神经网络——模型学习

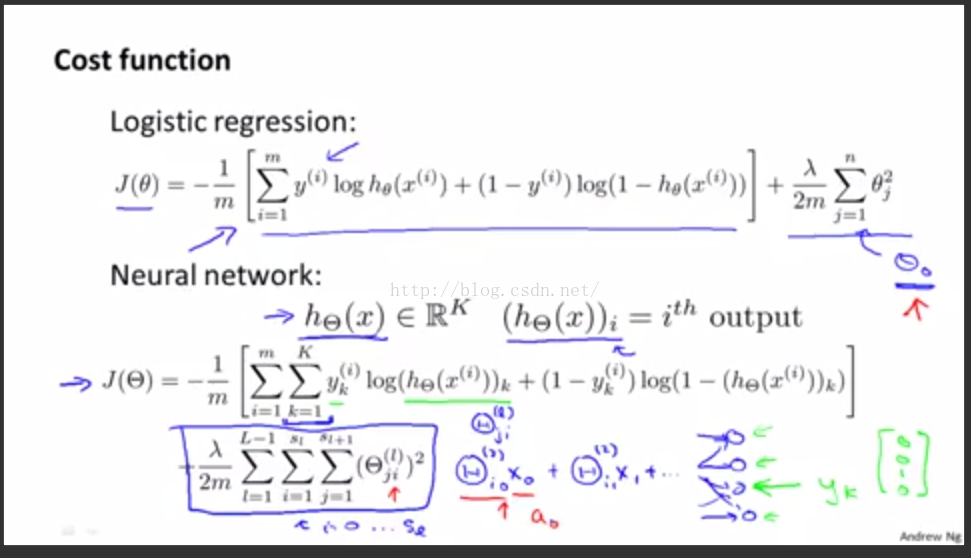

Cost Function:从逻辑回归推广过来

计算最小值,无论用什么方法,都需要计算代价和偏导。

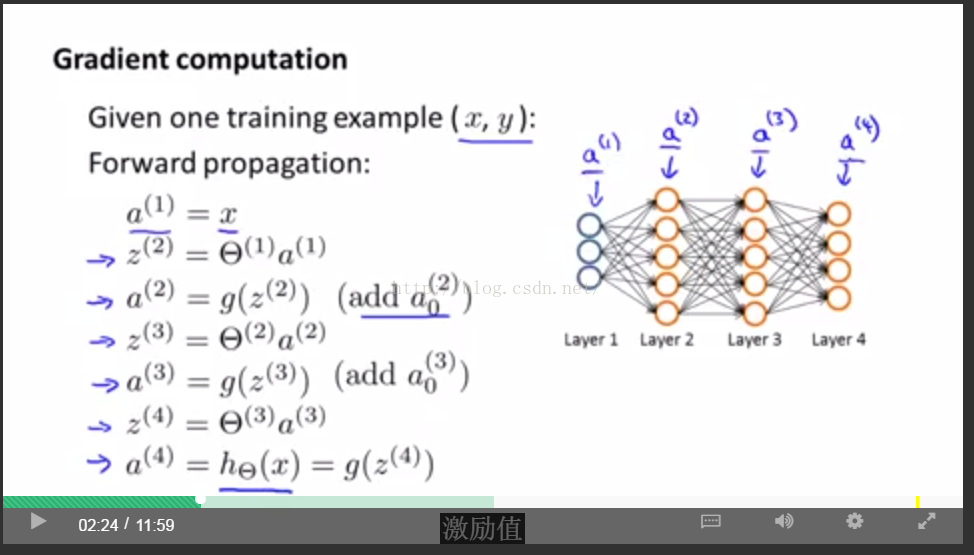

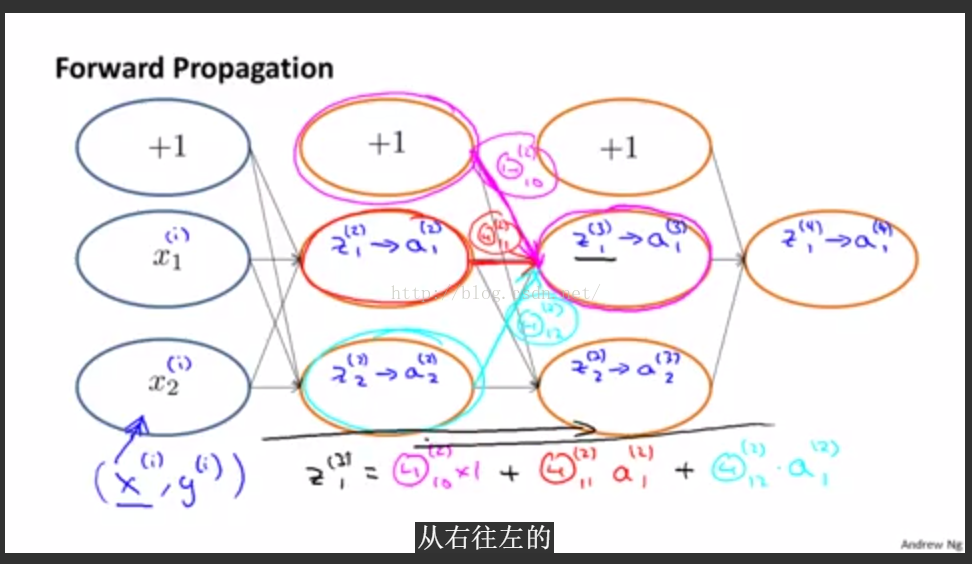

网络结构的前向传播和可向量化的特点:

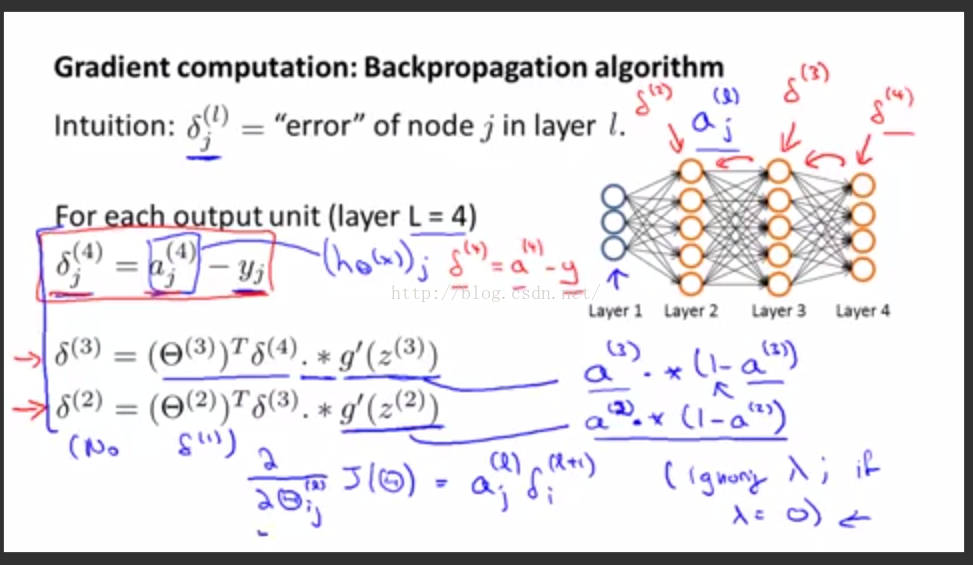

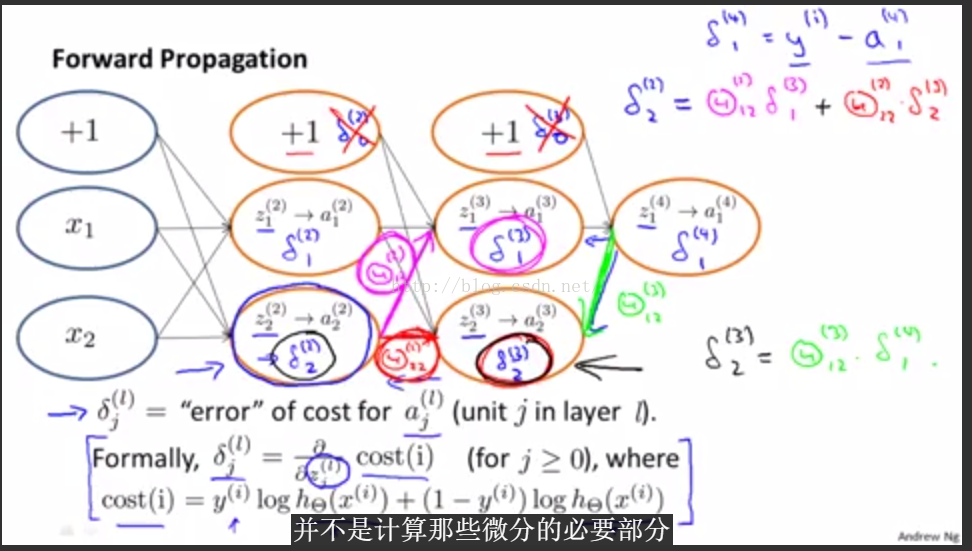

BP算法:

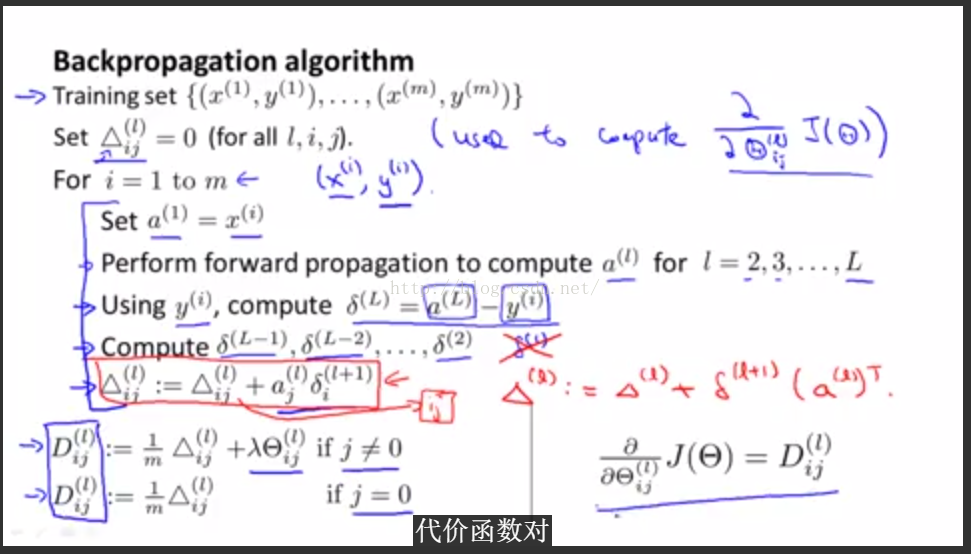

总结:计算代价函数及偏导

进一步理解FPBP:

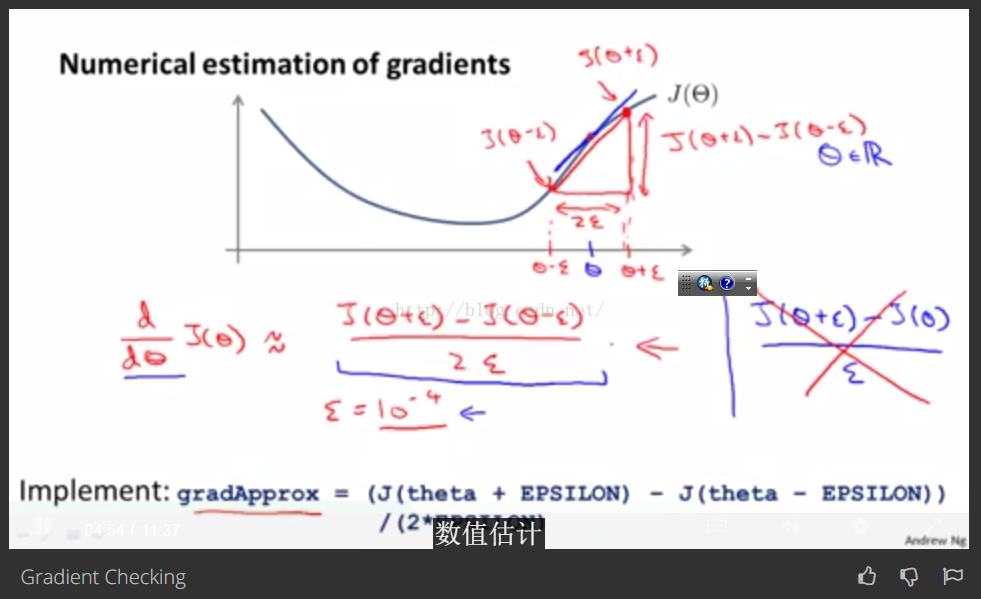

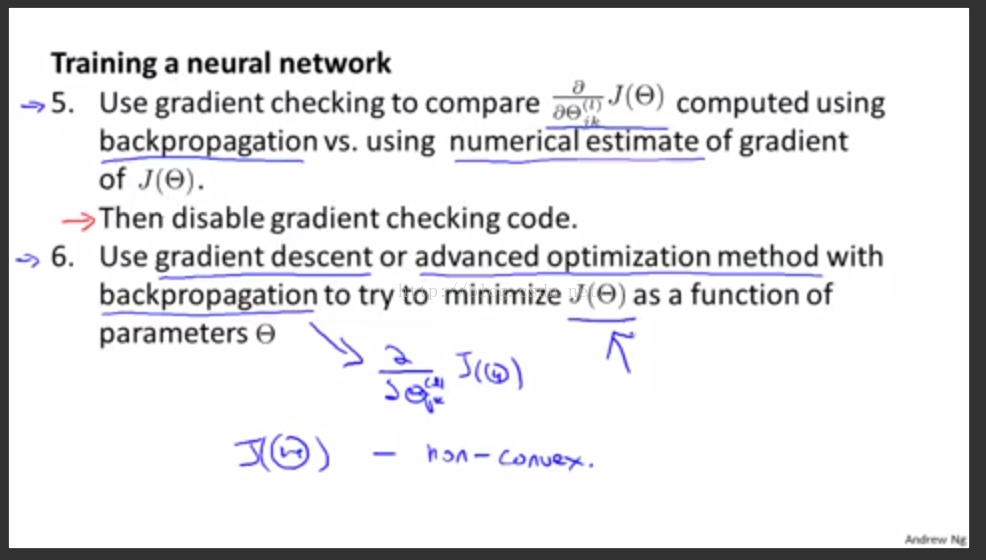

梯度检验:避免BP发生的小错误

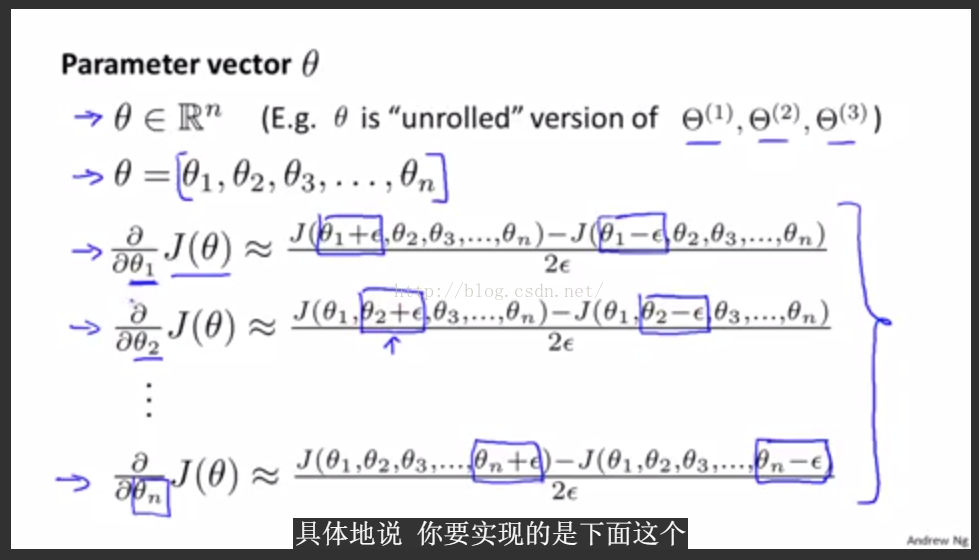

确保自己的确在计算代价函数的偏导数,对于向量形式,可以这么检验:

检验无误后要记得关掉检验功能,否则速度会慢.记得!!

数值方法计算梯度比BP算法慢.

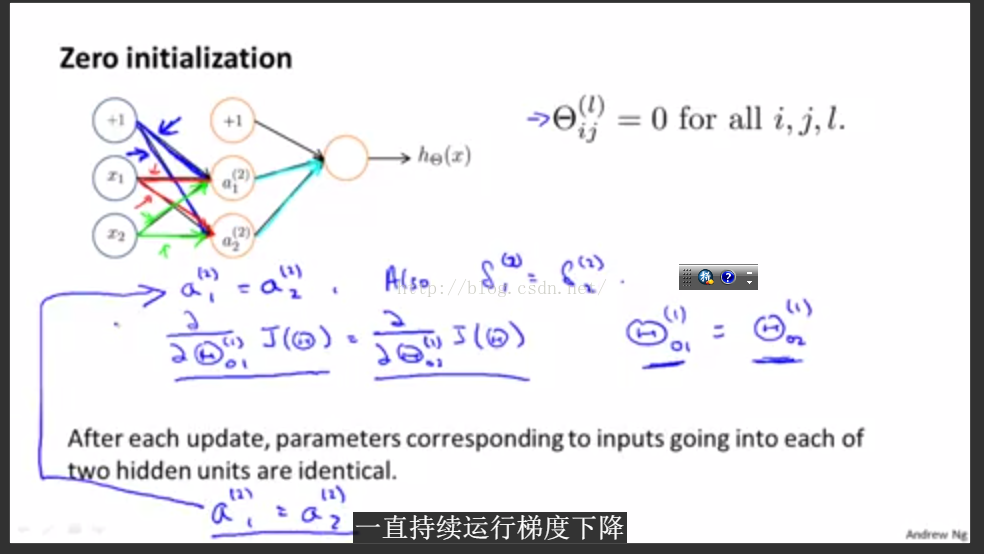

随机初始化权值:

都初始化为0的后果:

这样相当于每个神经元学习的东西都相同,相当于只在计算一个特征,这是完全多余的做法.所以要打破对称性.

随机初始化为一个区间内的接近0的小数.

总结:

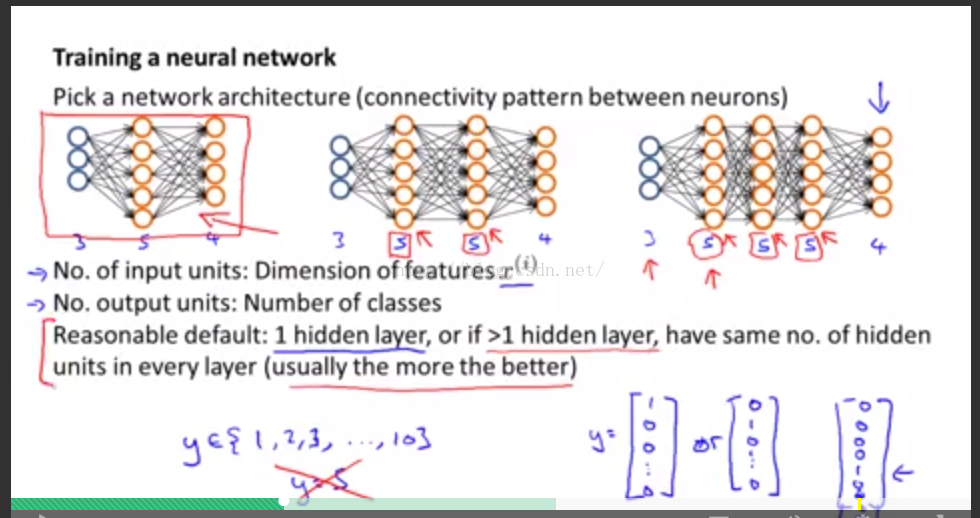

1、选择网络结构:

通常隐藏层一般越多越好,但计算量会大,一般默认一层隐藏层是比较合理的结构,隐藏层的数目稍微大于输入层数目是可以接受的.

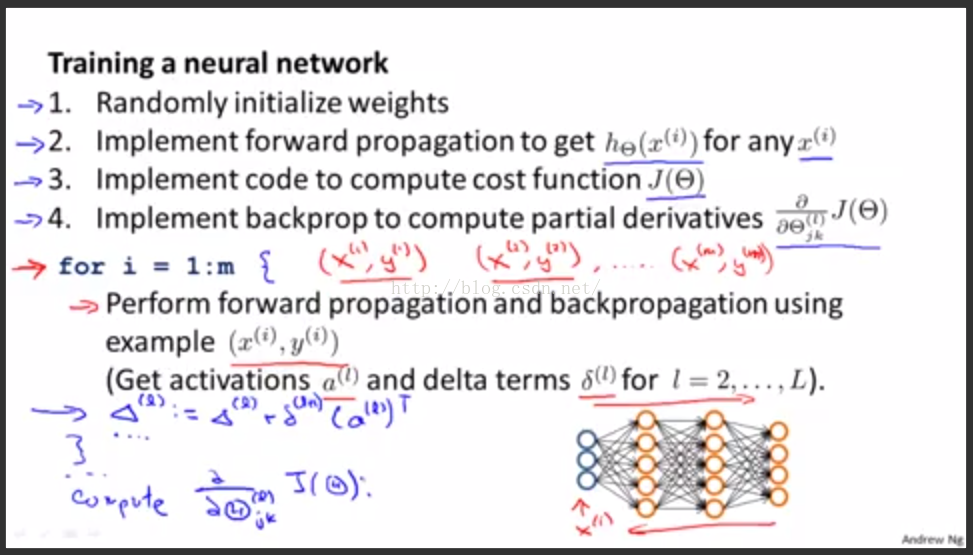

2、训练网络

给了个无人驾驶的例子

1934

1934

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?