人体姿态识别是计算机视觉领域的一个重要研究方向,旨在从图像或视频中准确推断出人体的姿势信息。通过人体姿态识别技术,我们可以实现人体动作分析、行为识别、运动捕捉等应用,对于智能监控、健康管理、虚拟现实等领域具有广泛的应用前景。

本教程将介绍人体姿态识别的基本概念、常用方法以及实际代码实现,帮助读者快速入门和理解这一领域的关键技术。

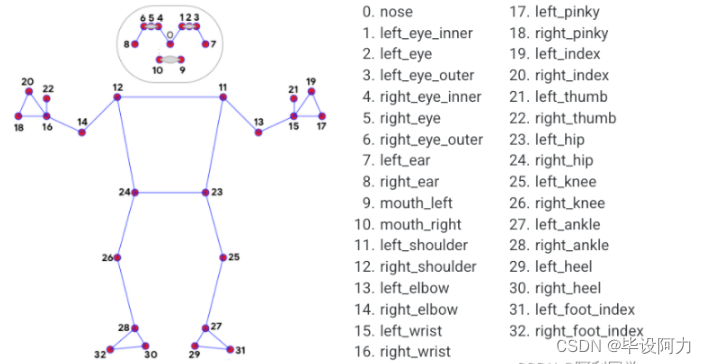

首先,我们将介绍人体姿态表示的方式,包括关节点标注、骨骼连接等基本概念,帮助读者了解如何用数学模型描述人体姿态。接着,我们将介绍常用的人体姿态识别方法,如基于深度学习的方法(如OpenPose、PoseNet)和传统的计算机视觉方法(如基于关键点匹配的方法),并比较它们的优缺点。

最后,我们将给出一个简单而有效的人体姿态识别代码示例,使用Python语言结合开源库(如OpenCV、TensorFlow等)实现基础的姿态检测功能。读者可以通过该示例代码,了解人体姿态识别的实际实现过程,并可以基于此进行进一步的探索和应用开发。

通过本教程,读者不仅可以掌握人体姿态识别的基本概念和常用方法,还可以通过实际代码实现加深对技术的理解和应用。希望本教程能为对人体姿态识别感兴趣的读者提供有益的指导和帮助,促进该领域的学习和研究。

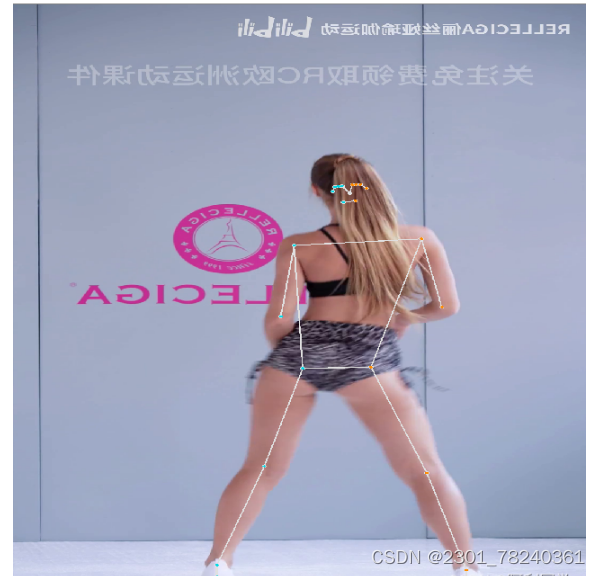

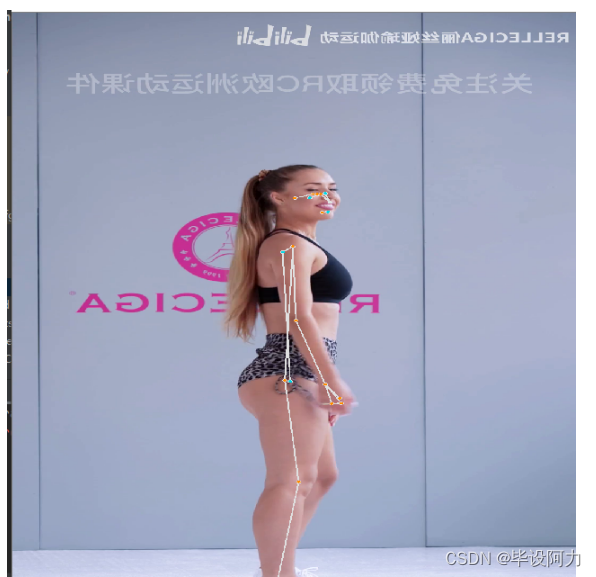

模型效果

从下图可以清楚的看到,提出的模型可以对人眼以及嘴巴进行描述。

最终的是对每个关节点进行了划分和表示。

算法代码

核心代码部分 顺便看下效果

支持的配置选项:

static_image_mode(静态图像模式)

model_complexity(模型复杂度)

smooth_landmarks(平滑标记点)

enable_segmentation(启用分割)

smooth_segmentation(平滑分割)

min_detection_confidence(最小检测置信度)

min_tracking_confidence(最小跟踪置信度)

with mp_pose.Pose(

#全部代码----->q767172261<---------

static_image_mode=True,

model_complexity=2,

enable_segmentation=True,

min_detection_confidence=0.5) as pose:

for idx, file in enumerate(IMAGE_FILES):

image = cv2.imread(file)

image_height, image_width, _ = image.shape

# Convert the BGR image to RGB before processing.

results = pose.process(cv2.cvtColor(image, cv2.COLOR_BGR2RGB))

if not results.pose_landmarks:

continue

print(

f'Nose coordinates: ('

f'{results.pose_landmarks.landmark[mp_pose.PoseLandmark.NOSE].x * image_width}, '

f'{results.pose_landmarks.landmark[mp_pose.PoseLandmark.NOSE].y * image_height})'

)

算法结论和效果展示

该流程是作为一个e图实现的,它使用了姿势标记模块中的姿势标记子图,并使用专用的姿势渲染器子图进行渲染。姿势标记子图在内部使用了姿势检测模块中的姿势检测子图。

代码部分可私信交流 Q7671722621

358

358

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?