前言

📅大四是整个大学期间最忙碌的时光,一边要忙着备考或实习为毕业后面临的就业升学做准备,一边要为毕业设计耗费大量精力。近几年各个学校要求的毕设项目越来越难,有不少课题是研究生级别难度的,对本科同学来说是充满挑战。为帮助大家顺利通过和节省时间与精力投入到更重要的就业和考试中去,学长分享优质的选题经验和毕设项目与技术思路。

🚀对毕设有任何疑问都可以问学长哦!

选题指导:

大家好,这里是海浪学长毕设专题,本次分享的课题是

🎯基于深度学习的成绩预测系统

设计思路

一、课题背景与意义

在教育领域,学生成绩预测是一个重要的问题,它有助于教师和教育机构更好地理解学生的学习状况,并为他们提供针对性的教学支持。近年来,随着深度学习技术的快速发展,基于深度学习的成绩预测系统逐渐受到关注。这类系统可以利用大量的学生数据,通过深度学习模型来预测学生的未来成绩,从而为教育决策提供数据支持。

二、算法理论原理

2.1 机器学习

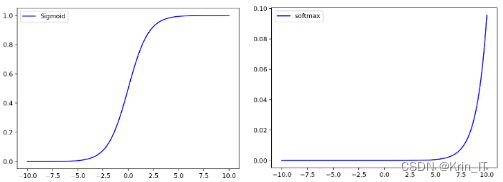

逻辑回归算法在分类问题中被广泛应用,可用于解决二分类和多分类问题。对于二分类问题,逻辑回归通过对输入属性特征进行加权并加上偏置项,得到一个线性函数。该线性函数的输出结果经过sigmoid函数的非线性转换,将结果映射到0到1之间,表示输入样本数据属于某一分类类别的概率值。如果概率大于0.5,则预测结果为正类别,否则为负类别。对于多分类问题,逻辑回归常采用一对多(One-vs-All)策略来处理。

在多分类问题中,逻辑回归的推广形式是Softmax回归。Softmax回归中,针对每个类别都有一个参数向量,用于计算输入样本属于该类别的概率值。在模型训练中,通过最大化似然函数来调整参数向量,使得模型可以正确分类每个样本。在预测阶段,输入样本计算每个类别的概率值,最终选择概率值最高的类别作为模型的预测结果。逻辑回归通过这种方式实现了对分类问题的有效建模和预测。

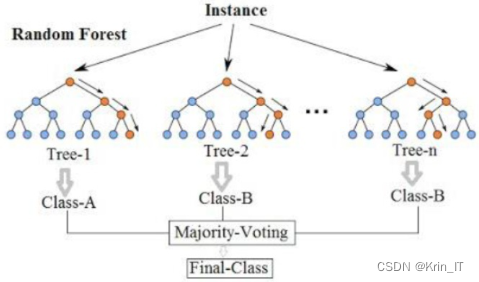

随机森林是一种强大的集成学习算法,广泛应用于分类、回归和特征选择等多个机器学习领域。它的核心思想是通过构建多个独立的决策树并将它们的预测结果进行集成,以提高模型的泛化能力和鲁棒性。在随机森林中,每个决策树都是在随机选择的特征子集上构建的,这种随机性不仅减少了特征之间的相关性,还使得模型更加难以过拟合。当使用随机森林进行预测时,会将输入数据分别输入到每个决策树中,得到每个决策树的预测结果。然后,通过投票机制将多个决策树的预测结果进行集成,得到最终的预测结果。这种集成策略充分利用了多个决策树之间的差异性,使得模型在面临复杂问题时能够更加稳健和准确地进行预测。

随机森林算法模型的分类流程包括三个主要步骤:首先,通过随机有放回抽样从原始训练集中生成多个子集,每个子集用于训练一棵决策树,从而构建出相互独立的决策树集合;其次,在构建每棵决策树时,随机选择特征集进行节点划分,以增加模型的多样性;最后,在分类过程中,每个决策树独立对测试样本进行分类,并采用多数投票法综合所有决策树的分类结果,选择出现最多次数的类别作为最终分类结果。这种集成学习策略使得随机森林具有出色的泛化能力和鲁棒性,适用于多种分类任务。

2.2 深度学习

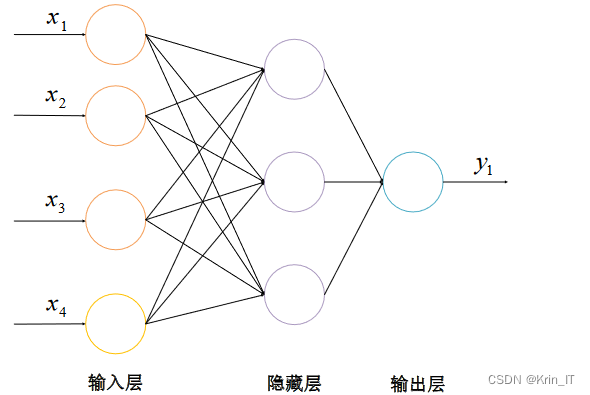

神经网络,作为人工智能领域的重要基石,已经深入影响了机器学习、计算机视觉、自然语言处理等多个领域的发展。通过模拟人类大脑神经元的连接与信息传递机制,神经网络实现了复杂数据的处理与分析。一个简单的神经网络结构通常包含输入层、隐藏层和输出层,每一层都由多个神经元组成,通过权重和激活函数进行数据的转换与传递。这种结构使得神经网络能够学习和识别数据的内在规律,进而解决各种实际问题,如图像识别、语音识别、自然语言处理等。特别是在二分类问题中,神经网络通过不断调整权重和偏置,使得输出层能够准确判断输入数据的类别。

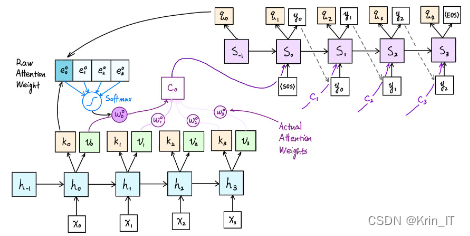

在自然语言处理中,自注意力机制被广泛应用于Transformer模型。在Transformer中,自注意力机制被用于计算输入序列中每个单词的权重,以便在生成输出序列时能够考虑到所有单词的信息。具体来说,对于输入序列中的每个单词,自注意力机制会计算一个权重向量,该向量表示该单词与其他单词之间的关联性。然后,这些权重向量被用于对输入序列进行加权求和,得到一个新的表示向量,该向量包含了所有单词的信息。

自注意力机制的实现方式通常采用多头注意力结构。多头注意力结构将输入序列分别输入到多个不同的自注意力层中,每个自注意力层都独立计算权重向量并进行加权求和。最后,这些自注意力层的输出被拼接起来,形成一个更丰富的表示向量。

三、检测的实现

3.1 数据集

在构建基于深度学习的成绩预测系统时,数据集的选择和处理至关重要。为了确保数据的质量和准确性,我选择了来自多个学校和学生群体的历史成绩数据,并进行了严格的数据清洗和预处理。为了增强模型的泛化能力,我还采用了数据扩充技术,如添加噪声、随机删除部分特征等,以模拟真实场景中数据的多样性。此外,我还利用了特征工程技术来提取和选择对预测有帮助的特征,以提高模型的预测性能。通过这些步骤,我成功地构建了一个高质量的成绩预测数据集,为模型的训练提供了有力支持。

数据扩充在深度学习中扮演着重要的角色,它可以帮助模型更好地泛化到未见过的数据。对于成绩预测系统而言,通过数据扩充可以增加训练样本的数量和多样性,提高模型的预测精度和稳定性。除了常见的添加噪声、随机删除特征等数据扩充方法外,还可以采用更高级的技术,如生成对抗网络(GAN)来生成新的合成数据。这些扩充后的数据将有助于提升成绩预测系统的性能,使其在实际应用中表现出更好的稳定性和适应性。

相关代码示例:

def train_gan(generator, discriminator, data, epochs=100):

for epoch in range(epochs):

# 训练生成器

noise = tf.random.normal(shape=(batch_size, noise_dim))

generated_data = generator(noise)

discriminator.trainable = False

fake_labels = tf.ones_like(generated_data)

real_labels = tf.zeros_like(data)

discriminator_loss = discriminator(generated_data, fake_labels) + discriminator(data, real_labels)

generator_optimizer.zero_grad()

discriminator_loss.backward()

generator_optimizer.step()

# 训练判别器

discriminator.trainable = True

fake_labels = tf.zeros_like(generated_data)

real_labels = tf.ones_like(data)

discriminator_loss = discriminator(generated_data, fake_labels) + discriminator(data, real_labels)

discriminator_optimizer.zero_grad()

discriminator_loss.backward()

discriminator_optimizer.step()3.2 实验环境搭建

实验环境使用Windows操作系统,并利用Python作为主要的编程语言进行算法和模型的实现。使用PyTorch作为深度学习框架,构建和训练神经网络模型。借助Pandas等库,完成数据的加载、处理和转换。这样的实验环境提供了一个方便和高效的平台,用于开发和测试算法系统。

3.3 实验及结果分析

在机器学习任务中,模型泛化能力的强弱至关重要,因此选择合适的评价指标来评估模型效果显得尤为重要。在处理可能存在的正负样本不均衡问题时,选择了四个常用的分类模型效果评价指标:准确率、精准率、召回率和F1-score。准确率反映了模型对所有样本的预测正确性,精准率衡量了模型预测某类别的准确性,召回率则关注实际属于某类别的样本中有多少被模型正确识别,而F1-score则是精准率和召回率的综合考量。这四个指标均要求越高越好,以全面评估模型的性能。

相关代码示例:

import pandas as pd

from sklearn.linear_model import LinearRegression

# 读取数据

data = pd.read_csv('student_data.csv') # 替换为你的数据文件路径

# 特征和目标变量

features = data[['Feature1', 'Feature2', ...]] # 选择特征列

targets = data['Target Variable'] # 选择目标变量列

# 划分训练集和测试集

X_train = features.values

y_train = targets.values

# 创建并拟合线性回归模型

regression_model = LinearRegression()

regression_model.fit(X_train, y_train)

# 进行预测

X_test = new_data[['Feature1', 'Feature2', ...]] # 新的数据用于预测

y_pred = regression_model.predict(X_test)

# 输出预测结果

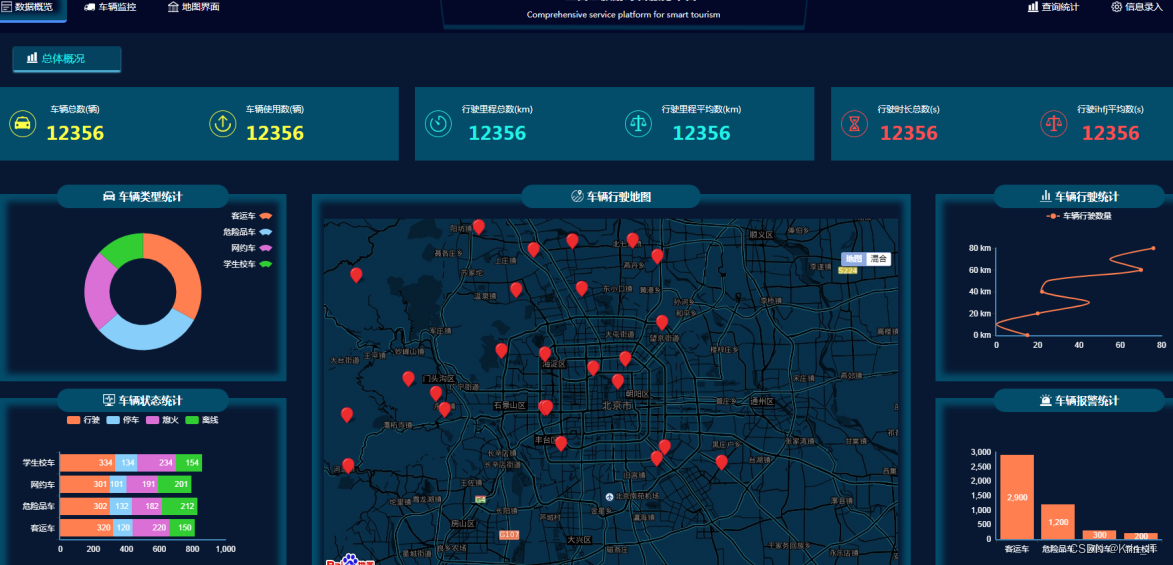

print("预测的成绩:", y_pred)实现效果图样例:

创作不易,欢迎点赞、关注、收藏。

毕设帮助,疑难解答,欢迎打扰!

2463

2463

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?