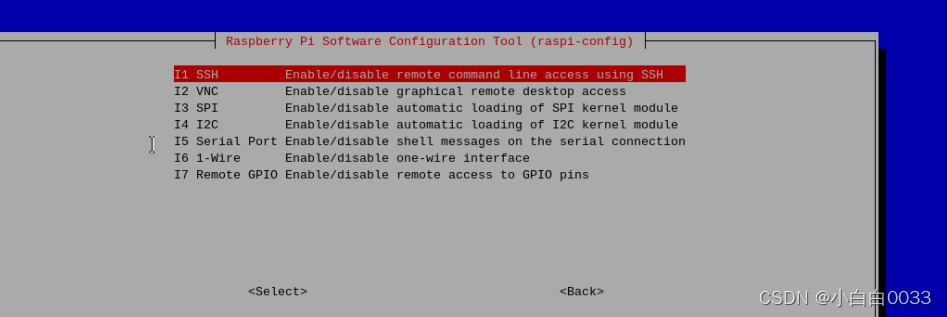

升级了最新的debian12系统后发现原来的传统摄像头的设置选项没有了

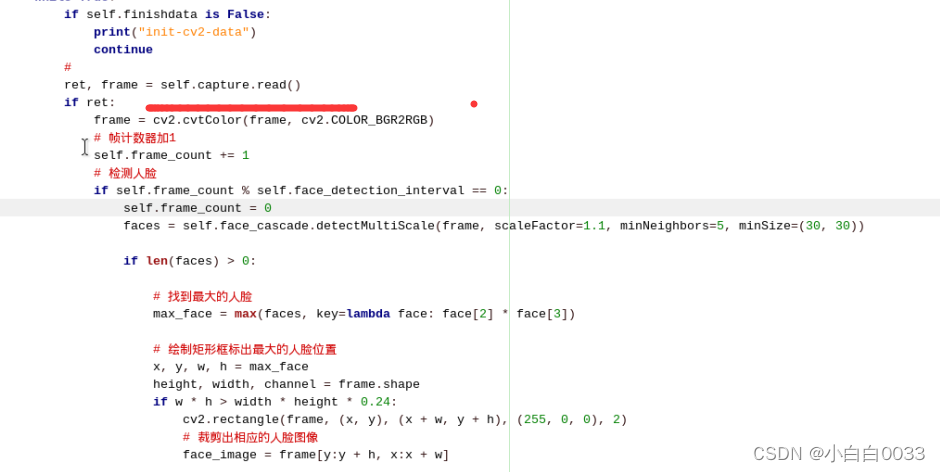

但是执行rpicam-hello能正常输出图像,在python的opencv中原来的读取帧的方法无法获取到任何内容

发现现在得用Picamera2的库来替代

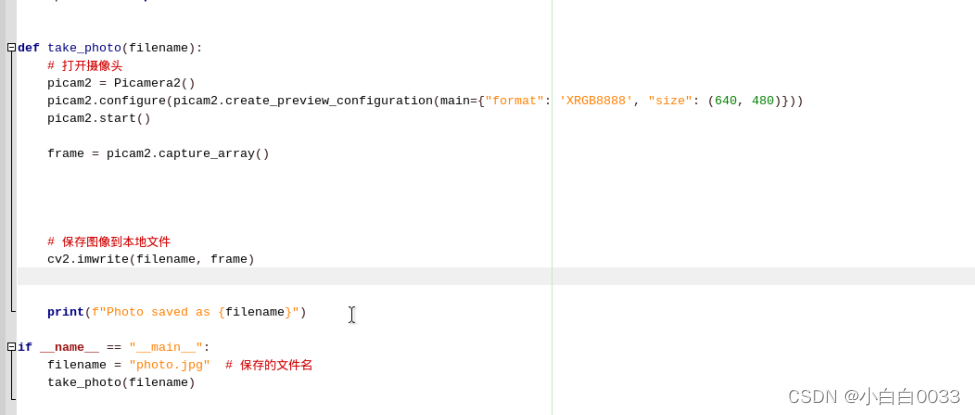

picam2 = Picamera2()

picam2.configure(picam2.create_preview_configuration(main={"format": 'XRGB8888', "size": (640, 480)}))

picam2.start()

frame = picam2.capture_array()

便可以正常使用了,折腾了2天才找到问题,还是不能随便上新版本...

参考自:

升级到Debian12后,旧版摄像头设置消失,需使用Picamera2库在Python和OpenCV中捕捉图像。`picamera2`的`capture_array`方法替代了传统方法,解决新系统兼容问题。

升级到Debian12后,旧版摄像头设置消失,需使用Picamera2库在Python和OpenCV中捕捉图像。`picamera2`的`capture_array`方法替代了传统方法,解决新系统兼容问题。

https://github.com/raspberrypi/picamera2/blob/main/examples/opencv_face_detect.py

https://github.com/raspberrypi/picamera2/blob/main/examples/opencv_face_detect.py

289

289

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?