在数据科学的丰富工具箱中,线性回归和逻辑回归是两种基础且广泛使用的模型。它们都是回归分析的典范,但适用于不同类型的预测问题。本文将为您详细解读这两种回归模型,帮助您理解它们的核心原理及如何在实际问题中应用它们。

线性回归(Linear Regression)

线性回归是用于建立连续响应变量与一个或多个解释变量之间关系的统计方法。它假设变量间存在线性关系,并通过找到最佳拟合直线来预测结果。

核心原理

线性回归模型通过最小化误差平方和来确定参数,即寻找一条直线 y = wx + b,其中 w 是斜率,代表解释变量对响应变量的影响强度;b 是截距,表示当解释变量为零时响应变量的期望值。

应用场景

经济领域:估算股票价格、汇率等金融指标。

社会科学:研究教育程度对收入水平的影响。

医学研究:分析药物剂量对治疗效果的作用。

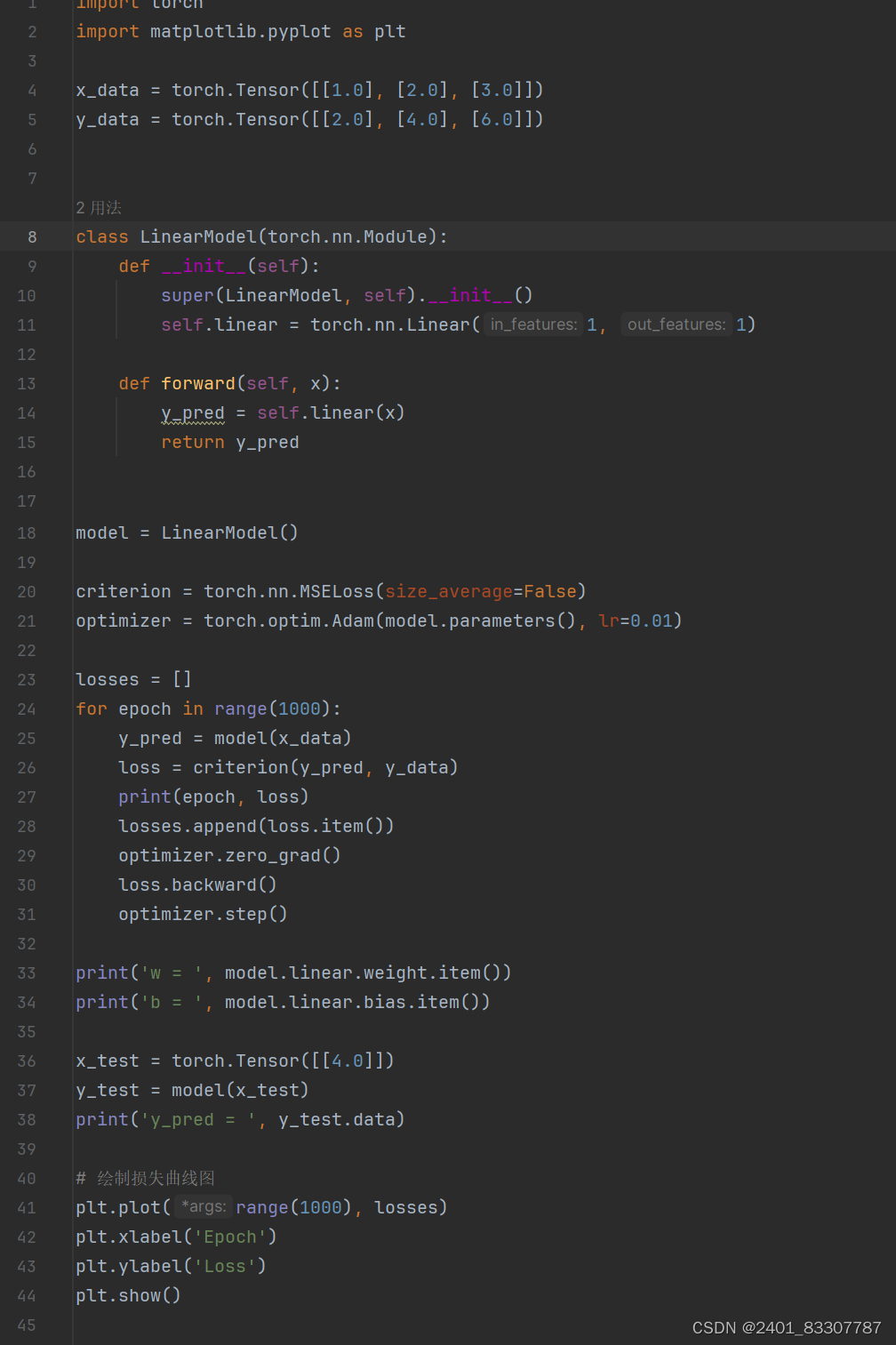

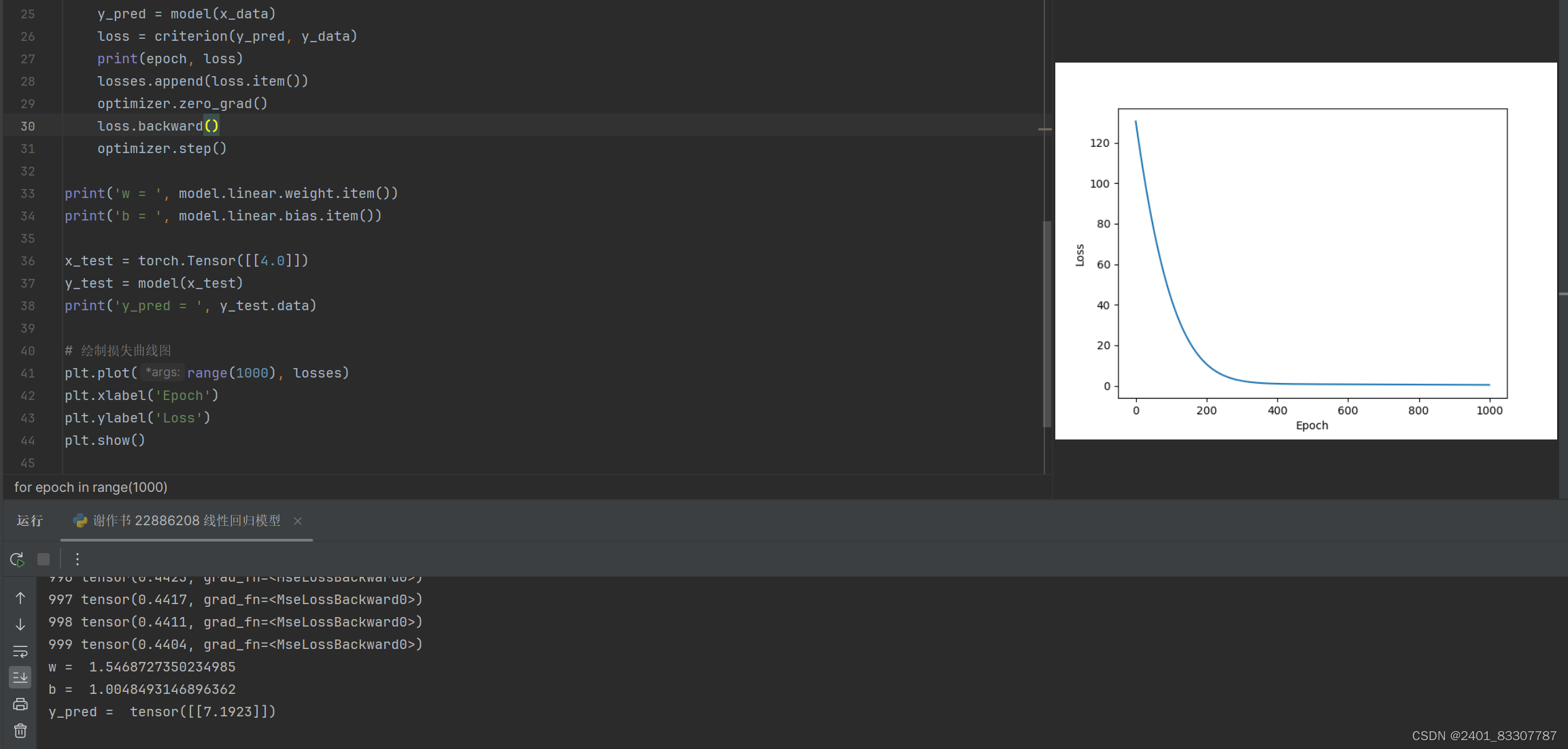

以下是一个简单示例:

运行结果:

逻辑回归(Logistic Regression)

当面对分类问题时,逻辑回归便是一种更合适的选择。它虽然名为回归,但实际上是一种分类算法,用于预测事件发生的概率。

核心原理

逻辑回归使用逻辑函数(sigmoid函数)将线性回归的输出映射到0至1之间,形成概率。其模型可表示为 p(y=1|x) = 1 / (1 + e^-(wx+b)),这样我们就能得出因变量取某一类别的概率。

应用场景

医疗诊断:评估患者是否有心脏病的风险。

垃圾邮件过滤:判断邮件是否为垃圾邮件。

客户流失预测:预测客户是否会离开,从而采取预防措施。

比较与对比

目标变量类型:线性回归预测连续数值,而逻辑回归预测离散的类别或者概率。

适用问题类型:线性回归适合回归问题,逻辑回归适合分类问题。

模型输出:线性回归输出实数,逻辑回归输出概率,通常以0.5为阈值进行分类。

损失函数:线性回归使用均方误差,逻辑回归使用交叉熵损失函数。

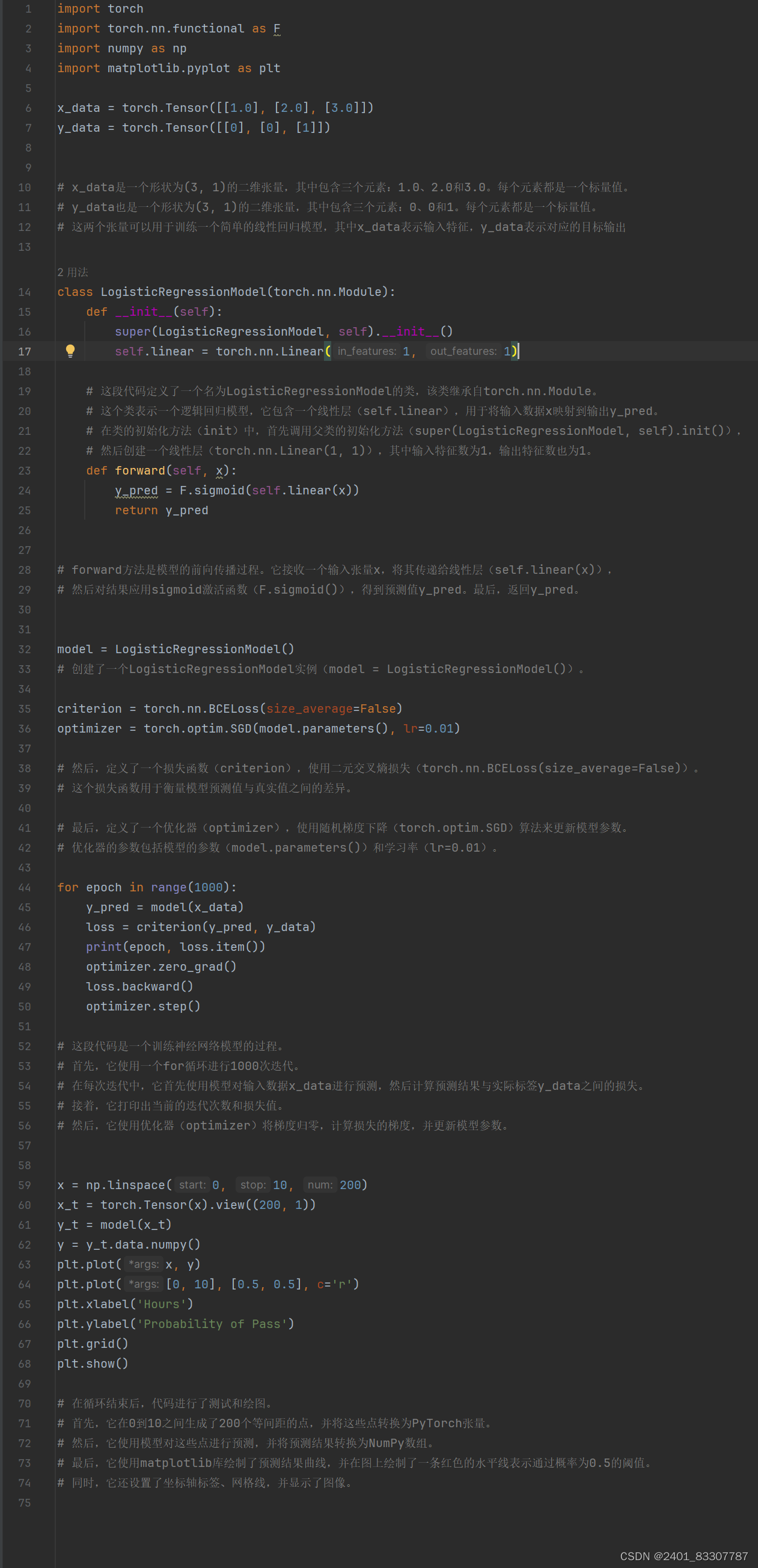

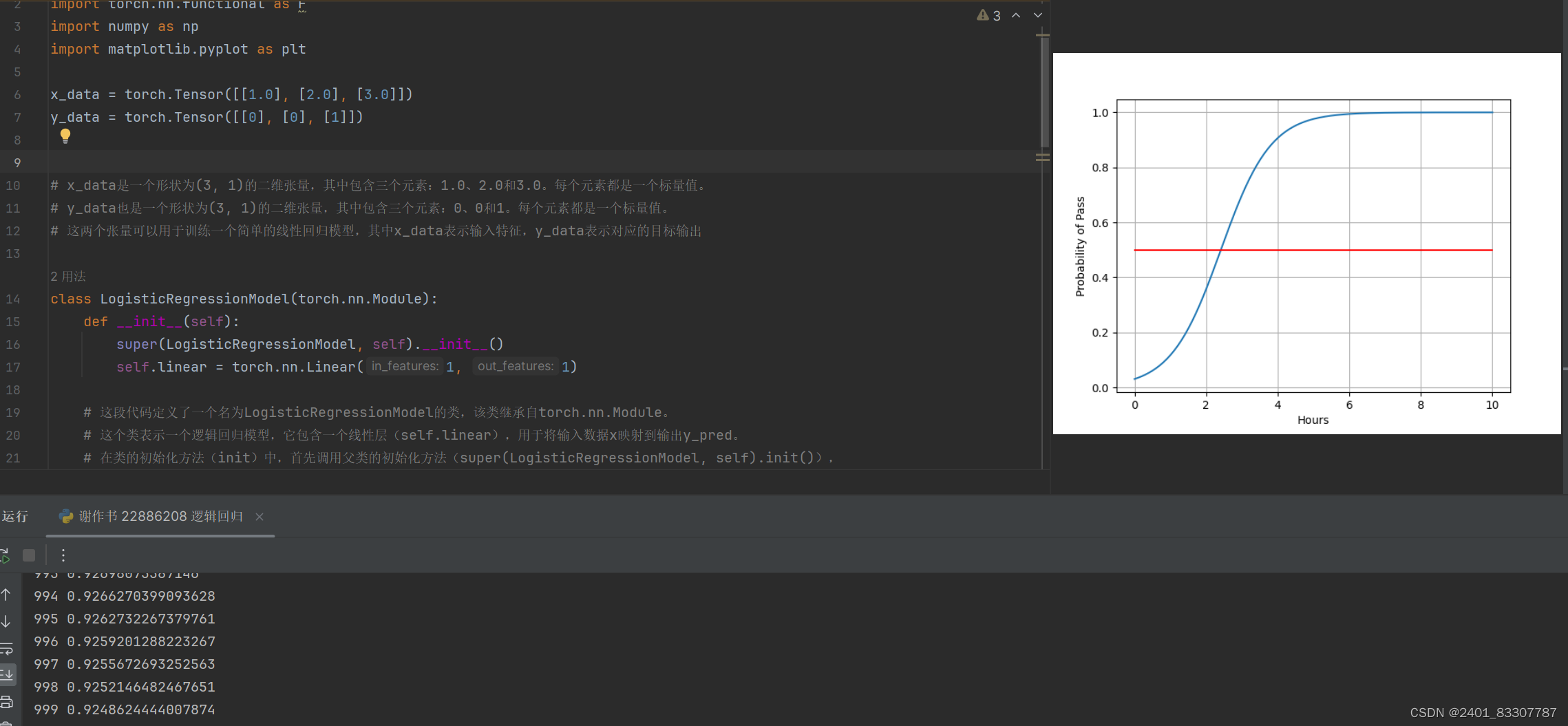

以下是一个简单示例:

运行结果:

本文详细介绍了线性回归和逻辑回归这两种基础的数据科学模型,分别探讨了它们的核心原理、应用场景以及对比,包括预测连续值与离散类别的差异,以及适用的损失函数和问题类型。

本文详细介绍了线性回归和逻辑回归这两种基础的数据科学模型,分别探讨了它们的核心原理、应用场景以及对比,包括预测连续值与离散类别的差异,以及适用的损失函数和问题类型。

742

742

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?