读者福利

更多笔记分享

1.单视角方法

单视角方法是最常见的3D人体姿态估计方法之一。它通过从单个摄像机视角捕捉的图像中推断出人体的三维姿态。这种方法通常分为两个步骤:2D姿态估计和3D重建。

在2D姿态估计阶段,深度学习模型被用于从输入图像中检测和定位人体关键点。这些关键点可以是人体的关节位置或特定身体部位的标记点。通过预测这些关键点的位置,可以得到人体在图像中的二维姿态信息。

然后,在3D重建阶段,使用将二维姿态信息与其他信息(如深度图像、摄像机参数等)结合起来,通过一些几何变换方法,将二维姿态信息转换为三维姿态信息。这些几何变换方法可以是透视投影、三角测量等。最终,通过这些步骤,我们可以得到人体的三维姿态。

2.多视角方法

多视角方法利用从多个不同视角或摄像机捕捉的图像进行3D人体姿态估计。这种方法可以通过利用多个视角的互补信息来提高姿态估计的准确性。

在多视角方法中,首先通过单视角方法对每个摄像机视角的图像进行2D姿态估计。然后,通过使用多个视角的2D姿态信息,结合摄像机参数和几何约束,将2D姿态信息转换为3D姿态信息。

多视角方法的主要优势在于能够提供更多的观察角度和更多的几何信息,从而提高了姿态估计的准确性和稳定性。但同时,它也增加了系统的复杂性,需要进行多个视角的图像对齐和标定等步骤。

3.基于深度学习的方法

近年来,基于深度学习的方法在3D人体姿态估计领域取得了显著的进展。这些方法利用深度学习模型对大规模数据集进行训练,从而学习到人体姿态的特征表示和模式。

基于深度学习的方法通常采用端到端的训练策略,即将输入图像作为模型的输入,直接输出人体的三维姿态。这种方法可以避免传统方法中的多个阶段处理,并且能够通过大规模数据集的训练来提高姿态估计的准确性。

基于深度学习的方法通常采用卷积神经网络(CNN)或循环神经网络(RNN)等深度学习模型进行姿态估计。这些模型通常使用3D姿态标注数据进行训练,以学习从图像到姿态的映射关系。

4.结合传感器的方法

除了使用图像或视频作为输入,还可以结合其他传感器,如深度摄像机(如Microsoft Kinect)或惯性测量单元(IMU),来提高3D人体姿态估计的准确性和鲁棒性。

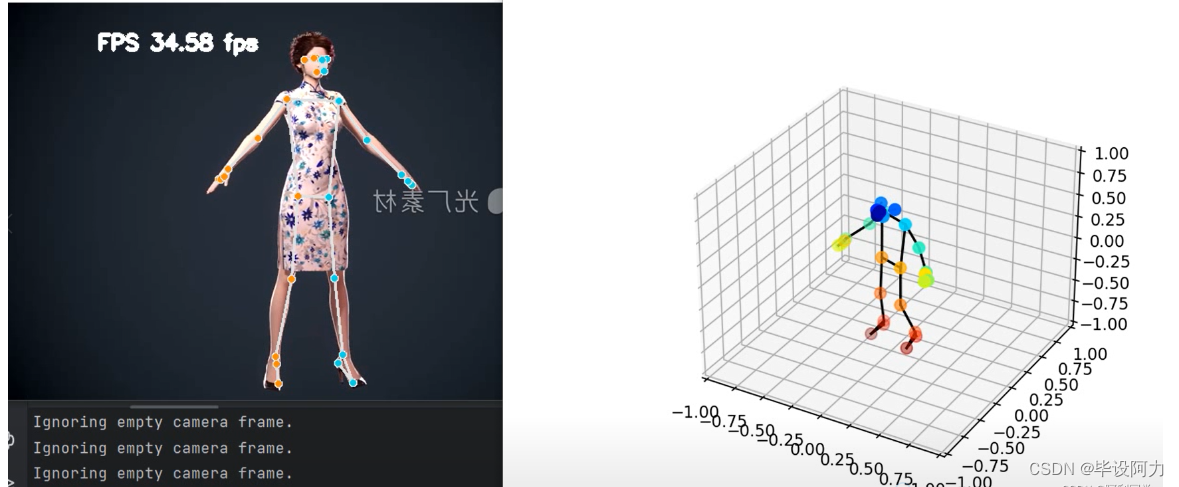

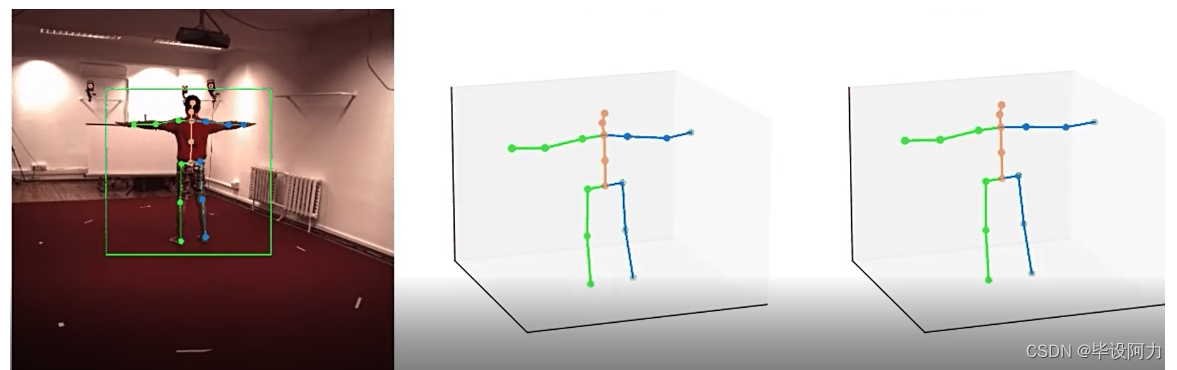

模型效果

深度摄像机可以提供人体的深度信息,从而帮助更准确地估计三维姿态。IMU可以提供人体的运动信息,从而帮助解决动态姿态估计的问题。

代码介绍

import torch

from torch.utils.data import DataLoader

from torchvision.transforms import Normalize

from openpose import OpenPoseModel, OpenPoseDataset

# 设置设备

device = torch.device("cuda" if torch.cuda.is_available() else "cpu")

# 模型路径和参数

model_path = "path_to_pretrained_model.pth"

input_size = (256, 256)

output_size = (64, 64)

num_joints = 17

# 加载模型

model = OpenPoseModel(num_joints=num_joints, num_stages=4, num_blocks=[1, 1, 1, 1]).to(device)

model.load_state_dict(torch.load(model_path))

model.eval()

# 数据集路径

dataset_path = "path_to_dataset"

# 数据预处理

normalize = Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225])

# 加载数据集

dataset = OpenPoseDataset(dataset_path, input_size, output_size, normalize=normalize)

dataloader = DataLoader(dataset, batch_size=8, shuffle=True, num_workers=4)

# 测试模型

total_loss = 0

total_samples = 0

with torch.no_grad():

for i, (images, targets) in enumerate(dataloader):

images = images.to(device)

targets = targets.to(device)

# 前向传播

outputs = model(images)

# 计算损失

loss = torch.mean((outputs - targets) ** 2)

total_loss += loss.item() * images.size(0)

total_samples += images.size(0)

average_loss = total_loss / total_samples

print("Average Loss: {:.4f}".format(average_loss))

## 总结

对于面试,一定要有良好的心态,这位小伙伴面试美团的时候没有被前面阿里的面试影响到,发挥也很正常,也就能顺利拿下美团的offer。

小编还整理了大厂java程序员面试涉及到的绝大部分**面试题及答案**,希望能帮助到大家,

最后感谢大家的支持,希望小编整理的资料能够帮助到大家!也祝愿大家都能够升职加薪!

> **本文已被[CODING开源项目:【一线大厂Java面试题解析+核心总结学习笔记+最新讲解视频+实战项目源码】](https://bbs.csdn.net/topics/618154847)收录**

**[需要这份系统化的资料的朋友,可以点击这里获取](https://bbs.csdn.net/topics/618154847)**

a面试题解析+核心总结学习笔记+最新讲解视频+实战项目源码】](https://bbs.csdn.net/topics/618154847)收录**

**[需要这份系统化的资料的朋友,可以点击这里获取](https://bbs.csdn.net/topics/618154847)**

2506

2506

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?