import torch

### 2.1 张量的创建

1. 创建一个没有初始化的张量

a = torch.empty(5, 3)

print(a)

tensor([[2.4835e+27, 2.5428e+30, 1.0877e-19],

[1.5163e+23, 2.2012e+12, 3.7899e+22],

[5.2480e+05, 1.0175e+31, 9.7056e+24],

[1.6283e+32, 3.7913e+22, 3.9653e+28],

[1.0876e-19, 6.2027e+26, 2.3685e+21]])

2. 创建一个有初始化的张量

b = torch.rand(5, 3)

torch.rand()返回一个张量,包含了从区间[0, 1)的均匀分布中抽取的一组随机数

torch.randn()返回一个张量,包含了从标准正态分布(均值为0,差为1,即高斯白噪声)中抽取的一组随机数。

torch.randint(参数1,参数2) 左闭右开

random.randint(参数1,参数2) 左闭右闭

print(b)

tensor([[0.1368, 0.8070, 0.4567],

[0.4369, 0.8278, 0.5552],

[0.6848, 0.4473, 0.1031],

[0.5308, 0.9194, 0.2761],

[0.0484, 0.9941, 0.2227]])

>

> 对比有无初始化的矩阵:当声明一个未初始化的矩阵时,它本身不包含任何确切的值.。当创建一个未初始化的矩阵时,分配给矩阵的内存中有什么数值就赋值给了这个矩阵,本质上是毫无意义的数据。

>

>

>

3. 创建一个全零张量并可指定数据元素的类型为long

c = torch.zeros(5, 3, dtype=torch.long)

print©

tensor([[0, 0, 0],

[0, 0, 0],

[0, 0, 0],

[0, 0, 0],

[0, 0, 0]])

同样地,还有 `torch.ones()`

4. 直接通过数据创建张量

d = torch.tensor([2.5, 3.5])

print(d) # tensor([2.5000, 3.3000])

5. 使用 numpy 中的数组创建 tensor

torch.tensor(np.array([[1, 2, 3], [4, 5, 6]]))

6. 通过已有的一个张量创建指定尺寸的新张量

x = d.new_ones(5, 3, dtype=torch.double)

print(x)

tensor([[1., 1., 1.],

[1., 1., 1.],

[1., 1., 1.],

[1., 1., 1.],

[1., 1., 1.]], dtype=torch.float64)

7. 通过已有的一个张量创建相同尺寸的新张量

利用randn_like方法得到相同张量尺寸的一个新张量, 并且采用随机初始化来对其赋值

y = torch.randn_like(x, dtype=torch.float)

print(y)

tensor([[-0.1497, -0.5832, -0.3805],

[ 0.9001, 2.0637, 1.3299],

[-0.8813, -0.6579, -0.9135],

[-0.1374, 0.1000, -0.9343],

[-1.1278, -0.9140, -1.5910]])

### 2.2 张量的属性

1. 获取张量的大小

print(y.size()) # torch.Size([5, 3])

>

> `torch.Size` 函数本质上返回的是一个tuple,因此它支持一切元组的操作。

>

>

>

2. 改变张量的形状

i = torch.randn(4, 4)

tensor.view()操作需要保证数据元素的总数量不变

j = i.view(16)

-1代表自动匹配个数

k = i.view(-1, 8)

print(i.size(), j.size(), k.size())

torch.Size([4, 4]) torch.Size([16]) torch.Size([2, 8])

### 2.3 张量的运算

1. 加法操作

第一种加法操作

print(x + y)

第二种加法操作

print(torch.add(x, y))

第三种加法操作

提前设定一个空的张量

result = torch.empty(5, 3)

将空的张量作为加法的结果存储张量

torch.add(x, y, out=result)

print(result)

第四种加法方式

原地置换

y.add_(x)

print(y)

>

> 注意:所有 `in-place` 的操作函数都有一个下划线的后缀,比如 `x.copy_(y),x.add_(y)`,都会直接改变 `x` 的值

>

>

>

### 2.4 获取张量元素

1. 取出元素

如果张量中只有一个元素,可以用 `.item()` 将值取出,作为一个 python number(真实值)

n = torch.randn(1)

print(n)

print(n.item())

tensor([-0.3531])

-0.3530771732330322

2. 切片

用类似于Numpy 的方式对张量进行操作:

print(x[:, 1])

tensor([1., 1., 1., 1., 1.], dtype=torch.float64)

### 2.5 类型转换

Torch Tensor和Numpy array的转换

a = torch.ones(5)

print(a) # tensor([1., 1., 1., 1., 1.])

1. 将 Torch Tensor 转换为 Numpy array

b = a.numpy()

print(b) # [1. 1. 1. 1. 1.]

对其中一个进行加法操作,另一个也随之被改变

a.add_(1)

print(a)

tensor([2., 2., 2., 2., 2.])

print(b)

[2. 2. 2. 2. 2.]

2. 将 Numpy array 转换为 Torch Tensor

import numpy as np

a = np.ones(5)

b = torch.from_numpy(a)

print(a)

[1. 1. 1. 1. 1.]

print(b)

tensor([1., 1., 1., 1., 1.], dtype=torch.float64)

np.add(a, 1, out=a)

print(a)

[2. 2. 2. 2. 2.]

print(b)

tensor([2., 2., 2., 2., 2.], dtype=torch.float64)

>

> 注意:

>

>

> * 所有在CPU上的Tensors,除了CharTensor,都可以转换为Numpy array并可以反向转换

> * Torch Tensor 和 Numpy array共享底层的内存空间,因此改变其中一个的值,另一个也会随之被改变。

>

>

>

>

> 关于Cuda Tensor: Tensors可以用`.to()`方法来将其移动到任意设备上。

>

>

> * GPU:“cuda”

> * CPU:“cpu”

>

>

>

x = torch.zeros(5, 3, dtype=torch.long)

如果服务器上已经安装了GPU和CUDA

if torch.cuda.is_available():

# 定义一个设备对象, 这里指定成CUDA, 即使用GPU

device = torch.device(“cuda”)

# 直接在GPU上创建一个Tensor

y = torch.ones_like(x, device=device)

# 将在CPU上面的x张量移动到GPU上面

x = x.to(device)

# x和y都在GPU上面, 才能支持加法运算

z = x + y

# 此处的张量z在GPU上面

print(z)

# 也可以将z转移到CPU上面, 并同时指定张量元素的数据类型

print(z.to(“cpu”, torch.double))

tensor([[1, 1, 1],

[1, 1, 1],

[1, 1, 1],

[1, 1, 1],

[1, 1, 1]], device=‘cuda:0’)

tensor([[1., 1., 1.],

[1., 1., 1.],

[1., 1., 1.],

[1., 1., 1.],

[1., 1., 1.]], dtype=torch.float64)

## 3 Pytorch中的 autograd

>

> 在整个 Pytorch 框架中,所有的神经网络本质上都是一个autograd package(自动求导工具包),它提供了一个对 Tensors 上所有的操作进行自动微分的功能。

>

>

>

### 3.1 torch.Tensor 介绍

`torch.Tensor` 是整个 package 中的核心类

* 如果将属性`.requires_grad` 设置为 `True`,它将追踪在这个类上定义的所有操作。

* 当代码要进行反向传播的时候,直接调用 `.backward()` 就可以自动计算所有的梯度(前提是属性`.requires_grad` 设置为 `True`)。

* 在这个Tensor上的所有梯度将被累加进属性 `.grad` 中。

* 如果想终止一个Tensor 在计算图中的追踪回溯(反向传播),只需要执行`.detach()`就可以将该Tensor从计算图中撤下,在未来的回溯计算中也不会再计算该Tensor。

* 如果想终止对整个计算图的追踪回溯,也就是不再进行方向传播求导数的过程,也可以采用代码块的方式`with torch.no_grad():`,这种方式非常适用于对模型进行 **预测** 的时候,因为预测阶段不再需要对梯度进行计算。

`torch.Function`是和`torch.Tensor` 同等重要的一个核心类,

* `torch.Function`和Tensor共同构建了一个完整的类, 每一个Tensor拥有一个`.grad_fn`属性,代表引用了哪个具体的 Function 创建了该Tensor。

* 如果某个张量Tensor是用户自定义的,则其对应的grad\_fn is None。

### 3.2 torch.Tensor 操作

不设置requires_grad

x1 = torch.ones(3, 3)

print(x1)

设置requires_grad

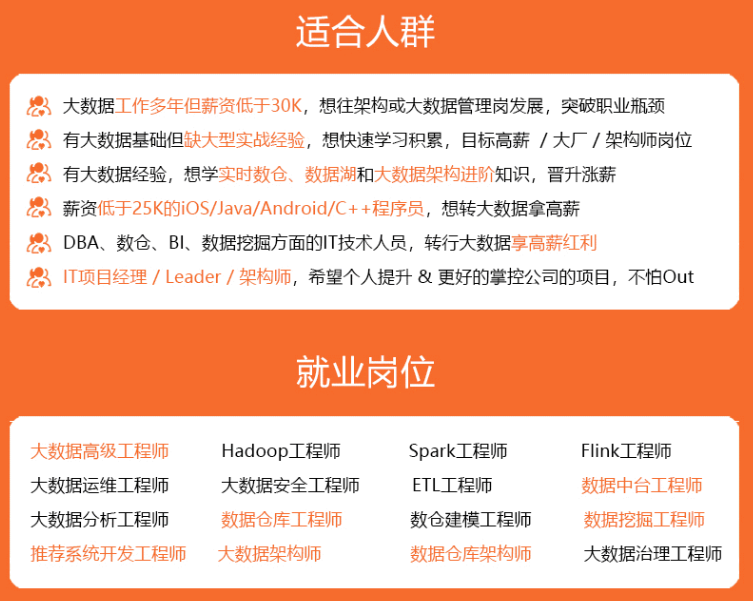

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

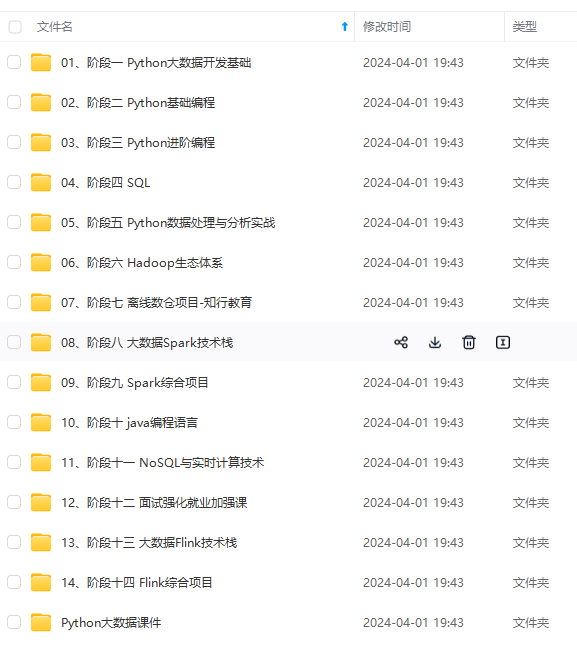

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

.2 torch.Tensor 操作

# 不设置requires\_grad

x1 = torch.ones(3, 3)

print(x1)

# 设置requires\_grad

[外链图片转存中...(img-GmbFzP6K-1714160887800)]

[外链图片转存中...(img-RhR2e79n-1714160887800)]

[外链图片转存中...(img-fBJnoIN7-1714160887801)]

**既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!**

**由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新**

**[需要这份系统化资料的朋友,可以戳这里获取](https://bbs.csdn.net/topics/618545628)**

本文详细介绍了如何在PyTorch中创建和操作张量,包括无初始化、有初始化、指定数据类型和维度的创建方法,以及张量的属性如大小、形状变换,以及基本的加法运算。此外,还概述了autograd模块的基本概念和torch.Tensor的自动求导功能。

本文详细介绍了如何在PyTorch中创建和操作张量,包括无初始化、有初始化、指定数据类型和维度的创建方法,以及张量的属性如大小、形状变换,以及基本的加法运算。此外,还概述了autograd模块的基本概念和torch.Tensor的自动求导功能。

401

401

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?