每个点云类别文件夹下有若干个txt的点云数据

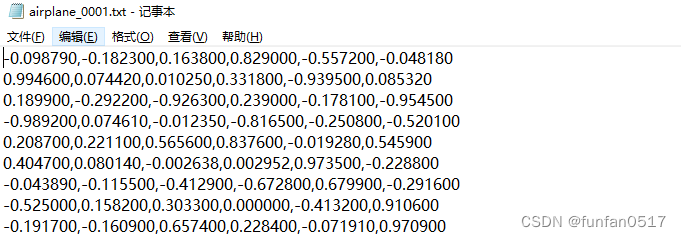

每个点云数据有若干行点数据,每行点数据包含x,y,z,nx,ny,nz等6个数据。

x、y、z为点云的空间坐标,nx、ny、nz为点云的法向量。

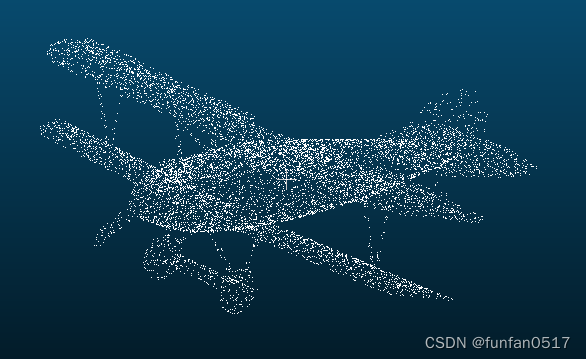

安装 CloudCompare软件可以打开txt点云文件

1.1.2制作个性化数据集

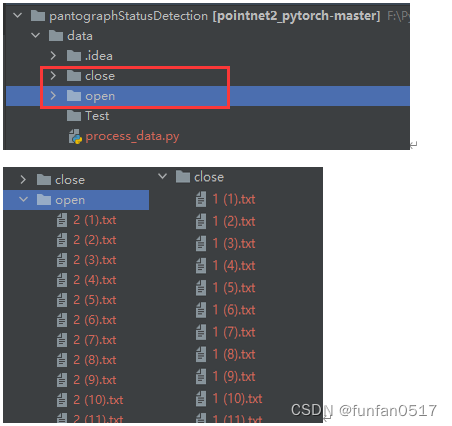

本次实验目标是检测受电弓开合状态,需要采集open和close两类点云数据,Test是一个存放最终真实无标签测试数据的空目录,process_data.py是一个自动生成数据集配置文件的脚本,后续会介绍

1.2 记录点云数据的配置文件

1.2.1原数据集介绍

除了分类点云数据外,还需要一些记录点云数据文件路径、类别、训练集、测试集的配置文件。

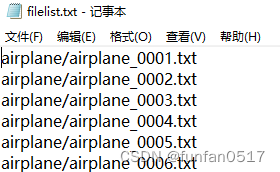

(1)filelist.txt记录了点云数据的相对文件路径

(2)modelnet40_shape_names.txt记录了全部类别

(3)modelnet40_train.txt记录了从数据集中划分的训练集

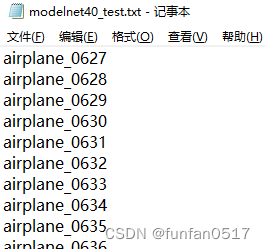

(4)modelnet40_test.txt记录了从数据集中划分的测试集

1.2.2制作个性化数据集

编写process_data.py数据集预处理脚本文件

import os

import random

import shutil

from pathlib import Path

获取当前程序执行的工作目录

current_directory = os.getcwd()

directory_name = os.path.basename(current_directory)

带类别标签的数据集所在目录

folder_paths = [Path(current_directory + “/open”), Path(current_directory + “/close”)]

初始化目录中文件

test_folder_path = Path(current_directory + “/Test”)

shutil.rmtree(test_folder_path)

os.mkdir(test_folder_path)

for folder_path in folder_paths:

file_list = list(folder_path.glob(“*”))

for i, file_path in enumerate(file_list, start=1):

new_file_name = f"{str(i).zfill(4)}{file_path.suffix}"

new_file_path = folder_path / new_file_name

if new_file_path.exists():

continue

file_path.rename(new_file_path)

生成以下目标文件(配置文件)

txt_file_path = Path(current_directory + “/filelist.txt”) # 记录全部带标签的数据集文件(带后缀名)

txt_file_path2 = Path(current_directory + f"/{directory_name}_train.txt") # 记录全部带标签的训练文件(不带后缀名)

txt_file_path3 = Path(current_directory + f"/{directory_name}_test.txt") # 记录全部带标签的测试文件(不带后缀名)

txt_file_path4 = Path(current_directory + f"/{directory_name}_shape_names.txt") # 记录全部类别(不带后缀名)

txt_file_path5 = Path(current_directory + f"/{directory_name}_realtest.txt") # 记录不带标签的真实测试文件(不带后缀名)

打开目标文件

with txt_file_path.open(“w”) as txt_file, txt_file_path2.open(“w”) as txt_file2, txt_file_path3.open(

“w”) as txt_file3, txt_file_path4.open(“w”) as txt_file4:

自我介绍一下,小编13年上海交大毕业,曾经在小公司待过,也去过华为、OPPO等大厂,18年进入阿里一直到现在。

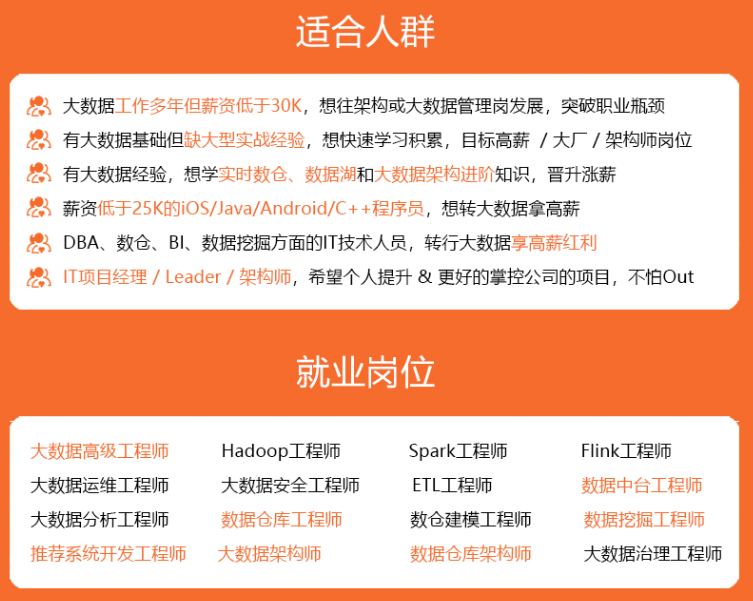

深知大多数大数据工程师,想要提升技能,往往是自己摸索成长或者是报班学习,但对于培训机构动则几千的学费,着实压力不小。自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

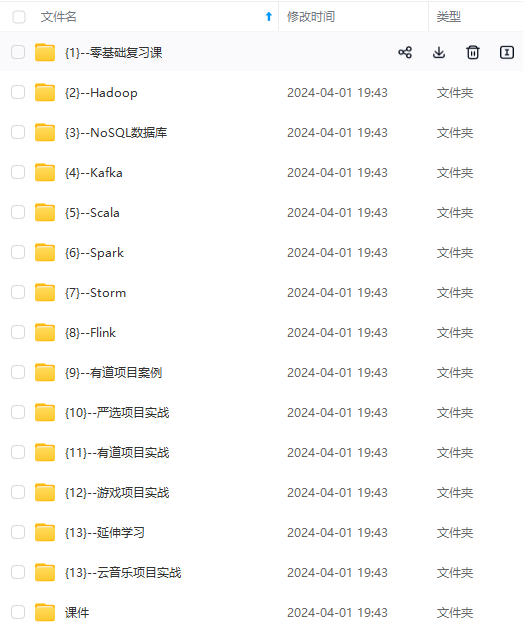

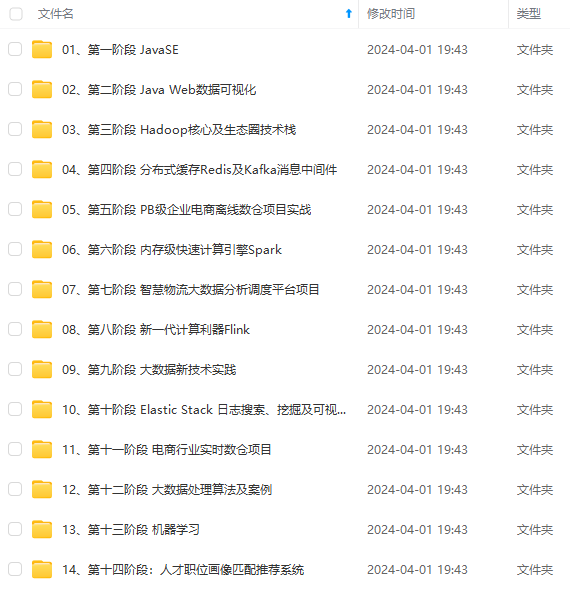

因此收集整理了一份《2024年大数据全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,基本涵盖了95%以上大数据开发知识点,真正体系化!

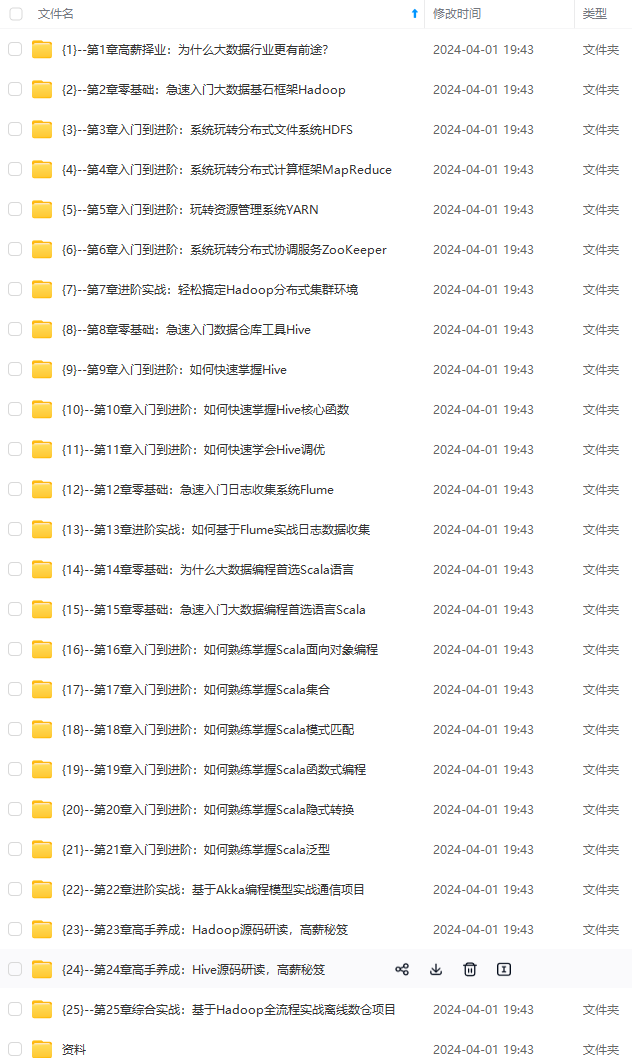

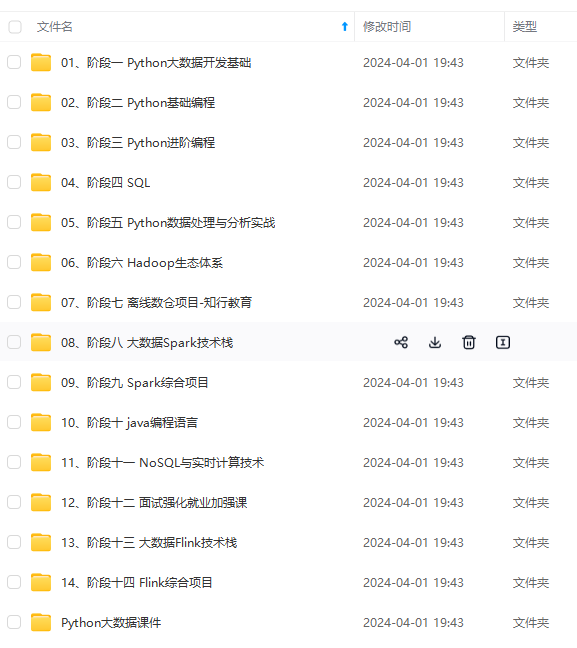

由于文件比较大,这里只是将部分目录大纲截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且后续会持续更新

如果你觉得这些内容对你有帮助,可以添加VX:vip204888 (备注大数据获取)

如果你觉得这些内容对你有帮助,可以添加VX:vip204888 (备注大数据获取)

[外链图片转存中…(img-nMNRyZt0-1712564582736)]

1002

1002

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?