既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上C C++开发知识点,真正体系化!

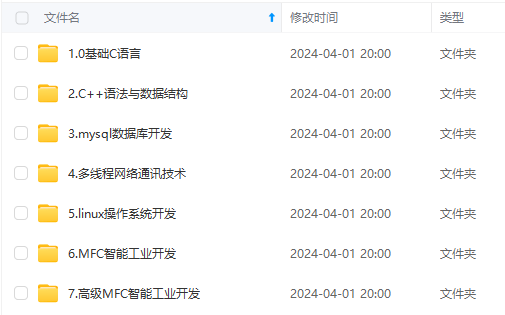

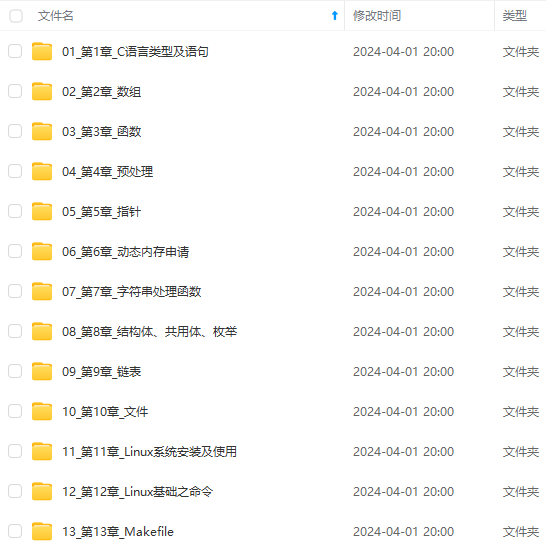

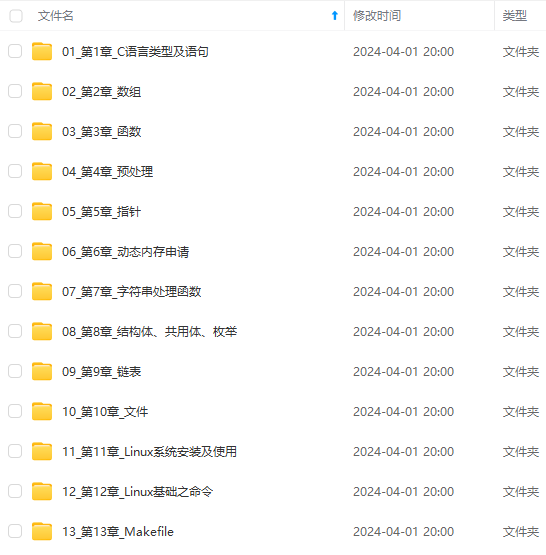

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

#include

#include

#include

#include<time.h>

using namespace std;

#define MAX 1000000

#define MIN -100000

double sigmoid(double z)

{

return 1.0/(1 + exp(-z));

}

/**

梯度上升算法,主要是确定负梯度方向,步长,采用迭代的思想迭代n至收敛,

当目标函数是凸规划问题,那么局部最小值就是全局最小值

在这里梯度下降和上升的区别,可以参考 http://blog.csdn.net/dongtingzhizi/article/details/15962797

**/

void gradAscent(Matrix dataMatIn, Matrix classLabels)

{

double alpha = 0.001;

int maxCycles = 500;

int m = dataMatIn.col;

int n = dataMatIn.row;

Matrix weights;

weights.initMatrix(&weights,n,1,1);

Matrix dataMuWeights;

dataMuWeights.initMatrix(&dataMuWeights, m, 1);

Matrix error;

error.initMatrix(&error, m, 1);

Matrix dataMatInT;

dataMatInT.initMatrix(&dataMatInT,n,m);

dataMatInT.transposematrix(dataMatIn, &dataMatInT);

Matrix dataMuError;

dataMuError.initMatrix(&dataMuError,n,1);

for (int i = 0; i < maxCycles; i++)

{

dataMuWeights.multsmatrix(&dataMuWeights, dataMatIn, weights);

for (int j = 0; j < m; j++)

{

dataMuWeights.mat[j][0] = sigmoid(dataMuWeights.mat[j][0]);

}

error.submatrix(&error, classLabels, dataMuWeights);

dataMuError.multsmatrix(&dataMuError, dataMatInT, error);

for (int j = 0; j < n; j++)

{

dataMuError.mat[j][0] = alpha * dataMuError.mat[j][0];

}

weights.addmatrix(&weights,weights, dataMuError);

}

weights.print(weights);

/**

验证算法的正确性

**/

Matrix test;

test.initMatrix(&test,dataMatIn.col, 1);

test.multsmatrix(&test, dataMatIn, weights);

for (int i = 0; i < m; i++)

{

if (test.mat[i][0] > 0)

{

cout<<1<<endl;

}

else

cout<<0<<endl;

}

}

void stocGradAscent(Matrix dataMatIn, Matrix classLabels)

{

}

/**

随机梯度下降与梯度下降法不同的是在负梯度方向的确定,梯度下降是根据所有的样本来确定负梯度方向,

而随机梯度下降每次只看一个样本点来确定负梯度方向,虽然不完全可信,但随着迭代次数增加,同样收敛

**/

//通过随机选取样本来更新回归系数,这种方法可以减少周期性的波动

//步长在不断的减少

void stocGradAscent1(Matrix dataMatIn, Matrix classLabels, int numIter = 150)

{

}

/**

逻辑回归,这里主要考虑其常用的两种求参数算法,一种是梯度下降,一种是随机梯度下降

*/

int main()

{

srand((unsigned)time(NULL));

dataToMatrix dtm;

cout<<“loadData”<<endl;

cout<<“----------------------”<<endl;

char file[20]=“logReg.txt”;

dtm.loadData(&dtm,file);

Matrix x;

x.loadMatrix(&x,dtm);

Matrix y;

y.initMatrix(&y,x.col,1);

y=y.getOneRow(x,x.row - 1);

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上C C++开发知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

764

764

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?