前言

DeepSeek部署完后,除了正常的聊天使用,实际上更想基于它做一些更符合预期的事情,比如基于某些事实或者数据,能给我推理出来相关的结果或者尽量限制在某一部分进行回答,这个比较突出的表现方式就是知识库,其中,最新最新出来的开源 RAGFlow 很不错,这就部署出来瞅一下。

RAGFlow

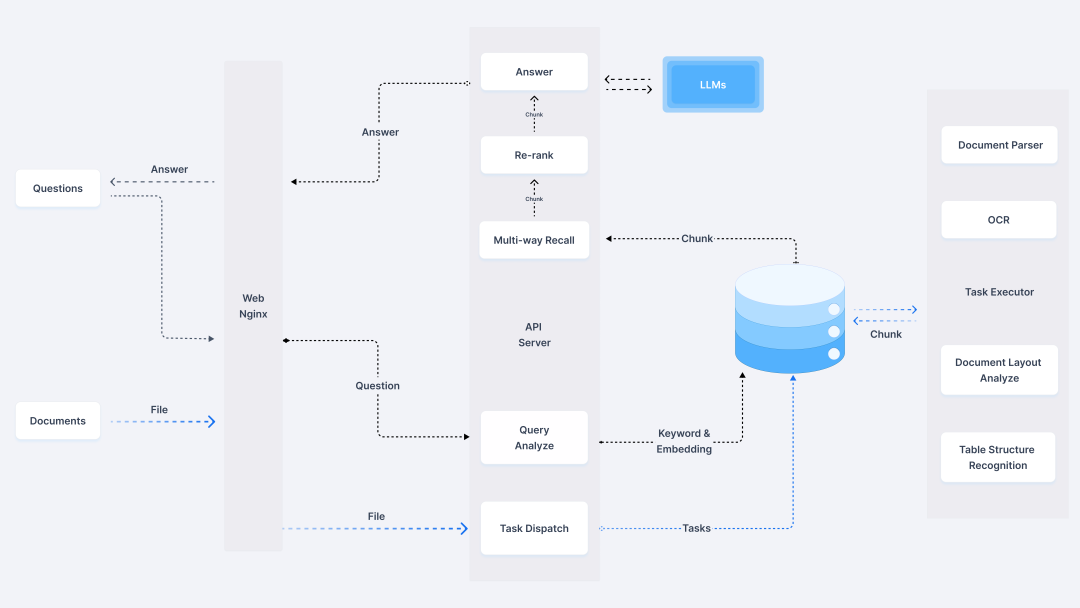

简单介绍下它,RAGFlow 是一款基于深度文档理解构建的开源 RAG (Retrieval-Augmented Generation )引擎。RAGFlow 可以为各种规模的企业及个人提供一套精简的 RAG 工作流程,结合大语言模型(LLM)针对用户各类不同的复杂格式数据提供可靠的问答以及有理有据的引用。

这个项目地址:

https://github.com/infiniflow/ragflow

开源可商用,感觉还不错,就来试着搭建一下。

也可以直接试用一下

https://demo.ragflow.io 试用 demo。

搭建 RPAFlow

这个图是它的架构

前提条件

-

1. CPU >= 4 核

-

2. RAM >= 16 GB

-

3. Disk >= 50 GB

-

4. Docker >= 24.0.0 & Docker Compose >= v2.26.1

这个部署主要是Docker 部署,还有 Docker Compose.

执行DockerCompose命令下载Docker镜像

修改相关配置,主要是解决端口冲突和文件大小的限制

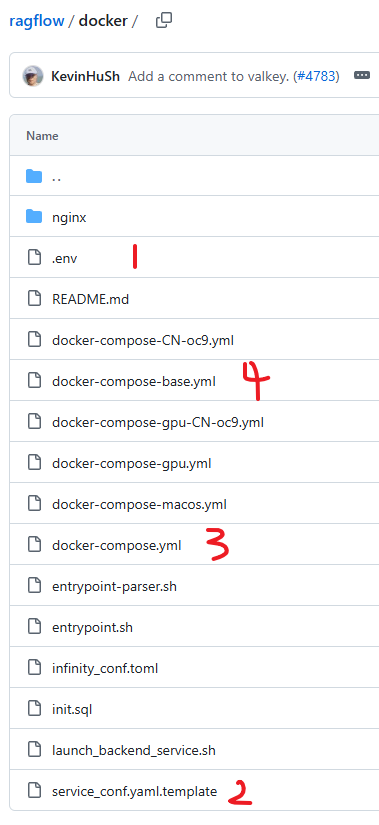

主要看这几个docker 相关的文件

-

1. .env是基础环境文件,改了里面的端口要跟2 service_conf.yaml 里面的保持一致。

-

2. 3 和 4 都是配置,主要是怕端口冲突,其中3 里面是核心服务80端口。

.env修改

默认是 ragflow:v0.16.0-slim 这个是缩减版

RAGFLOW_IMAGE=infiniflow/ragflow:v0.16.0-slim

这个是全量版,比较大,十几G

RAGFLOW_IMAGE=infiniflow/ragflow:v0.16.0

我这边默认是 最大的,里面包含了很多内置模型和ocr识别之类的。

docker/nginx/nginx.conf

client_max_body_size 500M; //128M还是小

docker/docker-compose.yml 文件

services:

ragflow:

depends_on:

mysql:

condition: service_healthy

image: infiniflow/ragflow:v0.16.0

container_name: ragflow-server

ports:

- ${SVR_HTTP_PORT}:9380

- 180:80

- 443:443

volumes:

- ./ragflow-logs:/ragflow/logs

- ./nginx/ragflow.conf:/etc/nginx/conf.d/ragflow.conf

- ./nginx/proxy.conf:/etc/nginx/proxy.conf

- ./nginx/nginx.conf:/etc/nginx/nginx.conf

env_file: .env

environment:

- TZ=${TIMEZONE}

- HF_ENDPOINT=${HF_ENDPOINT}

- MACOS=${MACOS}

- MAX_FILE_NUM_PER_USER=10485760

- MAX_CONTENT_LENGTH=524288000

主要修改了 180:80 防止外部端口污染。

MAX_FILE_NUM_PER_USER 以及 MAX_CONTENT_LENGTH环境变量,主要用来解决 上传文档大小的问题。

增加hosts配置

修改 /etc/hosts 新增以下配置

127.0.0.1 es01 infinity mysql minio redis

启动命令

在 docker/ docker-compose.yml 目录执行以下命令

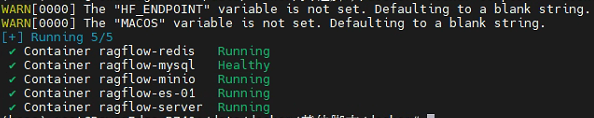

docker-compose -f docker-compose.yml up -d

这样就启动成功了

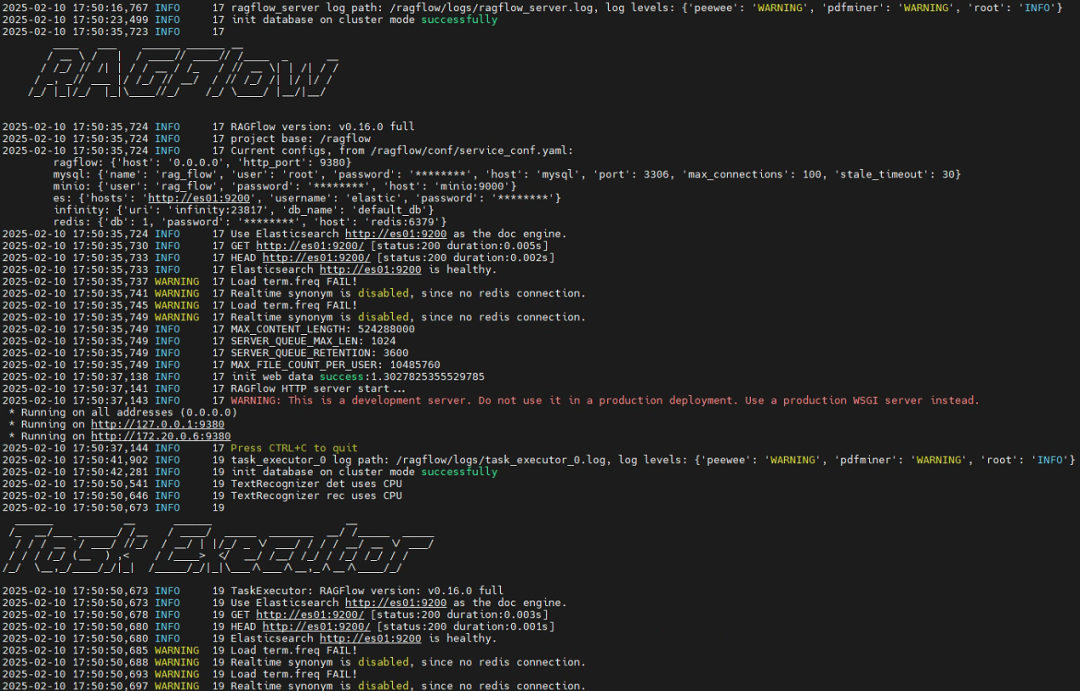

查看 ragflow-server 查看下具体的日志状态

docker logs -f ragflow-server

能看到 success 和 9380端口说明就成功了

然后,打开相关地址,换成本地IP即可(127.0.0.1:80)

80或者180 看《docker/docker-compose.yml 文件相关配置》

http://192.168.0.120:180

打开后,直接注册个账号(Sign Up)即可

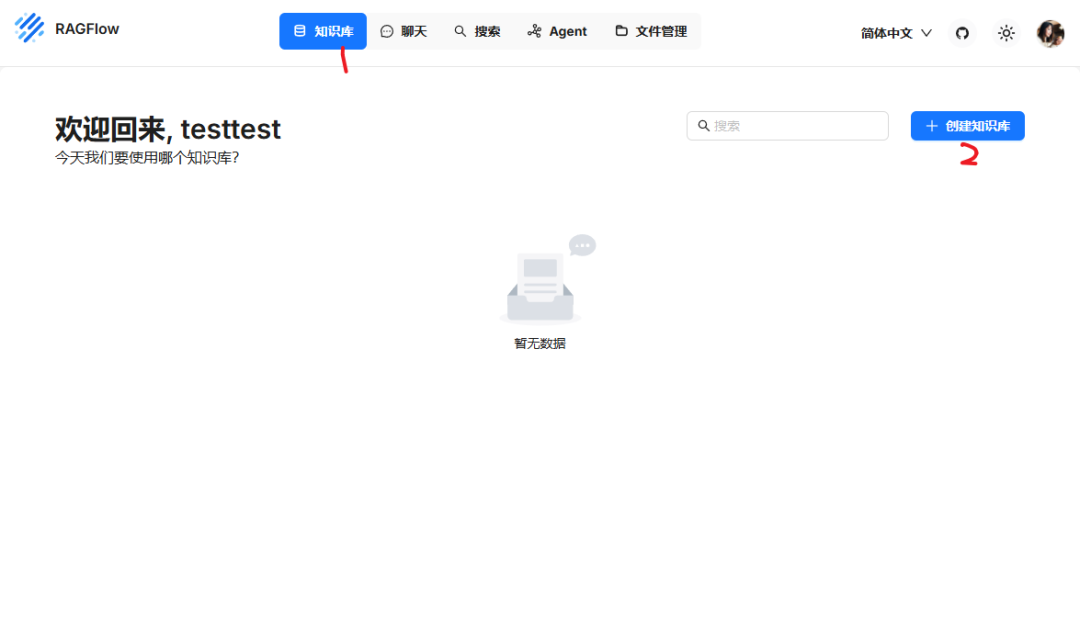

登录后,就看到了知识库的主页

知识库相关操作

先增加模型,然后,上传文件

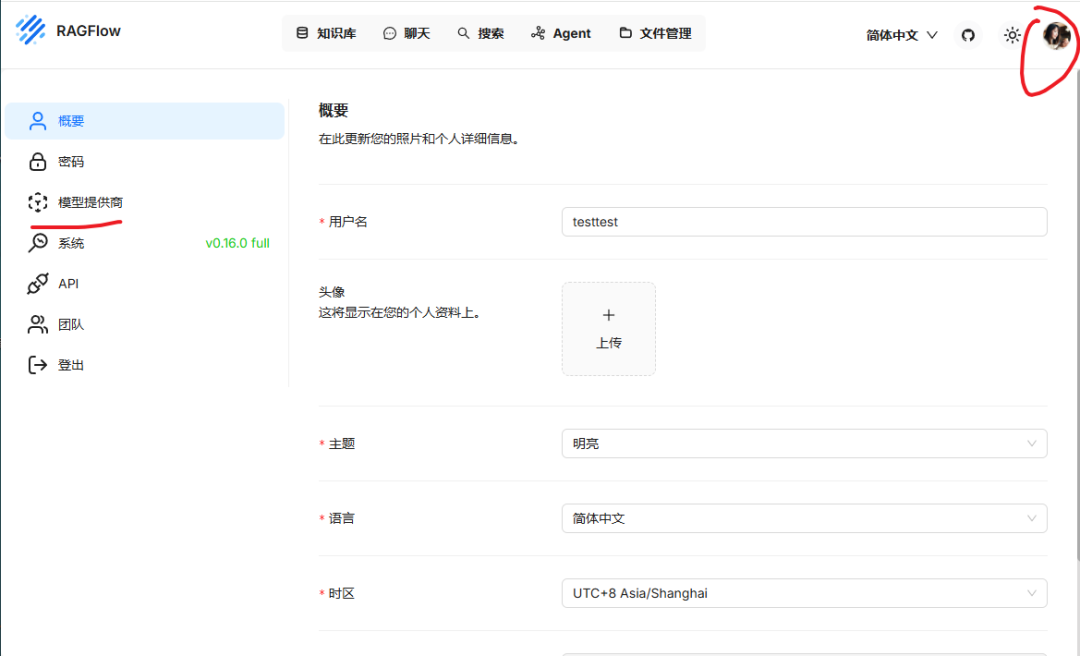

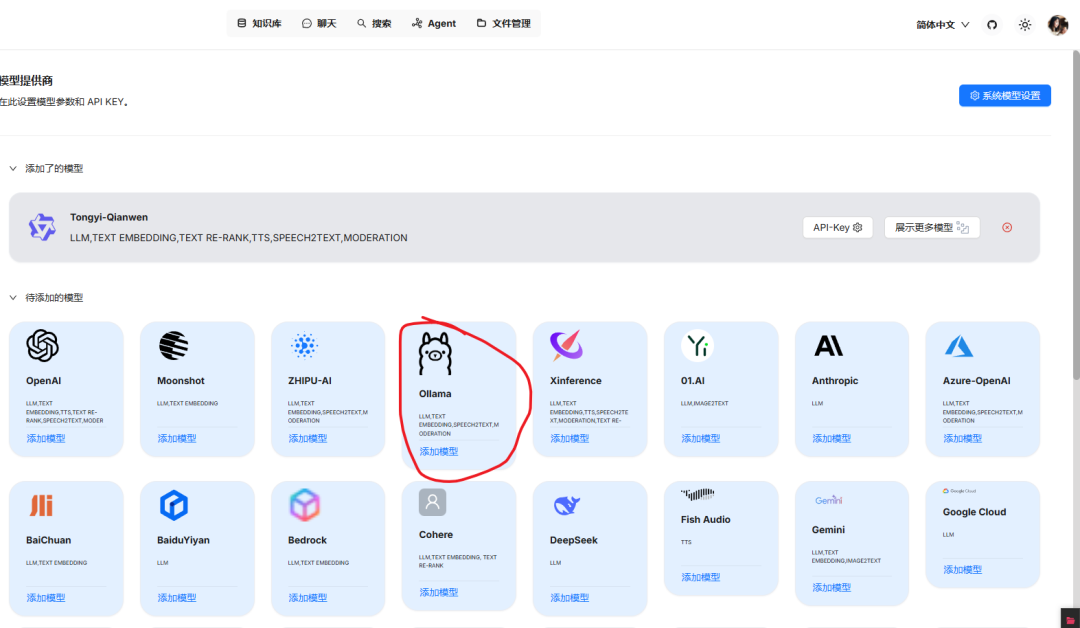

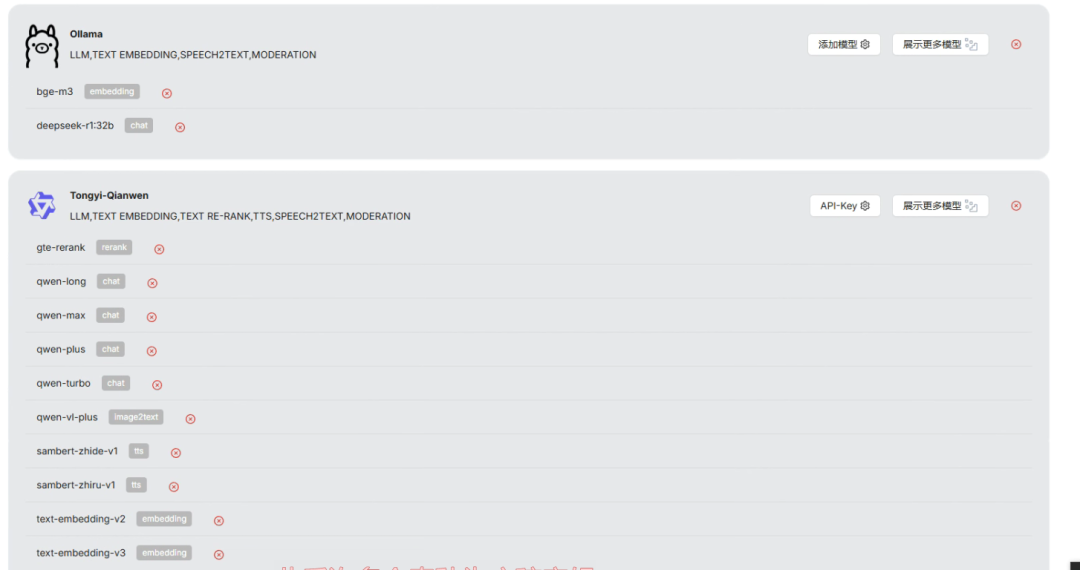

点击头像,然后,选择模型供应商

我们直接选择Ollama 即可

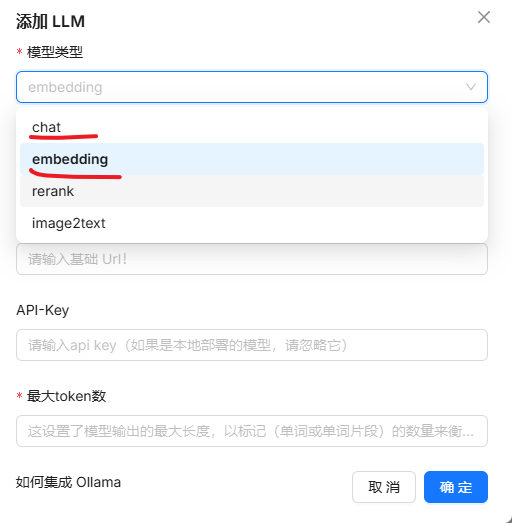

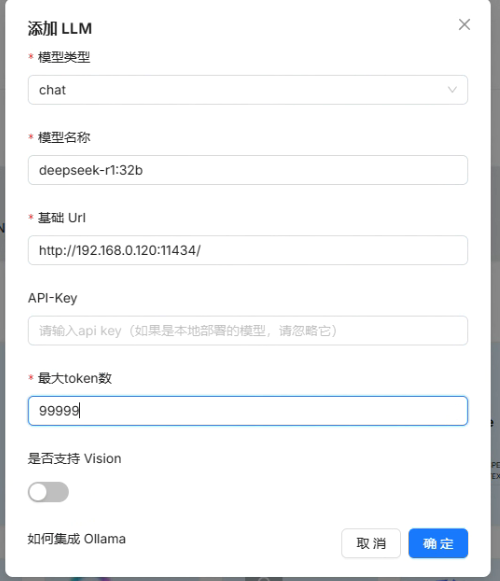

主要是两个模型,一个是chat模型,也就是我们的DeepSeek模型,另外embedding模型就是对文本内容取向量的模型,这个模型可以用它自己的也可以自己部署,我这边用自己部署的Ollma模型。

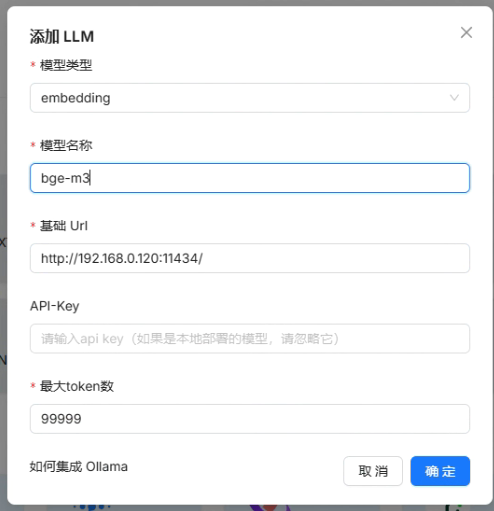

embedding 模型

ollama run bge-m3

我这边的ollama地址是

http://192.168.0.120:11434/

所以,如下图所示

上面是chat模型配置必须

这个是embedding 模型配置(bge-m3),不必须(可以用它内置的千问模型)

这个是配置完后的全部内容

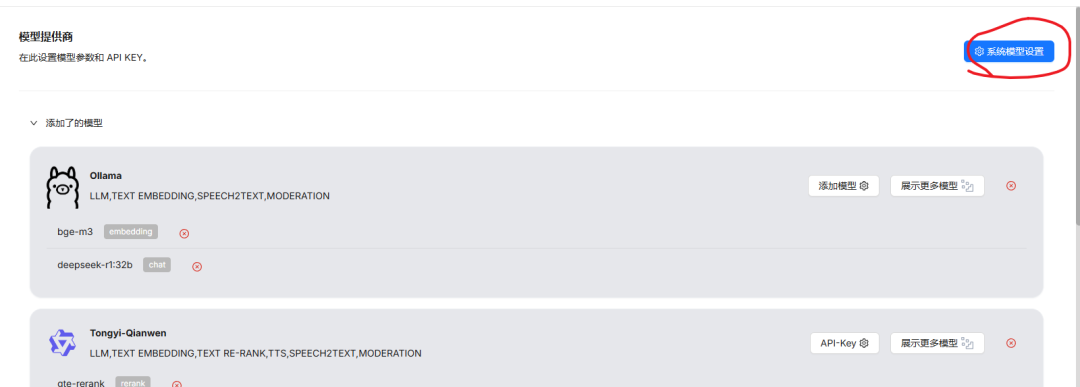

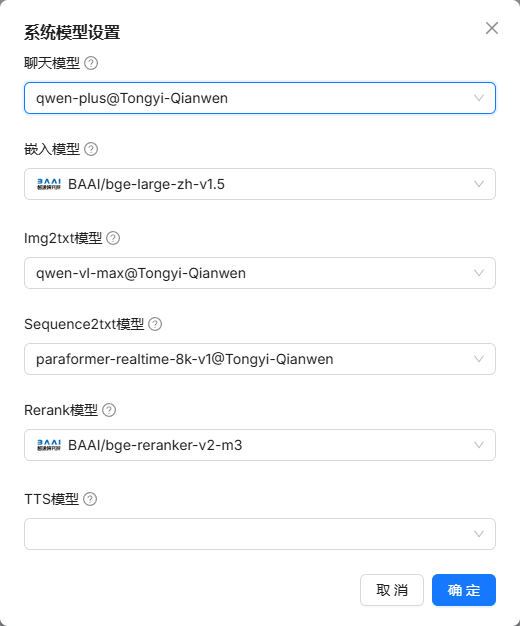

系统模型设置

点击 系统模型设置

如下图所示,默认的实际上也是可以用的,我这里改成强大的deepseek

看看下面,我就改这么多,不改其他的。

确定后,就可以看知识库的效果了

创建知识库

点击创建知识库

文档语言,权限,模型选择好即可。

点击新增文件

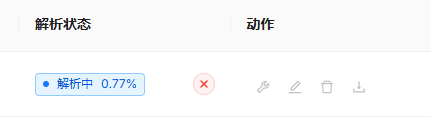

上传完之后,要点击解析,它才能分片到向量数据库里,这里目前按照它的架构是ES里。

它就会慢慢的解析。

成功后,就可以进行知识库问答了。

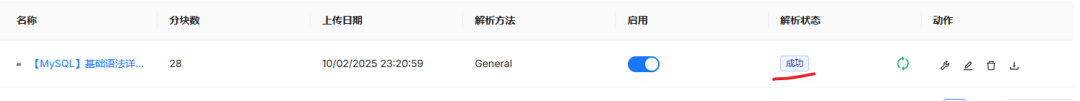

知识库问答

新建一个助理

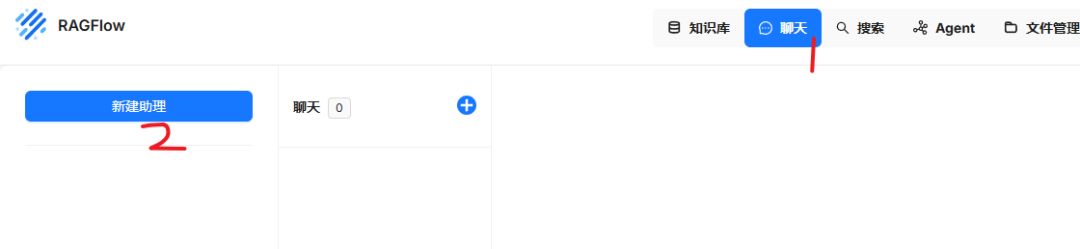

这里面配置很多,主要你所需要用到的知识库

这个界面是各种细节配置

这个就是模型的细节,可以参考模型的建议来,也可以自己微调。

试了一下,还是能用的。

完结,撒花!!!

包下载不下来的解决方案

我这边会提供百度云链接地址《相关文档》,可以直接使用。也可以自己敲命令一个一个下载,然后load到具体的服务器上。

docker pull docker.elastic.co/elasticsearch/elasticsearch:8.11.3

docker pull mysql:8.0.39

docker pull quay.io/minio/minio:RELEASE.2023-12-20T01-00-02Z

docker pull valkey/valkey:8

docker pull infiniflow/ragflow:v0.16.0

docker save -o elasticsearch.tar docker.elastic.co/elasticsearch/elasticsearch:8.11.3

docker save -o mysql.tar mysql:8.0.39

docker save -o minio.tar quay.io/minio/minio:RELEASE.2023-12-20T01-00-02Z

docker save -o valkey.tar valkey/valkey:8

docker save -o ragflow.tar infiniflow/ragflow:v0.16.0

docker load < elasticsearch.tar

docker load < mysql.tar

docker load < minio.tar

docker load < valkey.tar

docker load < ragflow.tar

总结

这个下载镜像基本都需要科学工具,设置不好,也不容易起作用,我这边就提供个下载地址。

相关文档

以官方文档为准

https://github.com/infiniflow/ragflow/blob/main/README_zh.md

百度云链接镜像文件和docker修改后的配置(仅供参考)

ragflow链接: https://pan.baidu.com/s/13YuKi31fbRAclzdpFCcQ3w?pwd=9kah

最后的最后

感谢你们的阅读和喜欢,作为一位在一线互联网行业奋斗多年的老兵,我深知在这个瞬息万变的技术领域中,持续学习和进步的重要性。

为了帮助更多热爱技术、渴望成长的朋友,我特别整理了一份涵盖大模型领域的宝贵资料集。

这些资料不仅是我多年积累的心血结晶,也是我在行业一线实战经验的总结。

这些学习资料不仅深入浅出,而且非常实用,让大家系统而高效地掌握AI大模型的各个知识点。如果你愿意花时间沉下心来学习,相信它们一定能为你提供实质性的帮助。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

DeepSeek全套安装部署资料

大模型知识脑图

为了成为更好的 AI大模型 开发者,这里为大家提供了总的路线图。它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

经典书籍阅读

阅读AI大模型经典书籍可以帮助读者提高技术水平,开拓视野,掌握核心技术,提高解决问题的能力,同时也可以借鉴他人的经验。对于想要深入学习AI大模型开发的读者来说,阅读经典书籍是非常有必要的。

实战案例

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

面试资料

我们学习AI大模型必然是想找到高薪的工作,下面这些面试题都是总结当前最新、最热、最高频的面试题,并且每道题都有详细的答案,面试前刷完这套面试题资料,小小offer,不在话下

640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

1926

1926

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?