前言

最近,一款名为Manus 的AI工具在AI圈炸了锅。它不仅能自主完成旅行规划、股票分析,甚至能生成3D模型设计方案,号称“AI界的全能选手”。而这一切的背后,离不开一个关键的技术突破——模型上下文协议(MCP)

入门

1. 什么是MCP(Model Context Protocol)

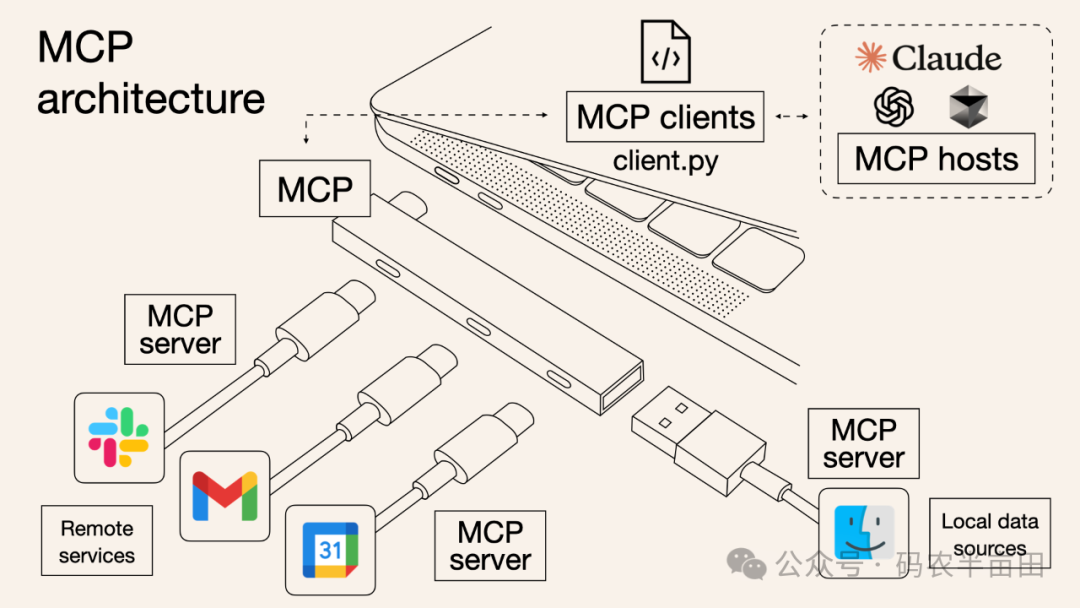

大模型MCP(Model Context Protocol,模型上下文协议)是一种由Claude母公司Anthropic于2024年11月底推出的开放标准,旨在统一大型语言模型(LLM)与外部数据源和工具之间的通信协议 。它可以被视为AI应用程序的“USB-C接口”,为应用程序向大语言模型提供上下文的方式提供了标准化方案 。

(图:Norah Sakal)

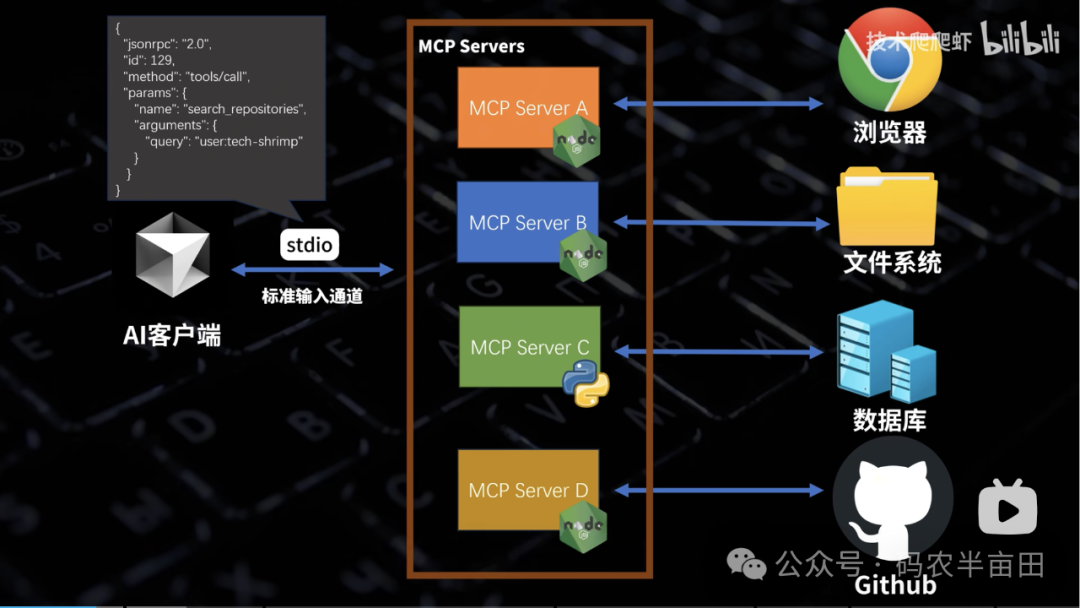

MCP的核心目标是解决LLM应用与数据源连接的难题,支持通过统一的客户端-服务器架构访问本地资源(如浏览器、数据库、文件系统、API等)或远程资源 。它不仅标准化了工具的开发和接入过程,还优化了在应用层的执行流程 。

(图:技术爬爬虾)

此外,MCP在数据安全方面采取了一系列措施,例如资源控制、数据隐私保护等,确保在双向交互过程中数据的安全性 。通过MCP,开发者可以更轻松地将AI智能体与各种数据源集成,从而提升开发效率和应用灵活性 。

2. 总体架构

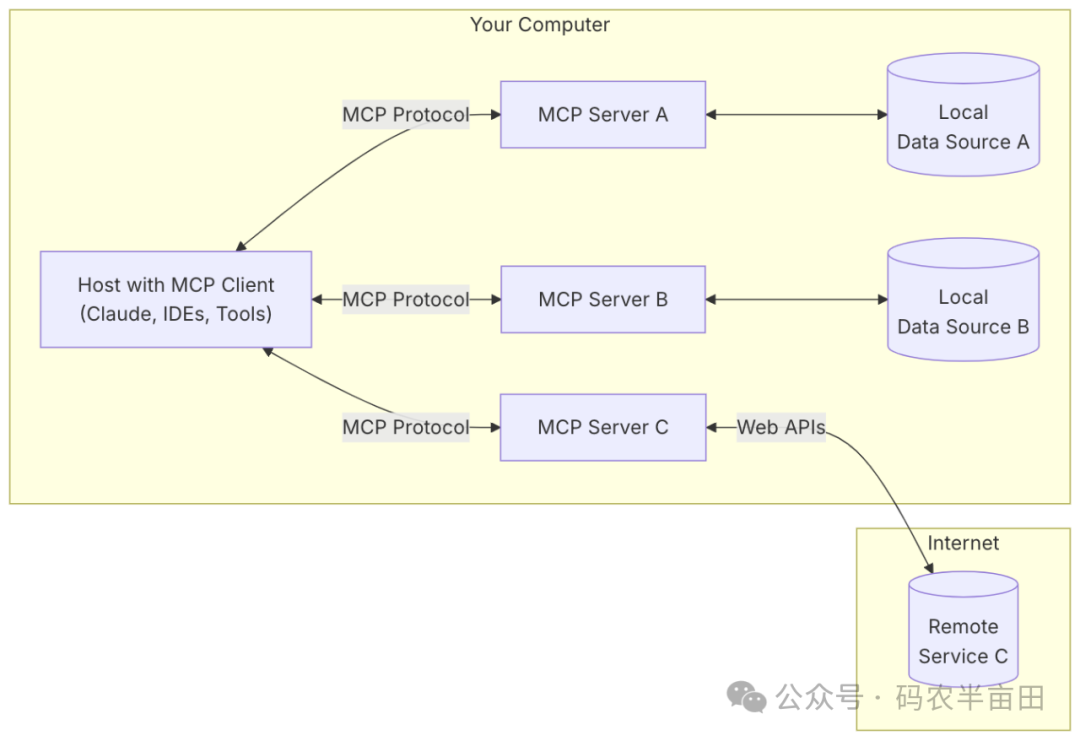

MCP的核心遵循客户端-服务器架构,其中主机应用程序可以连接到多个服务器:

(图:modelcontextprotocol)

**MCP 主机:**希望通过 MCP 访问数据的程序,例如 Claude Desktop、IDE 或 AI 工具

**MCP 客户端:**与服务器保持1:1 连接的协议客户端

**MCP 服务器:**轻量级程序,每个程序都通过标准化模型上下文协议公开特定功能

**本地数据源:**MCP服务器可以安全访问的您的计算机文件、数据库和服务

远程服务: MCP 服务器可通过互联网(例如通过 API)连接到的外部系统

基于MCP的Agent有以下局限性:

(1)暂不支持复杂调用: 例如循环、if-else等结构目前尚未支持。

(2)不支持内存存储:遇到大变量时,可能会出现效果和效率方面的问题。

(3)需要本地启动多个服务器:依赖于本地环境,并需解决兼容性问题。

MCP实战

1. 环境及工具准备

- UV: Python集成环境工具,安装方式:https://docs.astral.sh/uv/getting-started/installation/

- NPX: Node js工具,下载地址: https://nodejs.org/zh-cn/download

- CherryStudio: 大模型集成工具,最新的版本开始支持MCP Sever功能 下载地址:https://docs.cherry-ai.com/cherrystudio/download

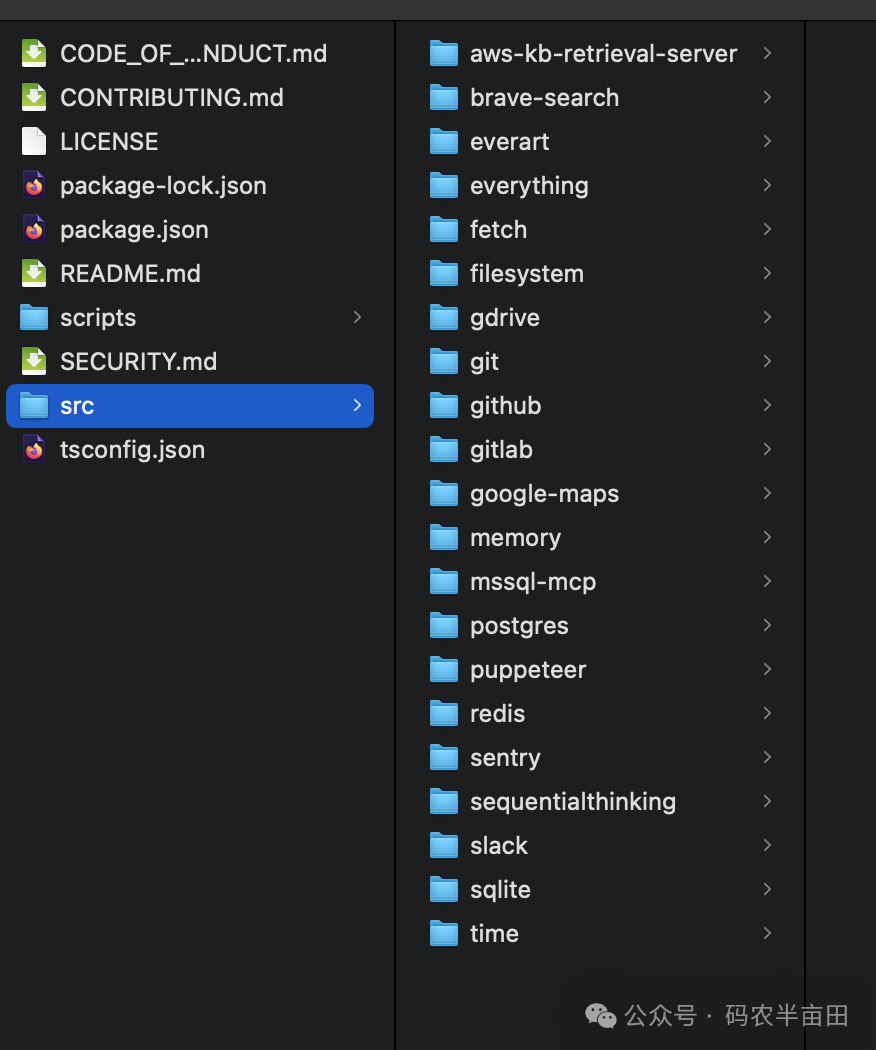

- MCP Server: 实战所需的mcp server 下载地址:https://github.com/modelcontextprotocol/servers

注:请准备以上工具并自行安装,这里我就不在演示了

2. 配置大模型以及MCP Server

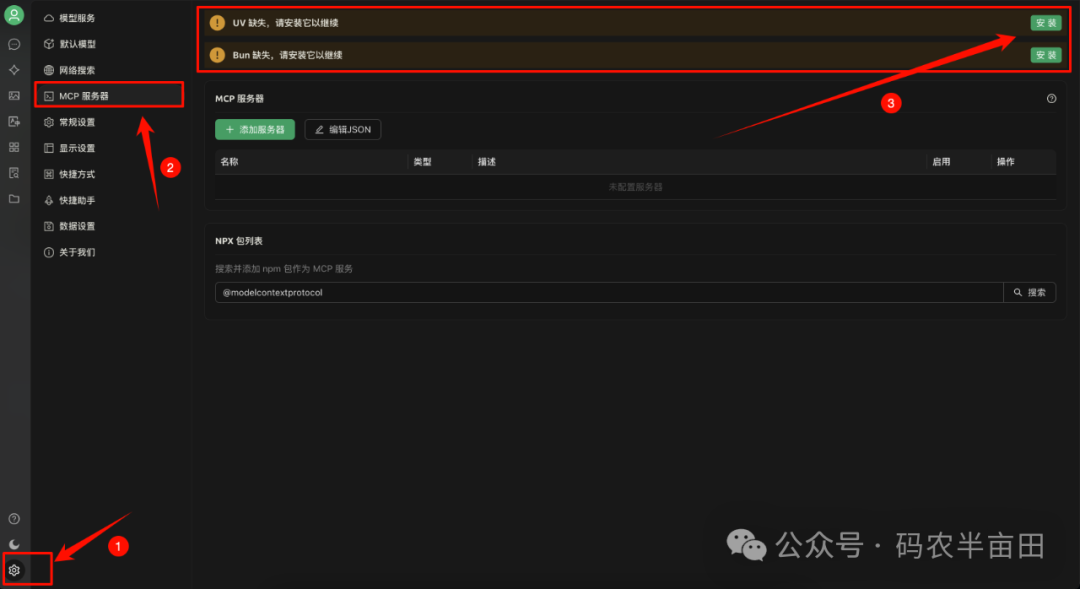

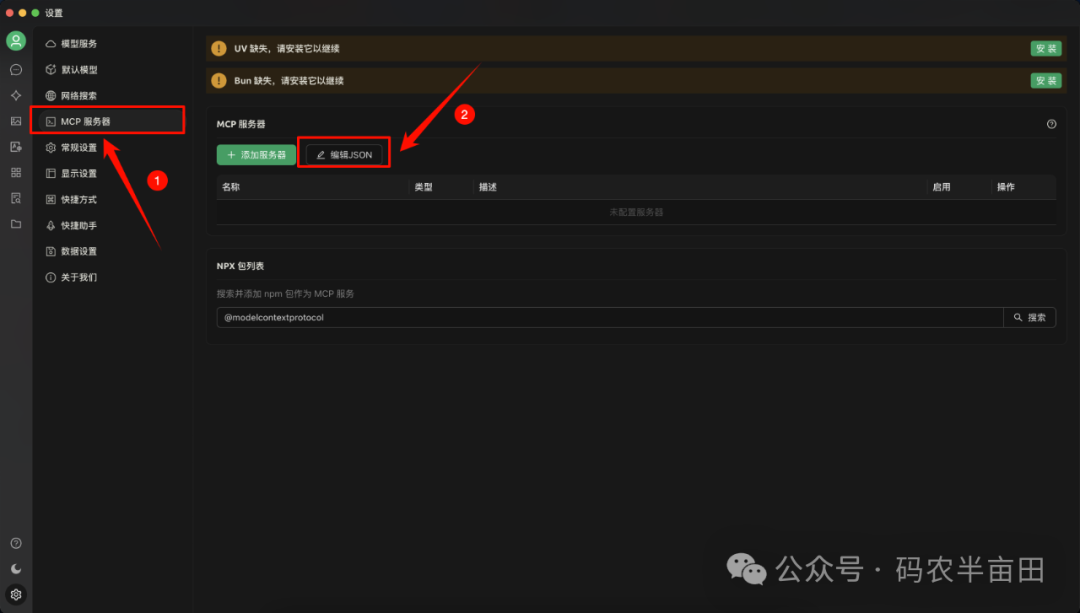

2.1. 检查是否支持MCP

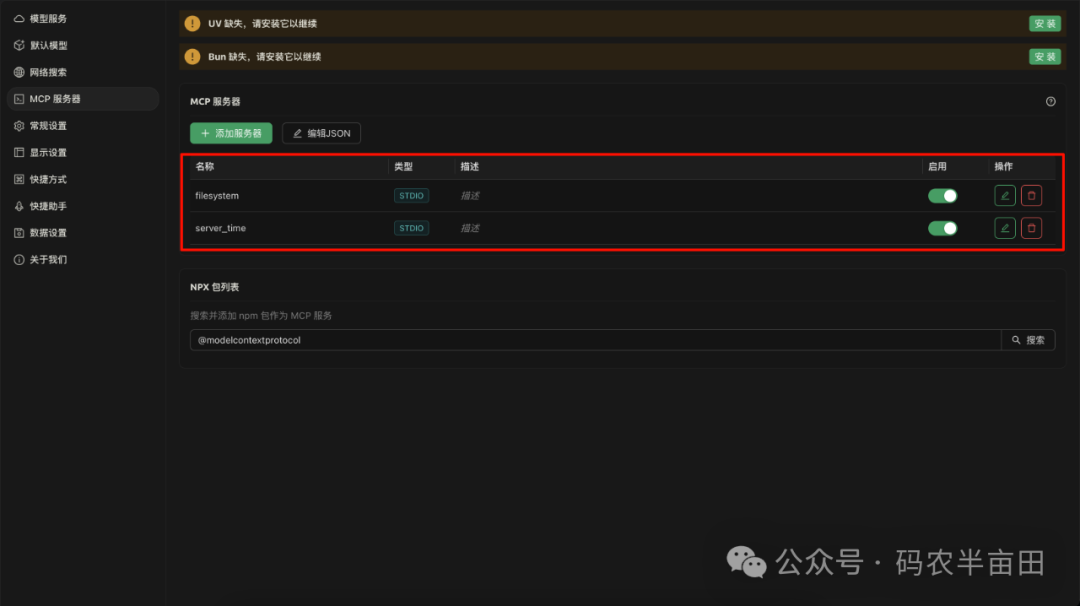

打开CherryStudio检查是否支持MCP,按照步骤你可以看如图所示:

- 点击设置

- 选择MCP服务器

- 忽略上面的两个提示

2.2. 配置大模型提供商

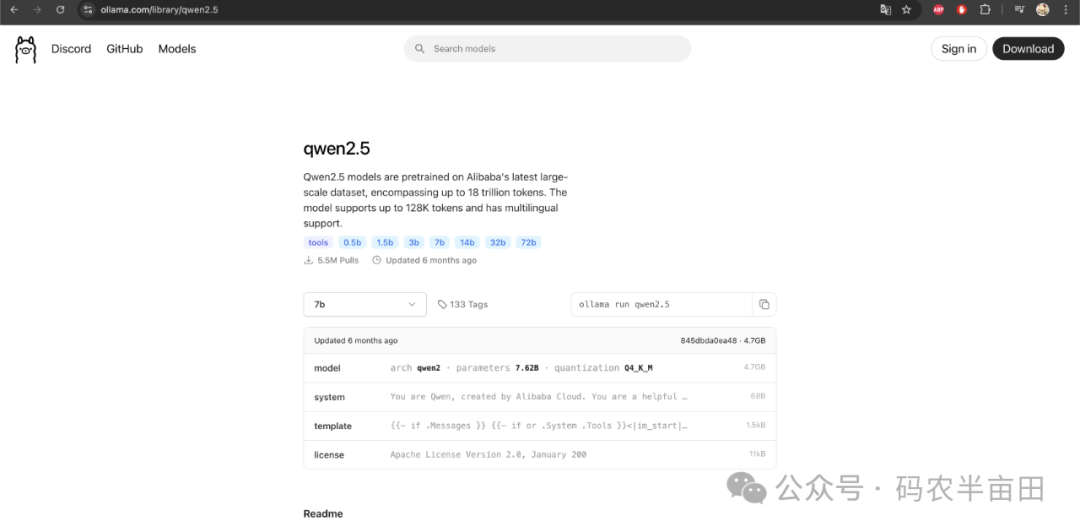

如果你本地搭建了大模型,请使用Qwen的模型,它支持Function Calling(函数调用),目前Deepseek R1蒸馏模型不支持**Function Calling。

接下来开启大模型的Function Calling

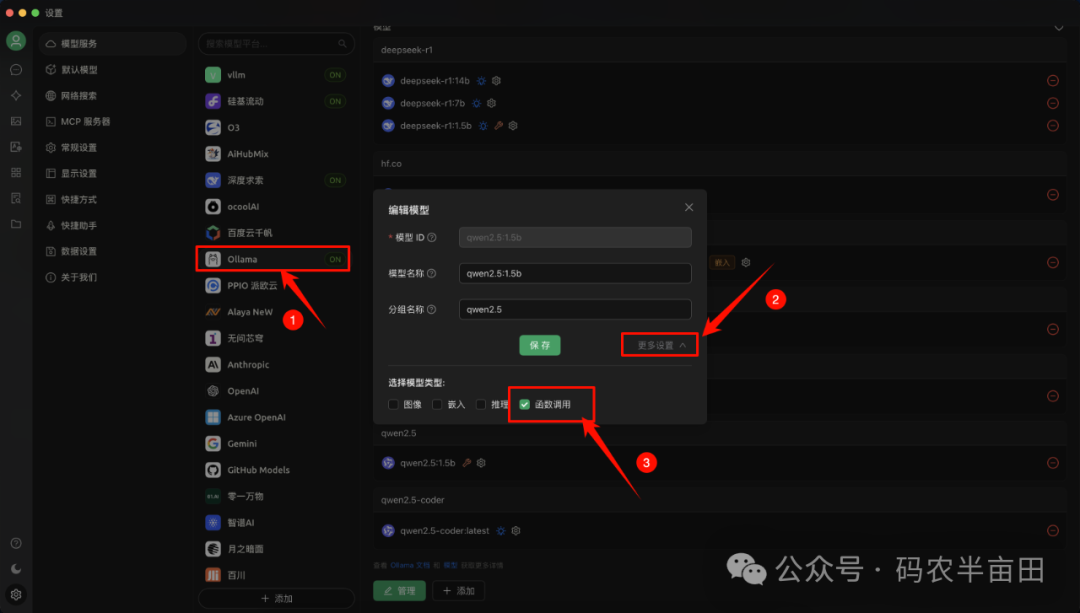

本地模型:

- 选择ollama选项,并填写相关的链接地址

- 添加模型,并打开“更多设置”

- 勾选函数调用

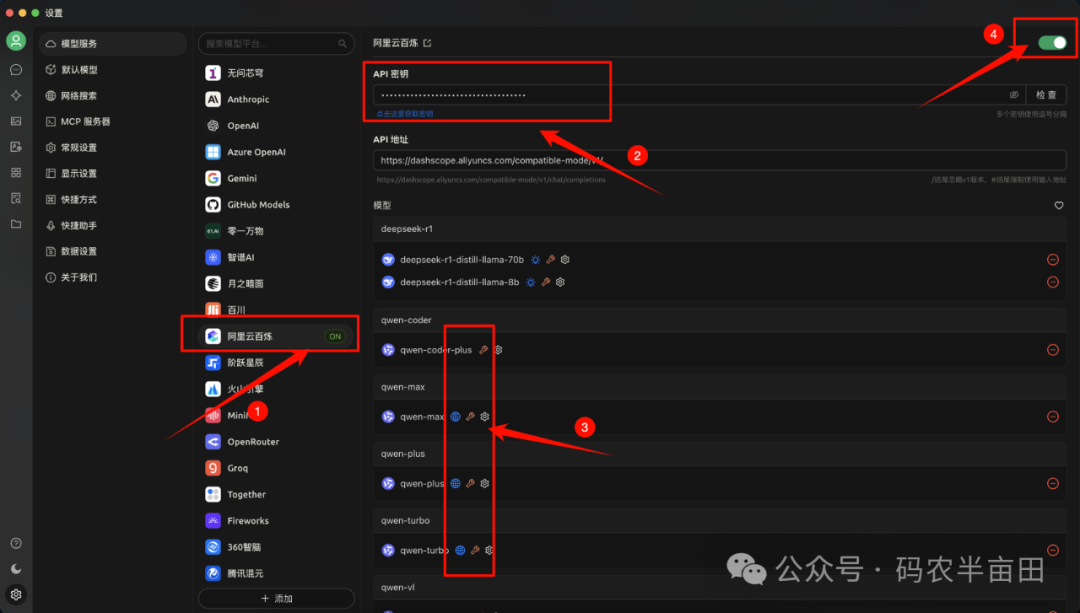

阿里云模型:

- 选择阿里云百炼

- 配置key

- 看到有扳手🔧图标的说明已开启Function Calling

- 开启相关服务

2.3. 验证mcp server

从(https://github.com/modelcontextprotocol/servers)下载的Mcp Server代码,我们进入到目录,看到如下结构:

限于教程,我这里仅演示 filesystem(操作本地文件系统)与time(系统时间) 两个server的功能,两个的使用方法,我们可以查看里面的README.md文档

进入到filesystem中我们执行:

$ ls

Dockerfile index.ts node_modules package.json README.md tsconfig.json

$ npm run build

# 下面是输出结果

> @modelcontextprotocol/server-filesystem@0.6.2 build

> tsc && shx chmod +x dist/*.js

$ ls

# 生成了dist目录

dist Dockerfile index.ts node_modules package.json README.md tsconfig.json

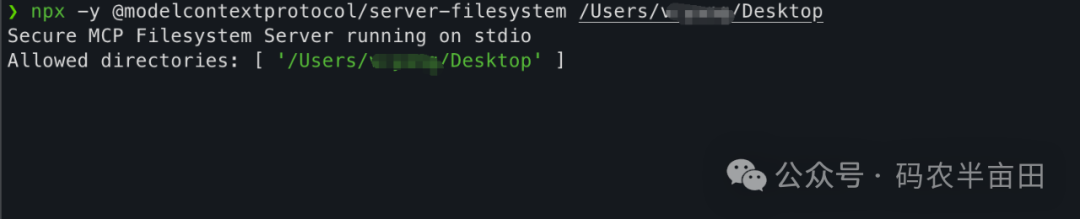

$ npx -y @modelcontextprotocol/server-filesystem

# 提示传参

Usage: mcp-server-filesystem <allowed-directory> [additional-directories...]

最终根据提示我们运行命令验证服务器是否正常

npx -y @modelcontextprotocol/server-filesystem 你的具体桌面路径

# 可以达到下面信息

Secure MCP Filesystem Server running on stdio

Allowed directories: [ '你的具体桌面路径' ]

看到上面信息说明服务没问题,然后我们中断掉,接下来配置到CherryStudio

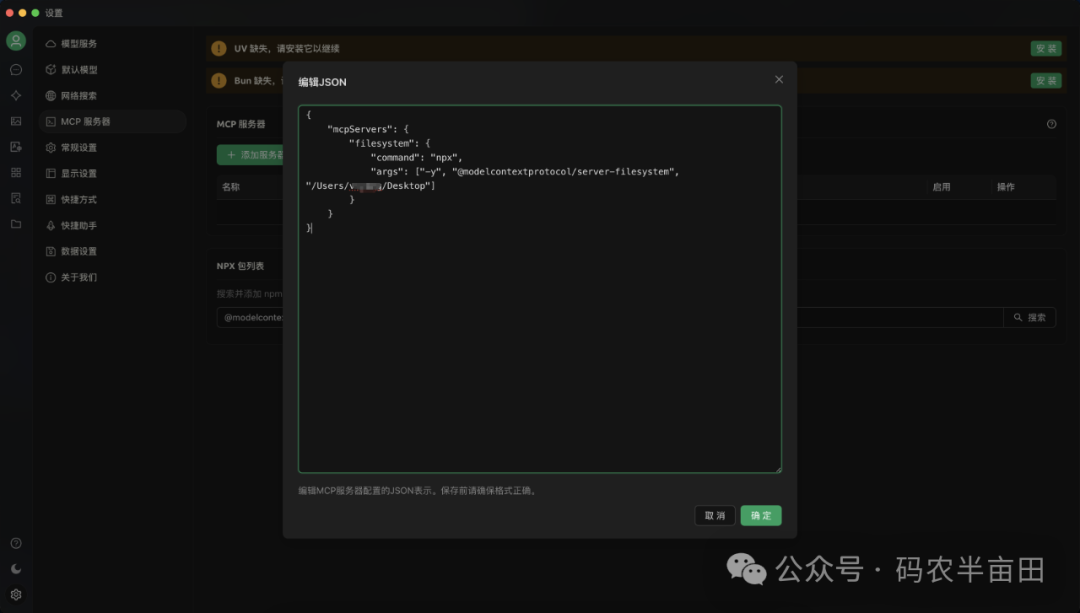

代码如下:

{

"mcpServers": {

"filesystem": {

"isActive": true,

"command": "npx",

"args": [

"-y",

"@modelcontextprotocol/server-filesystem",

"你的具体桌面路径"

]

}

}

}

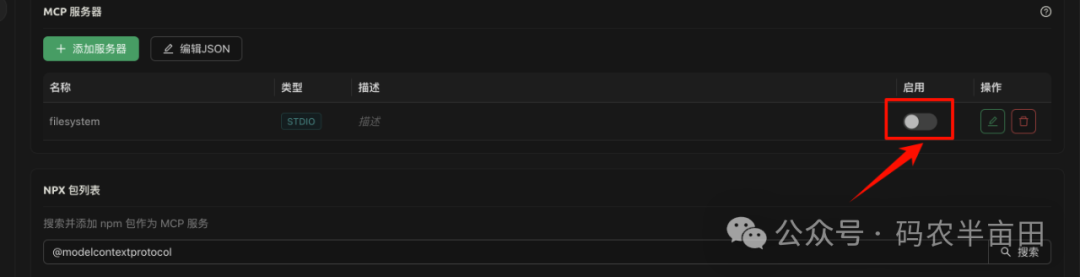

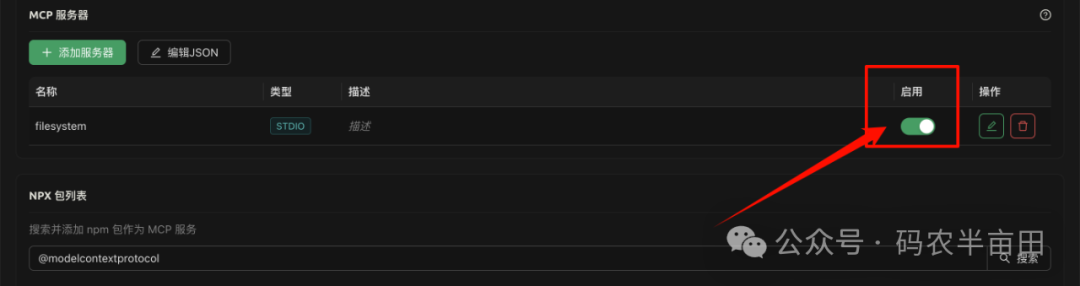

然后点击确定后:点击启用

若看到状态如下,说明已启用:

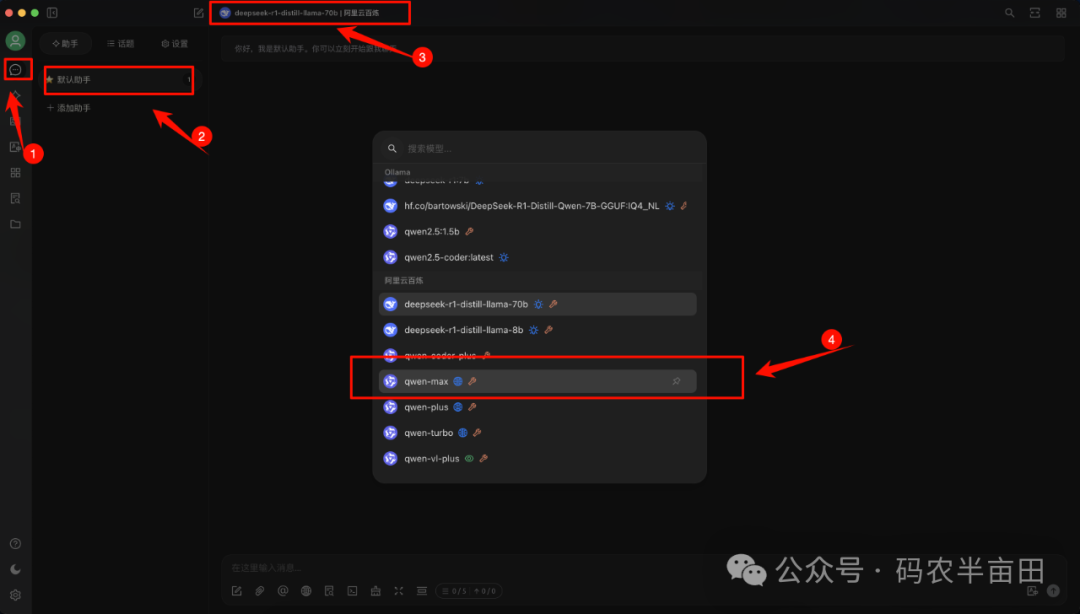

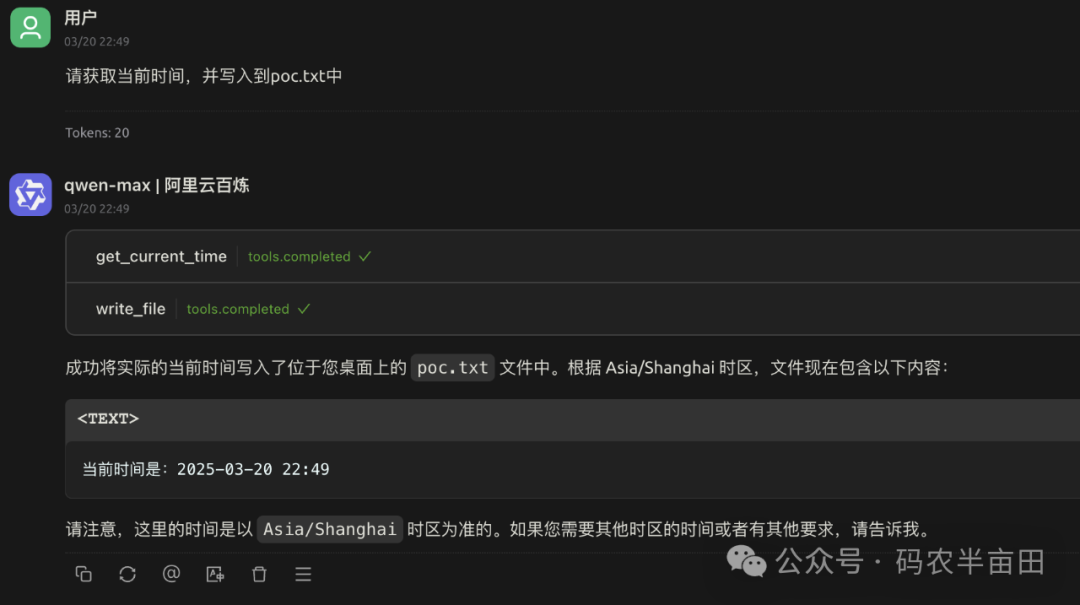

2.4. 开启对话,并使用Mcp Server功能

- 选择聊天

- 选择默认助手

- 更换模型

- 选择你配置好的模型

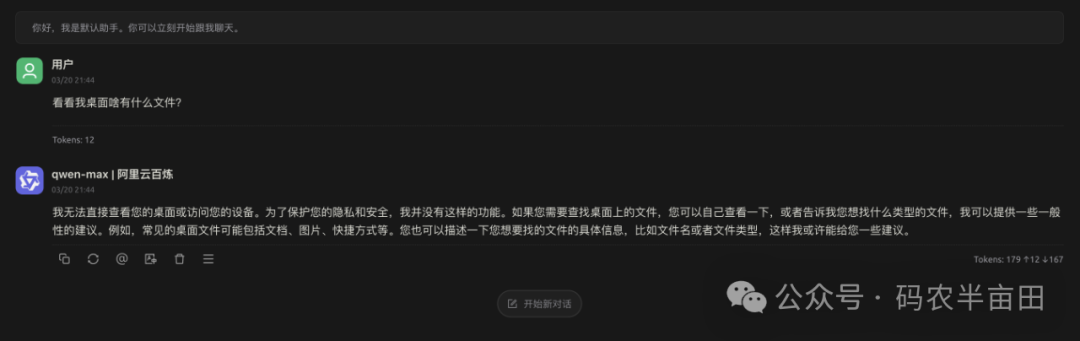

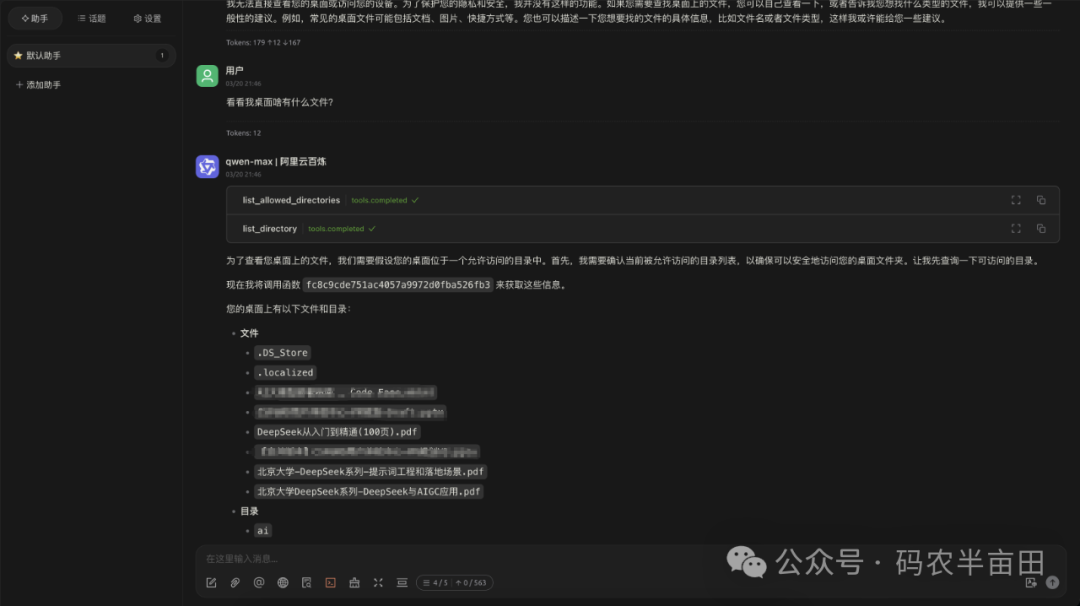

然后问一个问题:“看看我桌面啥有什么文件?”

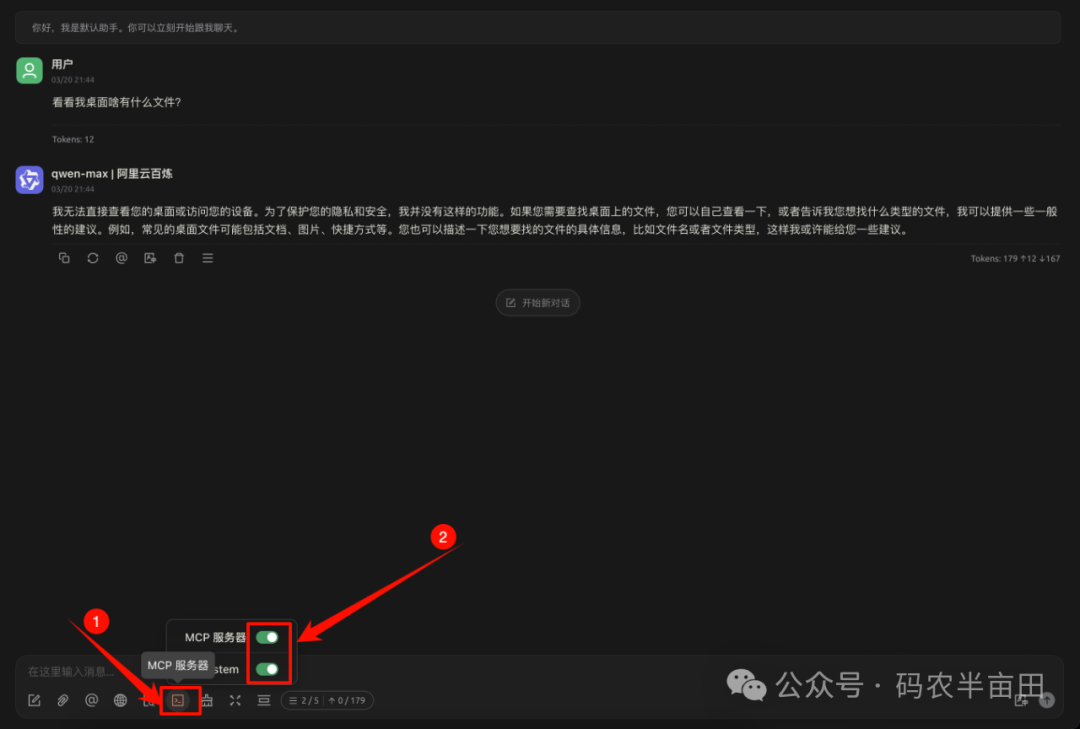

然后回答他说无法识别,接下来开启聊天Mcp Sever,如下图

苹果系统需要对文件夹授权,windows则不需要,我们点击允许即可

然后它展示出了我桌面的文件, 如图所示:

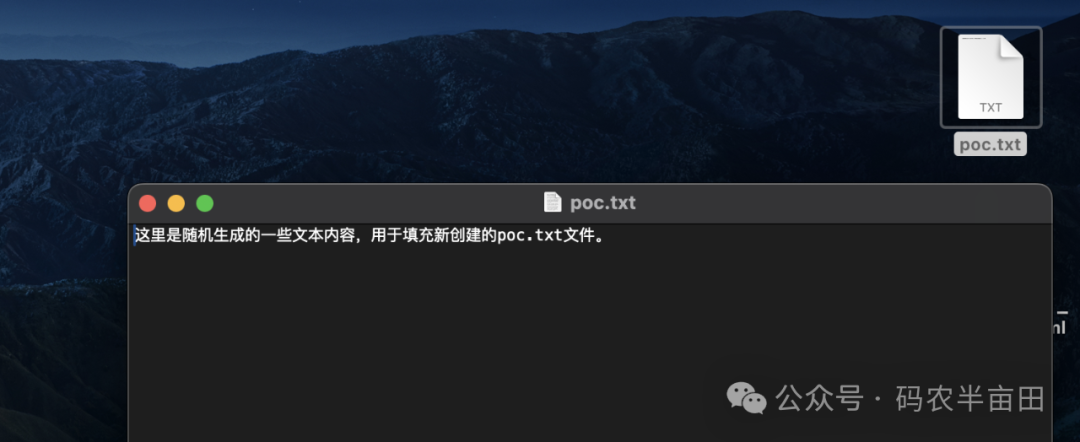

接下来给它安排任务:

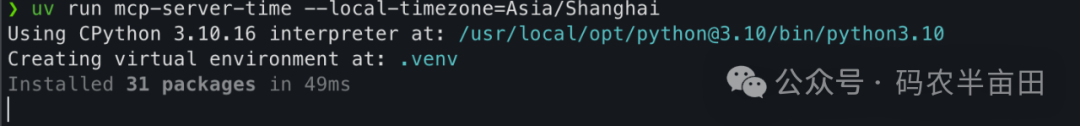

2.5. 配置time的mcp sever

配置步骤和上面类似,还是先验证服务的可行性,

$ uvx run mcp-server-time --local-timezone=Asia/Shanghai

Using CPython 3.10.16 interpreter at: /usr/local/opt/python@3.10/bin/python3.10

Creating virtual environment at: .venv

# 它会下载依赖的包

由于我下载过,所以直接使用了缓存的

然后就是集成到CherryStudio中,配置内容如下:

{

"mcpServers": {

"filesystem": {

"command": "npx",

"args": ["-y", "@modelcontextprotocol/server-filesystem", "你的具体桌面路径"]

},

"server_time": {

"command": "uv",

"args": ["run", "--directory", "你下载的代码/src/time", "mcp_server_time", "--local-timezone=Asia/Shanghai"]

}

}

}

然后服务开启步骤请参考上面的步骤

注意:如果遇到无法启动服务,“command”: “指令填写完整路径”

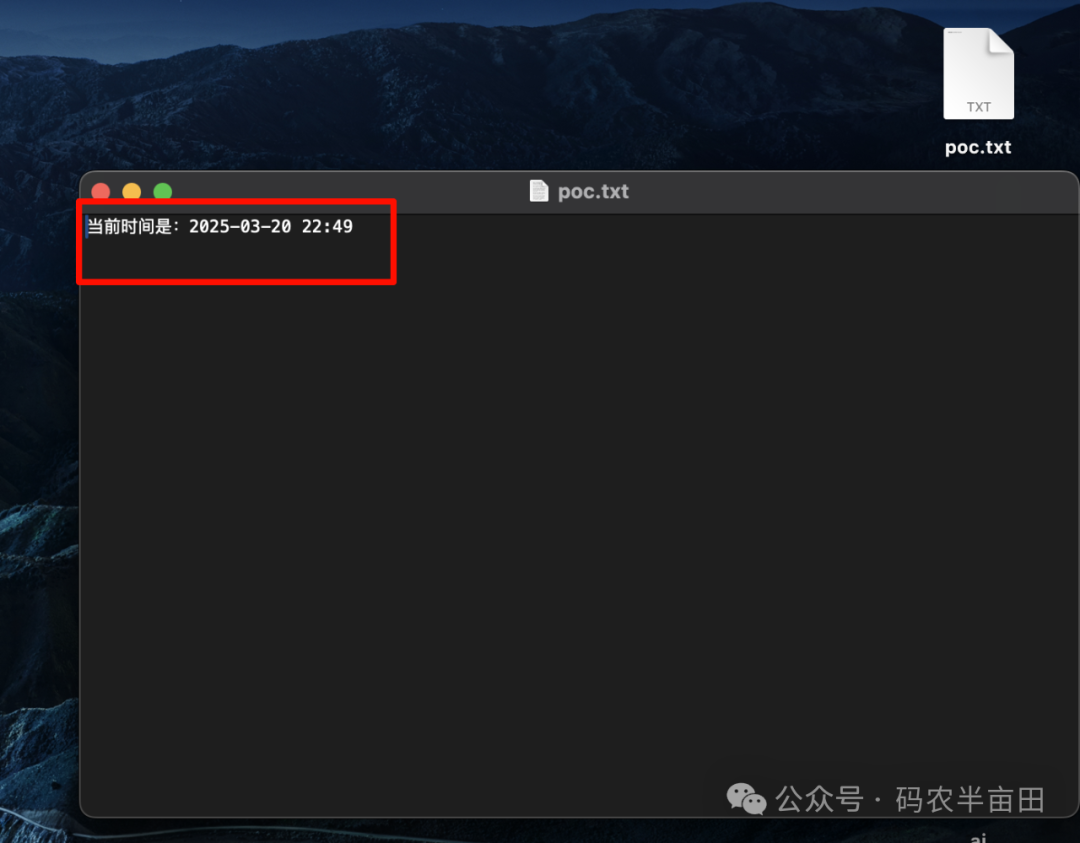

编排一个任务验证一下:

至此,两个例子都已演示完毕,谢谢观看。

只要有合适的工具,创意是无限的,探索更多精彩的功能,发挥你的潜力。

AI的发展有两条非常明确的路线:

- 1. 掌握更多的信息

- 2. 控制更多的工具

零基础如何学习AI大模型

领取方式在文末

为什么要学习大模型?

学习大模型课程的重要性在于它能够极大地促进个人在人工智能领域的专业发展。大模型技术,如自然语言处理和图像识别,正在推动着人工智能的新发展阶段。通过学习大模型课程,可以掌握设计和实现基于大模型的应用系统所需的基本原理和技术,从而提升自己在数据处理、分析和决策制定方面的能力。此外,大模型技术在多个行业中的应用日益增加,掌握这一技术将有助于提高就业竞争力,并为未来的创新创业提供坚实的基础。

大模型典型应用场景

①AI+教育:智能教学助手和自动评分系统使个性化教育成为可能。通过AI分析学生的学习数据,提供量身定制的学习方案,提高学习效果。

②AI+医疗:智能诊断系统和个性化医疗方案让医疗服务更加精准高效。AI可以分析医学影像,辅助医生进行早期诊断,同时根据患者数据制定个性化治疗方案。

③AI+金融:智能投顾和风险管理系统帮助投资者做出更明智的决策,并实时监控金融市场,识别潜在风险。

…

这些案例表明,学习大模型课程不仅能够提升个人技能,还能为企业带来实际效益,推动行业创新发展。

大模型就业发展前景

根据脉脉发布的《2024年度人才迁徙报告》显示,AI相关岗位的需求在2024年就已经十分强劲,TOP20热招岗位中,有5个与AI相关。

字节、阿里等多个头部公司AI人才紧缺,包括算法工程师、人工智能工程师、推荐算法、大模型算法以及自然语言处理等。

字节、阿里等多个头部公司AI人才紧缺,包括算法工程师、人工智能工程师、推荐算法、大模型算法以及自然语言处理等。

除了上述技术岗外,AI也催生除了一系列高薪非技术类岗位,如AI产品经理、产品主管等,平均月薪也达到了5-6万左右。

AI正在改变各行各业,行动力强的人,早已吃到了第一波红利。

最后

大模型很多技术干货,都可以共享给你们,如果你肯花时间沉下心去学习,它们一定能帮到你!

大模型全套学习资料领取

如果你对大模型感兴趣,可以看看我整合并且整理成了一份AI大模型资料包,需要的小伙伴文末免费领取哦,无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

部分资料展示

一、 AI大模型学习路线图

整个学习分为7个阶段

二、AI大模型实战案例

涵盖AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,皆可用。

三、视频和书籍PDF合集

从入门到进阶这里都有,跟着老师学习事半功倍。

四、LLM面试题

五、AI产品经理面试题

六、deepseek部署包+技巧大全

😝朋友们如果有需要的话,可以V扫描下方二维码联系领取~

1516

1516

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?