1.背景

Ollama和llama.cpp都是比较常见的本地部署大模型的工具,借助他们普通的笔记本也可以跑大模型。 Ollama和llama.cpp名字里面都带了个llama容易造成选择困难。本文希望能借助一个实际的例子,帮助你快速做出选择。

先说结论:如果只是本地部署不考虑性能的话闭眼选Ollama,如果要做"极致优化性能为王"就选llama.cpp.

后文会分别用Ollama和llama.cpp部署DeepSeek-R1 32B的实践说明如何得出这个结论的。

2.Ollama和llama.cpp的关系

Ollama和llama.cpp里面都带了个llama,就是我们熟悉的Meta开源的llama模型。 起初Ollama和llama.cpp都是用来服务llama的, 后来就独立发展成了两个独立的软件了, 他们都有自己的社区。

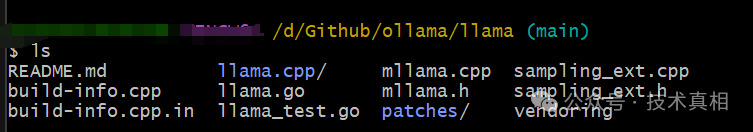

这里想重点说明的是, Ollama用llama.cpp作为底层实现模型推理的。这一点可以从Ollama的源码中得到答案:

Ollama代码的子目录llama里面就是包含了llama.cpp的代码, 并且通过llama.go文件将c++的接口导出到golang空间使用了。因此, 从源码的角度就可以认为llama.cpp就是Ollama的底层。

3.评测Ollama和llama.cpp

llama.cpp推荐的模型格式是GGUF, 为了公平让Ollama也使用同一个GGUF的模型。 我这里实验使用的是:DeepSeek-R1-Distill-Qwen-32B-Q5\_K\_M.gguf 模型。

3.1 Ollama部署DeepSeek-R1 32B

Ollama默认是不支持GGUF格式的,需要用Modelfile转换以下。步骤如下:

- 创建一个名为deepseek-r1-32b.gguf文件, 内容如下:

FROM ./bartowski/DeepSeek-R1-Distill-Qwen-32B-Q5_K_M.gguf

- 执行如下命令:

ollama create my-deepseek-r1-32b-gguf -f .\deepseek-r1-32b.gguf

就可以DeepSeek-R1 32B的GGUF模型导入到Ollama使用了

- 执行命令启动该模型:

ollama run my-deepseek-r1-32b-gguf:latest

这时可以正常加载了, 通过ollama ps命令可以看到进程信息如下:

NAME ID SIZE PROCESSOR UNTIL``my-deepseek-r1-32b-gguf:latest ad9f11c41b7a 25 GB 87%/13% CPU/GPU 3 minutes from now

可以看到,整个模型有25G, 87%加载到了CPU内存空间,13%加载到了GPU空间。实际使用发现推理是很慢的,但是还是可以用的。

3.2 llama.cpp部署DeepSeek-R1 32B

我用的是gitbash,因此llama.cpp的安装参考的是 参考:

https://github.com/ggml-org/llama.cpp/blob/master/docs/build.md#git-bash-mingw64

你也可以根据自己的情况选择正确的参考内容进行安装。安装完后,用如下命令执行:

build/bin/Release/llama-cli -m "/path/to/DeepSeek-R1-Distill-Qwen-32B-Q5_K_M.gguf" -ngl 100 -c 16384 -t 10 -n -2 -cnv

结果如下:

ggml_vulkan: Device memory allocation of size 1025355776 failed.`

`ggml_vulkan: vk::Device::allocateMemory: ErrorOutOfDeviceMemory llama_model_load: error loading model: unable to allocate Vulkan0 buffer llama_model_load_from_file_impl: failed to load model common_init_from_params: failed to load model 'D:/llm/Model/bartowski/DeepSeek-R1-Distill-Qwen-32B-Q5_K_M.gguf' main: error: unable to load model`

`

直接就报错了。

4.为什么llama.cpp部署不了

到这里,相信你知道怎么选型了。

不过,既然我们已经知道了llama.cpp是Ollama的底层,那为什么llama.cpp的表现反而不如Ollama呢?这个就要说到Ollama自己做的一个优化了, 也就是llama.cpp的ngl参数。用llama.cpp部署的时候ngl参数是写死的,而Ollama则是自己根据模型文件动态计算的ngl参数。

ngl参数的意思是将多少层加载到GPU去,我笔记本的GPU是4G显存,肯定不能将25G的DeepSeek加载进去的。因此llama.cpp的-ngl 100的用法肯定是不对的(100层基本就是全加载到GPU了),但是对于只有命令行的llama.cpp你也不好评估出-ngl应该取多少才能成功部署。

那Ollama是怎么做的呢?答案在Ollama的源码memory.go里面。这个文件里面的如下函数实现了根据模型计算ngl值的功能:

// Given a model and one or more GPU targets, predict how many layers and bytes we can load, and the total size``// The GPUs provided must all be the same Library``func EstimateGPULayers(gpus []discover.GpuInfo, f *ggml.GGML, projectors []string, opts api.Options) MemoryEstimate {` `// Graph size for a partial offload, applies to all GPUs` `var graphPartialOffload uint64` `// Graph size when all layers are offloaded, applies to all GPUs` `var graphFullOffload uint64` `// Final graph offload once we know full or partial` `var graphOffload uint64` `...

限于篇幅我就没有完整列出这个代码了,感兴趣的可以自己看下。正是这个函数让Ollama动态的计算了ngl的值,从而做出了“87%加载到了CPU内存空间,13%加载到了GPU空间”的动作,最终成功部署DeepSeek-R1 32B的模型。 实话实说, 普通的笔记本能部署32B的模型真的是太强了,出乎意料。

5.效果

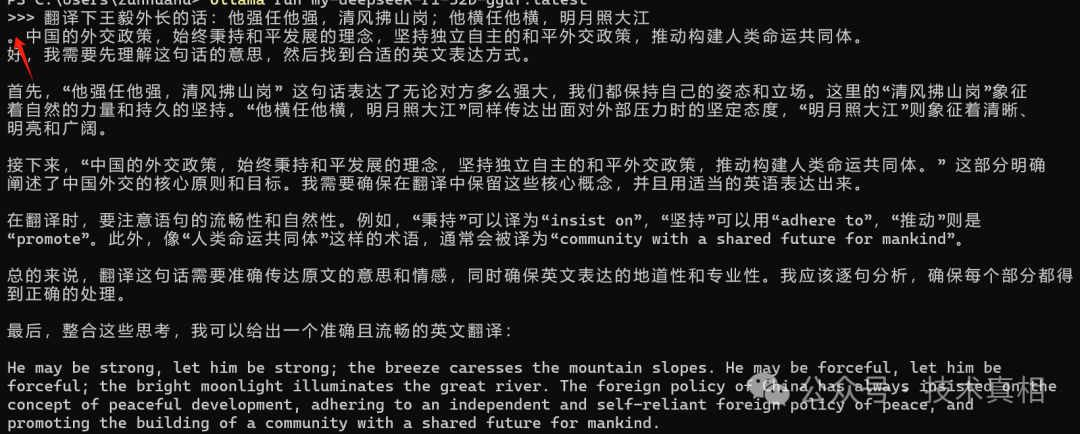

同样还是让它做前几天王毅外长交给DeepSeek的任务:翻译“他强任他强,清风拂山岗;他横任他横,明月照大江”。

结果有点奇怪, 虽然也给出了部分翻译, 但是它理解错了任务。可能和资源首先Ollama做了其他的什么参数优化吧。如果你有更好的想法,欢迎分享。

AI大模型学习路线

如果你对AI大模型入门感兴趣,那么你需要的话可以点击这里大模型重磅福利:入门进阶全套104G学习资源包免费分享!

扫描下方csdn官方合作二维码获取哦!

这是一份大模型从零基础到进阶的学习路线大纲全览,小伙伴们记得点个收藏!

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

100套AI大模型商业化落地方案

大模型全套视频教程

200本大模型PDF书籍

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

LLM面试题合集

大模型产品经理资源合集

大模型项目实战合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

2956

2956

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?