引言

近年来,大语言模型(LLM)如Meta的Llama 2系列凭借其强大的生成和理解能力成为NLP领域的核心工具。然而,直接将通用预训练模型应用于垂直领域(如医疗、法律、金融)时,常面临领域知识不足的问题。传统全参数微调(Fine-tuning)虽能提升领域表现,但存在计算成本高、易过拟合等缺陷。本文介绍如何通过LoRA(Low-Rank Adaptation)技术,对Llama 2进行二次预训练(Continued Pre-training),实现高效低成本的领域适配。

一、LoRA与二次预训练的背景

1.1 Llama 2模型简介

-

Llama 2是Meta于2023年推出的开源大语言模型家族,参数量涵盖7B/13B/70B。

-

优势:更强的上下文理解、更低的推理资源需求、支持商业用途。

-

局限性:通用预训练导致领域知识不足。

1.2 二次预训练的意义

-

目标:在特定领域语料(如医学论文、法律文书)上继续预训练,使模型吸收领域知识。

-

挑战:全参数微调需更新数十亿参数,GPU显存占用高,训练速度慢。

1.3 LoRA技术原理

-

核心思想:通过低秩分解(Low-Rank Decomposition)引入可训练旁路矩阵,冻结原始参数。

-

优势:参数效率提升90%+,显存占用降低,支持多任务切换。

二、实践步骤:基于LoRA的二次预训练

2.1 环境准备

python

# 依赖库

!pip install transformers==4.31.0 peft==0.4.0 accelerate==0.21.0 datasets==2.14.42.2 数据准备

-

领域语料示例(如金融领域):

-

文本清洗:去除HTML标签、特殊字符

-

分词:使用Llama 2 Tokenizer

-

格式:每行一个JSON对象,包含"text"字段

-

python

from transformers import AutoTokenizer

tokenizer = AutoTokenizer.from_pretrained("meta-llama/Llama-2-7b-hf")

def tokenize_function(examples):

return tokenizer(examples["text"], truncation=True, max_length=512)2.3 模型加载与LoRA配置

python

from transformers import AutoModelForCausalLM

from peft import LoraConfig, get_peft_model

model = AutoModelForCausalLM.from_pretrained(

"meta-llama/Llama-2-7b-hf",

load_in_8bit=True, # 量化加载

device_map="auto"

)

lora_config = LoraConfig(

r=8, # 秩

lora_alpha=32,

target_modules=["q_proj", "v_proj"], # 目标层

lora_dropout=0.05,

bias="none",

task_type="CAUSAL_LM"

)

model = get_peft_model(model, lora_config)

model.print_trainable_parameters() # 输出可训练参数占比(通常<1%)2.4 训练配置

python

from transformers import TrainingArguments, Trainer

training_args = TrainingArguments(

output_dir="./results",

per_device_train_batch_size=4,

gradient_accumulation_steps=8, # 显存不足时增大此值

warmup_steps=500,

max_steps=10000,

learning_rate=3e-4,

fp16=True,

logging_steps=100,

save_steps=1000,

optim="adamw_torch"

)

trainer = Trainer(

model=model,

args=training_args,

train_dataset=tokenized_datasets,

data_collator=lambda data: {'input_ids': torch.stack([f['input_ids'] for f in data])}

)2.5 训练与模型合并

python

# 启动训练

trainer.train()

# 合并LoRA权重到原模型

merged_model = model.merge_and_unload()

merged_model.save_pretrained("llama2-finance-lora")三、效果评估与对比

3.1 评估指标

-

困惑度(Perplexity):领域语料的PPL降低20-40%

-

领域QA准确率:在金融QA测试集上提升15%+

-

训练成本对比(7B模型):

方法 GPU显存 训练时间 磁盘占用 全参数微调 80GB+ 24h 13GB LoRA 24GB 12h 0.2GB

3.2 生成示例

输入:

"当前美联储加息对A股市场的影响主要是通过..."

原始Llama 2输出:

"作为AI模型,我无法预测金融市场..."

LoRA微调后输出:

"美联储加息通常导致美元走强,可能引发外资流出A股市场,短期内对成长股估值形成压力,但长期影响需结合国内货币政策分析..."

四、注意事项与扩展

-

数据质量:领域语料需充足(建议>1B tokens)且多样化

-

超参调优:尝试不同的秩(r=4/8/16)、学习率(1e-5~3e-4)

-

结合其他技术:可与Prompt Tuning、RLHF结合使用

五、结论

通过LoRA对Llama 2进行二次预训练,开发者能以极低的计算成本实现领域适配。该方法在保留原模型通用能力的同时,显著提升领域任务表现,为中小企业部署垂直领域大模型提供了可行方案。

最后

我还是那句话“最先掌握AI的人,将会比较晚掌握AI的人有竞争优势”。

我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

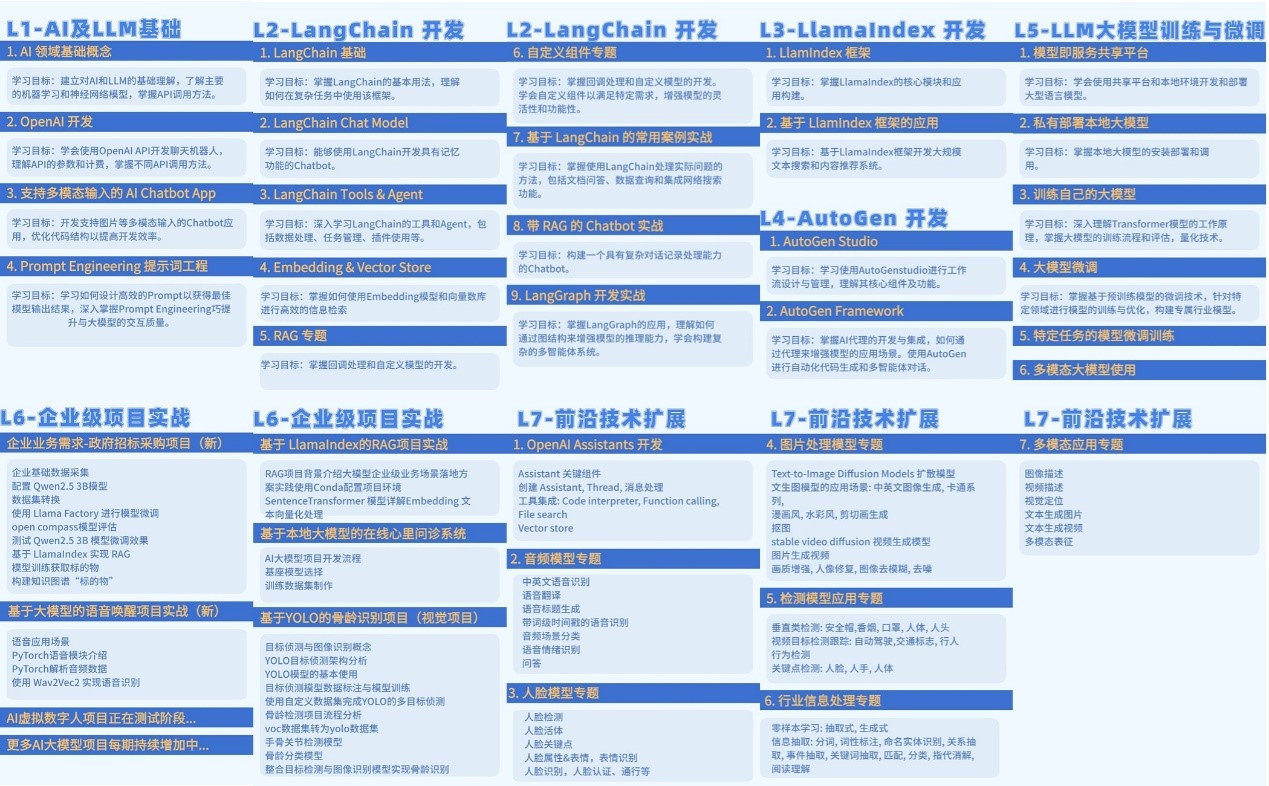

1、大模型全套的学习路线

学习大型人工智能模型,人工智能大模型学习路线图L1~L7所有阶段,需要系统的方法和持续的努力。既然要系统的学习大模型,那么学习路线是必不可少的,下面的这份路线能帮助你快速梳理知识,形成自己的体系。

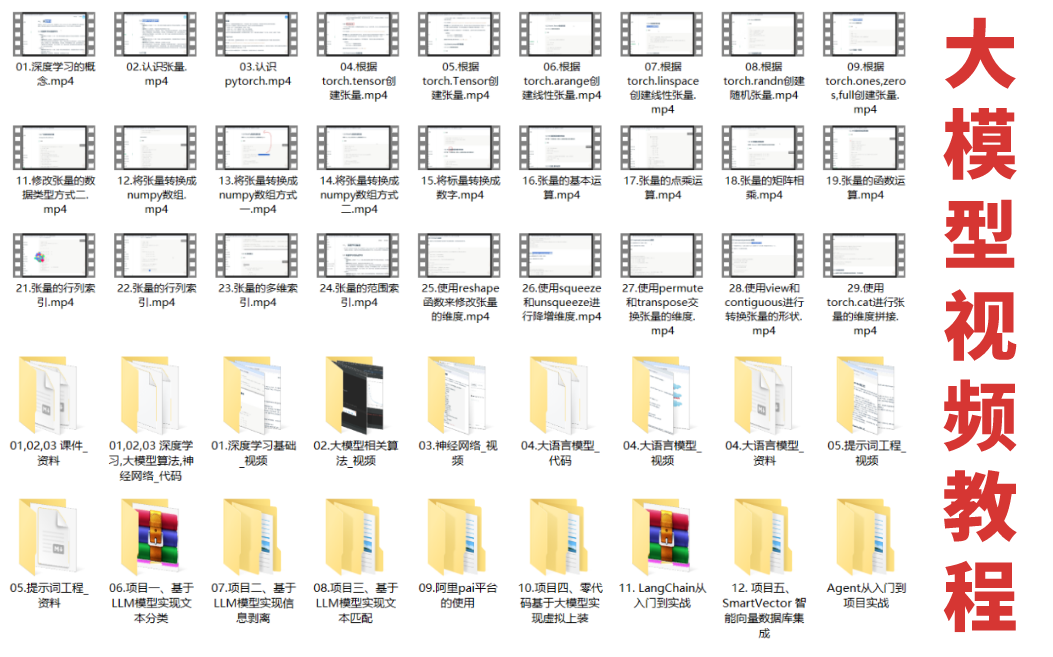

2. 大模型视频教程

对于很多自学或者没有基础的同学来说,这些纯文字类的学习教材会觉得比较晦涩难以理解,因此,我们提供了丰富的大模型视频教程,以动态、形象的方式展示技术概念,帮助你更快、更轻松地掌握核心知识。

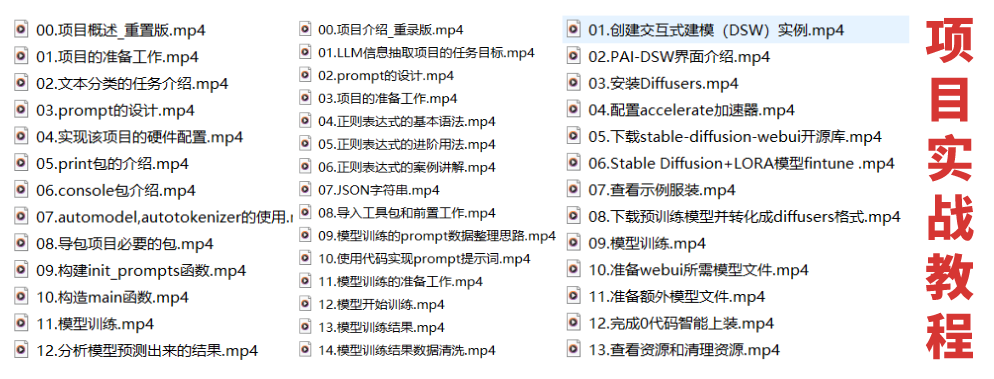

3. 大模型项目实战

学以致用 ,当你的理论知识积累到一定程度,就需要通过项目实战,在实际操作中检验和巩固你所学到的知识,同时为你找工作和职业发展打下坚实的基础。

1801

1801

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?