目录

1.3.2 Model-based reflex agents

1.1 代理模型

感知(Percepts):

代理对环境的感知/观察,是代理接收信息的来源,一般由硬件像传感器,键盘,摄像头等做出。不同饿输入手段也会使代理了解关于环境的不同信息。

行动(Action):

代理通过自身执行器做出的可能影响环境的行动,代理的目标是做出合理的行为。

环境(Environments):

代理所在的地方,并且能与其产生互动。环境会影响代理的感知和活动。代理的种类的设计通常会依环境而定。

性能测量(Performance Measure):

环境状态的可取性,量化评价代理所作行动的好坏。

1.2 作为函数的代理

代理可以通过经验来评估,有时也可以通过数学来分析。

代理是一个从感知序列到动作()的函数。

理想的理性代理会选择有望使其性能指标最大化的行动(基于感知序列和其固有知识)。

1.3 代理的种类

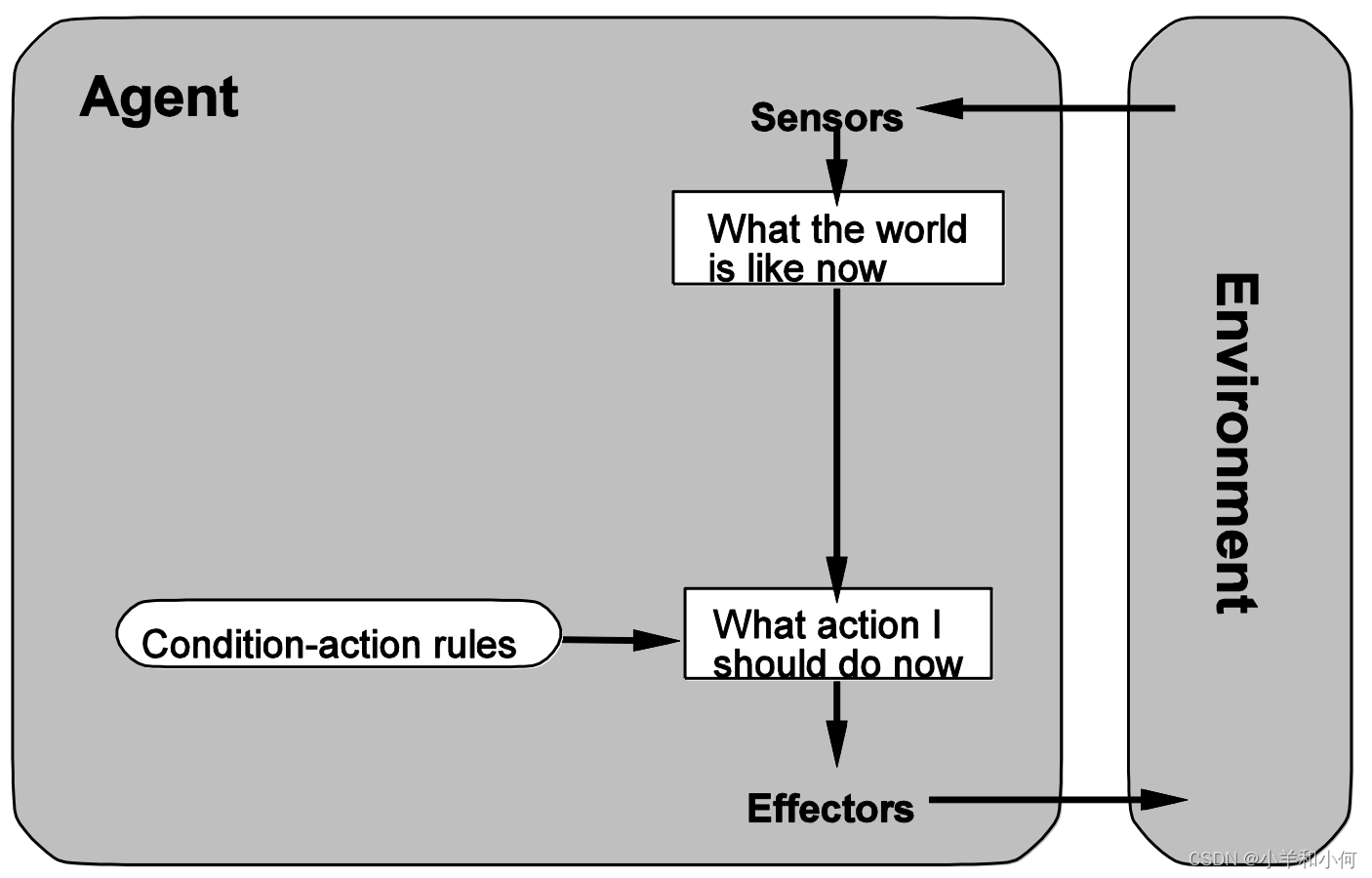

1.3.1 Simple reflex agents

简单的映射代理:

特点:适合简单的环境,忽略感知序列,而只针对当前感知选择行动,不关心过去的信息。(不记录环境的信息)

行动逻辑:条件到结果的直接映射(代码上反应为语句)。

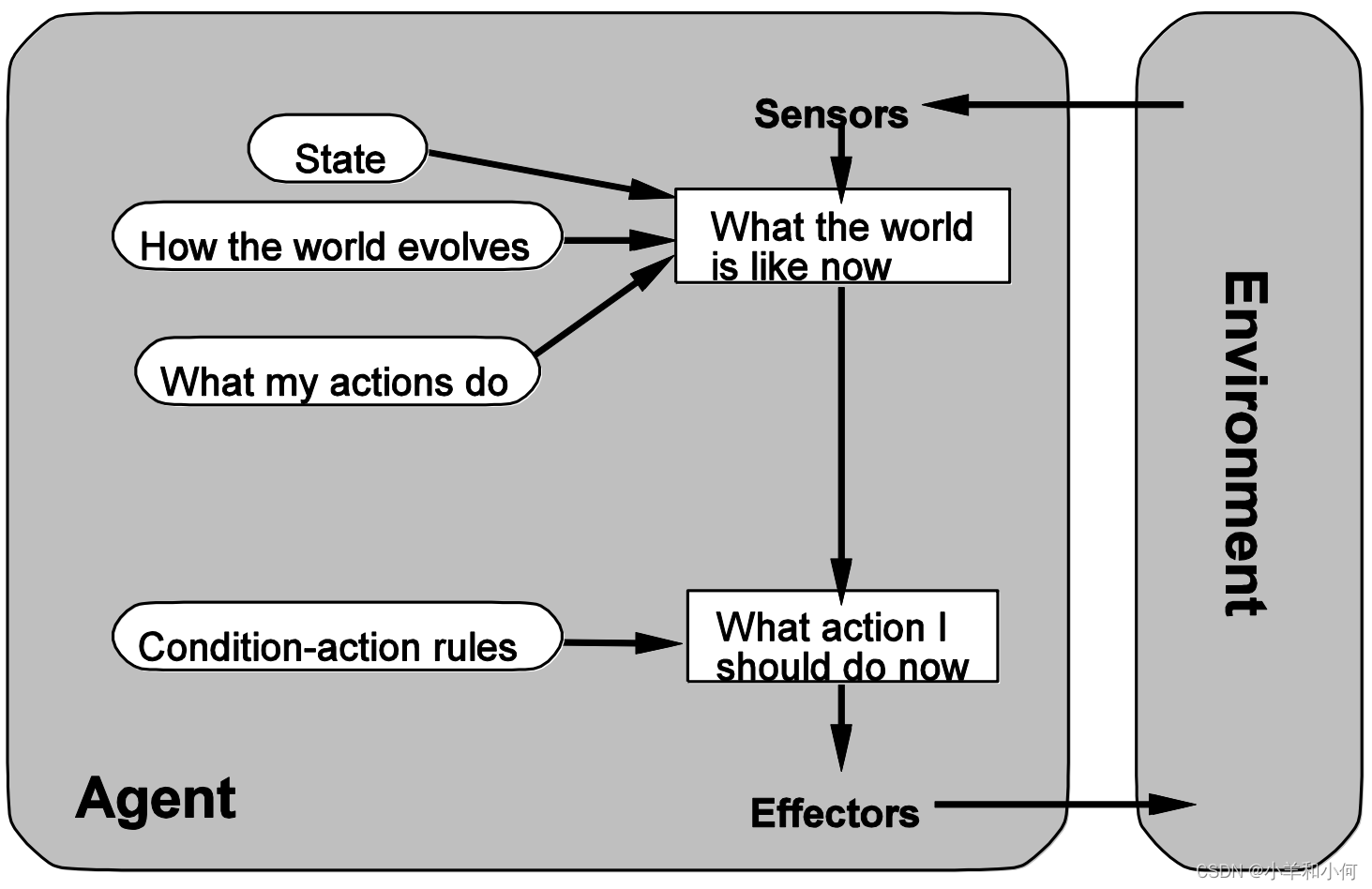

1.3.2 Model-based reflex agents

基于模型的代理:

特点:代理相比前者,可以通过状态对环境进行分析,通过模型推演出无法直接观测到的环境信 息,对环境信息的强化获取,适用于部分可见的环境。

行动逻辑:基于世界/物理规则,运用一些客观规律总结环境的信息,对行为进行反应,但依然是直接映射(代码上反应为语句)。

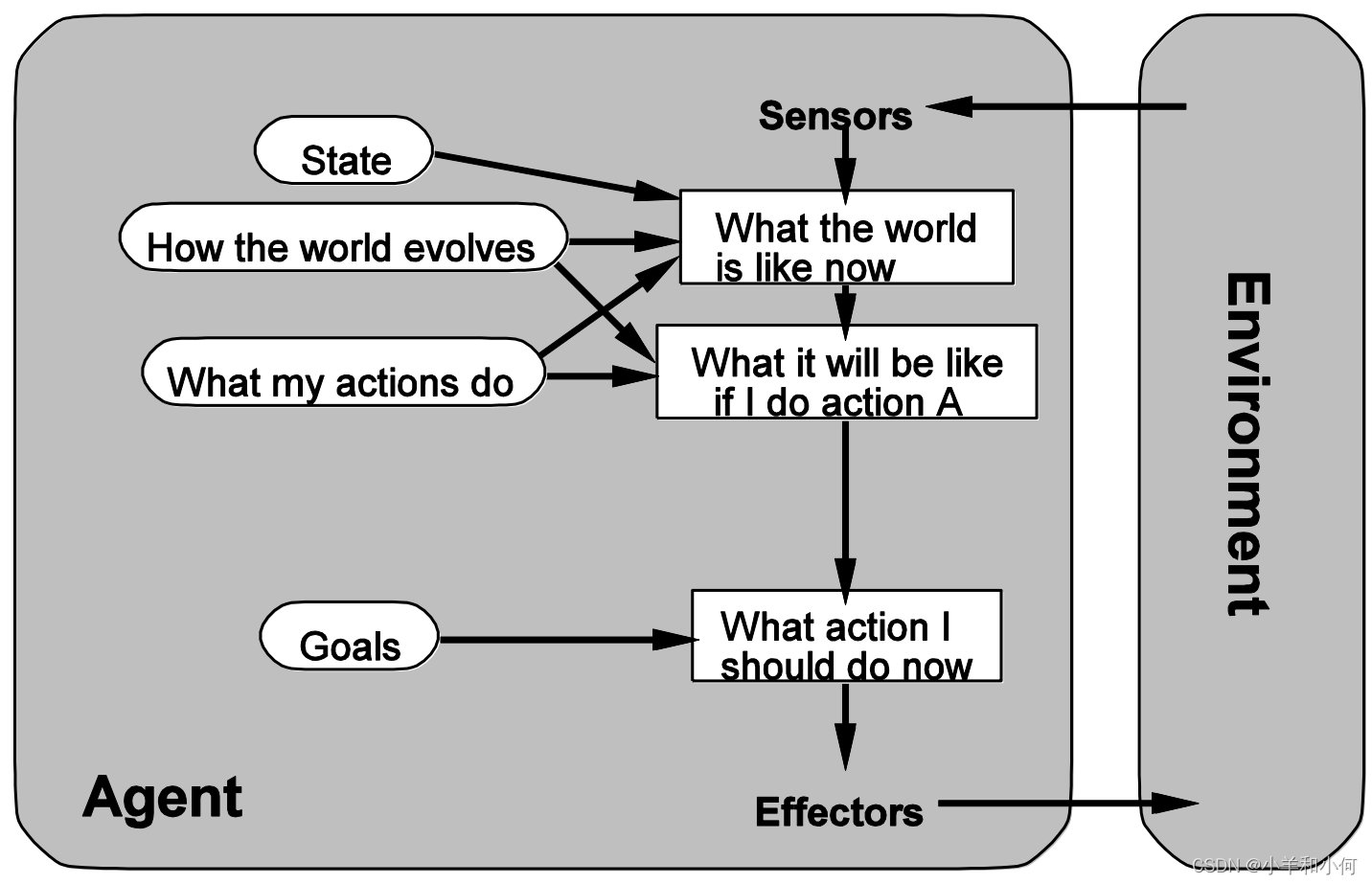

1.3.3 Goal-based agents

基于目标的代理:

特点:代理需要知道目标信息,并且作出的行动将受到目标的影响。

行动逻辑:盲目/随意选择所有合理的行为,直到代理在达到目标。(盲目搜索,过程是不断地尝试 所有可能的节点,最后返回⼀条达到目标的路径)

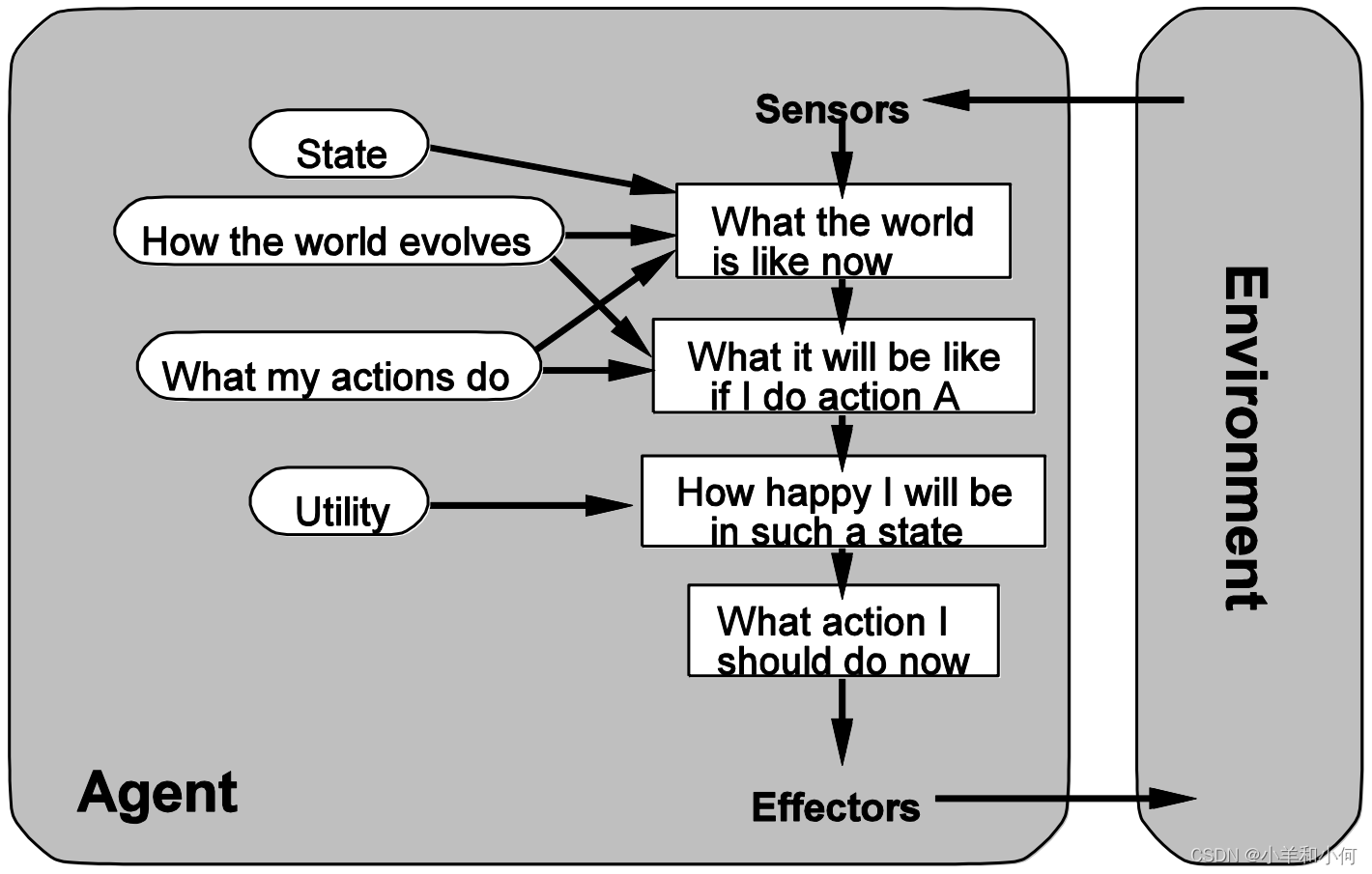

1.3.4 Utility-based agents

基于效用的代理:

特点:通过对行动进行评估,目的是高质量/效率完成目标。

行动逻辑:选择最高的行为。

1.4 环境的种类

环境可能是,也可能不是:

- 可见性:知觉包含了所有关于世界的相关信息。

- 确定性:当前世界的状态唯一决定了下一个世界。

- 顺序性:只有当前(或最近)的感知是相关的。

- 静态性:当代理在考虑时,环境不会改变。

- 离散性:有限数量的可能感知/行动。

(全局可见性/部分可见性):

形容是否环境中的信息全部/部分可以被观测到。

例子:

全局可见:国际象棋(所有的信息都可以从棋盘上得到)

部分可见:玩扑克(我们不知道其他玩家手里的牌)

(确定性/随机性):

行动的结果是否是包含随机性,当前世界的状态唯一决定了下一个世界。

例子:

确定的:国际象棋(没有随机时间发生)

随机的:西洋双陆棋(下一次的行为受到掷色子点数的影响)

(片断性/顺序性):

每⼀轮的行动之间是否有关联,还是只有当前(或最近)的感知是相关的。

例子:

片断的:掷色子(每回合的点数相不影响)

顺序的:围棋(⼀着不慎,满盘皆输,下⼀步的行为取决于之前的行为)

(静态性/ 动态性):

环境/规则是否会发生改变。

例子:

静态的:围棋(环境,规则不会改变,行动不受环境影响,当代理在考虑时,环境不会改变)

动态的:炉石传说(时间是环境组成成分,时间不断变化,行为逻辑也会变化,快到时间了往往不 会进行深入的思考,出牌逻辑趋于随机,因为⼀旦超时就输掉这一回合)

(离散性/ 连续性):

环境中的行为是否是连续的,即是否是有限数量的可能感知/行动。

例子:

离散的:国际象棋(回合制)

连续的:自动驾驶(连续行为)

环境类型在很大程度上决定了代理的设计。

现实世界是部分可观察的、随机的、顺序的、动态的、连续的。

3183

3183

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?