2014年的文章,神经机器翻译相对SMT统计机器翻译而言是比较新的方法,包含一个encoder一个decoder,encoder将变长的输入序列转化为定长的表示方式,然后decoder再将其转化为正确的翻译。这篇文章是想用两种模型分析神经机器翻译的特性:RNN encoder-deocoder模型和门递归卷积神经网络(grCnov)。总的发现是,神经机器翻译在没有生词的短句翻译上表现良好,但是当句子变长、生词变多时性能下降很快。另外,门递归卷积神经网络可以自动学习一个句子的语法结构。

神经机器翻译需要的存储单元比SMT少很多.这里用的RNN模型是带记忆的,

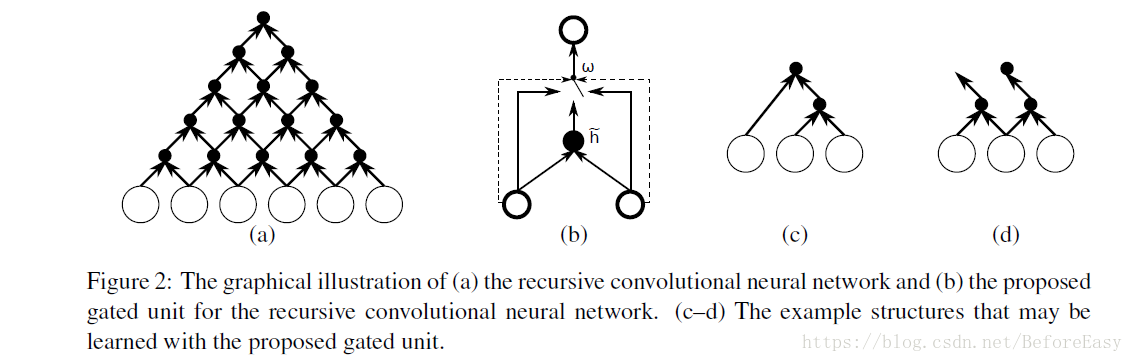

用到的另一种神经机器翻译模型是CNN的一种,在通常的CNN的基础上添加了门的机制,这样递归网络可以快速的学习源句子的结构。

这是递归神经网络的图

训练过程:

在英语-法语的训练集上,minibatch SGD的方法来训练两个模型,RNN模型使用tanh,后者使用max(0,x);来做非线性化处理;然后使用基本的beam search来寻找条件概率最大的回答。

结论就是翻译效果与句子长度和生词数是有关的。两个模型都在短句、无生词的时候表现最好,但是两者的表现都没有超过SMT系统;结合SMT之后整体的翻译效果变好了。神经模型在记录长句的时候会丢失一些信息,而传统的方法在长句上的表现则更好。

1045

1045

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?