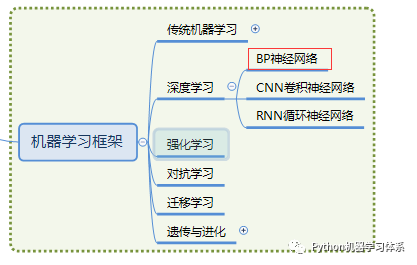

0.学习路径示意图

Hello,各位小伙伴大家晚上好呀,这期开始,博主就开始给大家分享深度学习这一块的内容啦。至于为啥要先开始讲BP神经网络(Back Propagetion Networks 反向传播网络),而不是一上来就是高大上的CNN、RNN、LSTM blabla,原因非常简单,上述所说各种高大上的神经网络都是基于BP网络出发的,最基础的原理都是由BP网络而来,所以小伙伴们只要掌握了这章最基本的原理,接下来的各种网络也能学得得心应手,有没有一种BP在手,天下我有的感觉。

废话不多说,这期的内容主要分为以下几点

1.BP神经网络简介

2.BP神经网络原理

3.Tensorflow开发环境搭建

4.总结

1.BP神经网络简介

BP网络(Back Propagetion Networks 反向传播网络),相信很多小伙伴一听到这个“网络”二字,头皮就开始发麻,博主一开始学的时候也一样,觉得网络密密麻麻地,绝对难得一批,其实不然,这里的网络比我们现实生活中的网络简化了不止一丁点儿,但是它却能出奇地完成各种各样的任务,逐渐成为我们人类智能生活的璀璨明珠。当然,BP网络虽然并不是最耀眼的一颗,但却是每一个初学的小伙伴必须去了解的一颗,博主认为BP网络是每个小伙伴深度学习之旅的开端。

2.BP神经网络原理

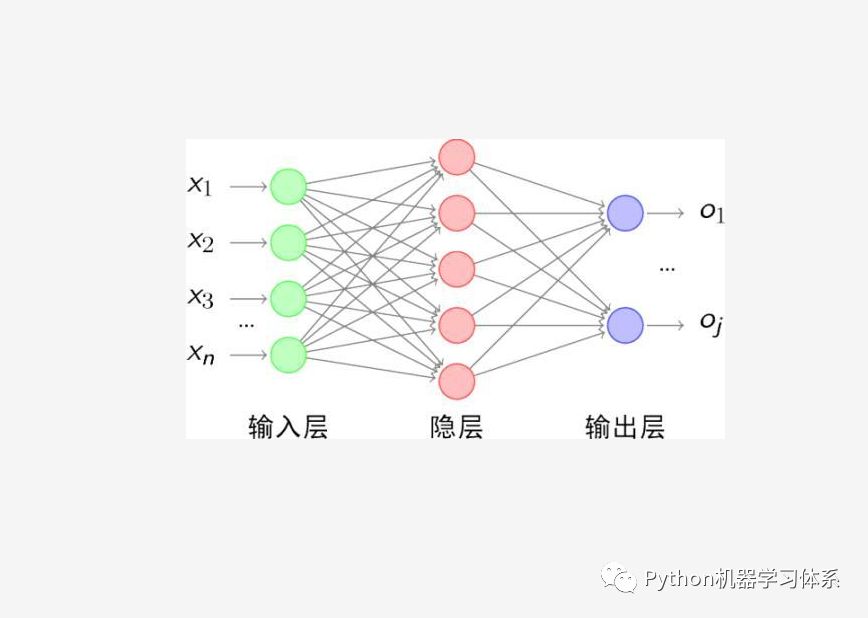

光看名字,可能小伙伴们并不了解这个网络是干啥的,那博主先给大家上个图,作为神经网络家族中最简单的一种网络,相信大家看完它的结构之后一定会对它有个非常直观的了解。

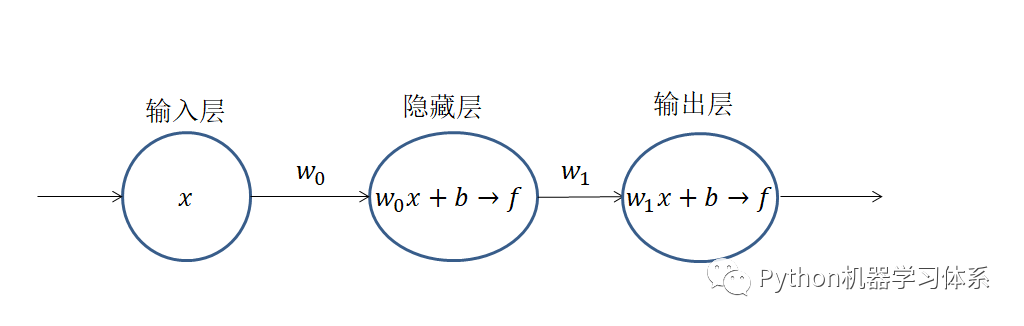

对,就是这么个东西,左边输入,中间计算,右边输出。可能这样还不够简单,博主给大家画一个更简单的。

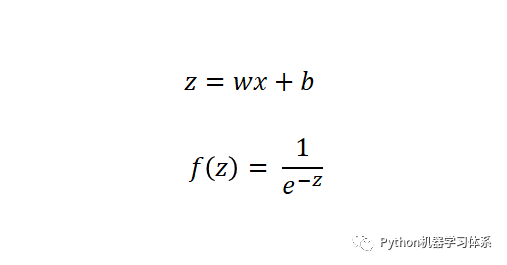

不算输入层,上面的网络结构总共有两层,隐藏层和输出层,它们“圆圈”里的计算都是下图的计算组合

每一级都是利用前一级的输出做输入,再经过圆圈内的组合计算,输出到下一级。

看到这里,可能很多小伙伴会疑惑,为什么要加上f(z)这个运算,这个运算的目的是为了将输出的值域压缩到(0,1),也就是所谓的归一化,因为每一级输出的值都将作为下一级的输入,只

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2042

2042

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?