以下内容基于如下文献:

A Comprehensive Survey on Graph Neural Networks

图神经网络

基于模型结构分类的图神经网络

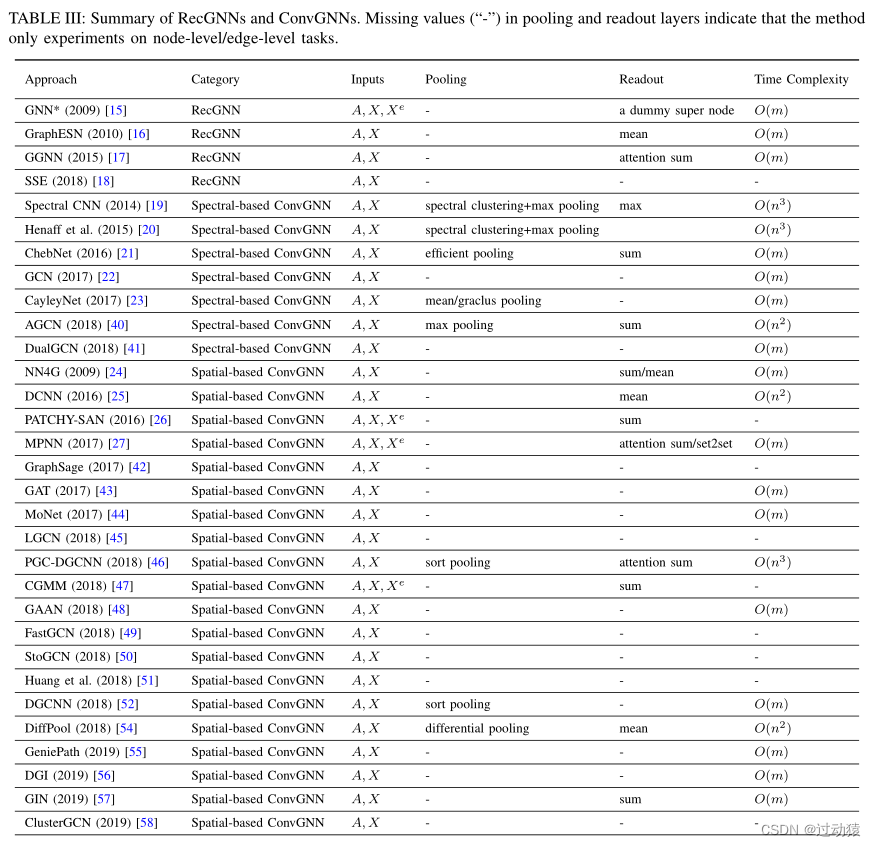

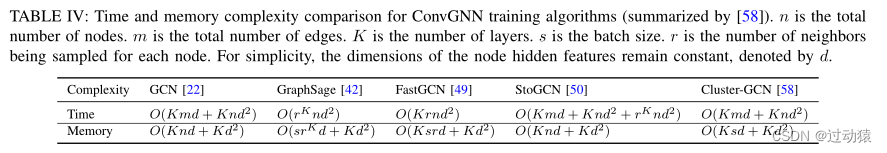

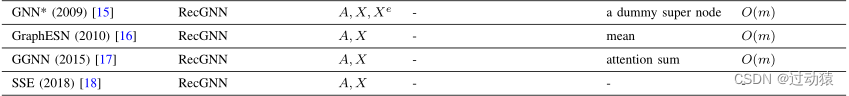

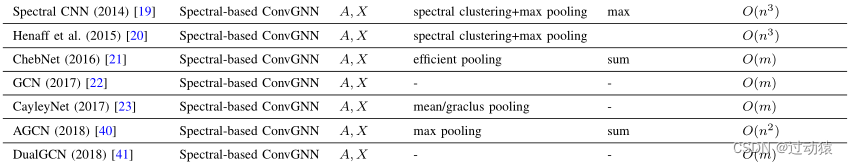

- 常见循环图神经网络和卷积神经网络

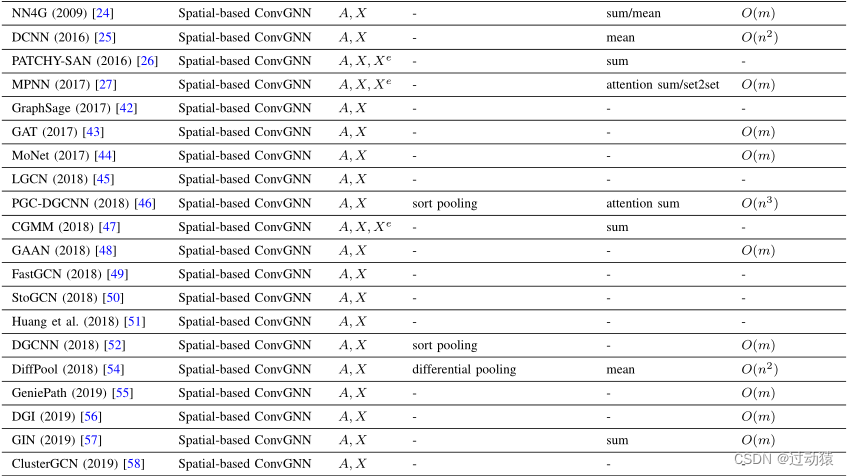

- 常见卷积神经网络的性能比较

1. 循环图神经网络(ResGNNs)

循环图神经网络(Recurrent graph neural networks,ResGNNs):假设图中的一个节点不断地与它的邻居交换信息/消息,直到达到稳定的平衡

2. 卷积图神经网络

卷积图神经网络(Convolutional graph neural networks, ConvGNNs):是通过聚集节点

v

v

v 自身的特征

x

v

x_v

xv 和邻居的特征

x

u

x_u

xu来生成节点v的表示,其中

u

∈

N

(

v

)

u∈N(v)

u∈N(v)。与RecGNNs不同,ConvGNNs堆叠多个图卷积层来提取高级节点表示。下图(a)表示节点分类,图(b)表示图分类。

基于谱域的ConvGNNs(Spectral-based ConvGNNs)

代表模型:ChebNet、GCN、DGCN(Directed Graph Convolutional Network)、lightGCN

基于空域的ConvGNNs(Spatial-based ConvGNNs)

代表模型:GraphSage、GAT、LGCN、DGCNN、DGI、ClusterGCN

谱域图卷积模型和空域图卷积模型的对比

由于效率、通用性和灵活性问题,空间模型比谱模型更受欢迎。

- 谱模型的效率低于空间模型:谱模型要么需要进行特征向量计算,要么需要同时处理整个图。空间模型通过信息传播直接在图域进行卷积,因此对大型图具有更强的可伸缩性。计算可以在一批节点中进行,而不是在整个图中进行。

- 依赖于图傅里叶基的谱模型对新图的泛化能力较差:他们假设一个固定的图形。对图的任何扰动都会导致特征基的变化。基于空间的模型在每个节点上执行局部图卷积,其中权重可以在不同的位置和结构之间轻松共享。

- 基于谱的模型仅限于在无向图上操作。基于空间的模型更灵活地处理多源图输入:如边输入[15],[27],[86],[95],[96],有向图[25],[72],有符号图[97],异构图[98],[99],因为这些图输入可以很容易地合并到聚合函数中。

图卷积模型中的下采样策略

在GNN生成节点特征后,我们可以将其用于最后的任务。但是,直接使用所有这些特征在计算上具有挑战性,因此,需要一个下采样策略。根据目标和它在网络中扮演的角色,这种策略有不同的名称,但它们的机制非常相似。:

- 池化(pooling):旨在通过对节点进行下采样来减少参数的大小,以生成更小的表示,从而避免过拟合、排列不变性和计算复杂性问题

- 读出(readout):主要用于生成基于节点表示的图级表示。

h G = m e a n / m a x / s u m ( h 1 ( K ) , h 2 ( K ) , . . . , h n ( K ) ) , K 是当前最后一个图卷积层的索引。 h_G = mean/max/sum(h_1^{(K)},h_2^{(K)},...,h_n^{(K)}),K是当前最后一个图卷积层的索引。 hG=mean/max/sum(h1(K),h2(K),...,hn(K)),K是当前最后一个图卷积层的索引。

3. 图自编码器(GAEs)

图自编码器(Graph autoencoders ,GAEs):是一种无监督学习框架,它将节点/图编码到潜在的向量空间中,并从编码的信息重构图数据。GAEs用于学习网络嵌入和图生成分布。图©展示了用于网络嵌入的GAE。

4. 时空图神经网络(STGNNs)

时空图神经网络(Spatial-temporal graph neural networks,STGNNs)旨在从时空图中学习隐藏模式,这在各种应用中变得越来越重要,如交通速度预测[72]、驾驶员机动预测[73]和人体动作识别[75]。stgnn的关键思想是同时考虑空间依赖性和时间依赖性。图(d)展示了用于时空图预测的STGNN。

代表模型:

GCRN、DCRNN、Structural-RNN 、ST-GCN、StemGNN

总结

- 循环图神经网络(ResGNNs):GNN、GraphESN、GGNN、SSE

- 基于谱域的ConvGNNs:ChebNet、GCN、DGCN(Directed Graph Convolutional Network)、lightGCN

- 基于空域的ConvGNNs:GraphSage、GAT、LGCN、DGCNN、DGI、ClusterGCN

- 图自编码器(GAEs):GAE、VGAE

- 时空图神经网络(STGNNs):GCRN、DCRNN、Structural-RNN 、ST-GCN、StemGNN

循环图神经网络和时空图神经网络的区别:

- 循环图神经网络:将时序神经网络模型放到图神经网络内部(消息传播机制(propagation)中),以减少图中的拓扑结构信息在传播过程中造成的损失

- 时空图神经网络:将时序神经网络模型放到图神经网络外部,以获取图结构的时间和空间信息。

可以简单地理解为:循环图神经网络是将时序模型嵌入到图模型中,时空图神经网络是将图模型嵌入到时序模型中(或将二者结合)

图模型分类

图类型适用情况

1. 有向图

适用模型:GraphSAGE、GAT、DirectedGCN

2. 无向图

适用模型:GCN

3. 异构图

异构图:指存在几种不同类型的节点

适用模型:GraphSAGE、GAT

4. 带边信息的图

带边信息的图:边带有额外的信息。有两种解决方案:

- 把这类图查分成二部图(二部图:把一个图的顶点划分为两个不相交子集 ,使得每一条边都分别能连接两个集合中的顶点。如果存在这样的划分,则此图为一个二分图),把带信息的边变成节点。即:开始节点 - 边节点 - 结束节点

- 对于不同类型的边采用不同的权重矩阵来传播

5. 动态图

动态图:将复杂网络表示为随时间变化的结构

https://arxiv.org/pdf/2005.07496.pdf

https://arxiv.org/pdf/2203.10480.pdf

6. 多维图

多维图指的是节点之间有多种关系,形成一个多维度的图

适用模型:RGCN

其他

循环图神经网络(ResGNNs):

模型:GNN、GraphESN、GGNN、SSE

基于谱域的ConvGNNs:

模型:ChebNet、GCN、DGCN(Directed Graph Convolutional Network)、lightGCN

基于空域的ConvGNNs:

模型:GraphSage、GAT、LGCN、DGCNN、DGI、ClusterGCN

图自编码器(GAEs):

模型:GAE、VGAE

时空图神经网络(STGNNs):

模型:GCRN、DCRNN、Structural-RNN 、ST-GCN、StemGNN

效率

模型:FastGCN、ClusterGCN

无监督

模型:DGI

将CNN的原理应用于图卷积

模型:LGCN

编码

模型:GAE、VGAE

时空

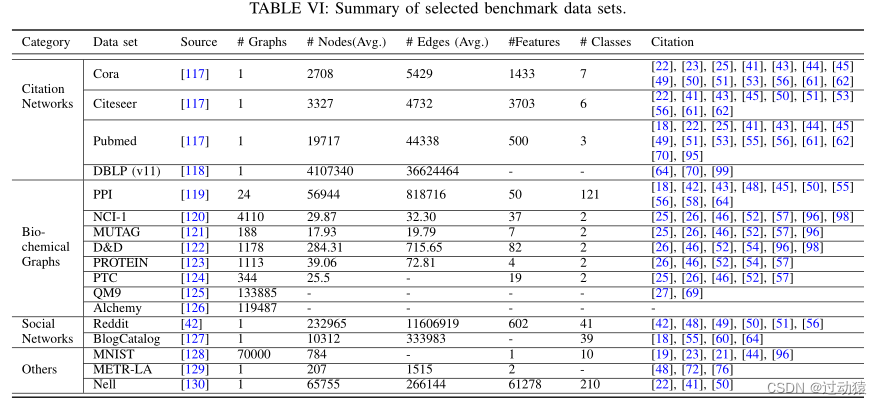

数据集

学术单词

- Taking sth as an example:以…为例

1884

1884

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?