1.preliminaries-autograd

# 对非标量调用backward需要传入一个gradient参数,该参数指定微分函数关于self的梯度。

# 本例只想求偏导数的和,所以传递一个1的梯度是合适的

x.grad.zero_()

y = x * x

# 等价于y.backward(torch.ones(len(x))),把y转换为标量

y.sum().backward()

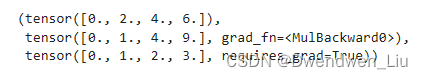

x.grad,y,x

为什么y.sum()求和可以得到结果

# 对非标量调用backward需要传入一个gradient参数,该参数指定微分函数关于self的梯度。

# 本例只想求偏导数的和,所以传递一个1的梯度是合适的

x.grad.zero_()

y = x * x

# 等价于y.backward(torch.ones(len(x))),把y转换为标量

y.sum().backward()

x.grad,y,x

为什么y.sum()求和可以得到结果

611

611

574

574

1023

1023

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?