模型蒸馏(Model Distillation)和知识蒸馏(Knowledge Distillation)是紧密相关的概念,但在技术范畴和应用细节上存在一定差异。

一、核心定义

-

知识蒸馏(Knowledge Distillation, KD)

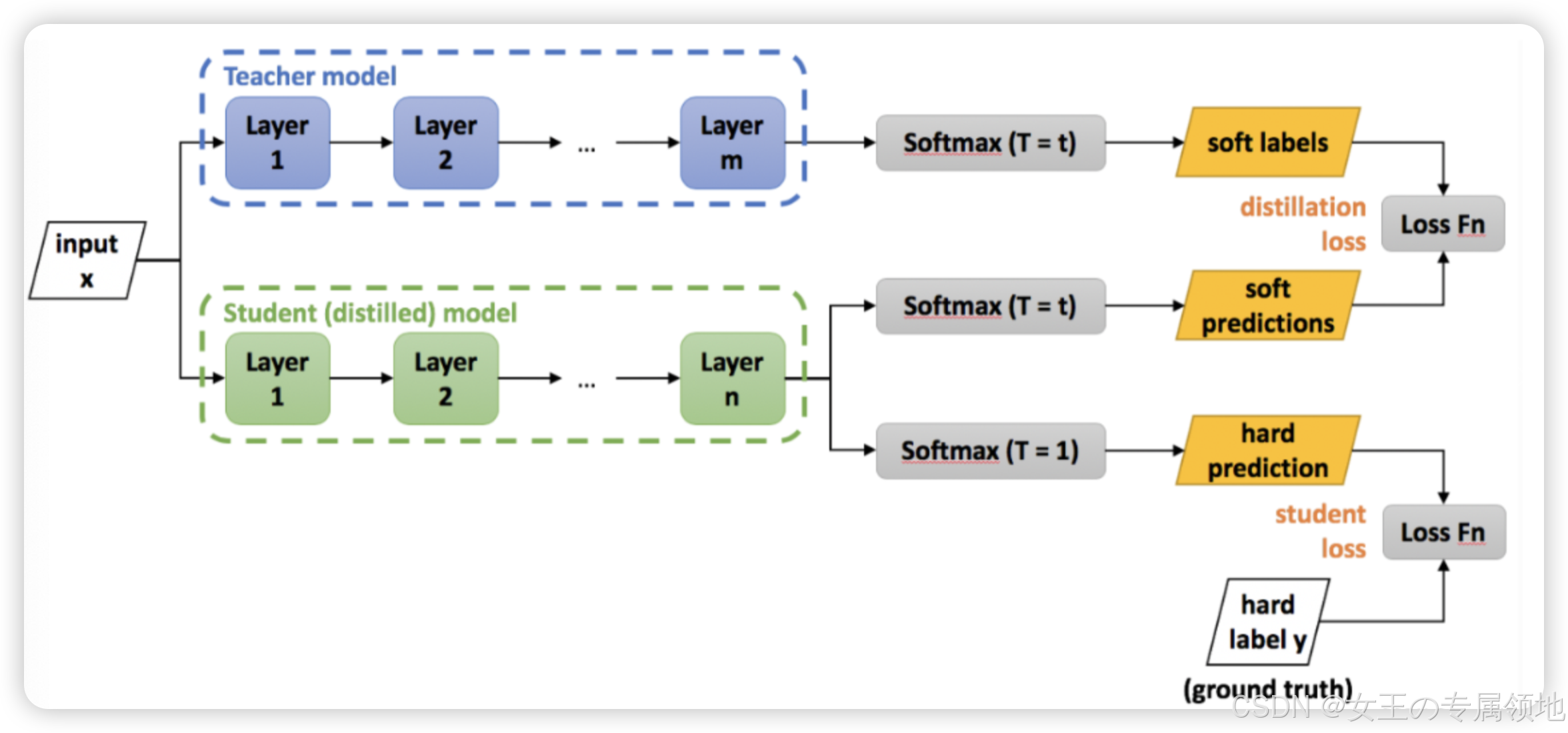

- 狭义概念:特指通过迁移教师模型的“知识”(如输出概率分布、中间层特征等)来训练学生模型的方法,由Hinton等人在2015年提出。

- 核心思想:学生模型模仿教师模型的软标签(Soft Targets),而非直接学习真实标签(Hard Labels)。

-

模型蒸馏(Model Distillation)

- 广义概念:泛指将大模型(教师模型)的知识迁移到小模型(学生模型)的技术体系<

订阅专栏 解锁全文

订阅专栏 解锁全文

3790

3790

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?