细粒度图像分类(Fine-Grained Image Classification, FGIC)是在区分出基本类别的基础上,进行更精细的子类划分,如区分鸟的种类、车的款式、狗的品种等,在工业界和实际生活中都有着广泛的业务需求和应用场景。早期细粒度图像分类(FGIC)算法多基于特征提取,但由于特征的表述能力有限,分类效果有很大的局限。近年来,随着深度学习的兴起,神经网路强大的特征提取能力促进了该领域的快速进步。

在细粒度图像分类中由于不同种类目标的类间差异小,因此对目标进行准确的局部定位和描述是细粒度图像分类的关键,目前已有许多学者进行了探索并取得了显著效果[1-3],为了更加精确的定位到鉴别性强的部件,本文提出了一种特征增强模块(Feature enhancement blocks, FEB),将其加入部件建议生成器(Part proposal generator, PPG)中;现有方法对提出的部件特征大多直接进行特征拼接,这忽视了不同部件鉴别力的差异,为此本文提出了上下文转换器(Context Transformer) ,令鉴别力最高的部件作为“领航员”(Navigator),其它部件在“领航员”的引领下进行联合特征学习。

最后对于融合后的特征,本文提出了金字塔上下文集成块(Pyramid Context Integration Block, PCIB)来进行更好的集成。实验结果表明本文提出的方案在三个常用数据集上达到了较优的性能。

论文题目:

Cross-Part Learning for Fine-Grained Image Classification

论文来源:

IEEE Transactions on Image Processing 2021, VOL. 31, 2022

论文链接:

https://ieeexplore.ieee.org/document/9656684

01

介绍

由于深度神经网络的巨大成功,细粒度图像分类(Fine-Grained Image Classification, FGIC)领域得以快速发展。FGIC任务的目标是从不同超类中对不同的子类进行划分[4],其面临的挑战主要来自于类内差异大,类间差异小。类内差异大体现在属于同一子类别的对象往往呈现不同的外观,尤其是姿势变化显著的非刚性对象,如鸟类,鱼类等;类间差异小体现在来自不同子类别的物体具有相似的外观,只有通过专业知识才能进行识别。因此很多学者希望使用基于部件的方法来发现目标间细微的区别以实现更好的分类。

早期基于部件的工作[5-7]试图通过获取细微和局部差异来提高细粒度识别性能。这些标注起到了显著的效果,然而这些方法引入了对象的标注框和密集的部件标注,这会浪费大量的人力,并需要很强的专业知识,限制了其在真实场景中的应用,最新的一些工作提出以弱监督的方式来解决这个问题,仅需要对象标签信息。弱监督的方法可以大致分成了三类:

第一类是基于双线性特征的分类方法,该方法的思路是使用两个不同的CNN协同完成细粒度图像的类别检测和特征提取,通过双线性操作和特征归一化得到最终的双线性特征,将其作为分类依据[8]。然而,双线性特征的高维统计导致需要大量的算力,针对此后续有很多学者进行了改进和探索[9-11]。

第二类是基于部件的方法,这些方法通过对原始图像的切分,找出局部对分类结果影响大的部件,对这些部件进行特征融合得到更好的分类结果。定位到的部件对最终的分类结果影响很大,如何定位到鉴别力更强的部件一直是这类工作研究的重点,本文提出了一种特征增强模块(Feature Enhancement Blocks, FEB),将其加入部件建议生成器(Part Proposal Generator, PPG)中更好的定位到强鉴别力的部件。

第三类则是基于注意力机制的方法。近期源自自然语言处理(Natural Language Processing, NLP)的Transformers[12]模型在计算机视觉任务中取得了显著成效[13-15],也被广泛的应用于细粒度图像分类(FGIC)[16-18]。基于部件的FGIC方法大多对于部件特征直接进行拼接,这忽视了部件间融合的合理性,针对这一点,本文提出了跨部件的特征学习(Cross-parts Feature Learning)。具体来说,本文利用注意机制[19]设计了上下文转换器(Context Transformer),令鉴别力最高的部件作为“领航员”(Navigator),其它部件在“领航员”的引领下进行联合特征学习,使部件融合更加合理。

本文的主要贡献如下:

1. 本文提出了一种端到端的弱监督跨部件卷积神经网络(Cross-Part Convolutional Neural Network, CP-CNN),提出了一种特征增强块(Feature Enhancement Blocks, FEB)来提升部件建议生成器(Part Proposal Generator, PPG)的性能。

2. 借鉴Transformers的核心思想,利用注意力机制设计了上下文转换器(Context Transformer),令鉴别力最高的部件作为“领航员”(Navigator),在“领航员”的指导下实现跨部件特征融合。

3. 提出金字塔上下文集成块(Pyramid Context Integration Block, PCIB)来集成融合后的特征。

4. 实验结果表明,本文提出的CP-CNN在CUB-200-2011、Stanford Cars和FGVC-Aircraft数据集上达到了较优的性能。

02

方法介绍

为了在不需要边界框或密集的部件标注的情况下提高细粒度图像分类(FGIC)的性能,本文提出了一个弱监督的跨部件卷积神经网络模型(CP-CNN)。

该模型首先通过提出的特征增强模块(FEB)提升建议生成器(PPG)的定位能力;定位到部件后通过上下文转换器(Context Transformer)实现部件间的联合特征学习;最后使用金字塔上下文集成块(Pyramid Context Integration Block, PCIB) 集成融合后的特征。

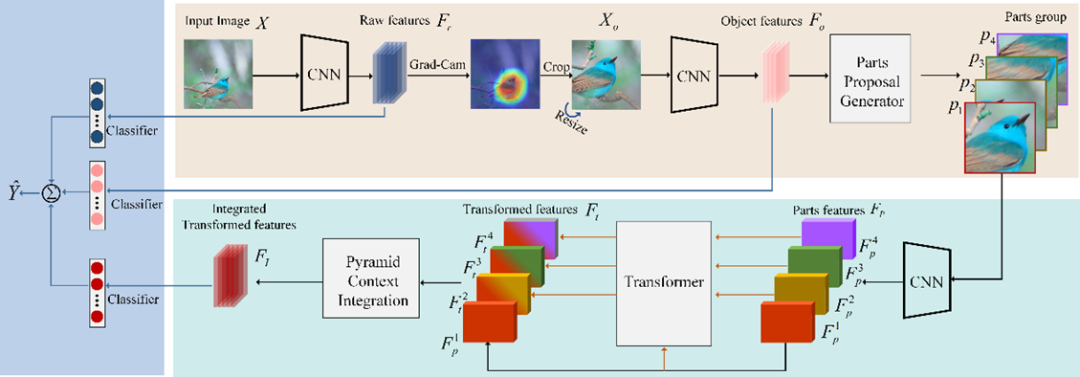

该模型的总体结构如图1所示,本章后续的安排如下:2.1特征增强的部件建议生成器;2.2 部件交互学习的上下文转换器;2.3 金字塔上下文集成。

图1 CP-CNN网络结构

2.1 特征增强的部件建议生成器

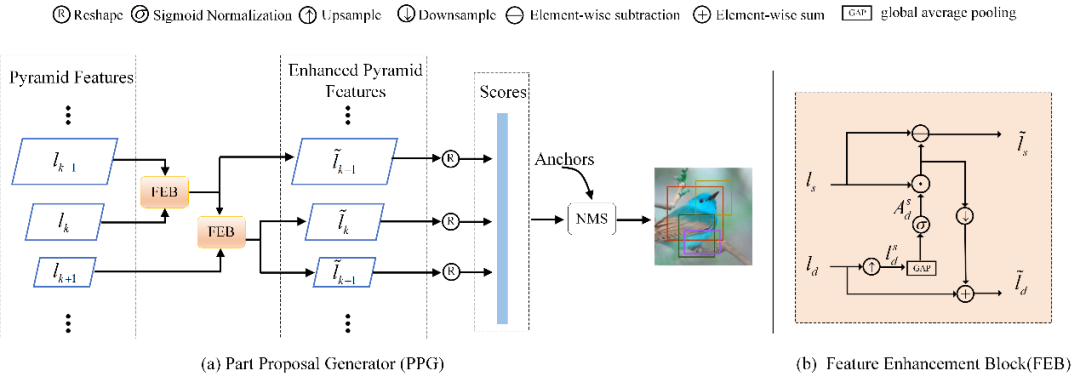

为了解决由尺度多样性引起的变化,需要探索不同尺度下部件特征表示的关系。浅层特征包含了更加丰富的细节信息,有利于小部件定位;深层特征突出了大部件的信息,可用于大部件的区分。本文尝试通过嵌入多个增强特征块(FEB)来设计部件建议生成器(PPG),利用深层特征对浅层特征中大部件的噪声进行抑制,增强浅层对小部件的提取性能;同时利用浅层特征对深层特征进行补充,丰富深层大部件的信息。其具体的结构如图2所示,算法1则展示了部件建议生成器(PPG)的主要过程。

图2 (a)部件建议生成器(PPG)结构 (b)特征增强模块(FEB)

2.2 部件交互学习的上下文转换器

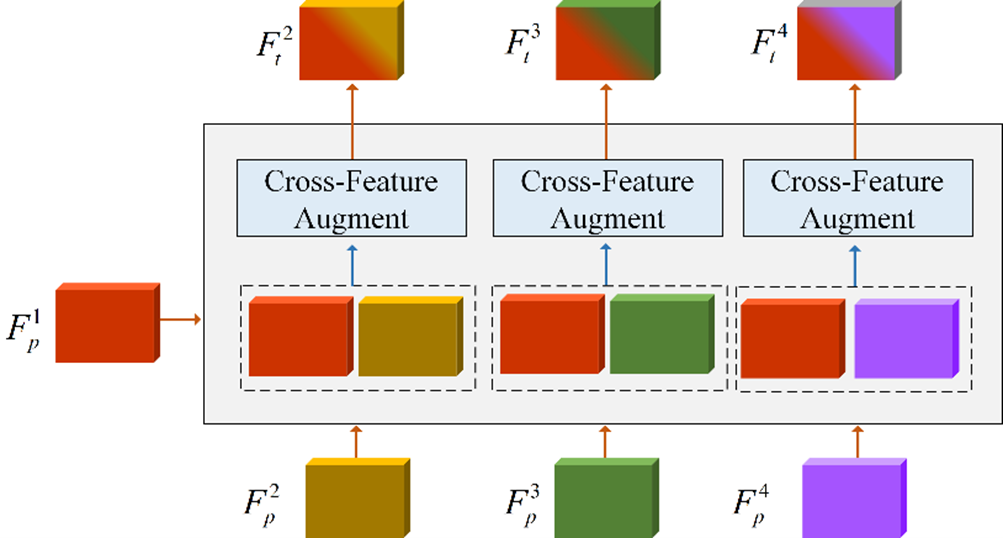

为了实现部件间的联合特征学习,本文设计了一个“领航员”(Navigator)指导的联合特征学习方法,首先对部件的鉴别力进行排序,令鉴别力最高的部件作为“领航员”(Navigator),其它部件在“领航员”的引领下进行学习。图3显示了本文上下文转换器的基本结构,特征学习是以成对的方式进行的, “领航员”中更有鉴别力的特征和部件自身所具有的补充信息相互融合以学习到更好的特征。

图3上下文转换器结构图

2.3 金字塔上下文集成块

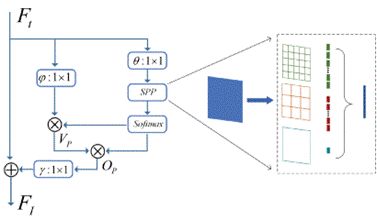

为了进一步提高细粒度识别的性能,需要通过一种有效的方法集成融合后的特征。非局部分块(Non-local Block, NLB)[20]等常见的融合操作能够有效地捕获长程依赖关系,能够在许多任务上实现对现有网络的改进。然而,NLB的计算量很大,且只考虑了输入特征图的空间相关性。为此,本文构造了一个金字塔上下文集成块 (Pyramid Context Integration Block, PCIB),引入了一种高效的非局部方法对全局上下文信息进行建模,它具有NLB捕获长程依赖关系的特性,且计算量更小,其结构如图4所示。

图4金字塔上下文块(PCB)的体系结构,其中SPP由一组空间金字塔池组成

03

实验结果及可视化

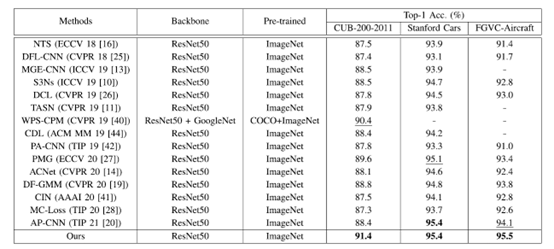

本文方法在CUB-200-2011、Stanford Cars和FGVC-Aircraft三个基准数据集上进行了实验验证。表1展示了本文提出的方法与近期方法在三个基准数据集上的结果比较,本文的方法在识别性能上均达到了最优。

表1 与近期方法在不同数据集中的比较

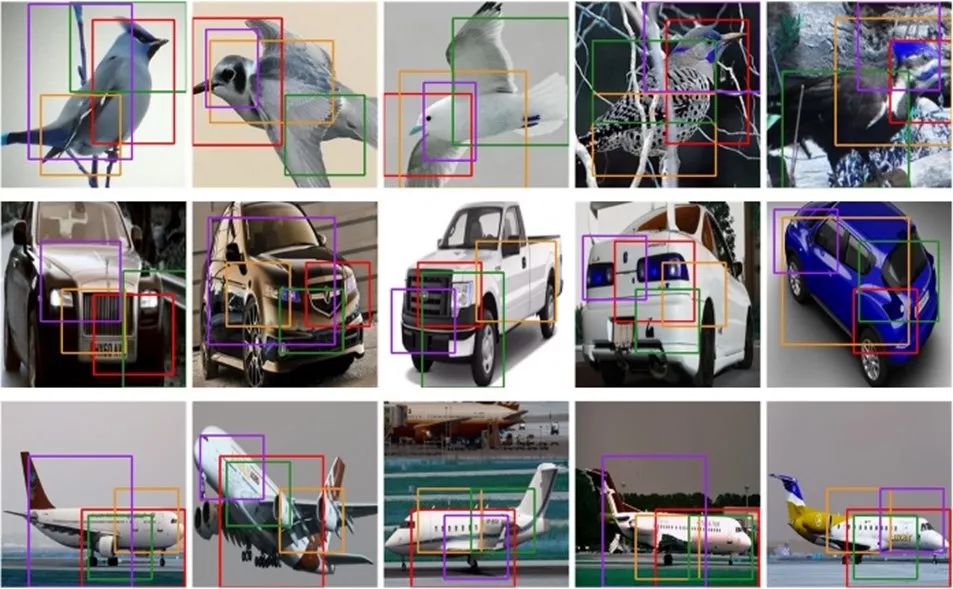

图5是对部件建议生成器(PPG)预测的前4个部件边界框的可视化,从图5第一行可以看出,即使在复杂的背景下,增强的部件建议生成器提取出的部件(矩形区域)仍覆盖了鸟类的大多数信息,尤其是头部和躯干这些被认为最具区分性的区域。与鸟类类似,Stanford Cars和FGVC-Aircraft上定位到的部件也与人类的感知一致(例如,汽车的灯和格栅,机翼和机头),部件建议生成器(PPG)能够有效地识别出具有强鉴别性的区域。

图5 不同数据集部件定位图

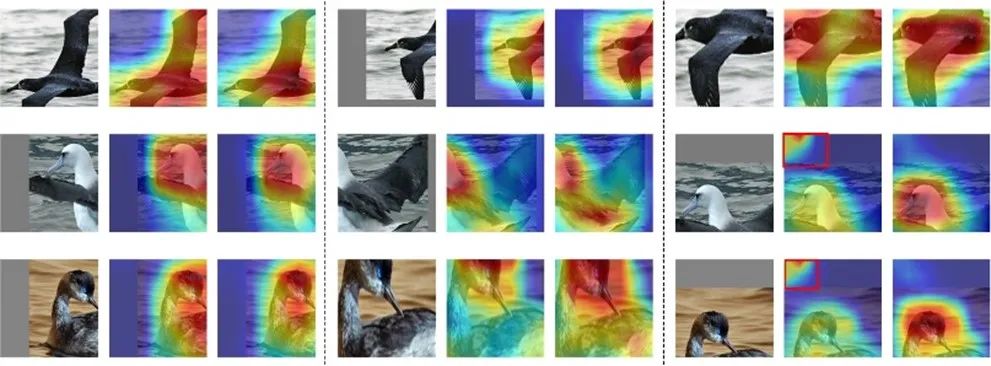

图6是上下文转换器之前和之后的特征图可视化对比。从图6中可以发现,经过上下文转换器后,更多的能量被分配到更有鉴别性的区域(鸟的头部、躯干等部位),并且有效减少了背景区域的干扰,如最右边二三行红色矩形所示的区域。

图6上下文转换器处理前后的特征能量分布可视化图

04

总结与展望

本文提出了一种用于细粒度图像分类的弱监督跨部件卷积神经网络模型(CP-CNN)。研究了不同部件之间的潜在相互作用,以应对FGIC任务中存在的类内差距大,类间差距小的挑战。

为了更好的定位到鉴别性强的部件,本文设计了一个增强的部件建议生成器(PPG)来进行部件定位;提出了上下文转换器(Context Transformer),在“领航员”的指导下进行联合特征学习;最后通过上下文集成块(PCIB)更好的集成融合后的特征。

在CUB-200-2011、Stanford Cars和FGVC-Aircraft上的评估表明,本文提出的方法具有优越的性能。在未来,该工作将考虑扩展到其它实际应用中,例如违禁物品检查、肺炎图像诊断等。

1761

1761

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?