诸神缄默不语-个人CSDN博文目录

诸神缄默不语的论文阅读笔记和分类

论文名称:How Much Knowledge Can You Pack Into the Parameters of a Language Model?

ArXiv网址:https://arxiv.org/abs/2002.08910

代码和模型权重:https://github.com/google-research/google-research/tree/master/t5_closed_book_qa

本文是2020年EMNLP论文,作者来自谷歌。

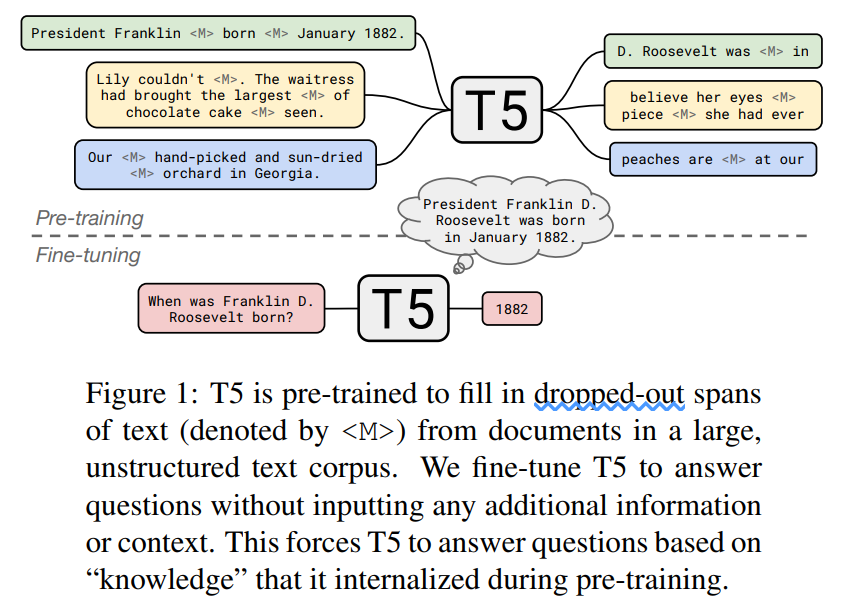

本文通过无上下文/外部知识的QA任务来度量LM中储存的知识信息。实验结果证明LM的表现非常好。

(但是这个T5也经过了各种疯狂微调捏)

预训练模型:T5(包括T5.1.1)

继续预训练:Salient Span Masking (SSM)

在度量知识的下游任务上微调:QA(用text2text的T5直接回答,不太需要考虑具体的回答格式)

解码方案是贪心算法

注意本文实验用的QA数据不在T5预训练数据中

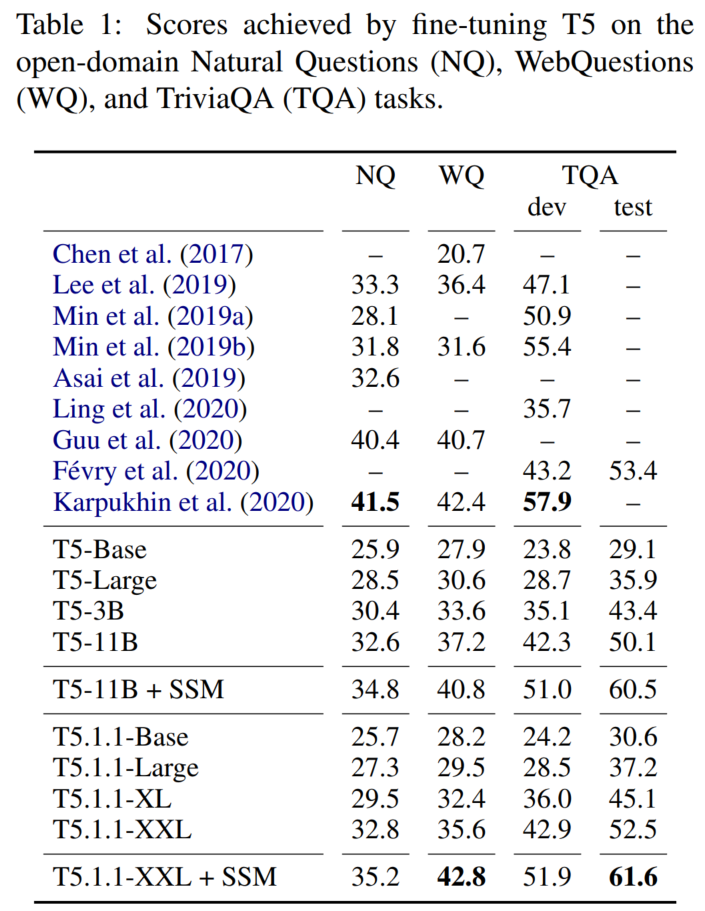

主实验结果:

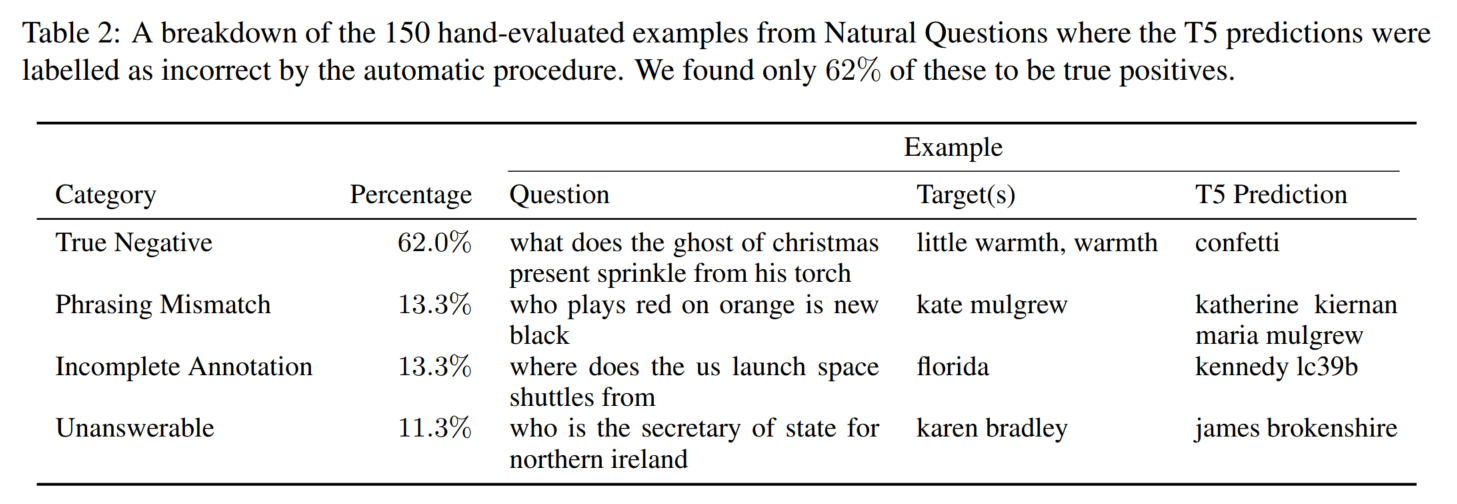

有些回答说起来也算答对了,但是不完全跟标准答案一样的FP情况:

这篇paper的未来展望部分写得非常细致,附录里面也写了很多详细的其它尝试工作,很敬业了。

2806

2806

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?