论文笔记整理:刘克欣,天津大学硕士

链接:https://dl.acm.org/doi/abs/10.1145/3475731.3484957

动机

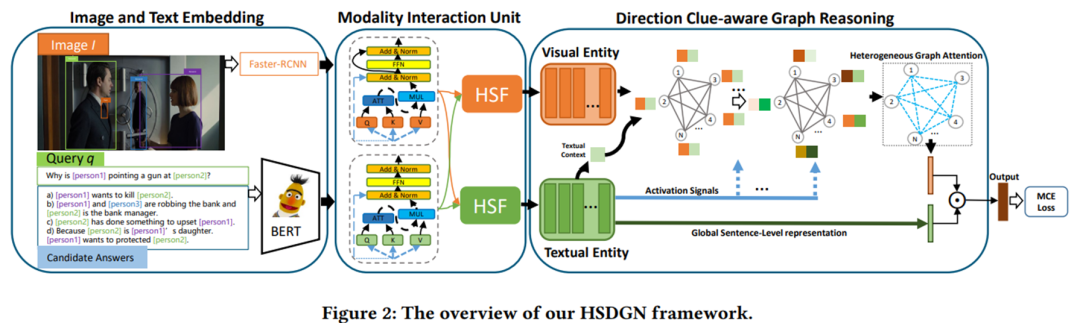

视觉常识推理(VCR)任务旨在促进认知水平相关推理的研究。现有的方法仅考虑了区域-词的相似性来实现视觉和语言域之间的语义对齐,忽略了视觉概念和语言词之间的隐式对应(如词-场景、区域-短语和短语-场景)。文章提出了一种层次语义增强方向图网络,设计了一个模态交互单元(MIU)模块,通过聚合层次视觉-语言关系来捕获高阶跨模态对齐。

亮点

文章的亮点主要包括:

1.提出了一种新颖的层次语义增强方向图网络(Hierarchical Semantic Enhanced Directional Graph Network, HSDGN)用于视觉常识推理任务,该网络能够捕获不同模式间的高阶相关性,并执行清晰的推理过程。;2.提出了一个HSF层,通过探索视觉概念和语言词之间的层次语义对应,更准确地捕捉跨模态语义对齐;3.设计了一个DCGR模块,该模块可以在每个推理步骤中根据实体的重要性动态选择有价值的实体,从而使推理过程更具可解释性。

概念及模型

文章提出的HSDGN包括三个部分:

•图像和文本嵌入模块:使用自上而下的注意力提取图像的区域级特征,是以哦那个预训练的BERT提取文本的单词级特征。•模态交互单元(Modality Interaction Unit, MIU)模块:包括模态内上下文建模层和层次语义融合(Hierarchical Semantic Fusion, HSF)层。通过聚合层次视觉-语言关系来捕获高阶跨模态对齐。•方向线索感知图推理(Direction Clue-aware Graph Reasoning , DCGR)模块:利用激活信号帮助执行有向图推理,然后利用异构图注意聚合演化的图表示以获得最终结果。

模型整体框架如下:

•图像和文本嵌入模块 对于每张图片

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

636

636

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?