线性回归从0实现

代码的实现需要这么几个过程。

- 数据

- 读入随机打乱的数据,然后要分epoch。

- 定义我们的模型,损失函数,优化算法

- 定义好超参数

- 开始 for epoch …这个过程需要根据超参数,predict pre_label,然后计算出损失的反向传播,根据优化算法去更新参数。

- 最后记得打印每次的loss,acc,auc等参数。

我们读取 ⼀小批量训练样本,并通过我们的模型来获得⼀组预测。 计算完损失后,我们开始反向传播,存储每个参数 的梯度。最后, 我们调⽤优化算法sgd来更新模型参数

构造数据

#随机生成一批数据 。y = Xw + b + ϵ. ϵ代表噪音值。

true_b = 4.2

true_w = torch.tensor([2,-3.4])

num_examples = 1000

def synthetic_data(w,b,num_examples):

X = torch.normal(0,1,(num_examples,len(w)))

y = torch.matmul(X,w)+b

y+= torch.normal(0,0.01,y.shape)

return X,y

features, labels = synthetic_data(true_w,true_b,num_examples)

labels.shape

#torch.Size([1000])

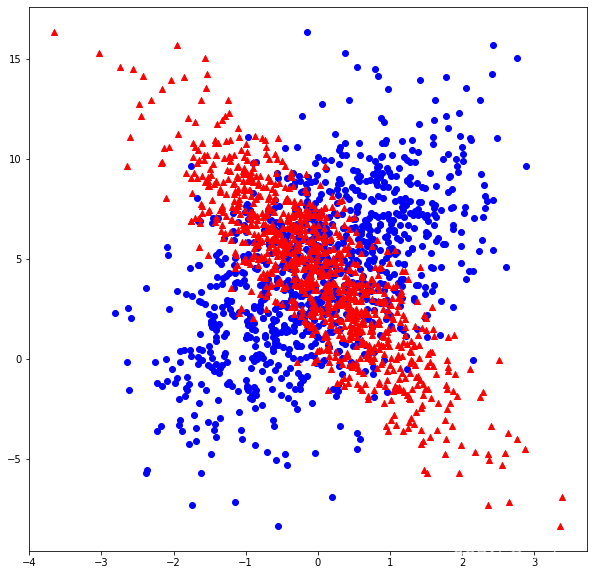

看一下构造的数据。

# 保证图片在浏览器内正常显示

%matplotlib inline

import matplotlib.pyplot as plt

plt.figure(figsize=(10,10))

plt.scatter(features[:,0],labels,marker='o',c='b')

plt.scatter(features[:,1],labels,marker='^',c='r')

plt.show()

定义数据随机读取函数:

特别注意yield字段。:yield 的函数在 Python 中被称之为 generator(生成器)

def data_iter(batch_size, features, labels):

num_examples = len(features)

indices = list(range(num_examples))

# 这些样本是随机读取的,没有特定的顺序

random.shuffle(indices)

for i in range(0, num_examples, batch_size):

batch_indices = torch.tensor(indices[i: min(i + batch_size, num_examples)])

#print(indices[i: min(i + batch_size, num_examples)])

yield features[batch_indices], labels[batch_indices]

import random

batch_size = 10

for X, y in data_iter(batch_size, features, labels):

print(X, '\n', y)

break

初始化超参数

batch_size = 10

lr = 0.03

num_epochs = 3

w = torch.normal(0, 0.01, size=(2,1), requires_grad=True)

b = torch.zeros(1, requires_grad=True)

定义模型

def linreg(X,w,b):

"""线性回归模型"""

return torch.matmul(X,w) + b

定义损失函数

def squared_loss(y_hat, y):#@save

"""均⽅损失。"""

return (y_hat - y.reshape(y_hat.shape)) ** 2 / 2

定义优化算法

def sgd(params,lr,batch_size):

#不track 梯度

with torch.no_grad():

for param in params:

param -= lr*param.grad / batch_size

param.grad.zero_()

train

net = linreg

loss = squared_loss

for epoch in range(num_epochs):

for X, y in data_iter(batch_size,features,labels):

l = loss(net(X,w,b),y)

l.sum().backward()

sgd([w,b],lr,batch_size)# 使用参数的梯度更新参数

with torch.no_grad():

train_l = loss(net(features,w,b),labels)

print(f'epoch {epoch + 1},loss {float(train_l.mean()):f}')

test

总结

pytorch backward

若在 torch 中 对定义的变量 requires_grad 的属性赋为 True ,那么此变量即可进行梯度以及导数的求解。

当c.backward() 语句执行后,会自动对 c 表达式中 的可求导变量进行方向导数的求解,并将对每个变量的导数表达存储到 变量名.grad 中

loss.sum().backward()中对于sum()的理解

一个向量是不进行backward操作的,而sum()后,由于梯度为1,所以对结果不产生影响。反向传播算法一定要是一个标量才能进行计算。

torch.no_grad()

是一个上下文管理器,被该语句 wrap 起来的部分将不会track 梯度

参考

线性回归的从零开始实现

pytorch backward() 的一点简单的理解

loss.sum().backward()中对于sum()的理解

with torch.no_grad() 详解

Python yield 使用浅析

1074

1074

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?