点击上方“3D视觉工坊”,选择“星标”

干货第一时间送达

来源丨泡泡机器人SLAM

作者丨泡泡图灵智库

作者:Irene Ballester, Alejandro Fontan, Javier Civera, Klaus H. Strobl , Rudolph Triebel

机构:University of Zaragoza ,German Aerospace Center ,Technical University of Munich

来源:2021 IEEE International Conference on Robotics and Automation (ICRA)

编辑:吕军宁

审核:Echo

摘要

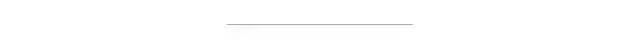

在本文中,我们介绍了DOT(动态对象跟踪),这是一种可以添加到现有的 SLAM 系统中的前端,可以显著提高其在高动态环境中的鲁棒性和准确性。DOT 将实例分割和多视图几何图形相结合,为动态对象生成掩码,以使基于刚性场景模型的 SLAM 系统在优化时避开这些图像区域。

为了确定哪些对象实际上在移动,DOT 首先对潜在动态对象实例进行分割,然后利用估计的相机运动,通过最小化光度重投影误差来跟踪这些对象。相比于其他方法,这种短期跟踪提高了分割的准确性。最后,只生成实际的动态掩码。我们在三个公共数据集中用 ORB-SLAM 2 评估了 DOT。结果表明,我们的方法显着提高了 ORB-SLAM 2 的准确性和鲁棒性,特别是在高度动态场景下。

方法

1.OVERVIEW

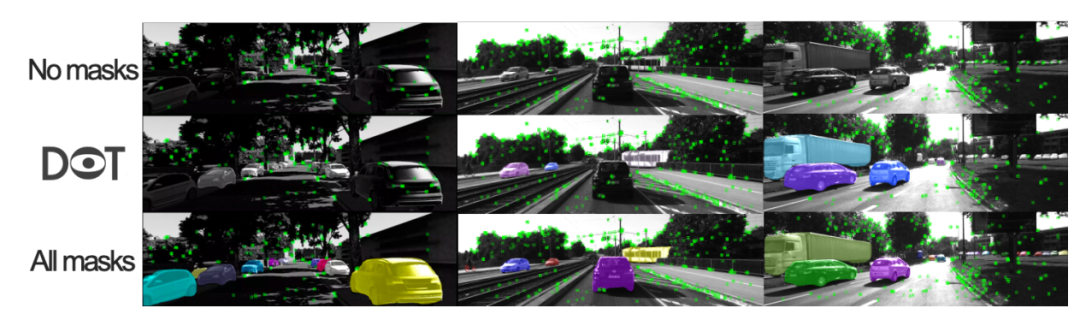

图 2:DOT

图 2 显示了 DOT 的概述。DOT 的输入是一定视频速率的RGB-D或双目图像,其输出是对场景静态和动态元素进行编码的掩码,可以直接被 SLAM 或里程计系统使用。

第一个部分(实例分割)对应于 CNN,它按像素分割出所有潜在的动态对象。在我们使用自动驾驶数据集进行的实验中,只有汽车被分割为潜在动态对象。后面会详细介绍,由于 DOT 逐帧跟踪掩码,因此不需要在每一帧都执行此操作。

图像处理块提取和分离图像静态区域的点和动态对象中的点。仅使用场景的静态部分计算相机位姿。从该部分中,考虑相机姿势,独立估计每个分割物体的运动(目标跟踪)。

下一个部分(物体是否在运动?)使用几何关系确定被网络标记为潜在动态对象的物体是否确实在移动。该信息用于更新编码每帧静态和动态区域的掩码,并为链接的里程计/ SLAM 视觉系统提供信息。

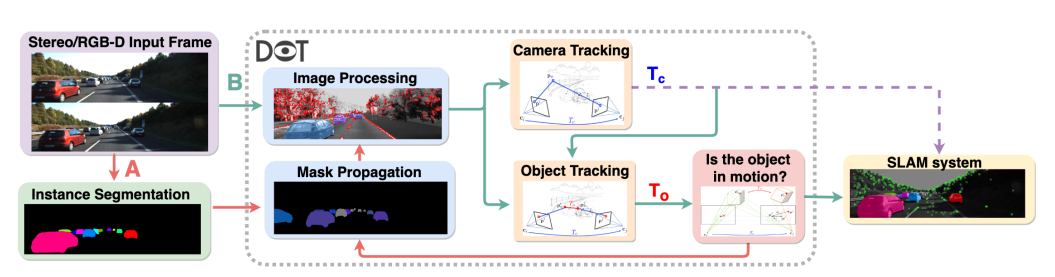

最后,DOT 根据物体的运动估计(掩码传播)生成新的掩码,因此并非每一帧都需要由网络进行分割(见图 3)。鉴于实例分割的大量计算负载,这可以成为DOT 相关优势相对于其他先进的方法。

图 3:上面一行显示了相机和物体的跟踪。请注意,并非所有帧都需要网络分割(黄色框)。下面一行显示了由 DOT 传播的对运动分类进行编码的掩码:运动(彩色)、静态(黑色)和尚未观察到(灰色)。

2.实例分割

我们使用深度网络 Detectron2 来分割图像中存在的所有潜在运动实例。输出被修改为在单张图像中的所有分割掩码。未被划分为潜在动态对象的图像区域被赋予“背景”标签,被认为是静态的。同时为了在多帧中跟踪对象,我们对 DOT 输出的掩码和由网络输出的掩码做了一个匹配操作。

3.相机位姿和运动物体的跟踪

我们分两步进行估算。首先我们找到相机的姿态,作为相对变换,然后减去它来估计物体运动

相机跟踪

通过最小化光度重投影误差来优化相机姿态

物体跟踪

一旦估计了 ,就可以通过使用属于此类对象的图像高梯度像素的子集来估计每个潜在动态物体的姿态,同时潜在动态物体建模为具有姿态的固体。(笔者理解:掩码传播的测量从得到)

通过最小化光度重投影误差来估计

4.物体是否在运动

该模块接收相机的变换矩阵和对象的变换矩阵作为输入,并估计对象是否在移动。由于图像噪声的传播,直接在中观察物体运动会导致难以建立确定物体是否在运动的绝对阈值。

我们将我们的指标表示为动态差异,即点的假设为静态的投影与其实际投影之间的距离(以像素为单位)。

同时,我们可以推导出物体运动估计的不确定性

其微分熵为

我们将动态差异与随熵平滑增长的可变阈值做比较。将所有动态视差超过此阈值的对象标记为“运动中”。对于低于熵阈值的每个值,我们假设无法观察到物体运动。

虽然选择最优的函数公式需要进一步研究,但该表达式满足要求,并在这项工作中显示出良好的效果

5.掩码传播

为了将同一3D对象来自不同帧的实例相关联,DOT 会重叠神经网络生成的掩码和通过多视图方程以及计算出的相机和对象姿势投影上一帧中的像素来传播的掩码。

评估

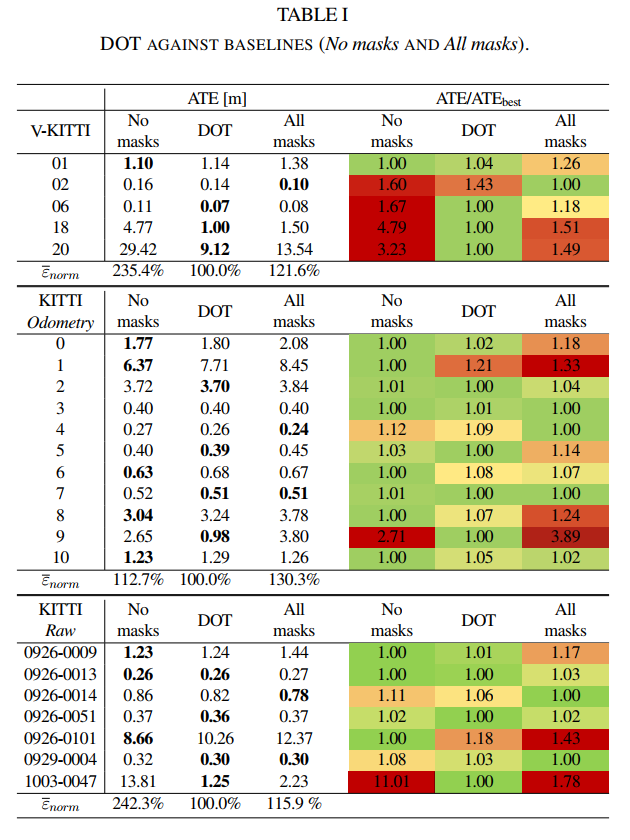

图 4:右侧ATE由每个序列中的最佳ATE归一化

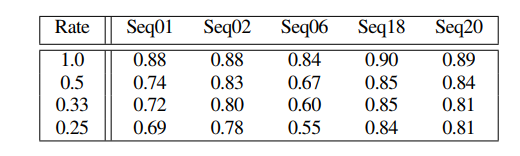

图 5:V-Kitti 数据集中不同分割率的 IOU

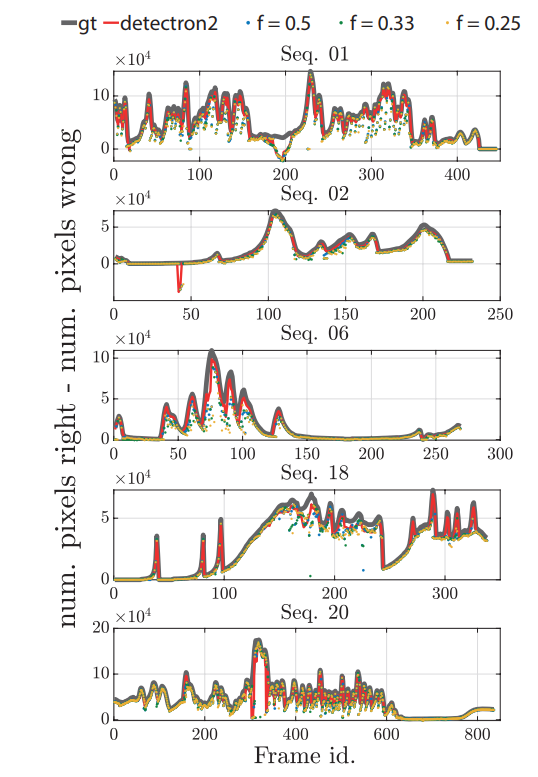

图 6:掩码传播。当 DOT 使用网络分割所有帧(红色)、50%(蓝色)、33%(黄色)和 25%(绿色)时,相对于V-KITTI真值,正确标记的像素数减去未标记的像素数。

总结

DOT 是一种用于 SLAM 系统的新型前端算法,它通过结合实例分割和多视图几何方程,可靠地检测和跟踪移动对象。我们在用于自动驾驶研究的三个公共数据集中对ORB-SLAM2进行了评估,表明DOT生成的物体运动信息使我们能够分割动态内容,从而显着提高其鲁棒性和准确性。

DOT 独立于 SLAM 使其成为一个多功能的前端,可以通过最少的集成工作适应任何最先进的视觉里程计或SLAM系统。与其他系统不同,DOT掩码跟踪降低了对实例分割速率的要求,从而降低了与现有技术相关的计算需求。

点击阅读原文,提取码: yqf8,即可获取本文下载链接。

本文仅做学术分享,如有侵权,请联系删文。

3D视觉精品课程推荐:

2.面向自动驾驶领域的3D点云目标检测全栈学习路线!(单模态+多模态/数据+代码)

3.彻底搞透视觉三维重建:原理剖析、代码讲解、及优化改进

4.国内首个面向工业级实战的点云处理课程

5.激光-视觉-IMU-GPS融合SLAM算法梳理和代码讲解

6.彻底搞懂视觉-惯性SLAM:基于VINS-Fusion正式开课啦

7.彻底搞懂基于LOAM框架的3D激光SLAM: 源码剖析到算法优化

8.彻底剖析室内、室外激光SLAM关键算法原理、代码和实战(cartographer+LOAM +LIO-SAM)

重磅!3DCVer-学术论文写作投稿 交流群已成立

扫码添加小助手微信,可申请加入3D视觉工坊-学术论文写作与投稿 微信交流群,旨在交流顶会、顶刊、SCI、EI等写作与投稿事宜。

同时也可申请加入我们的细分方向交流群,目前主要有3D视觉、CV&深度学习、SLAM、三维重建、点云后处理、自动驾驶、多传感器融合、CV入门、三维测量、VR/AR、3D人脸识别、医疗影像、缺陷检测、行人重识别、目标跟踪、视觉产品落地、视觉竞赛、车牌识别、硬件选型、学术交流、求职交流、ORB-SLAM系列源码交流、深度估计等微信群。

一定要备注:研究方向+学校/公司+昵称,例如:”3D视觉 + 上海交大 + 静静“。请按照格式备注,可快速被通过且邀请进群。原创投稿也请联系。

▲长按加微信群或投稿

▲长按关注公众号

3D视觉从入门到精通知识星球:针对3D视觉领域的视频课程(三维重建系列、三维点云系列、结构光系列、手眼标定、相机标定、激光/视觉SLAM、自动驾驶等)、知识点汇总、入门进阶学习路线、最新paper分享、疑问解答五个方面进行深耕,更有各类大厂的算法工程人员进行技术指导。与此同时,星球将联合知名企业发布3D视觉相关算法开发岗位以及项目对接信息,打造成集技术与就业为一体的铁杆粉丝聚集区,近4000星球成员为创造更好的AI世界共同进步,知识星球入口:

学习3D视觉核心技术,扫描查看介绍,3天内无条件退款

圈里有高质量教程资料、可答疑解惑、助你高效解决问题

觉得有用,麻烦给个赞和在看~

1249

1249

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?