1. LSTM (Long Short-Term Memory)

| 代码获取戳此:LSTM、CNN-LSTM、BILSTM、BILSTM-Adaboost、CNN-BILSTM等 |

介绍:

LSTM是一种特殊的循环神经网络(RNN),能够捕捉序列数据中的长期依赖关系。它通过引入门控机制(如输入门、遗忘门和输出门)来控制信息的传递和更新。

优劣:

优点:能够处理长期依赖问题,适用于时间序列预测、文本生成等任务。

缺点:计算量大,参数较多,可能导致过拟合。

2. CNN-LSTM

介绍:

CNN-LSTM模型结合了卷积神经网络(CNN)和LSTM。CNN用于提取数据的局部特征,而LSTM则用于捕捉这些特征之间的长期依赖关系。

优劣:

优点:结合了CNN和LSTM的优点,能够同时处理局部特征和长期依赖关系。

缺点:模型复杂度高,训练难度大,需要较大的计算资源。

3. BiLSTM (Bidirectional LSTM)

介绍:

BiLSTM是双向的LSTM,它能够同时捕捉序列数据中的前向和后向信息。这意味着在任意时间步,BiLSTM都可以看到过去和未来的信息。

优劣:

优点:能够捕捉双向的上下文信息,提高模型的性能。

缺点:相比LSTM,计算量更大,参数更多。

4. BiLSTM-Adaboost

介绍:

BiLSTM-Adaboost结合了BiLSTM和Adaboost算法。Adaboost是一种集成学习方法,通过训练多个弱分类器并将其组合成一个强分类器来提高模型的性能。

优劣:

优点:结合了BiLSTM和Adaboost的优点,能够进一步提高模型的预测准确性和稳定性。

缺点:需要训练多个模型,计算量大,且可能受到Adaboost中弱分类器数量的影响。

5. CNN-BiLSTM

介绍:

CNN-BiLSTM模型结合了CNN和BiLSTM。CNN用于提取数据的局部特征,而BiLSTM则用于捕捉这些特征之间的双向依赖关系。

优劣:

优点:结合了CNN和BiLSTM的优点,能够同时处理局部特征和双向依赖关系。

缺点:模型复杂度较高,训练难度大,需要较大的计算资源。

6. CNN-BiLSTM-Adaboost

介绍:

CNN-BiLSTM-Adaboost模型结合了CNN、BiLSTM和Adaboost。它首先使用CNN提取数据的局部特征,然后使用BiLSTM捕捉这些特征之间的双向依赖关系,最后使用Adaboost算法将多个模型的预测结果进行集成。

优劣:

优点:结合了三种技术的优点,能够显著提高模型的预测准确性和稳定性。

缺点:模型复杂度非常高,训练难度大,计算资源消耗大。此外,需要仔细调整各种参数以获得最佳性能。

7. CNN-BiLSTM-Attention

介绍:

CNN-BiLSTM-Attention模型在CNN-BiLSTM的基础上引入了注意力机制。注意力机制允许模型在预测时关注输入序列中的重要部分。

优劣:

优点:通过引入注意力机制,模型能够更准确地捕捉输入序列中的关键信息,提高预测的准确性。

缺点:增加了模型的复杂性,可能导致训练难度和计算成本增加。此外,注意力机制的设计和实现需要仔细考虑以避免引入不必要的噪声或偏见。

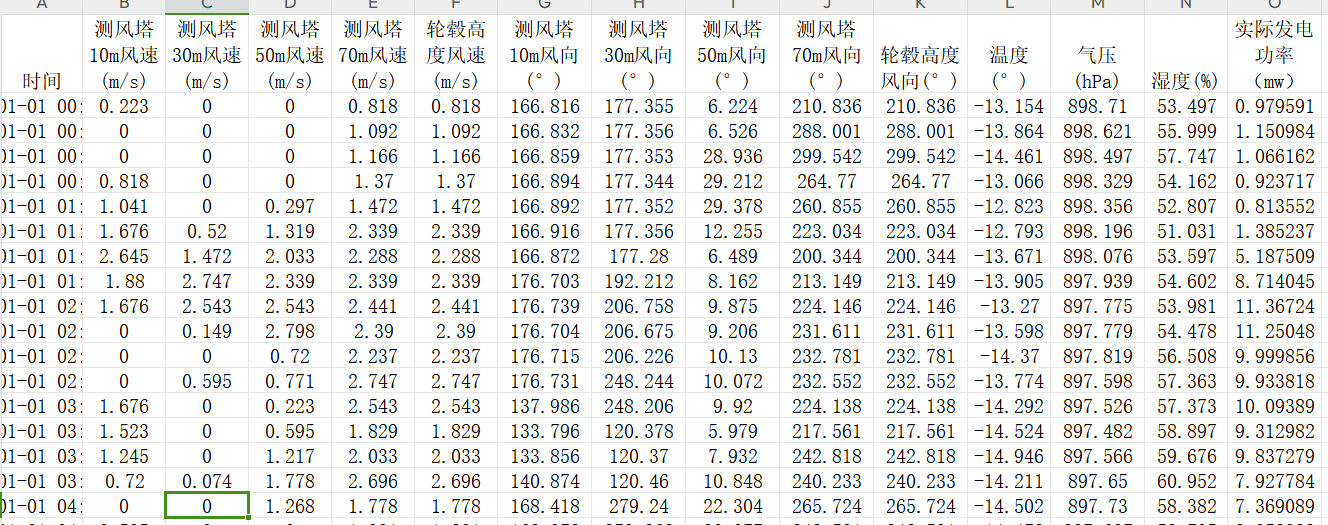

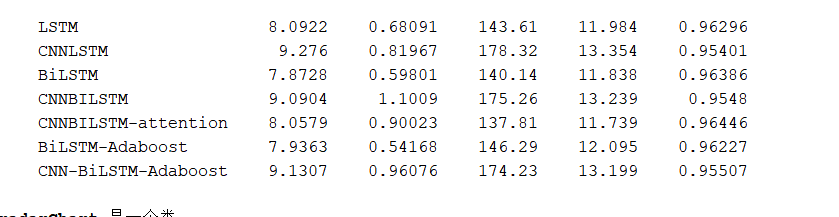

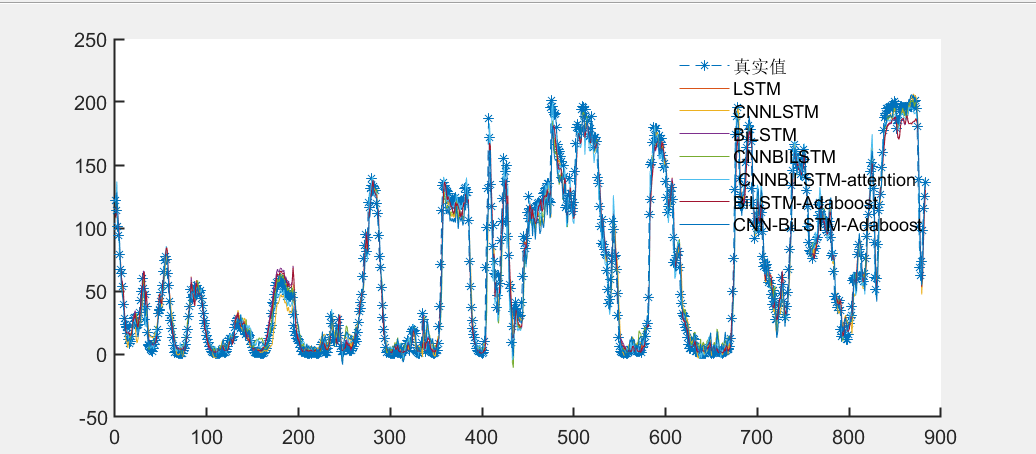

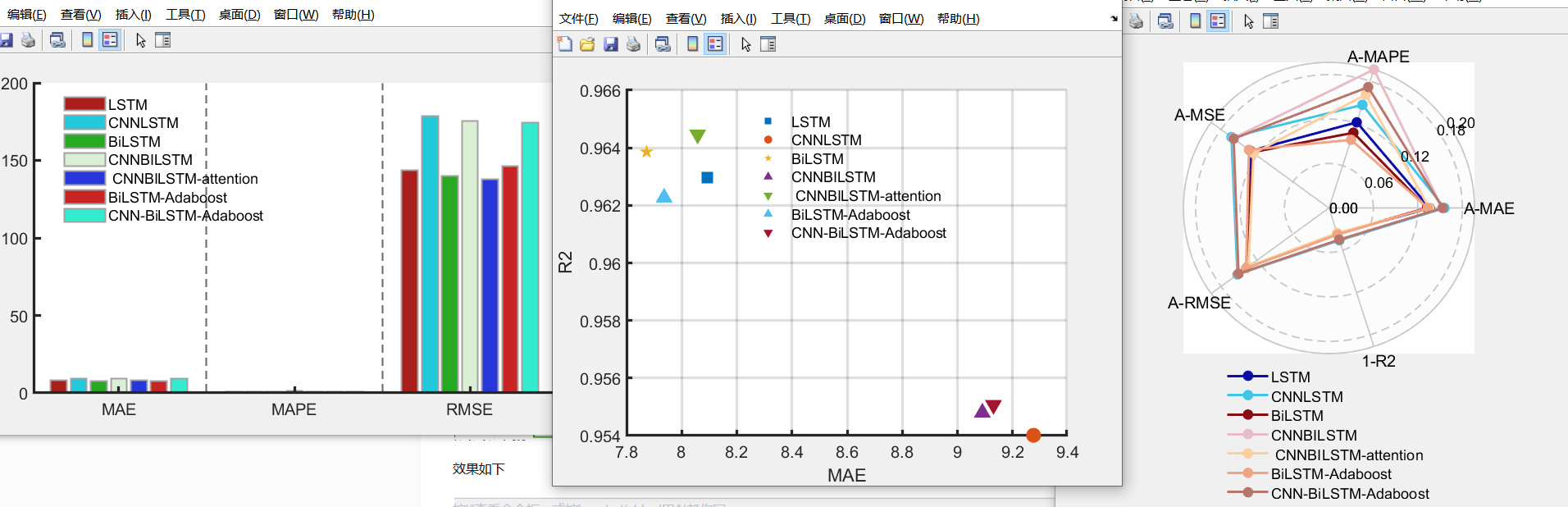

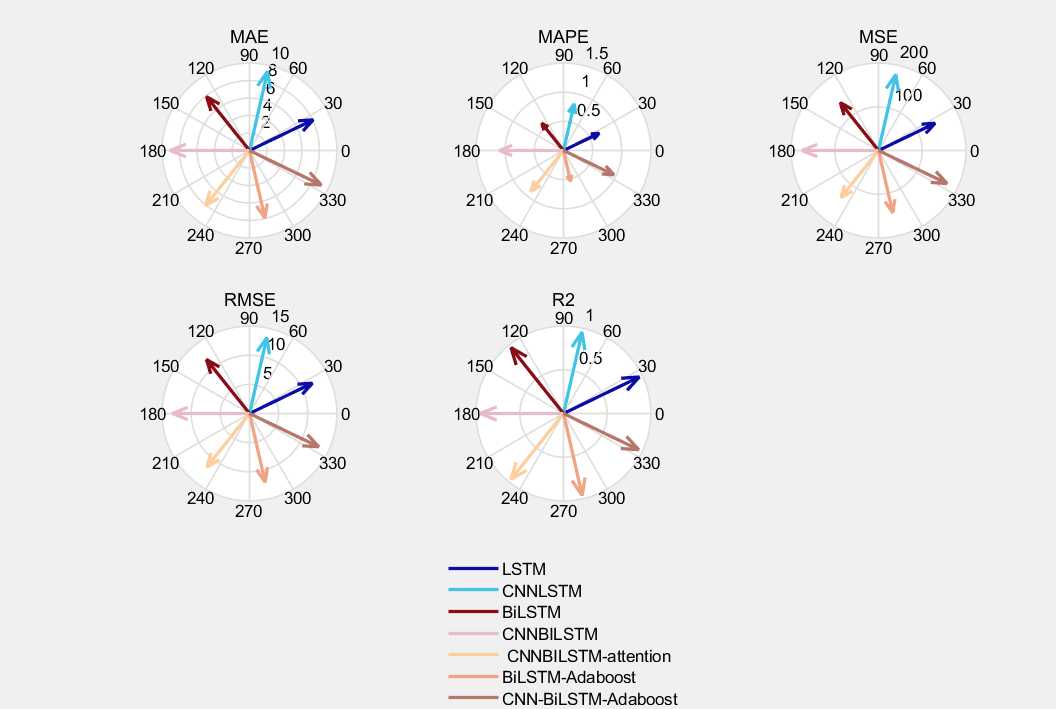

基于风电数据集进行预测效果对比

效果如下

215

215

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?