内存访问成本(Memory Access Cost, MAC)是衡量深度学习模型效率的关键指标,直接影响模型在硬件上的推理速度和资源消耗。以下从定义、影响因素、优化方法及实际应用四个维度展开分析:

一、MAC的定义与计算

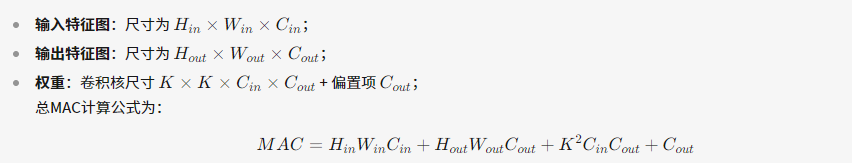

MAC指模型在推理过程中从内存读取和写入数据的总开销,包括输入特征图、输出特征图及权重的访问次数。以卷积层为例:

例如,输入224×224×3的卷积层与32个3×3卷积核运算时,MAC高达约4375万次。

二、MAC对模型速度的关键影响

-

硬件瓶颈效应

内存访问速度远低于计算速度,尤其在大模型中,MAC可能成为性能瓶颈。例如,EfficientNet的FLOPs虽低于ResNet50,但因深度可分离卷积的高MAC特性,实际推理速度反而更慢。 -

并行度与数据依赖

多分支结构(如Inception)会引入数据依赖,降低GPU并行度,增加同步开销。例如,残差网络(ResNet)的

订阅专栏 解锁全文

订阅专栏 解锁全文

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?