前言

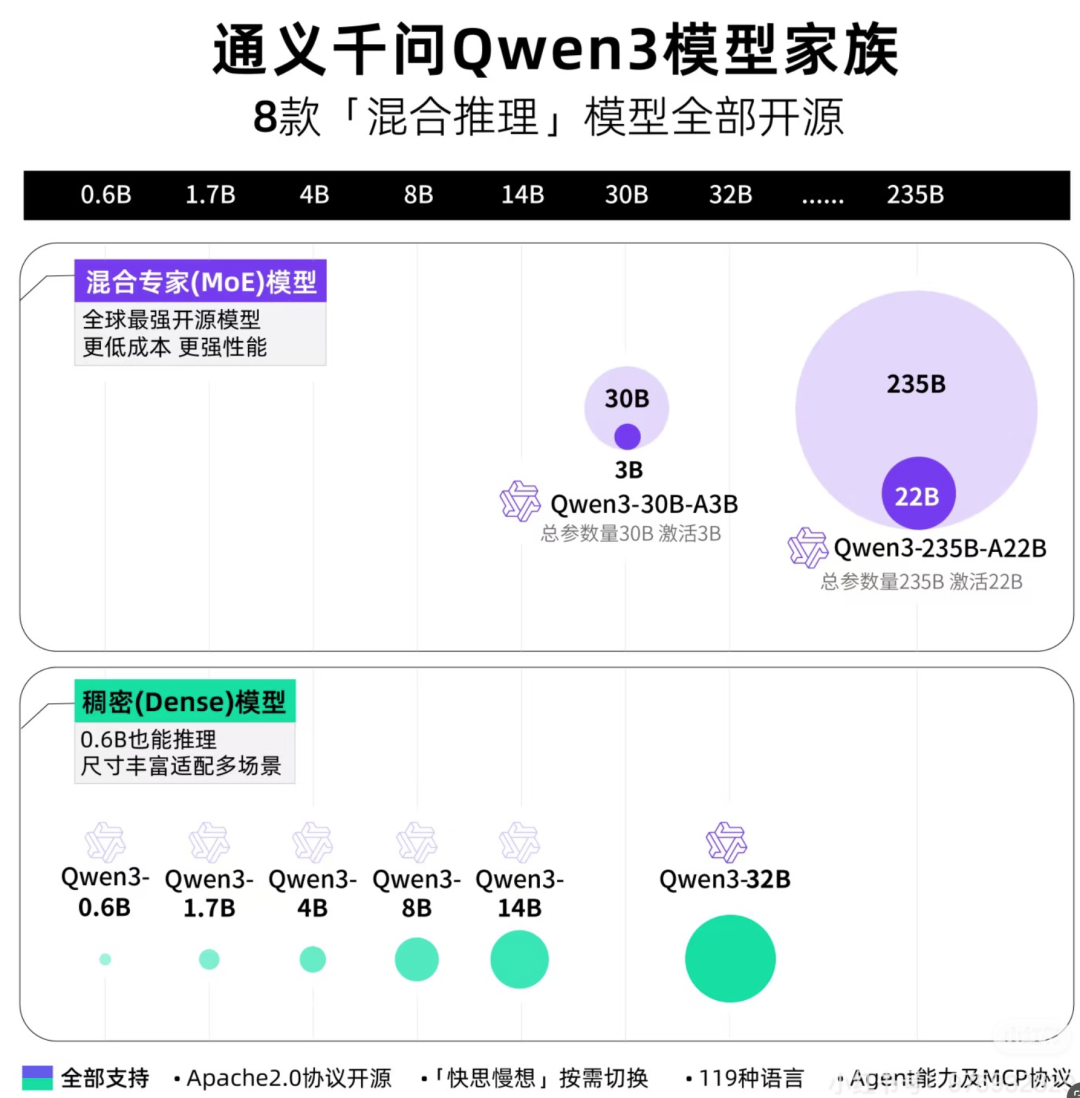

开源 8 款模型:6 款 Dense 模型 +2 款 MoE 模型

技术细节大家可以看看 Qwen 技术博客,建议点开看看,干货很多:https://qwenlm.github.io/blog/qwen3/

8 个不同尺寸的模型,照顾到了所有场景:

6 款 Dense 模型:

0.6B、1.7B、4B、8B、14B、32B

2 款 MoE 模型:

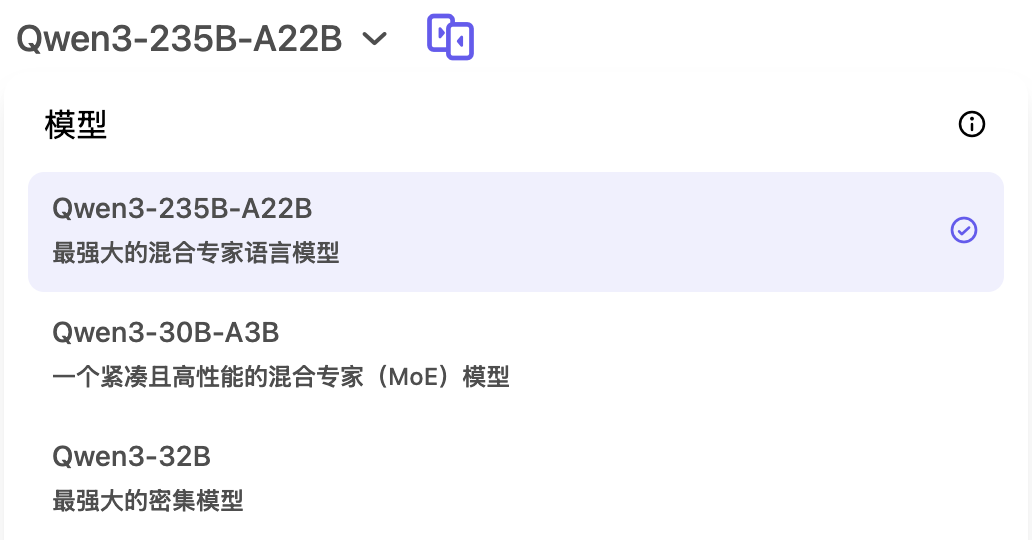

Qwen3-235B-A22B (MoE, 总大小 235B, 激活参数 22B, 上下文 128K)

Qwen3-30B-A3B (MoE, 总大小 30B, 激活参数 3B, 上下文 128K)

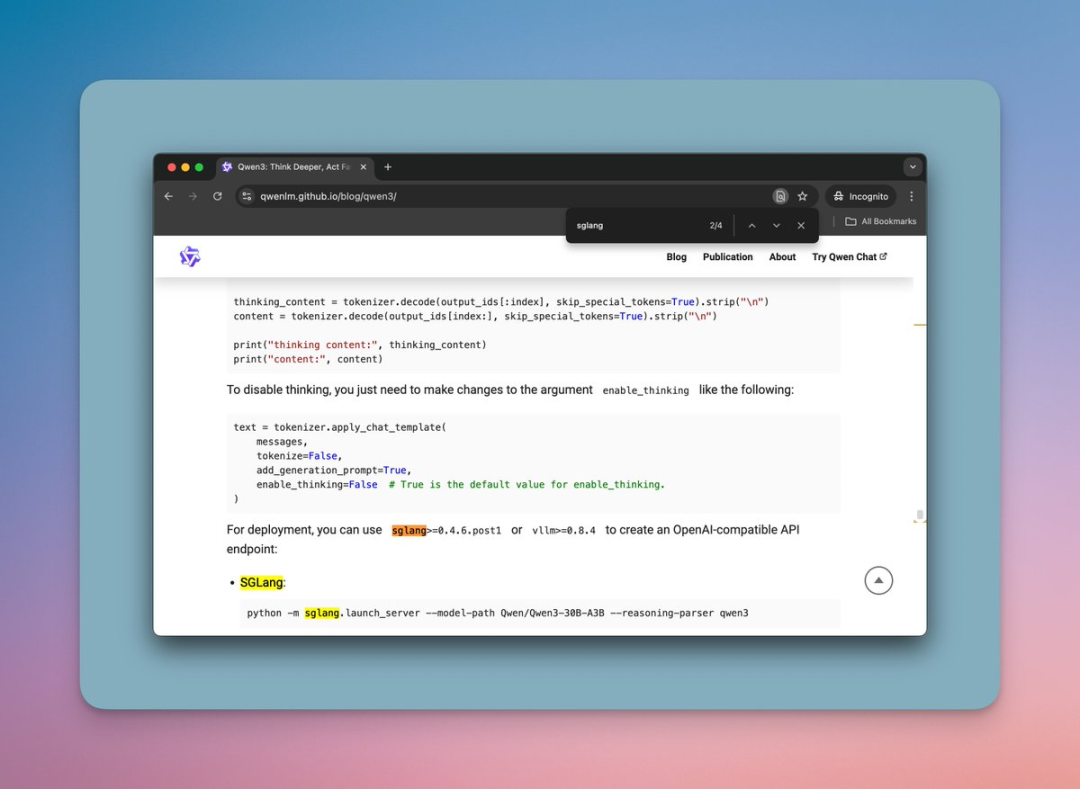

混合思维模式,搭载了 thinking 开关,可以直接手动控制要不要开启 thinking

最大的这个 Qwen3-235B-A22B 在强劲性能的基础上,部署成本仅为 Deepseek R1 的 35%。

Qwen3-30B-A3B 的激活参数只有 3B,性能却可以跟 QWQ-32B 打平,成本只有 10%,可以在消费级显卡上部署。

0.6B 的小参数模型适合在移动设备上部署。

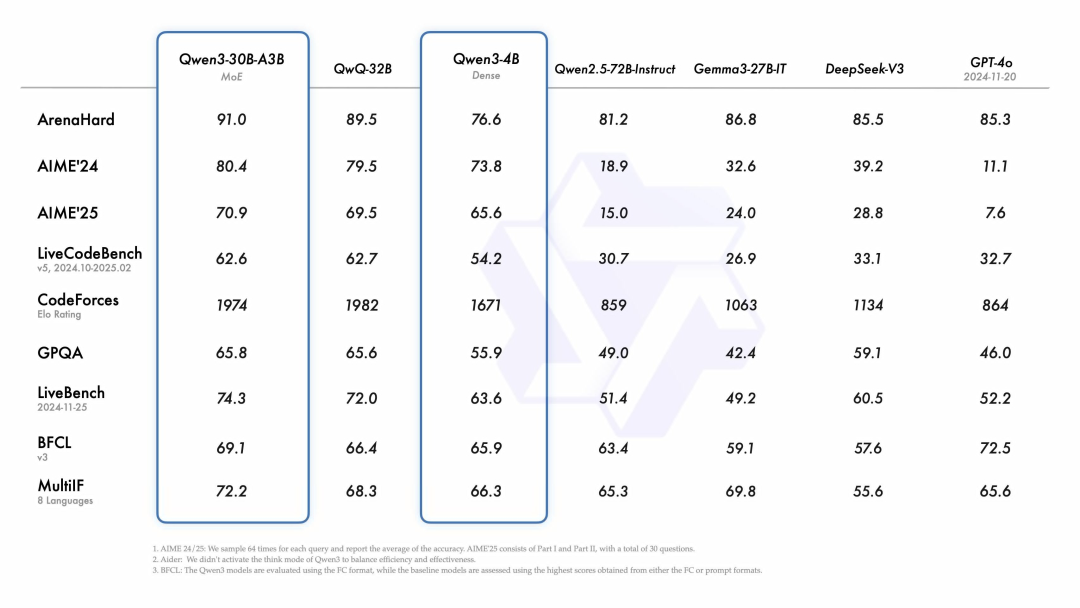

在性能上 Qwen 3 的每个尺寸得分都是同尺寸开源最强。

Qwen3-235B-A22B 在代码、数学、通用能力等基准测试中,与 DeepSeek-R1、o1、o3-mini、Grok-3 和 Gemini-2.5-Pro 相比,表现出极具竞争力的结果。

此外,小型 MoE 模型 Qwen3-30B-A3B 的激活参数数量是 QwQ-32B 的 10%,表现更胜一筹

正如博客所说,Qwen 朋友圈非常强大,昨晚已发布,一众伙伴就 0day 级支持

你可以在 Qwen 官网直接与 Qwen3v 不同参数模型直接对话:https://chat.qwen.ai/

本地部署

ollama

模型页:https://ollama.com/library/qwen3

运行:ollama run qwen3

其他尺寸,在后面加参数即可,比如:ollama run qwen3:32b

可以在提示词后输入 /no_think 来切换 Ollama 中的无思考模式。

备注⚠️:ollama 运行的是量化版,效果有折扣

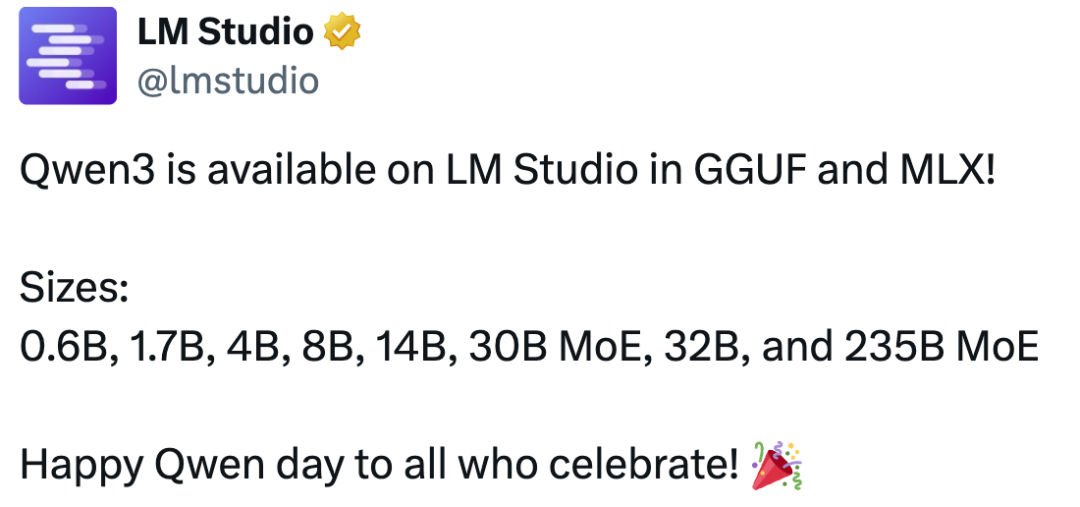

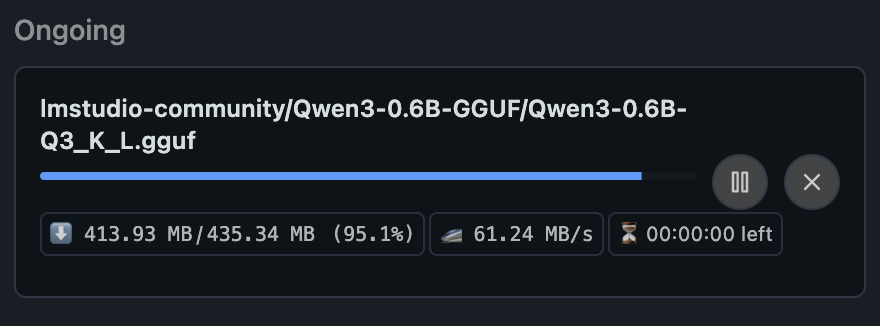

LM Studio

地址:https://lmstudio.ai/

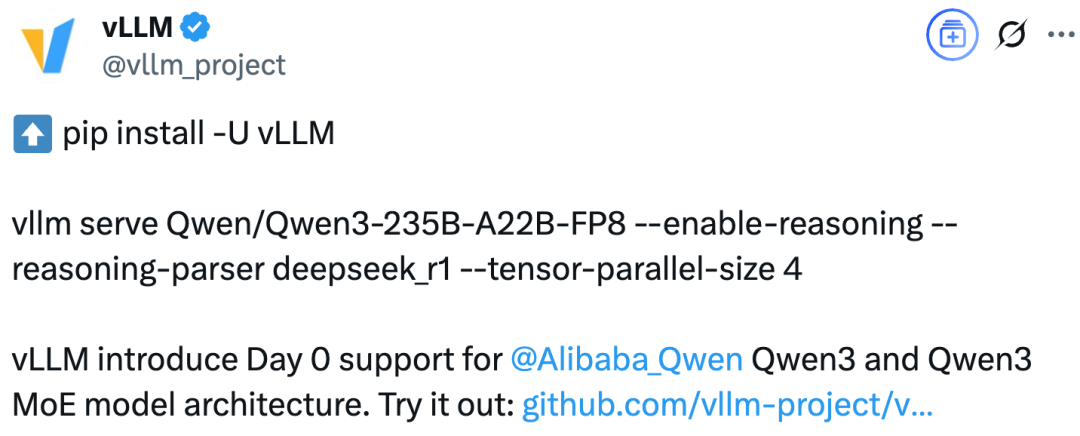

vLLM

需要升级到 v0.8.4 以上,最好 v0.8.5

地址:https://github.com/vllm-project/vllm/issues/17327

vllm serve Qwen/Qwen3-235B-A22B-FP8 --enable-reasoning --reasoning-parser deepseek_r1 --tensor-parallel-size 4

SGLang

需要升级到SGLang 0.4.6.post1

地址:https://github.com/sgl-project/sglang

pip3 install "sglang[all]>=0.4.6.post1"

python3 -m sglang.launch_server --model Qwen/Qwen3-235B-A22B --tp 8 --reasoning-parser qwen3

python3 -m sglang.launch_server --model Qwen/Qwen3-235B-A22B-FP8 --tp 4 --reasoning-parser qwen3

CPU 部署

llama.cpp

可以用 llama.cpp 运行起 Qwen3 量化版本、动态量化版本!

地址:https://huggingface.co/collections/unsloth/qwen3-680edabfb790c8c34a242f95

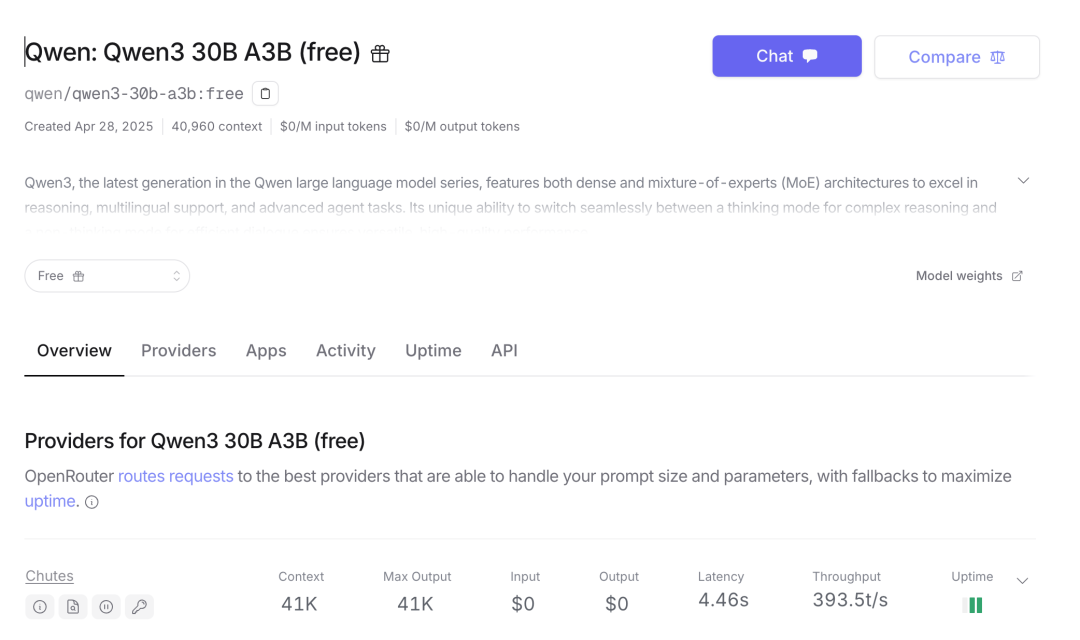

OpenRouterAI

openrouter 提供了免费的 API

地址:https://openrouter.ai/models?order=newest&q=qwen3

KTransformer

Xeon 铂金 4 代 + 4090 运行 Qwen3-235B-A22B 单个请求可以达到 13.8 token/s, 4 个请求并行可以达到总计 24.4 token/s

地址:http://github.com/kvcache-ai/ktransformers/blob/main/doc/en/AMX.md

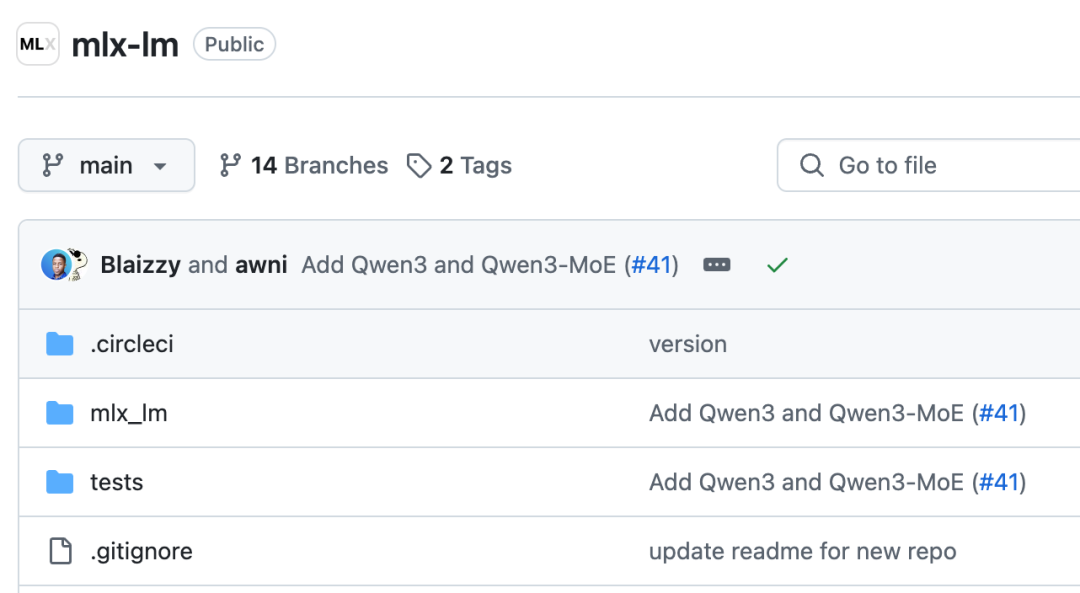

Mac

Mac 上也可以跑 Qwen3 了

地址:https://github.com/ml-explore/mlx-lm/commit/5c2c18d6a3ea5f62c5b6ae7dda5cd9db9e8dab16

pip install -U mlx-lm

# or

conda install -c conda-forge mlx-lm

支持设备

- iPhone: 0.6B, 4B

- Macbook: 8B, 30B, 3B/30B MoE

- M2, M3 Ultra: 22B/235B MoE

Qwen3 优点还有很多,我正在下载,随后再发本地部署后的测试情况:

- Qwen3 是全球最强开源模型,性能全面超越 DeepSeek R1,国内第一个敢说全面超越 R1 的模型,之前都是比肩

- Qwen3 是国内首个混合推理模型,复杂答案深度思考,简单答案直接秒回,自动切换,提升智力 + 节省算力双向奔赴

- 模型部署要求大幅降低,旗舰模型仅需 4 张 H20 就能本地部署,部署成本估算下来是能比 R1 下降超 6 成

- Agent 能力大幅提升,原生支持 MCP 协议,提升了代码能力,国内的 Agent 工具都在等它

- 支持 119 种语言和方言,包括爪哇语、海地语等地方性语言,全世界都可以用上 AI

- 训练数据 36 万亿 token,相比 Qwen2.5 直接翻倍,不仅从网络抓取内容,还大量提取 PDF 的内容、大量合成代码片段

- 模型部署要求大幅降低,旗舰模型仅需 4 张 H20 就能本地部署,是 R1 的三分之一

最后的最后

感谢你们的阅读和喜欢,作为一位在一线互联网行业奋斗多年的老兵,我深知在这个瞬息万变的技术领域中,持续学习和进步的重要性。

为了帮助更多热爱技术、渴望成长的朋友,我特别整理了一份涵盖大模型领域的宝贵资料集。

这些资料不仅是我多年积累的心血结晶,也是我在行业一线实战经验的总结。

这些学习资料不仅深入浅出,而且非常实用,让大家系统而高效地掌握AI大模型的各个知识点。如果你愿意花时间沉下心来学习,相信它们一定能为你提供实质性的帮助。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

大模型知识脑图

为了成为更好的 AI大模型 开发者,这里为大家提供了总的路线图。它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

经典书籍阅读

阅读AI大模型经典书籍可以帮助读者提高技术水平,开拓视野,掌握核心技术,提高解决问题的能力,同时也可以借鉴他人的经验。对于想要深入学习AI大模型开发的读者来说,阅读经典书籍是非常有必要的。

实战案例

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

面试资料

我们学习AI大模型必然是想找到高薪的工作,下面这些面试题都是总结当前最新、最热、最高频的面试题,并且每道题都有详细的答案,面试前刷完这套面试题资料,小小offer,不在话下

640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

644

644

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?