在全球人工智能模型快速发展的浪潮中,DeepSeek-V3和Qwen 2.5系列的亮相为开源模型注入了新的活力。这两大模型通过技术创新和高效优化,成功将训练成本和资源消耗降至最低,同时实现了与闭源顶级模型相媲美的性能。

DeepSeek-V3技术报告

报告内容详见:

https://wcn4il2c5x2d.feishu.cn/wiki/G28mwxSAsis8Zykfyqbcsdzenbf

DeepSeek-V3模型–一个100%开源的LLM,在许多基准上击败了GPT 4o和Claude 3.5 Sonnet;一个强大的混合专家(MoE)语言模型,总参数为671B,每个token激活了37B。DeepSeek团队在HuggingFace上共享了模型,并在他们的“DeepSeek-V3技术报告”中提供了有关模型的详细信息。

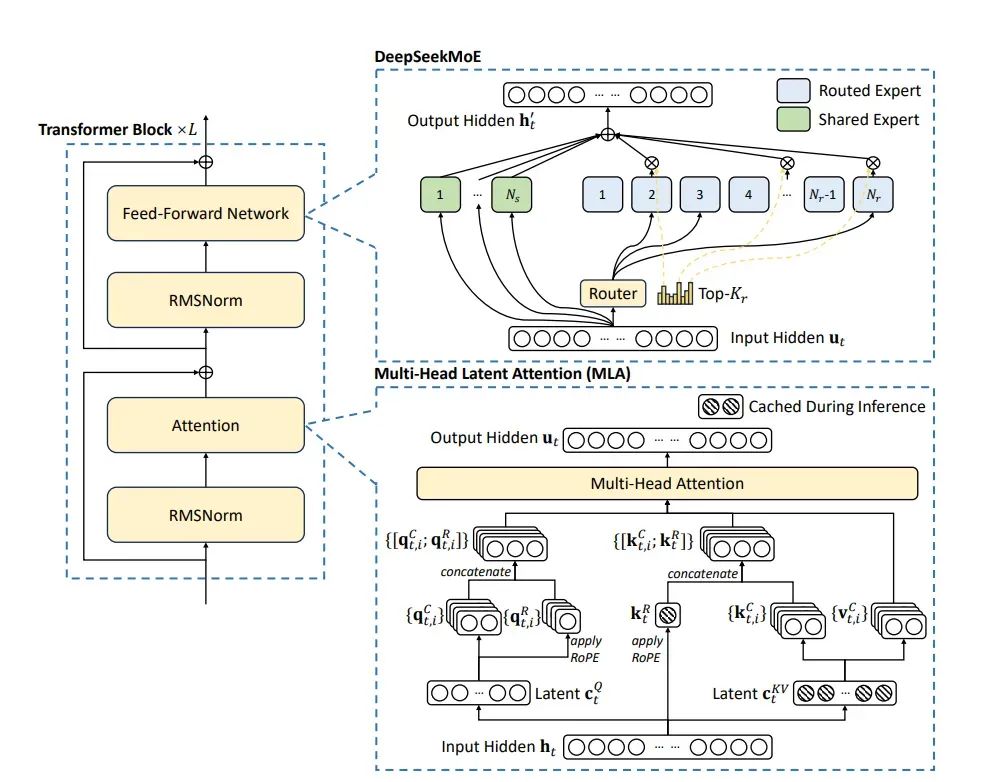

DeepSeek MoE架构是一个精细的MoE,每个token有1个共享专家和256个路由专家,8个活跃路由专家。该架构还包括多头潜在注意力,具有低等级联合压缩,用于关注键和值。它还具有多token预测,有助于投机解码和更好地利用训练数据。

Deepseek-V3使用14.8万亿个token进行训练,使用了2788K H800 GPU小时,成本仅为560万美元。DeepSeek-V3的这种具有成本效益的训练是由于精细的MoE架构,在训练中使用FP8混合精度,以及在训练期间调整和扩展上下文长度。

他们通过算法-框架-硬件共同设计克服了大型MoE模型训练中的通信瓶颈,实现了在训练中有效使用计算。两阶段的上下文长度扩展首先将上下文从4k令牌扩展到32k令牌,然后扩展到128k令牌。与Llama、Claude和类似的人工智能模型相比,这些优化的综合结果是训练效率极高,成本降低了10倍。

训练后使用SFT和RL来与人类的偏好保持一致,并提炼DeepSeek-R1推理能力,他们的推理模型,这增强了其推理和数学能力。多令牌预测(MTP)可用于增强模型性能,并实现推理加速的投机解码。

DeepSeek-V3对MoE LLM的基准非常令人印象深刻,只有37B个活动参数:MMLU上88.5,GPQA上59.1,MMLU-Pro上75.9,MATH上90.2,CodeForces上51.6等。DeepSeek-V3是目前最强的开源模型,其性能可与GPT-4o和Claude-3.5-Sonnet等领先的闭源模型相媲美。

Qwen2.5技术报告

报告内容详见:

https://wcn4il2c5x2d.feishu.cn/wiki/PwpEwDPdMiJetPkaKY9cK4XFnOg

Qwen 2.5系列LLM于9月发布,从那时起,阿里巴巴Qwen团队发布了有用的更新,包括Qwen-2.5编码器32B模型,扩展了100万个令牌上下文支持,以及基于Qwen 32B的推理人工智能模型Qwen QwQ。本周,他们发布了QvQ,这是一个基于Qwen2-VL-72B的视觉推理模型。这一系列版本使Qwen成为领先的LLM家族,拥有一些用于编码、推理和本地使用的最佳人工智能模型。

阿里巴巴Qwen团队发布了Qwen2.5技术报告,以提供有关该开放式权重系列LLM的更多详细信息。Qwen2.5系列由几个开放式权重基础和指令调整模型组成,参数范围从0.5B到72B。此外,还有两种专有的混合专家(MoE)型号,Qwen2.5-Turbo和Qwen2.5-Plus。开放式Qwen2.5-72B-Instruct的性能可与Llama-3-405B-Instruct相媲美。

一些关键功能&以前版本的对比

Qwen2.5 LLMs维护基于变压器的解码器架构,利用分组查询注意力(GQA)、SwiGLU激活、旋转位置嵌入(RoPE)、QKV偏置和RMSNorm。令牌化采用字节级字节对编码(BBPE),并具有扩展的控制令牌集。

Qwen团队将训练前数据集扩展到18万亿个代币,纳入了更多样和高质量的数据。预培训包括复杂的数据过滤、专注于知识、代码和数学的战略数据混合以及长上下文培训。

对于训练后,他们使用了超过100万个样本的复杂监督微调(SFT),并结合了多阶段强化学习(DPO,然后是GRPO)。两阶段强化学习涉及用于复杂推理的离线学习和用于细微差别输出质量的在线学习。

这些模型利用YARN和Dual Chunk Attention(DCA)来延长上下文长度,Qwen2.5-Turbo高达100万个代币。

训练的这些进步导致了更好的人类偏好调整,增强了长文本生成,并改善了结构化数据分析。

评估展示了在语言理解、数学、编码和人类偏好调整方面的顶级表现,该报告还强调了Qwen2.5的长上下文能力。例如,Qwen2.5-Turbo在1M令牌密码检索任务中实现了100%的准确率。Qwen2.5进一步成为他们最新和最伟大的专业模型的基础:Qwen2.5-Math、Qwen2.5-Coder、QwQ和QvQ等多模态模型。

总结

虽然大多数专有人工智能模型供应商都对技术细节保密,但Qwen团队和DeepSeek团队通过各自的技术报告对他们的模型及其细节进行了令人耳目一新的开放。这些模型的发布不仅标志着开源技术的进步,也凸显了开放性在推动行业前行中的关键作用。随着这些领先团队的不断努力,开源模型正在快速缩小与闭源顶级模型的差距,为全球人工智能的发展注入新的动力。

最后的最后

感谢你们的阅读和喜欢,作为一位在一线互联网行业奋斗多年的老兵,我深知在这个瞬息万变的技术领域中,持续学习和进步的重要性。

为了帮助更多热爱技术、渴望成长的朋友,我特别整理了一份涵盖大模型领域的宝贵资料集。

这些资料不仅是我多年积累的心血结晶,也是我在行业一线实战经验的总结。

这些学习资料不仅深入浅出,而且非常实用,让大家系统而高效地掌握AI大模型的各个知识点。如果你愿意花时间沉下心来学习,相信它们一定能为你提供实质性的帮助。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

大模型知识脑图

为了成为更好的 AI大模型 开发者,这里为大家提供了总的路线图。它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

经典书籍阅读

阅读AI大模型经典书籍可以帮助读者提高技术水平,开拓视野,掌握核心技术,提高解决问题的能力,同时也可以借鉴他人的经验。对于想要深入学习AI大模型开发的读者来说,阅读经典书籍是非常有必要的。

实战案例

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

面试资料

我们学习AI大模型必然是想找到高薪的工作,下面这些面试题都是总结当前最新、最热、最高频的面试题,并且每道题都有详细的答案,面试前刷完这套面试题资料,小小offer,不在话下

640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

2094

2094

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?