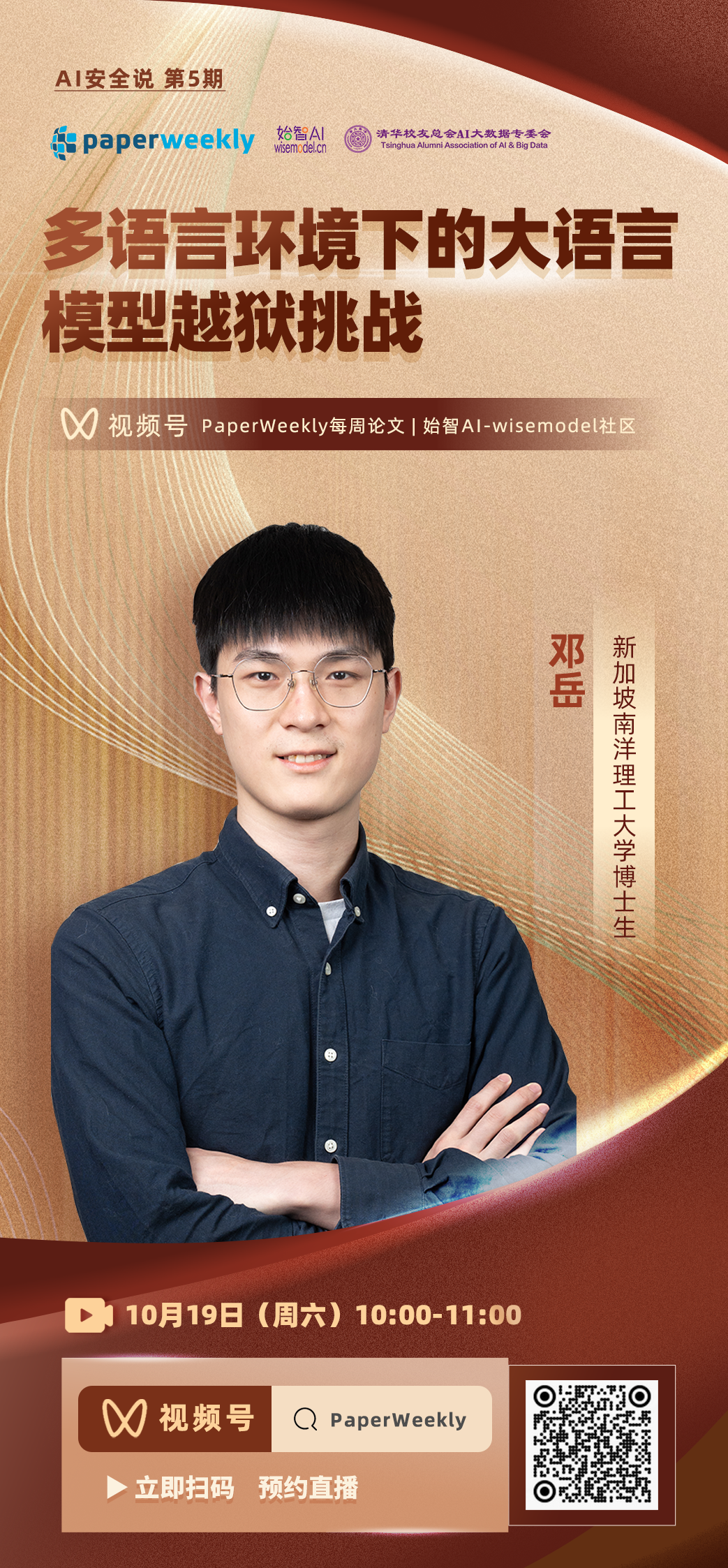

AI安全说 第5期

嘉宾在线解读✔️

在线实时Q&A✔️

直播主题

多语言环境下的大语言模型越狱挑战

直播嘉宾

邓岳

新加坡南洋理工大学博士生

直播时间

2024年10月19日(周六)

10:00-11:00

观看方式

PaperWeekly视频号

PaperWeekly B站直播间

一键预约直播

▼

报告介绍

大语言模型(LLMs)在许多任务中展现了强大能力,但同时也带来了“越狱”问题,即恶意指令可操控模型产生不良行为。虽然已有多种防护措施被提出,但大多数仅限于英语场景。

本次 talk 将探讨 LLMs 在多语言环境中的越狱问题,揭示两类风险:无意风险与有意攻击。无意风险指用户在使用非英语提示时,意外绕过安全机制;有意攻击则是恶意用户通过结合多语言提示与恶意指令,故意攻击模型。

实验表明,在无意风险下,低资源语言的有害内容概率是高资源语言的三倍。此外,低资源语言也可作为攻击大模型输出的有效工具。为应对此类挑战,我们提出了 Self-Defence框架,通过自动生成多语言数据进行安全微调。实验结果显示,该方法有效减少了不安全内容的生成。

嘉宾介绍

嘉宾介绍

邓岳

新加坡南洋理工大学博士生

邓岳,新加坡南洋理工大学在读博士生,其导师是Sinno Jialin Pan教授。他的研究重点是大模型的安全性问题,例如针对大模型的“越狱”攻击和对检索器的攻击。他的相关研究成果已在顶级国际会议ICLR上发表。目前,他专注于大模型安全的深入攻防研究,致力于为大模型的安全落地提供更加全面的探索与保障。

技术交流群

扫码备注「LLM安全」

立刻加入技术交流群

一键预约直播

▼

🔍

现在,在「知乎」也能找到我们了

进入知乎首页搜索「PaperWeekly」

点击「关注」订阅我们的专栏吧

·

·

163

163

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?