一、算法简介。

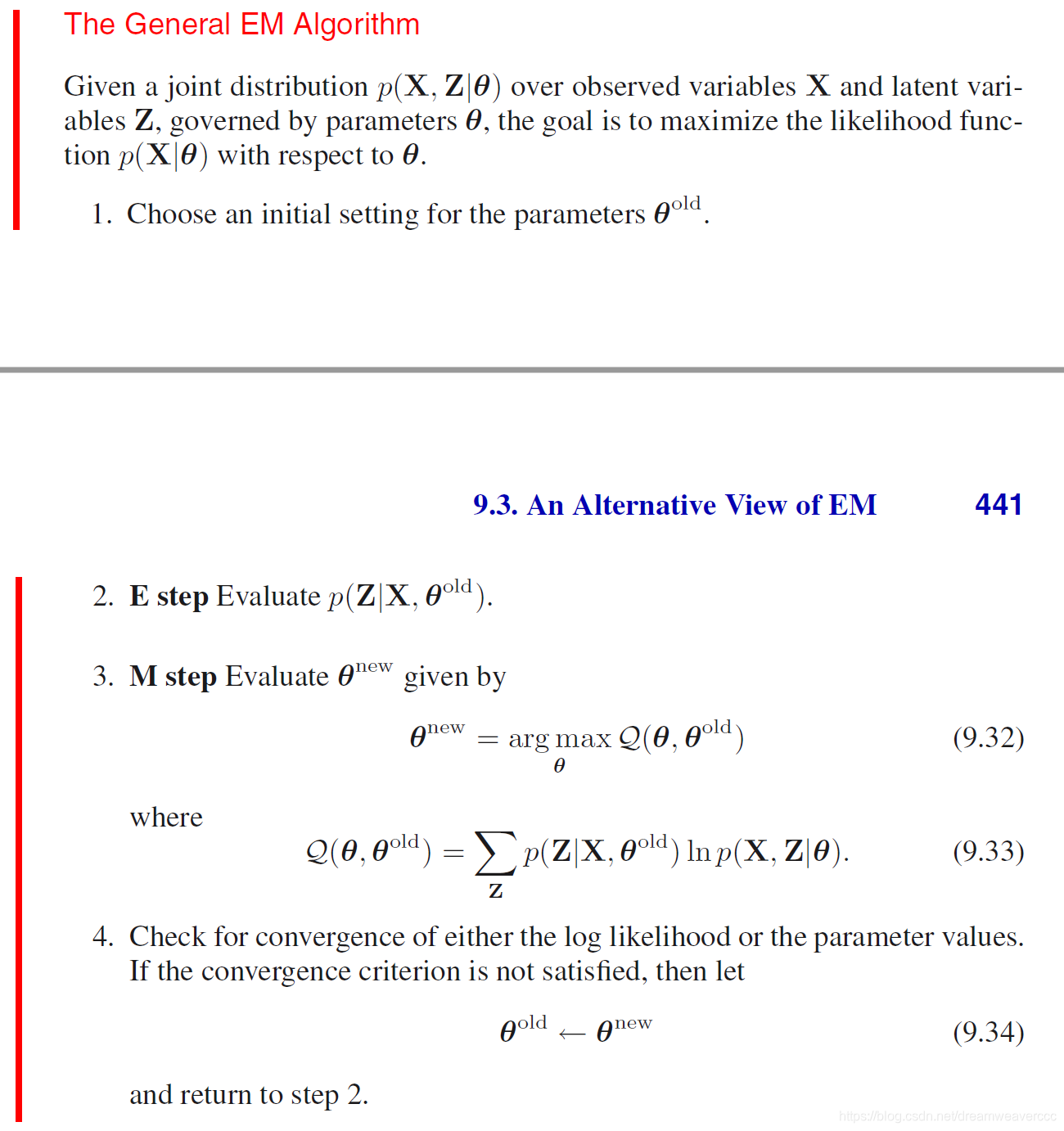

EM算法全称为Expectation Maximization,即期望极大算法,是一种用于处理含有隐变量(hidden variable)的概率模型参数的极大似然估计,或极大后验概率估计。EM算法是一种迭代算法,每一次迭代可分为两步:E步,求期望(Expectation);M步,求极大(Maximization)。

二、算法步骤。

引用于PRML。

三、个人总结。

EM算法是求含有潜变量的模型参数的方法。因为传统的极大似然估计不能解决含有隐变量的模型,所以需要消除隐变量。这里我们采用求期望的方式去消除隐变量,是因为可以将似然函数表达式拆分为期望和KL散度的和。当KL散度为0时,期望与似然函数相等,最大化期望也是最大化似然函数。这类似于变分推断的理念。

附录:李航《统计学习方法》第9章习题第3题实现代码。(该代码的最终收敛结果取决于参数初始值的设置)

# Statistical Learning Method Chapter 9 Exercise 9.3

# Question description: Try to estimat

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3083

3083

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?