误差来源 & 梯度下降

1. 误差来源

从上节课测试集数据来看,Average Error 随着模型复杂增加呈指数上升趋势。更复杂的模型并不能给测试集带来更好的效果,而这些 Error 的主要有两个来源,分别是 bias 和 variance 。

首先

Error = Bias + Variance

Error反映的是整个模型的准确度,Bias反映的是模型在样本上的输出与真实值之间的误差,即模型本身的精准度,Variance反映的是模型每一次输出结果与模型输出期望之间的误差,即模型的稳定性。

参考: 机器学习中的 Bias(偏差)、Error(误差)、Variance(方差)有什么区别和联系?

更多:偏差(Bias)和方差(Variance)——机器学习中的模型选择

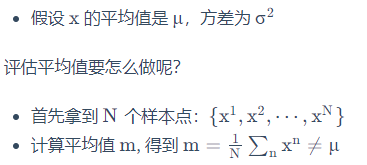

1.1 评估x的偏差

1.2 评估x的方差

1.3 总结

例如打靶,误差来源于你瞄准的位置和靶心的距离(偏差) 以及你实际打出的位置和瞄准的位置的距离(方差)。

(1)考虑不同模型的方差

比较简单的model其variance越小,越复杂的模型其方差越大,如下图所示:

(2)考虑不同模型的偏差

比较简单的模型其偏差越大,越复杂的模型其偏差越小。

看上图,直观上讲:简单的模型包含的可能性较少,甚至都没有包含到目标点;越复杂的模型包含的可能性越多,很有可能就包含了目标点。

(3)偏差 V.S. 方差

上图中的横坐标表示模型的复杂程度,纵坐标表示偏差、方差和误差的值。

简单模型(左边)是偏差比较大造成的误差,这种情况叫做欠拟合; 而复杂模型(右边)是方差过大造成的误差,这种情况叫做过拟合。

偏差大-欠拟合

当bias比较大时,说明你的模型太过简单根本没有包含目标点,这种情况下再多的数据也拯救不了,此时需要重新设计你的model,比如增加参数。

方差大-过拟合

但是很多时候不一定能做到收集更多的data。可以针对对问题的理解对数据集做调整。比如识别手写数字的时候,偏转角度的数据集不够,那就将正常的数据集左转15度,右转15度,类似这样的处理。

1.4 选择模型

现在在偏差和方差之间就需要一个权衡 想选择的模型,可以平衡偏差和方差产生的错误,使得总错误最小 但是下面这件事最好不要做:

用训练集训练不同的模型,然后在测试集上比较错误,模型3的错误比较小,就认为模型3好。但实际上这只是你手上的测试集,真正完整的测试集并没有。比如在已有的测试集上错误是0.5,但有条件收集到更多的测试集后通常得到的错误都是大于0.5的。

(1)交叉验证

交叉验证 就是将训练集再分为两部分,一部分作为训练集,一部分作为验证集。

用训练集训练模型,然后再验证集上比较,确定出最好的模型之后(比如模型3),再用全部的训练集训练模型3,然后再用public的测试集进行测试,此时一般得到的错误都是大一些的。

不过此时会比较想再回去调一下参数,调整模型,让在public的测试集上更好,但不太推荐这样。

(2)N-折交叉验证

将训练集分成N份,比如分成3份,比如在三份中训练结果Average错误是模型1最好,再用全部训练集训练模型1。

2. 梯度下降

然后分别计算初始点处,两个参数对 L 的偏微分,然后

θ

0

θ^{0}

θ0 减掉 η 乘上偏微分的值,得到一组新的参数。同理反复进行这样的计算。黄色部分为简洁的写法,▽L(θ) 即为梯度。

注: (上图举例将梯度下降法的计算过程进行可视化)

- 红色箭头指的方向为等高线的法线方向;

- η 叫做Learning rates(学习速率);

- 更新方式:

2.1 调整学习速率

(1)小心翼翼地调整学习率

上图

左边黑色为损失函数的曲线,假设从左边最高点开始,

如果学习率调整的刚刚好,比如红色的线,就能顺利找到最低点。

如果学习率调整的太小,比如蓝色的线,就会走的太慢,虽然这种情况给足够多的时间也可以找到最低点,实际情况可能会等不及出结果。

如果学习率调整的有点大,比如绿色的线,就会在上面震荡,走不下去,永远无法到达最低点。还有可能非常大,比如黄色的线,直接就飞出去了,更新参数的时候只会发现损失函数越更新越大。

虽然这样的可视化可以很直观观察,但可视化也只是能在参数是一维或者二维的时候进行,更高维的情况已经无法可视化了。

解决方法就是上图

右边的方案,将参数改变对损失函数的影响进行可视化。比如

学习率太小(蓝色的线),损失函数下降的非常慢;

学习率太大(绿色的线),损失函数下降很快,但马上就卡住不下降了;

学习率特别大(黄色的线),损失函数就飞出去了;

学习率刚刚好(红色的线),可以得到一个好的结果。

(2)自适应学习率 - Adagrad

比如: Adagrad 算法

Adagrad 举例

下图是一个参数的更新过程

将 Adagrad 的式子进行化简:

在 Adagrad 中,当梯度越大的时候,步伐应该越大,但下面分母又导致当梯度越大的时候,步伐会越小。

Adagrad 的直观解释:

这和之前的说法有些矛盾。有paper解释如下图:(反差感)

Adagrad 的正式解释:

多参数下结论不一定成立

对比不同的参数

Adagrad 进一步的解释

再回到之前的 Adagrad

2.2 随机梯度下降法

—> 可以让你的training更快

随机梯度下降法中的损失函数不需要处理训练集所有的数据,每次选取一个例子,不需要像之前那样对所有的数据进行处理,只需要计算某一个例子的损失函数就可以赶紧update 梯度。

常规梯度下降法走一步要处理到所有二十个例子,但随机算法此时已经走了二十步(每处理一个例子就更新)

2.3 特征缩放(Feature Scaling)

上图可知:两个输入的分布的范围很不一样,建议把他们的范围缩放,使得不同输入的范围是一样的。

(1)原因

(2)方法

方法非常多,这里举例一种常见的做法:

2.4 梯度下降的理论基础

(1)数学理论

比如在

θ

0

θ^0

θ0 处,可以在一个小范围的圆圈内找到损失函数细小的

θ

1

θ^1

θ1,更新红圈的圆心为

θ

1

θ^1

θ1,不断的这样去寻找。

接下来就是如果在小圆圈内快速的找到最小值?即如何在红色圈中找一个loss最小的参数的方法:泰勒展开式

举例:

图中3条蓝色线是把前3项作图,橙色线是 sin(x)。

多变量泰勒展开式

利用泰勒展开式简化

回到之前如何快速在圆圈内找到最小值。基于泰勒展开式,在 (a,b) 点的红色圆圈范围内,可以将损失函数用泰勒展开式进行简化:

将问题进而简化为下图:

不考虑s的话,可以看出剩下的部分就是两个向量(△θ 1,△θ 2 ) 和 (u,v) 的内积,那怎样让它最小,就是和向量 (u,v)方向相反的向量。

然后将u和v带入:

上面这段话没有听懂…

(2)梯度下降的限制

容易陷入局部极值 还有可能卡在不是极值,但微分值是0的地方 还有可能实际中只是当微分值小于某一个数值就停下来了,但这里只是比较平缓,并不是极值点。

参考

1029

1029

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?