作者丨我爱计算机视觉 来源丨我爱计算机视觉 编辑丨极市平台

导读

首创性地提出了PGTFormer,这是第一个专门为视频人脸恢复设计的方法。PGTFormer采用了端到端的设计,摒弃了传统方法中的复杂对齐步骤,实现了更加高效和连贯的视频人脸恢复。

本篇分享 IJCAI 2024 论文Beyond Alignment: Blind Video Face Restoration via Parsing-Guided Temporal-Coherent Transformer,西电、西南科大联合提出首个视频人脸修复技术!让人脸细节更清晰!

论文地址:https://arxiv.org/abs/2404.13640

论文主页:https://kepengxu.github.io/projects/pgtformer/

开源代码地址:https://github.com/kepengxu/PGTFormer

研究者主页:https://kepengxu.github.io

引言

在计算机视觉领域,视频人脸恢复一直是一个备受关注的研究方向。然而,大多数现有的方法主要针对静态图像,无法有效处理视频中的时序信息,往往需要繁琐的对齐操作,并且在面对长视频时,容易出现恢复结果不一致的问题。

针对这些挑战,研究者首创性地提出了PGTFormer(Parsing-Guided Temporal-Coherent Transformer),这是第一个专门为视频人脸恢复设计的方法。PGTFormer采用了端到端的设计,摒弃了传统方法中的复杂对齐步骤,实现了更加高效和连贯的视频人脸恢复。

方法介绍

设计动机

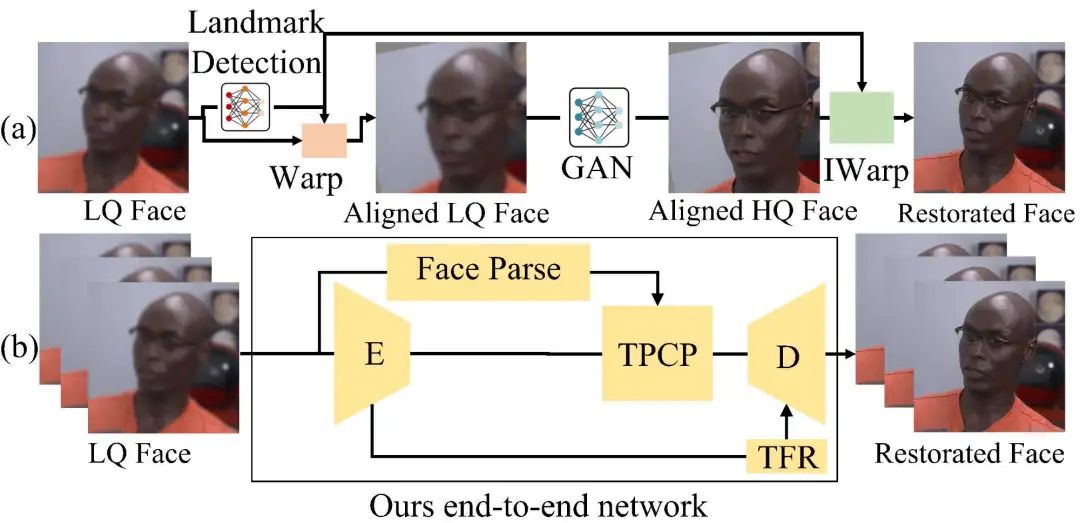

图中展示了过去方案和PGTFormer在处理视频人脸恢复时的不同流程。(a)展示过去方案需要对齐操作的复杂流程,(b)展示PGTFormer的方法,完全省去了对齐步骤,直接实现了端到端的视频恢复。

现有的视频人脸恢复方法面临的主要问题在于时序一致性和对齐的复杂度。许多方法为了保持视频帧间的一致性,依赖于对帧进行精确对齐,这不仅增加了计算复杂度,还可能引入对齐误差,导致恢复效果不佳。

为了克服这些问题,研究者设计了PGTFormer。该方法通过引入解析引导和时序一致性建模,完全抛弃了对齐操作,实现了端到端的视频人脸恢复。这一创新设计大大简化了处理流程,同时显著提升了恢复结果的连贯性和视觉效果。

网络结构

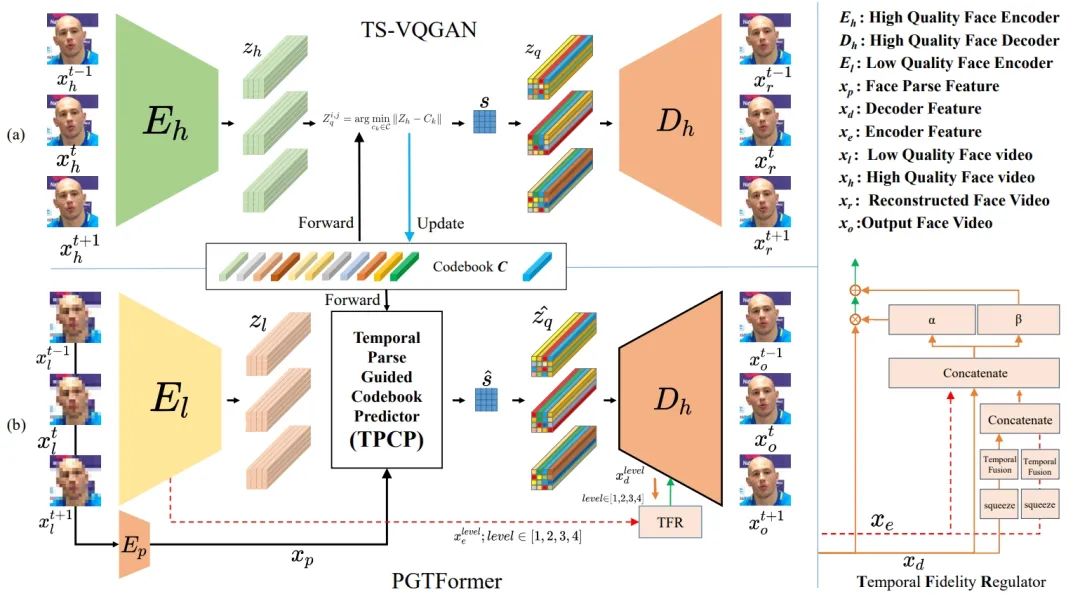

图中详细展示了PGTFormer的网络结构。图中还展示了TS-VQGAN与PGTFormer之间的协作关系,说明了两阶段训练的过程。

PGTFormer的网络结构旨在从根本上解决视频人脸恢复中的关键难题。其训练过程分为两个主要阶段:

第一阶段 - 训练TS-VQGAN(时空VQGAN):

在这个阶段,研究者首先训练TS-VQGAN,该模型通过嵌入高质量的视频人脸先验信息,为PGTFormer后续的恢复任务提供了强大的基础。TS-VQGAN能够有效地捕捉和表示高质量人脸的空间和时间特征,生成与真实人脸非常接近的先验嵌入。这些嵌入在后续步骤中将作为PGTFormer的查询目标。第二阶段 - 训练PGTFormer:

在第二阶段,PGTFormer通过人脸解析模块和时空Transformer模块,利用第一阶段中训练得到的高质量视频人脸先验,完成视频人脸恢复任务。具体而言,PGTFormer首先解析输入的低质量视频帧,提取出关键的面部特征,然后通过时空Transformer模块,从TS-VQGAN生成的高质量人脸先验中查询相应的细节信息。最终,解码器将这些查询得到的高质量特征整合到原始视频中,输出高清且时序一致性强的恢复视频。

实验结果

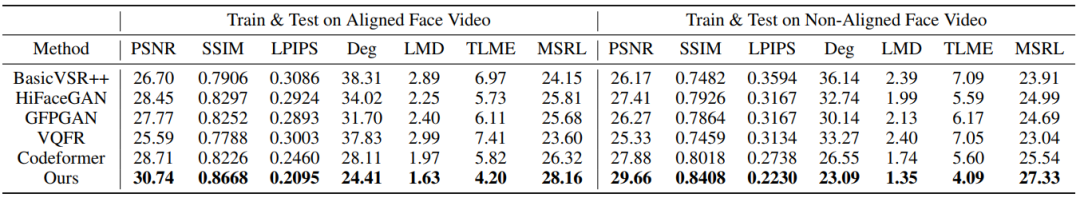

为了验证PGTFormer的有效性,研究者在多个公开数据集上与其他最先进的方法进行了对比。以下是PGTFormer与其他方法在多个定量指标上的表现,涵盖了在对齐和非对齐人脸视频上的训练和测试结果。

如表格所示,PGTFormer在多个关键指标上显著超越了现有的最先进方法,具体包括:

PSNR(峰值信噪比):PGTFormer在对齐人脸视频和非对齐人脸视频上的PSNR值分别达到了30.74和29.66,明显高于其他方法,表明其在重建图像质量上的强大能力。

SSIM(结构相似性):PGTFormer在SSIM指标上也展现了卓越的表现,在对齐和非对齐数据集上的SSIM值分别为0.8668和0.8408,远高于其他竞争方法,证明了PGTFormer在保持结构一致性方面的优势。

LPIPS(感知相似度):PGTFormer在LPIPS指标上取得了最低值,分别为0.2095(对齐)和0.2230(非对齐),表明在主观视觉感受上,PGTFormer生成的图像与高质量图像的差异最小,具有更好的视觉效果。

Deg、LMD、TLME、MSRL:在这些用于评价面部特征、扭曲程度、时间一致性和细节保留的指标上,PGTFormer也全面领先于其他方法,展现出极强的全方位恢复能力。

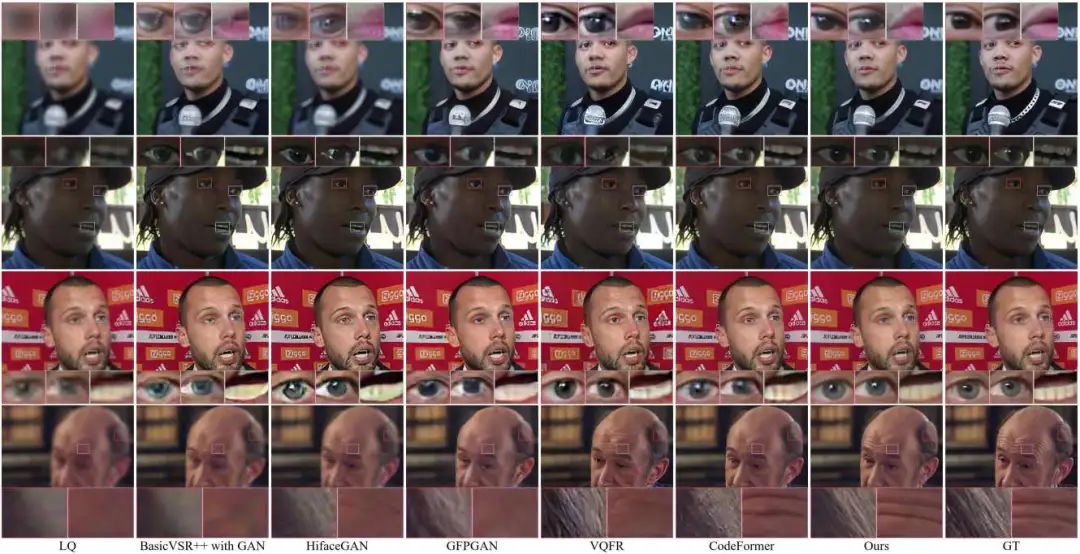

主观对比结果

除了定量评价外,研究者还进行了大量的主观视觉对比实验。主观结果清晰地展示了PGTFormer在恢复视频人脸时的卓越表现:

图中展示了PGTFormer与其他方法在视觉效果上的差异。可以看到PGTFormer在细节保留、伪影去除以及及面部自然度上明显优于其他方法。

主观视觉对比结果表明,PGTFormer能够有效恢复面部细节,如眼睛、嘴巴的轮廓和纹理。与其他方法相比,PGTFormer生成的面部更加生动,色彩还原度更高,几乎没有伪影和不自然的过渡。

结论

PGTFormer作为第一个专门为视频人脸恢复设计的方法,在该领域中开创了一个新的方向。其端到端的设计彻底解决了传统方法中对齐操作复杂且易引入误差的问题,同时通过解析引导和时序一致性建模,实现了高效、自然的视频人脸恢复。

未来,研究者计划进一步优化网络结构,并将其应用到更广泛的视频增强任务中,期待PGTFormer能够在更多实际场景中展现出卓越的性能。

参考文献

K Xu, L Xu, G He, W Yu, Y Li. Beyond Alignment: Blind Video Face Restoration via Parsing-Guided Temporal-Coherent Transformer. Proceedings of the Thirty-Third International Joint Conference on Artificial Intelligence IJCAI-24

往期精彩回顾

适合初学者入门人工智能的路线及资料下载(图文+视频)机器学习入门系列下载机器学习及深度学习笔记等资料打印《统计学习方法》的代码复现专辑交流群

欢迎加入机器学习爱好者微信群一起和同行交流,目前有机器学习交流群、博士群、博士申报交流、CV、NLP等微信群,请扫描下面的微信号加群,备注:”昵称-学校/公司-研究方向“,例如:”张小明-浙大-CV“。请按照格式备注,否则不予通过。添加成功后会根据研究方向邀请进入相关微信群。请勿在群内发送广告,否则会请出群,谢谢理解~(也可以加入机器学习交流qq群772479961)

1088

1088

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?