1. ChatGPT的含义

ChatGPT的GPT对应的英文分别为Generative Pre-trained Transformer,意思是用到Transformer网络架构的生成式预训练模型。其中预训练也叫做自监督学习(Self-supervised Learning)或者是大模型(Foundation Model)。

2. ChatGPT模型是怎么来的

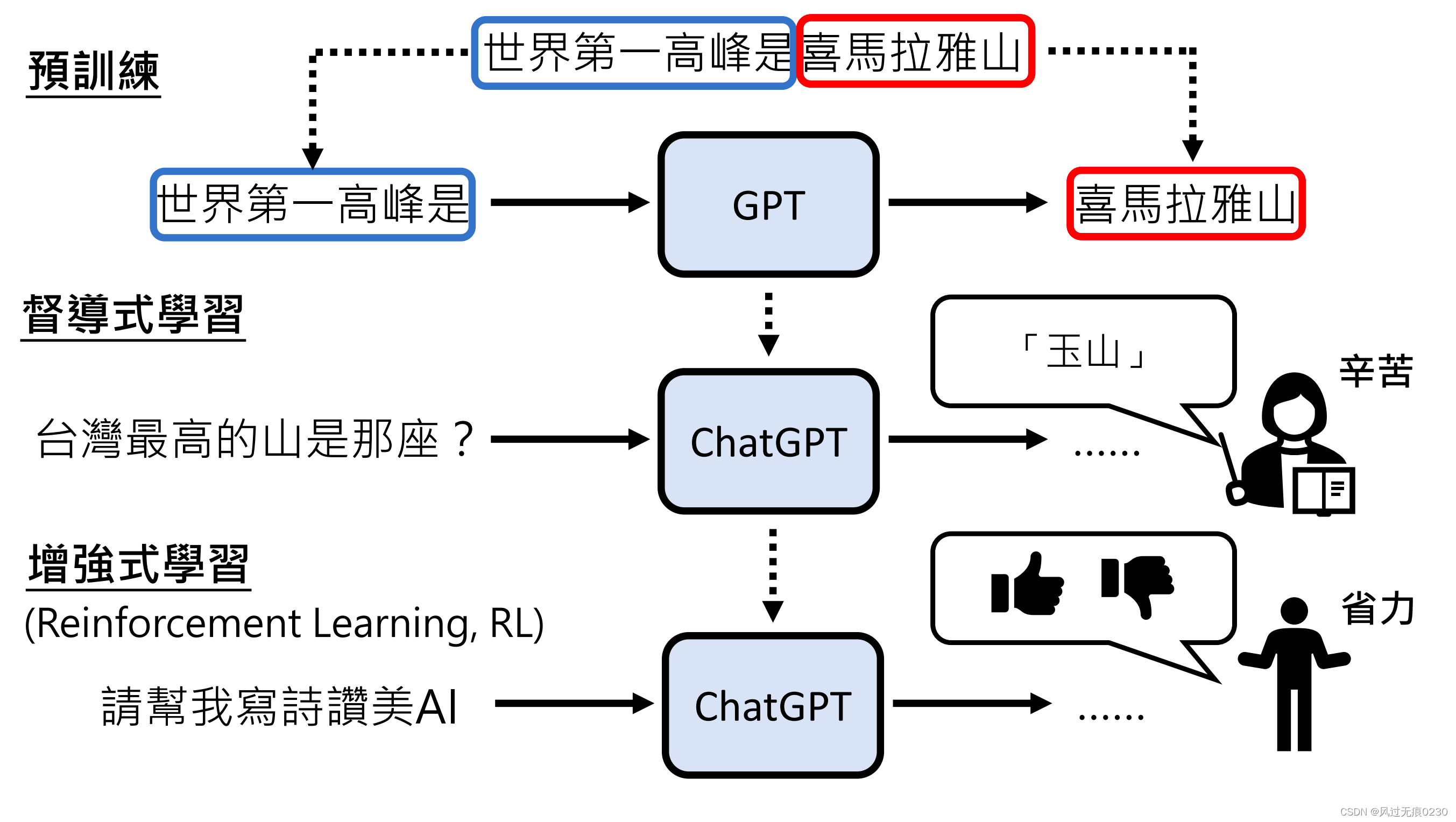

ChatGPT模型的训练包含三个部分:

- 预训练:这部分是自监督学习,直接将获取的文字训练资料作为模型的输入,训练出一个模型。这部分资料都是没有标签的。

- 微调(finetune):在预训练模型的基础上,将准备好的有标签的数据作为模型的输入进行训练,这部分属于监督学习(Supervised Learning)。

- 强化学习(Reinforcement Learning,RL):输入问题,由第二步的模型生成答案,人类对答案进行评价好坏。

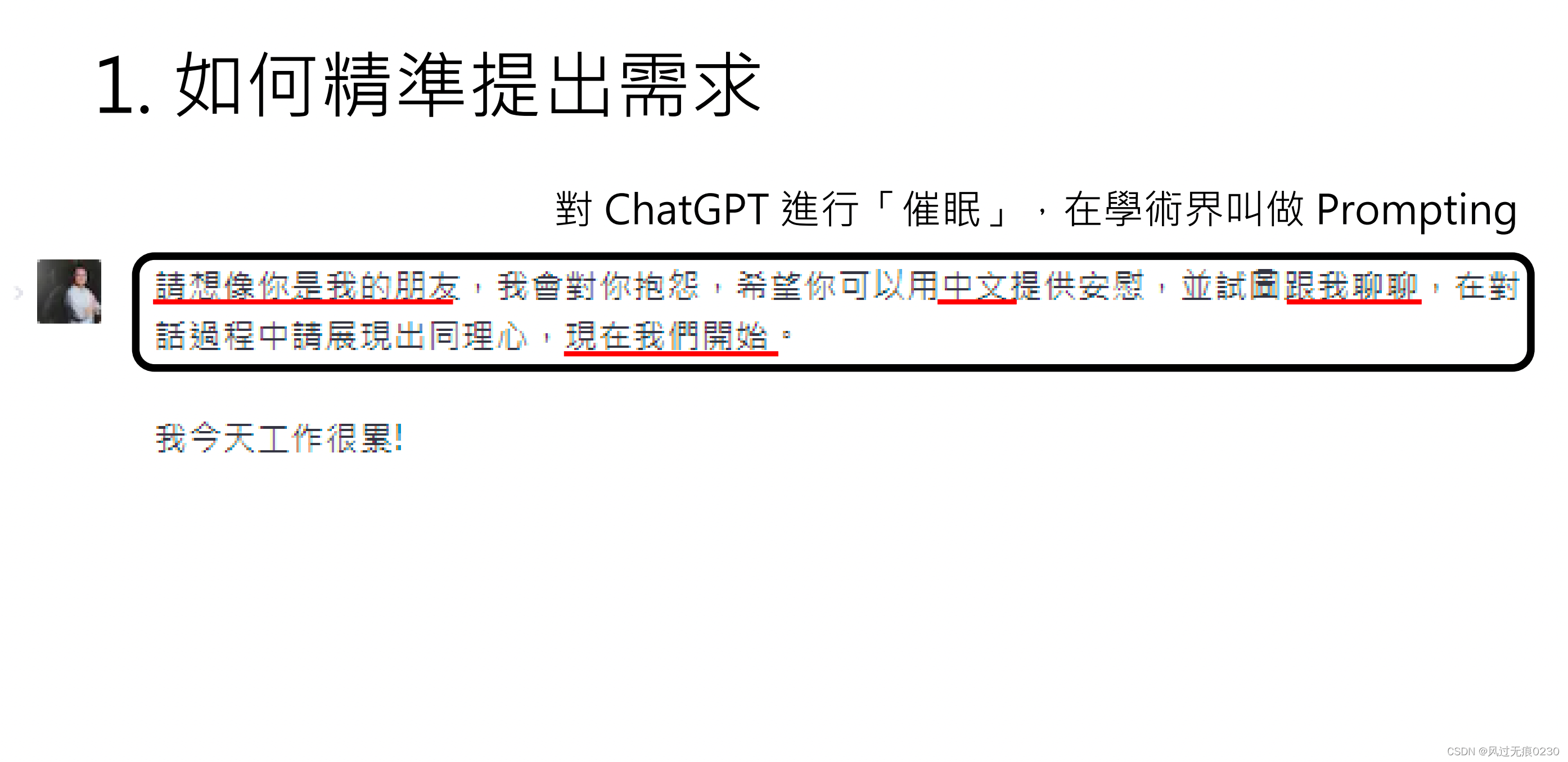

3. 如何对ChatGPT精准提出需求

这个例子是假设你想把ChatGPT当成聊天机器人,需要对它进行催眠,学术界叫Prompt。Prompt是给input加的一段文字或一组向量,让模型根据input和外加的prompt做masked language modeling (MLM)。

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?