14.概率图模型

14.1隐马尔可夫模型

1、概率模型

机器学习是根据一些已观察到的证据(如训练样本)来对感兴趣的未知变量(如类别标记)进行估计和预测。概率模型(probabilistic model)提供了一种描述框架,将学习任务归结于计算变量的概率分布

在概率模型中,利用已知变量推测未知变量的分布称为推断(inference),其核心是如何基于可观测变量推断出未知变量的条件分布。假定未知变量集合是Y,可观察变量集合是O,其他变量集合是R,生成式(generative)模型考虑联合分布P(Y,R,O);判别式(discriminative)模型考虑条件分布P(Y,R|O);给定一组观测变脸值,推断就是由P(Y,R,O)或P(Y,R|O)得到条件概率分布P(Y|O)。

直接利用概率求和规则消去变量R不可行,因为即便每个变量只有简单的两种取值,复杂度已去到至少O(2|Y|+|R|);并且属性变量之间还可能存在复杂的联系;因此概率模型的学习,即基于训练样本来估计变量分布的参数是困难的。为此需要能表达变量间关系的工具,用于推断和学习算法,概率图模型即是。

2、概率图模型

概率图模型(probabilisticgraphical model)是一类用图来表达变量相关关系的概率模型。概率图模型,以图为表示工具,如一个结点表示一个或一组随机变量,结点之间的边表示变量间的概率相关关系,即变量关系图。

根据边的性质不同,概率图模型大致可分为两类:

1)使用有向无环图表示变量间的依赖关系,称为有向图模型或贝叶斯网(Bayesian network);

2)使用无向图表示变量间的相关关系,称为无向图模型或马尔可夫网(Markov network);

隐马尔可夫模型属于第一种有向网类型。

3、隐马尔可夫模型

隐马尔可夫模型(Hidden Markov Model,HMM)是结构最简单的动态贝叶斯网(dynamic Bayesian network),是著名的有向图模型,主要用于时序数据建模,在语音识别、自然语言处理等领域有广泛应用。

1)HMM结构信息

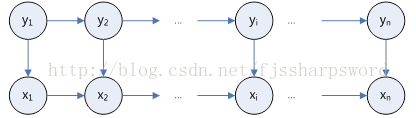

HMM的变量可分为两组:第一组是状态变量{y1,y2,…,yn},其中yi∈Y表示第i时刻的系统状态,通常假定状态变量是隐藏的、不可观测的,因此状态变量也叫隐变量(hidden variable);第二组是观测变量{x1,x2,…,xn},其中xi∈X表示第i时刻的观测值。

在HMM中,系统通常在多个状态{ s1,s2,…,sN }之间转换,因此状态变量yi的取值范围Y(状态空间)通常是有N个可能取值的离散空间。观测变量xi可以是离散型也可以使连续型,这里仅考虑离散型观测变量,并假定其取值范围X为{ o1,o2,…,oM}。

HMM图结构如下:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2415

2415

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?