PyTorch - torch.nn.PReLU

flyfish

PReLU是Parametric ReLU

示例1

import torch

import torch.nn as nn

input = torch.arange(0, 12).view(1,3,2,2).float()

input = torch.randn(1,3,2,2)

print(input)

m = nn.PReLU(3)

output = m(input)

print(output)

计算过程

数学表达式:

P

R

e

L

U

(

x

)

=

m

a

x

(

0

,

x

)

+

a

∗

m

i

n

(

0

,

x

)

PReLU(x)=max(0,x)+a∗min(0,x)

PReLU(x)=max(0,x)+a∗min(0,x)

还可以这样写

f

(

y

i

)

=

{

y

i

,

if

y

i

>

0

a

i

y

i

,

if

y

i

≤

0

f\left(y_{i}\right)=\left\{\begin{array}{ll} y_{i}, & \text { if } y_{i}>0 \\ a_{i} y_{i}, & \text { if } y_{i} \leq 0 \end{array}\right.

f(yi)={yi,aiyi, if yi>0 if yi≤0

代码是

a=0.25

print(torch.max(input,torch.FloatTensor([0.0])) + a * torch.min(input,torch.FloatTensor([0.0])))

torch.nn.PReLU(num_parameters=1,init=0.25)

参数说明

其中a 是一个可学习的参数,当不带参数调用时,即nn.PReLU(),在所有的输入通道上使用同一个a,当带参数调用时,即nn.PReLU(nChannels),在每一个通道上学习一个单独的a。

注意:当为了获得好的performance学习一个a时,不要使用weight decay。

num_parameters:要学习a的数量,可以输入两种值,1或者输入的通道数,默认是1

init:a的初始值,默认0.25

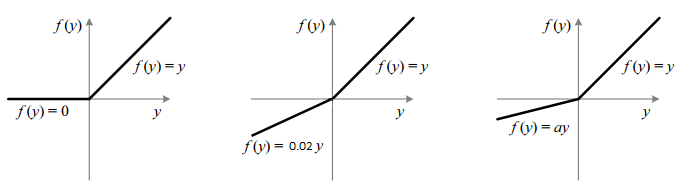

ReLU,LeakyReLU,PReLU比较

2847

2847

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?