一、 什么是 Ollama

Ollama 是⼀个开源的⼤型语⾔模型服务⼯具,

兼容 Windows、Linux 和 MacOS 操作系统。

提供了

类似 OpenAI 的 API 接⼝和聊天界⾯,可以⾮常⽅便地在本地部署各种开源的⼤模型并通过接⼝使⽤。

官⽹:

https://ollama.com/

GitHub:

https://github.com/ollama/ollama

二、Ollama 的优势

●

本地部署:Ollama 允许⽤户在⾃⼰的本地环境中部署⼤型语⾔模型

●

易于使⽤:Ollama 提供了类似 OpenAI 的 API 接⼝和聊天界⾯,使得⽤户可以轻松地与模型进⾏交

互

●

降低成本:开发阶段,可以在本地环境中使⽤ Ollama ,减少调⽤⼤模型平台接⼝ token 的消耗

●

热加载模型⽂件:Ollama⽀持热加载模型⽂件,这意味着⽤户可以在不重启服务的情况下更换或更 新模型

●

定制化与可扩展性:⽤户可以根据⾃⼰的任务和需求,定制和创建⾃⼰的语⾔模型

●

开源与灵活性:Ollama是⼀个开源项⽬,这意味着⽤户可以⾃由地访问、使⽤和修改其源代码

三、 部署安装

1.

官⽹下载安装包打开运⾏:

https://ollama.com/download

2.

docker 安装:

https://hub.docker.com/r/ollama/ollama

docker run -d -v ollama:/root/.ollama -p 11434:11434 --name ollama ollama/olla

ma

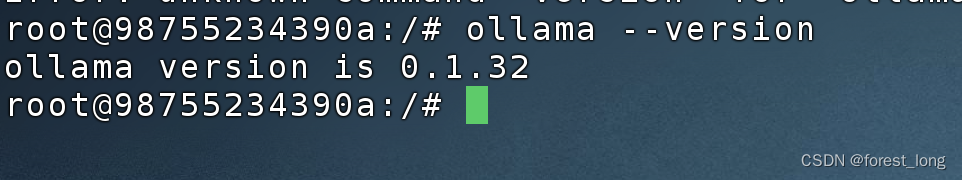

安装完后,进入docker容器,

检查是否安装成功:

ollama --version

四、安装⼤模型

1、安装 Owen 模型

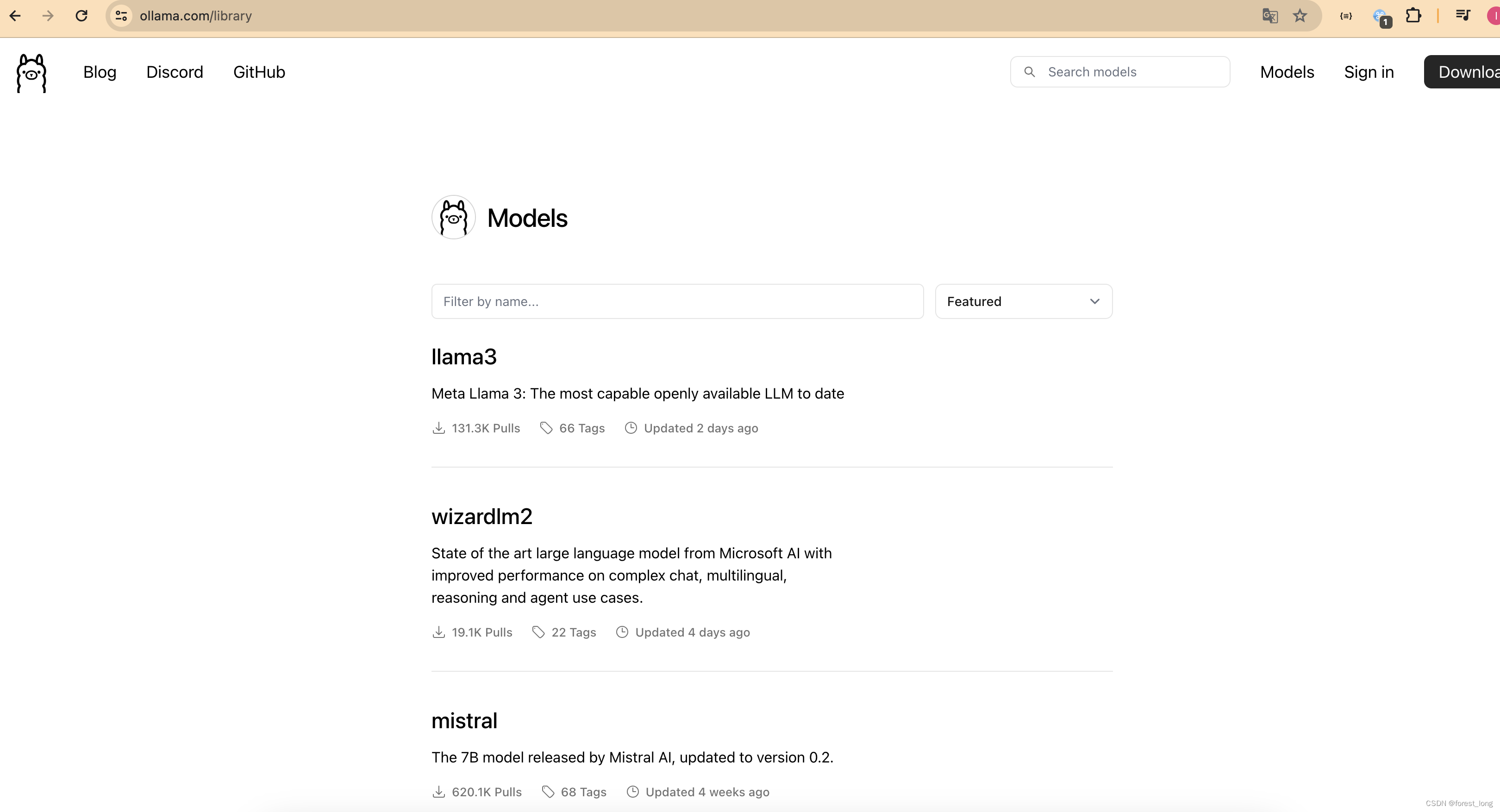

Ollama 官⽅⽀持的模型可以在

https://ollama.com/library

上⾯找到

进入qwen列表

New in Qwen 1.5

- 6 model sizes, including 0.5B, 1.8B, 4B (default), 7B, 14B, 32B (new) and 72B

ollama run qwen:0.5bollama run qwen:1.8bollama run qwen:4bollama run qwen:7bollama run qwen:14bollama run qwen:32bollama run qwen:72b

- Significant performance improvement in human preference for chat models

- Multilingual support of both base and chat models

- Stable support of 32K context length for models of all sizes

The original Qwen model is offered in four different parameter sizes: 1.8B, 7B, 14B, and 72B.

大模型操作命令

拉取模型:

ollama pull qwen:7b

删除模型:

ollama rm qwen:7b

列出电脑上的模型

ollama list

运⾏模型:

ollama run qwen:7b本文是安装qwen:0.5b作为演示,大小394MB

2、运行Qwen模型

ollama run qwen:0.5b

93

93

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?