Manifold Mixup: Better Representations by Interpolating Hidden States

https://arxiv.org/pdf/1806.05236.pdf

https://github.com/vikasverma1077/manifold_mixup

深度学习善于拟合训练数据,在测试数据分布稍有差异时,预测效果就不好,

这种测试数据包括数据分布偏移, 异类, 对抗样本,

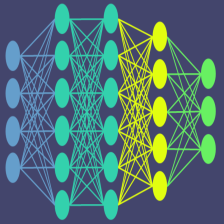

为解决这个问题,我们提出Manifold Mixup,即一种简单的正则化方法,

Manifold Mixup使用语义插补文字作为附加的训练信号,使神经网络 在多层的向量表示 有更平滑的决策边界,

结果是,用Manifold Mixup训练的神经网络可学习class-representations时使用更少的方差方向,

我们证明了这个理论在理想情况下为何会发生扁平化,在实际场景也证实了,以及联系到之前的信息论和泛化理论,

尽管只用很少代码,Manifold Mixup很大提升了监督学习的baseline, 提升了一步对抗样本攻击的鲁棒性,以及提升了测试集的log-likelihood分数

Manifold Mixup是一种深度学习正则化技术,通过在隐藏层进行特征插值,促进模型学习更平滑的决策边界,提高对数据分布偏移、异类和对抗样本的鲁棒性。实验表明,这种方法能提升模型的泛化能力和对抗攻击的抵抗力。

Manifold Mixup是一种深度学习正则化技术,通过在隐藏层进行特征插值,促进模型学习更平滑的决策边界,提高对数据分布偏移、异类和对抗样本的鲁棒性。实验表明,这种方法能提升模型的泛化能力和对抗攻击的抵抗力。

807

807

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?