早上6点爬起来看完OpenAI 的发布会,确实惊艳,主要体现在以下几点:

- 实时性:从现场发布的demo演示来看,响应延时在毫秒级别,对人的感官来讲,几乎可以认为是零延时,但注意到一个细节,演示前,iPhone连接了TypeC 线,同时特别强调了需要稳定的网络链接,这个对实时响应非常重要,因此,在移动网络下,其实时表现可能会打折扣。

-

端到端的处理能力:这个能力的落地进一步验证了transformer的泛化能力,everything is token 的时代即将到来。从这个方面来说,同时我也对Tesla 的FSD 提升了很大信心;

-

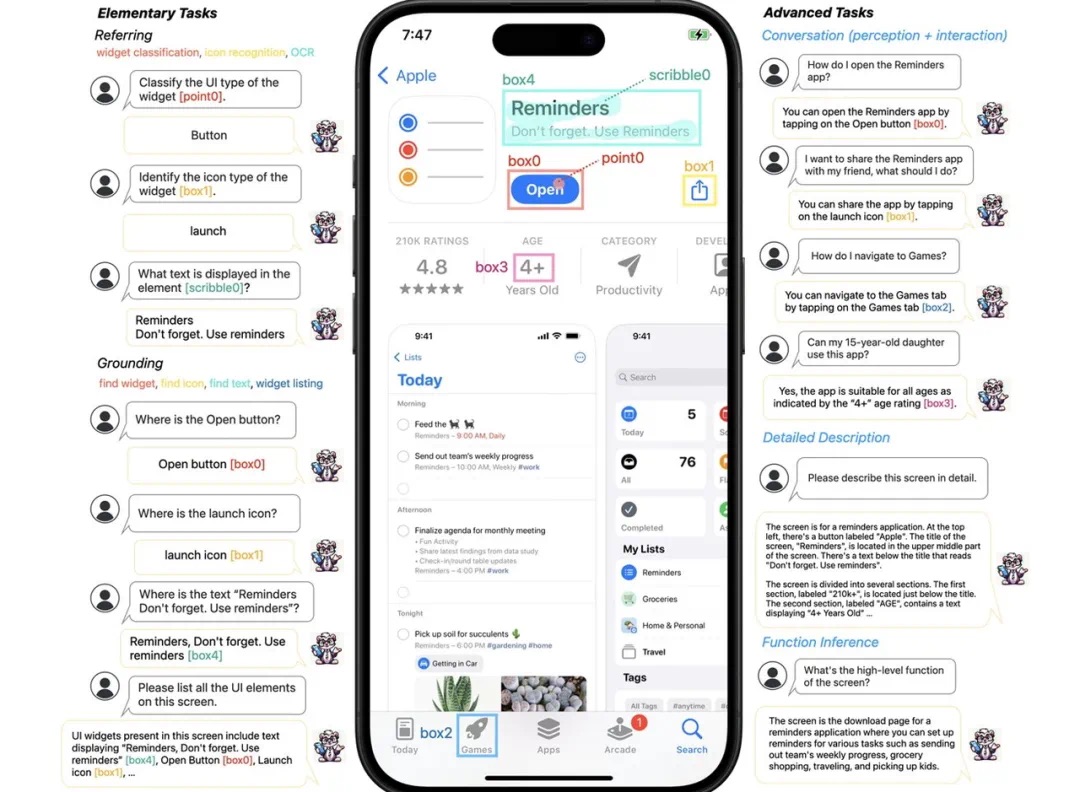

多模态能力: 多模态的处理能力,现在的Mixtral和各种MOE在处理多模态问题还是遇到瓶颈,实现demo状态的丝滑切换不光是要在模型层面下功夫,工程化也需要有极高的造诣,这一点不得不佩服,就演示的几个场景来看,从语音到提示打开视频识别,chatgpt切换极其自然和稳定,甚至有增加了过渡的语气和主持人开玩笑,就这个能力来看,不只是MOE expert切换能够解决的了;

-

全民免费尝鲜:推理成本进一步下降,在模型架构方面有了进一步的改进和加强,结合最近Deepseek V2 和YOCO(you only cache once)的进展,推理成本实现了断崖式的下降,全民AIGC的时代很快即将到来;

-

iPhone AI: 全程演示使用的是iPhone,结合近期iPhone和OpenAI 达成交易的传闻,并且iPhone是在边缘端部署,那上面提到的延时问题就不存在了,集合iPhone本地的的众多应用,chatgpt加持的Siri会焕发出新的截然不同的生机,期待ing。

985

985

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?