一、本文介绍

本文给大家带来的改进机制是利用AODNet图像去雾网络结合PONO机制实现二次增强,我将该网络结合YOLOv5针对图像进行去雾检测(也适用于一些模糊场景,图片不清晰的检测),同时本文的内容不影响其它的模块改进可以作为工作量凑近大家的论文里,非常的适用,图像去雾检测为群友最近提出的需要的改进,在开始之前给大家推荐一下我的专栏,本专栏每周更新3-10篇最新前沿机制 | 包括二次创新全网无重复,以及融合改进(大家拿到之后添加另外一个改进机制在你的数据集上实现涨点即可撰写论文),还有各种前沿顶会改进机制 |,更有包含我所有附赠的文件(文件内集成我所有的改进机制全部注册完毕可以直接运行)和交流群和视频讲解提供给大家。

👑欢迎大家订阅我的专栏一起学习YOLO👑

目录

二、原理介绍

官方论文地址: 官方论文地址点击即可跳转

官方代码地址: 官方代码地址点击即可跳转

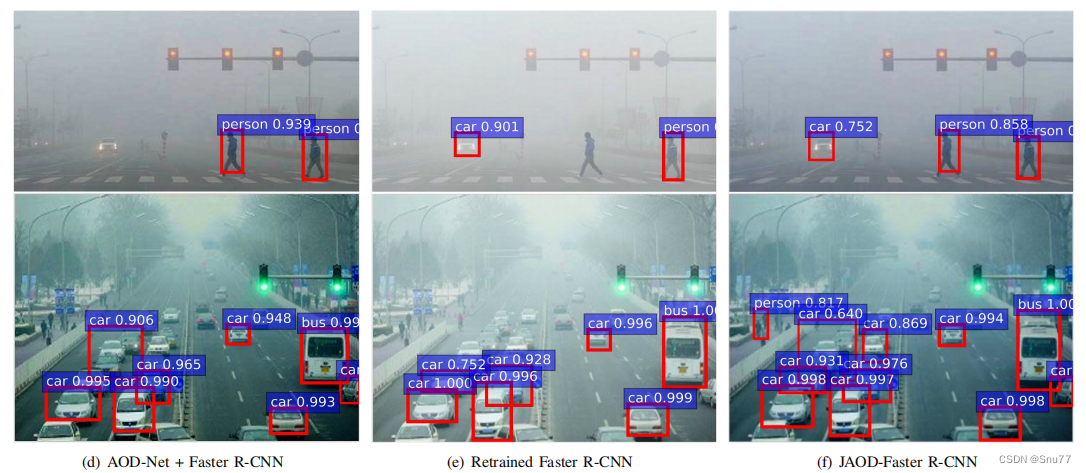

摘要:这篇论文提出了一种名为全能去雾网络(AOD-Net)的图像去雾模型,该模型是基于重新制定的大气散射模型并利用卷积神经网络(CNN)构建的。与大多数先前的模型不同,AOD-Net不是分别估计传输矩阵和大气光,而是直接通过一个轻量级的CNN生成清晰图像。这种新颖的端到端设计使得将AOD-Net嵌入到其他深度模型中变得简单,例如,用于提升雾霾图像上高级任务性能的Faster R-CNN。在合成和自然雾霾图像数据集上的实验结果证明了我们在峰值信噪比(PSNR)、结构相似性指数(SSIM)和主观视觉质量方面超越了最先进技术的性能。此外,当将AOD-Net与Faster R-CNN结合并从头到尾进行联合训练时,我们见证了雾霾图像上对象检测性能的显著提升。

AOD-Net是一个端到端的可训练去雾模型,直接从有雾图像产生清晰图像,而不是依赖于任何单独和中间参数估计步骤。基于重新公式化的大气散射模型设计,与现有工作共享相同的物理基础,但以一种“更端到端”的方式将其所有参数估计在一个统一模型中完成

主要创新点

- 端到端去雾模型:首次提出一个端到端训练的去雾模型,直接从雾图像生成清晰图像,避免了传统方法中估计传输矩阵和大气光的独立步骤。

- 与高级视觉任务的结合:首次量化研究去雾质量如何影响后续高级视觉任务的性能,为比较去雾结果提供了一种新的客观标准。此外,AOD-Net可以无缝地与其他深度模型嵌入,形成一个在有雾图像上执行高级任务的流水线,通过端到端的联合调优进一步提升性能。 <

本文介绍了如何利用AODNet-PONO-Net图像去雾网络改进YOLOv5,实现对图像的二次增强,尤其适用于模糊或雾天图像的物体检测。通过端到端训练的AOD-Net模型,直接从雾图像生成清晰图像,提升后续高级视觉任务的性能。详细教程包括核心代码修改和训练过程记录。

本文介绍了如何利用AODNet-PONO-Net图像去雾网络改进YOLOv5,实现对图像的二次增强,尤其适用于模糊或雾天图像的物体检测。通过端到端训练的AOD-Net模型,直接从雾图像生成清晰图像,提升后续高级视觉任务的性能。详细教程包括核心代码修改和训练过程记录。

订阅专栏 解锁全文

订阅专栏 解锁全文

4215

4215

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?