目录

一、从感知机到神经网络

1.1 神经网络的例子

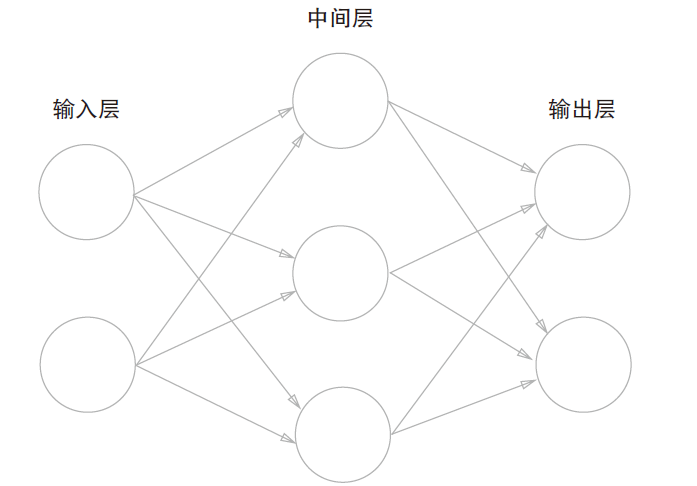

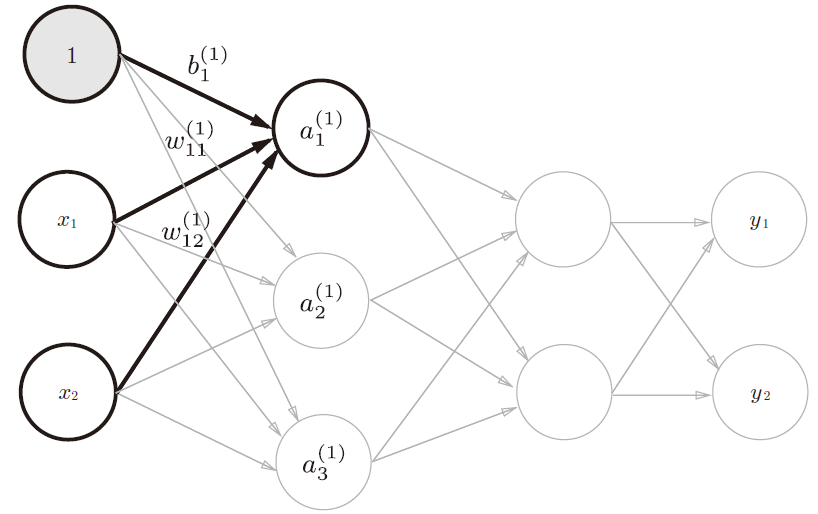

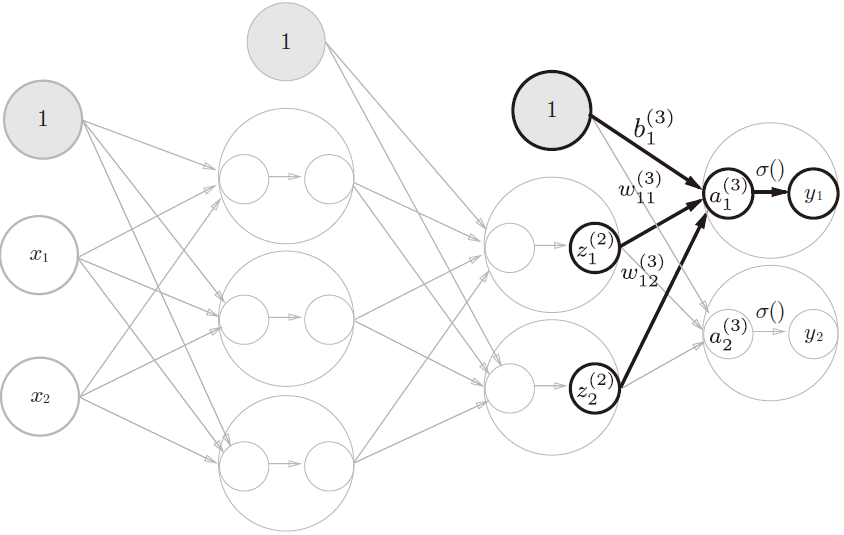

可以用图1所示的图表示神经网络,将最左边的一列称为输入层,最右边的一列称为输出层,中间的一列称为中间层。有时也将中间层称为“隐藏层”。“隐藏”就是指肉眼看不见的意思。

看图1时不免会想到上一章的感知机,实际上就连接方式而言,与感知机并无差别,真正存在差异的地方是信号传递的方式。

1.2 激活函数

前一章的感知机中存在一个公式:

引入新函数,将上式改为:

将上述函数称为激活函数,激活函数的作用在于决定如何来激活输入信号的总和。

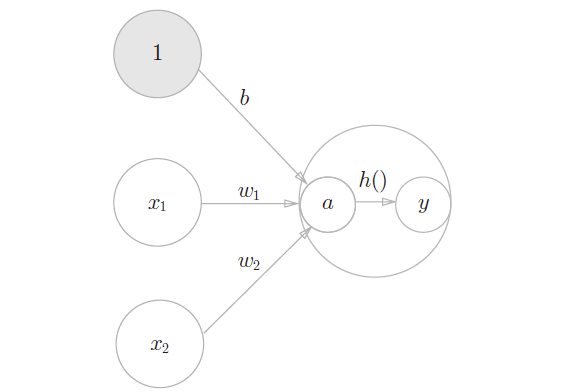

对上式进行改写,分成两个阶段,先计算输入信号的加权总和,在用激活函数转换这个总和。将上述分为:

,

a表示加权输入信号和偏置信号的总和,再利用h()函数转换为输出y。

二、激活函数

激活函数以阈值为界,一旦输入超过阈值,就切换输出。这样的函数一般也称为阶跃函数,因此我们也可以说感知机使用了阶跃函数作为激活函数。

2.1 sigmoid函数

神经网络中最常使用的激活函数就是sigmoid函数:

![]()

sigmoid函数看上去有些复杂,但其也仅仅是一个函数而已,利用python实现形式如下:

def sigmoid(x):

return 1/(1 + np.exp(x))

x = np.array([-1.0, 1.0, 2.0])

result = sigmoid(x)

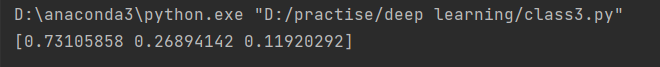

print(result)结果如下:

之所以sigmoid函数的实现能支持Numpy函数是因为Numpy的广播功能。当标量与Numpy数组之间进行运算时,标量会和Numpy数组中的各个元素进行运算。

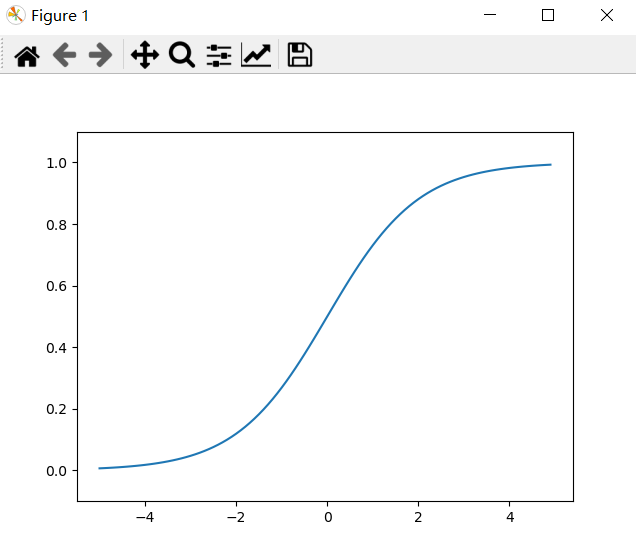

绘制sigmoid函数的图像:

sigmoid函数与阶跃函数之间存在共同点,两者均为非线性函数,神经网络的激活函数必须使用非线性函数,若使用线性函数,神经网络的层数就不再有意义了。

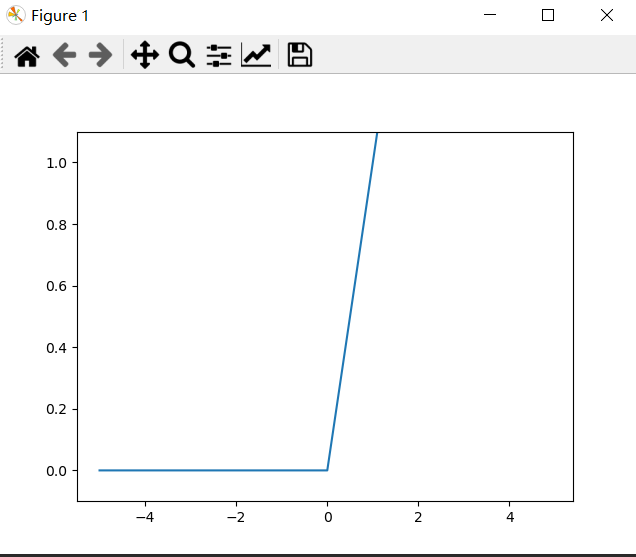

2.2 ReLU函数

ReLU函数再输入大于0时,直接输出该值;在输入小于等于0时,输出0。

ReLU函数可以表示为:

用python实现ReLU函数:

def relu(x):

return np.maximum(0, x)

x = np.arange(-5.0, 5.0, 0.1)

result = relu(x)

plt.plot(x, result)

plt.ylim(-0.1, 1.1)

plt.show()

三、多维数组的运算

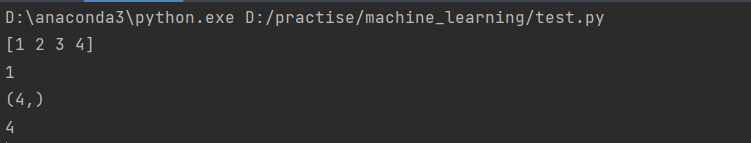

3.1 多维数组

多维数组是“数字的集合”,数字排成一列的集合、排成长方形的集合、排成三维状或者N维状的集合都称为多维数组。

A = np.array([1,2,3,4])

print(A)

res1 = np.ndim(A)

res2 = A.shape

res3 = A.shape[0]

print(res1)

print(res2)

print(res3)结果为:

其中ndim()函数可以获得数组的维度,而数组的形状可以通过实例变量获得数组的形状,A为一维数组,由4个元素组成。A.shape的结果为一个元组。

当输入为三维数组时输出为:

B = np.array([[1,2,3,4], [2,3,4,5], [5,6,7,8], [8,10,22,11]])

res4 = np.ndim(B)

res5 = B.shape

res6 = B.shape[0]

print(B)

print(res4)

print(res5)

print(res6)

计算矩阵的乘法时可以使用dot()函数进行,需要注意的是两个矩阵A,B,A的第一维元素个数必须要和矩阵B的行数相等。

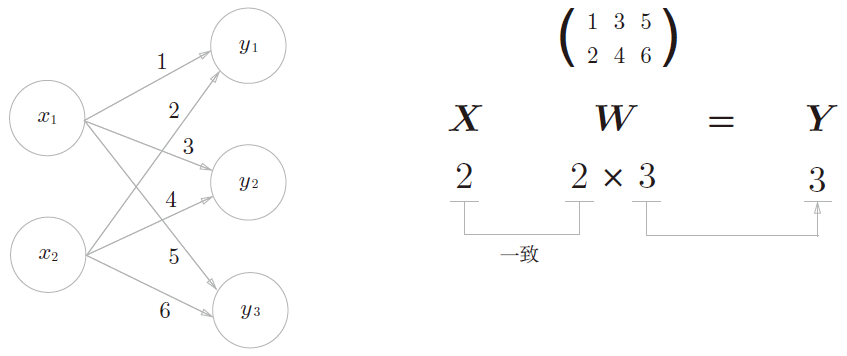

3.2 神经网络的内积

使用Numpy矩阵来实现神经网络。对于图5的神经网络:

python代码实现:

X = np.array([1, 2])

W = np.array([[1, 3, 5], [2, 4, 6]])

Y = np.dot(X, W)

print(Y)四、三层神经网络的实现

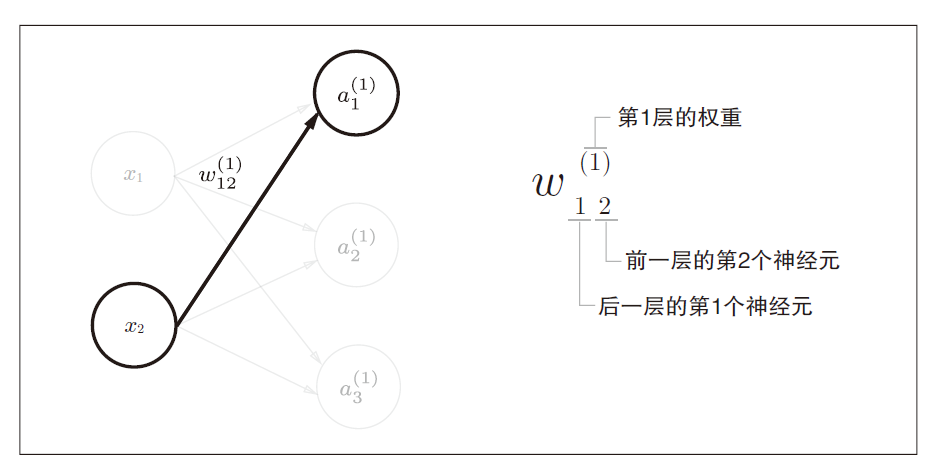

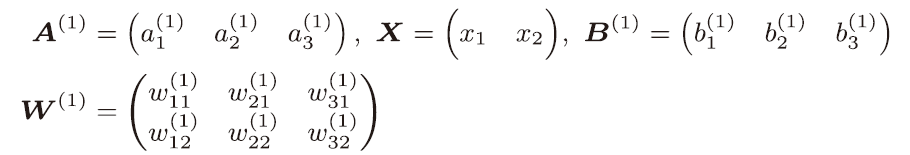

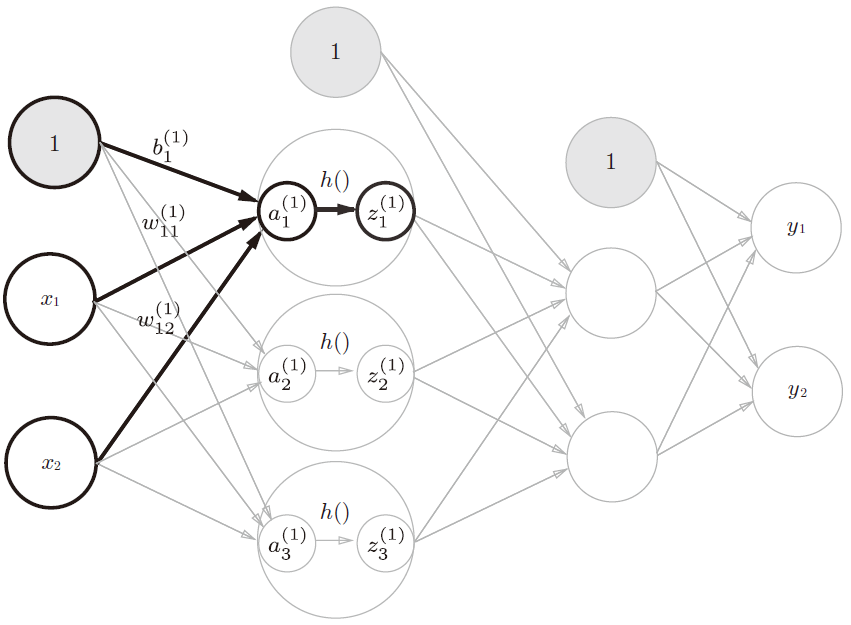

引入图6中的符号便于知识的学习,在图6中权重和隐藏层的神经元的右上角都有一个(1),表示权重与神经元的层号。权重右下角的数字代表后一层神经元与前一层神经元之间的索引号。

4.1 各层之间的信号传递

以下式的内容表示加权信号与偏置组合后的信号:

![]()

使用矩阵的乘法运算后公式变为:

![]()

字母分别代表着:

加上隐藏层中的激活函数后,可以表示为:

激活函数h()为sigmoid函数。接下来就是第一层到第二层的信号传递,以及第二层到第三层的信号传递。

4.2 代码实现

def identity_function(x):

return x

def init_network():

network = {}

network['w1'] = np.array([[0.1, 0.3, 0.5], [0.2, 0.4, 0.6]])

network['b1'] = np.array([0.1, 0.2, 0.3])

network['w2'] = np.array([[0.1, 0.4], [0.2, 0.5], [0.3, 0.6]])

network['b2'] = np.array([0.1, 0.2])

network['w3'] = np.array([[0.1, 0.3], [0.2, 0.4]])

network['b3'] = np.array([0.1, 0.2])

return network

def forward(network, x):

w1, w2, w3 = network['w1'], network['w2'], network['w3']

b1, b2, b3 = network['b1'], network['b2'], network['b3']

a1 = np.dot(x, w1) + b1

z1 = sigmoid(a1)

a2 = np.dot(z1, w2) + b2

z2 = sigmoid(a2)

a3 = np.dot(z2, w3) + b3

y = identity_function(a3)

return y

network = init_network()

x = np.array([1.0, 0.5])

y = forward(network, x)

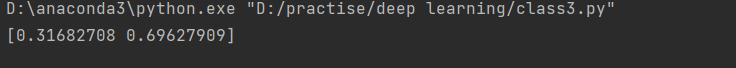

print(y)结果如下:

五、输出层的设计

五、输出层的设计

神经网络可以用在分类问题和回归问题上,但需要根据情况改变输出层的激活函数,一般而言回归问题用恒等函数,分类问题用softmax()函数。

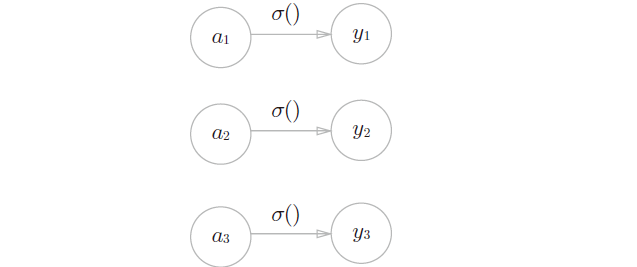

5.1 恒等函数和softmax()函数

恒等函数:

恒等函数会将输入按原样输出,对于输入的信息,不加任何改动直接输出就如上图所示。

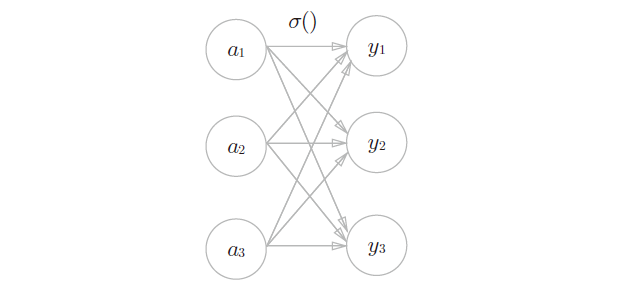

softmax函数:

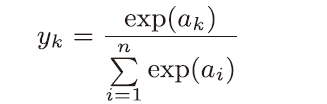

softmax函数可以用下式表示:

它表示了假设输出层有n个神经元,计算第k个神经元的输出。softmax函数的分子是输入信号

的指数函数,分母是所有输入信号的指数函数的和。

python代码实现:

def softmax(a):

c = np.max(a)

exp_a = np.exp(a - c)

sum_exp_a = np.exp(exp_a)

y = exp_a / sum_exp_a

return ysoftmax函数的输出是0.0到1.0之间的实数。且输出的值总和为1。正是有了输出的总和为1这个特性,使用softmax()函数时,才可以把softmax函数的输出解释为“概率”。

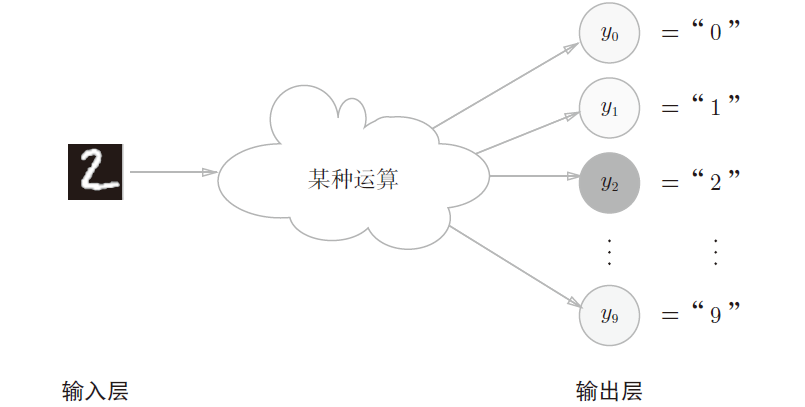

5.2 输出层神经元数量

输出层的神经元数量需要根据待解决的问题来决定。对于分类问题,输出层的神经元数量一般设定为类别的数量。对于某个输入图像,预测是图中的数字0-9中的哪一个问题,可以如图9一样,设定输出层的神经元为10个。

930

930

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?