写在前面

想象一下,你部署的 LLM 应用在高峰期响应缓慢、用户请求大量排队甚至超时失败——这不仅严重影响用户体验,更可能直接导致业务损失。造成并发瓶颈的核心原因之一,就是 LLM 推理本身对计算资源(尤其是 GPU 显存和计算单元)的巨大消耗。

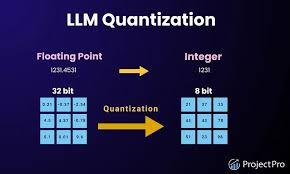

那么,当我们的 LLM 推理服务并发告急时,该如何应对?除了增加硬件投入(这往往成本高昂),模型量化 (Model Quantization) 是一种在不显著牺牲(有时甚至能略微提升)性能的前提下,有效降低模型显存占用、提升推理速度,从而间接提高并发处理能力的关键技术。

LLaMA-Factory 作为一个广受欢迎、易于使用的 LLM 微调和部署框架,也提供了便捷的模型量化功能。本文将深入探讨:

- LLM 推理服务并发不足的典型场景。

- 模型量化的核心原理与主流方法(AWQ 与 GPTQ)。

- 如何使用 LLaMA-Factory 实现这两种量化方法。

- 不同量化方式对并发能力提升的预估与分析。 <

订阅专栏 解锁全文

订阅专栏 解锁全文

952

952

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?