flash-attn库安装记录

第一步:

安装好cuda11.7

第二步:

使用代码export CUDA_HOME=/usr/local/cuda-11.7让库找到cuda路径

第三步:

使用pip install flash-attn --no-build-isolation安装

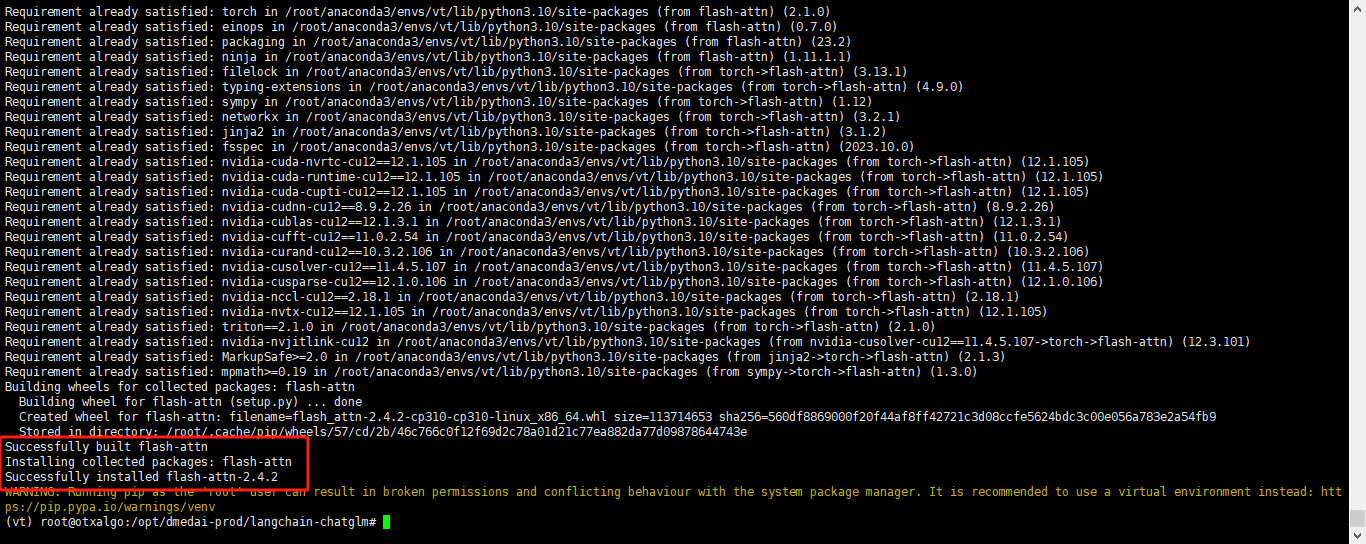

安装成功显示

更新:

手动下载flash-attn库网址未为https://github.com/Dao-AILab/flash-attention/releases

更新2:

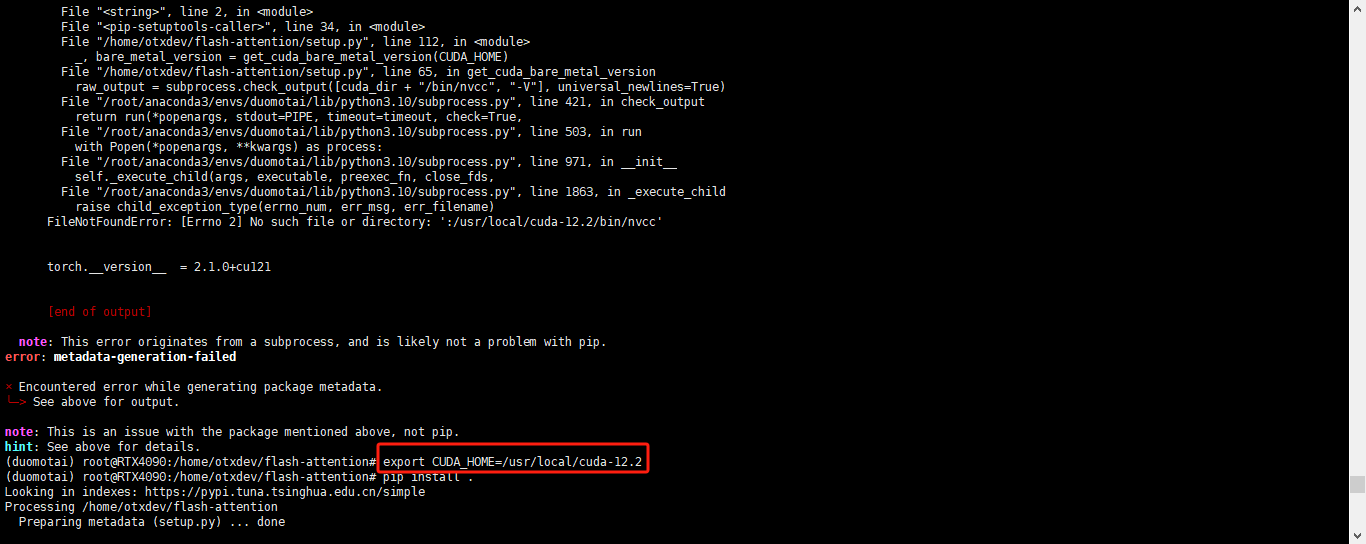

安装cuda12.2,cudnn8.9.5-12.2

第一步下载:git clone https://github.com/Dao-AILab/flash-attention

第二步引导cuda12.2路径:export CUDA_HOME=/usr/local/cuda-12.2

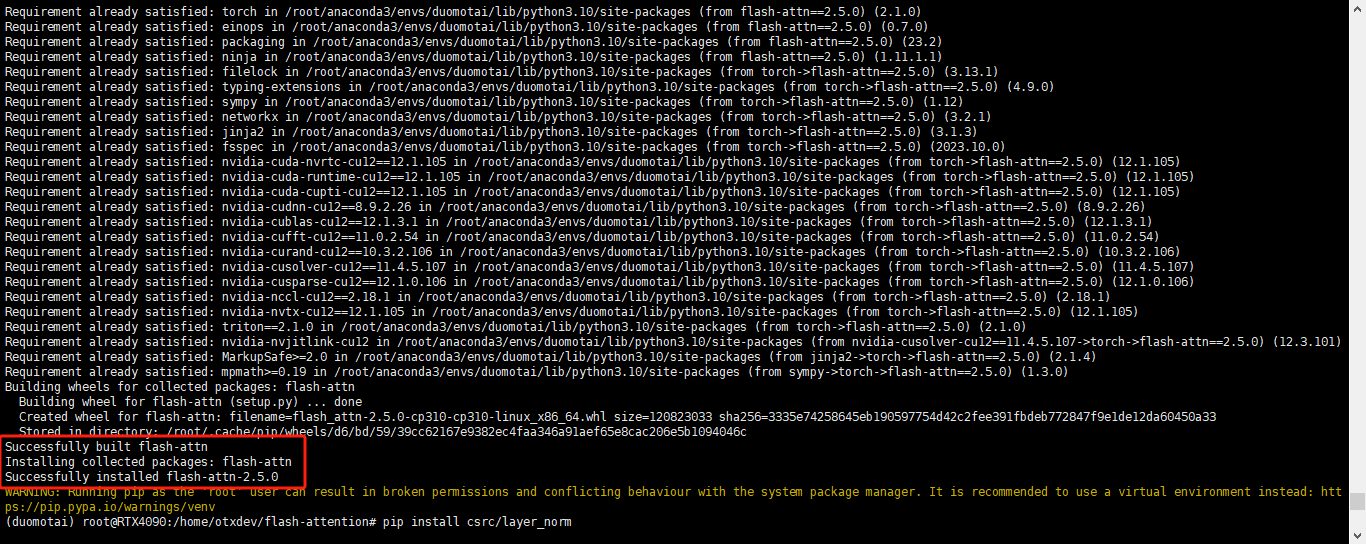

第三步:cd flash-attention && pip install .

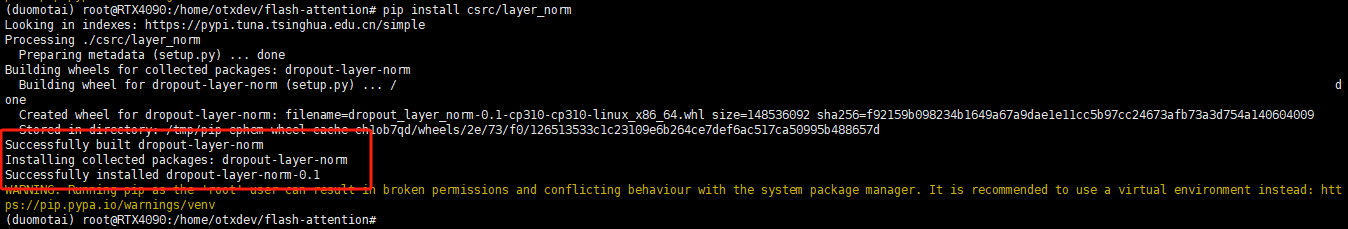

第四步:pip install csrc/layer_norm

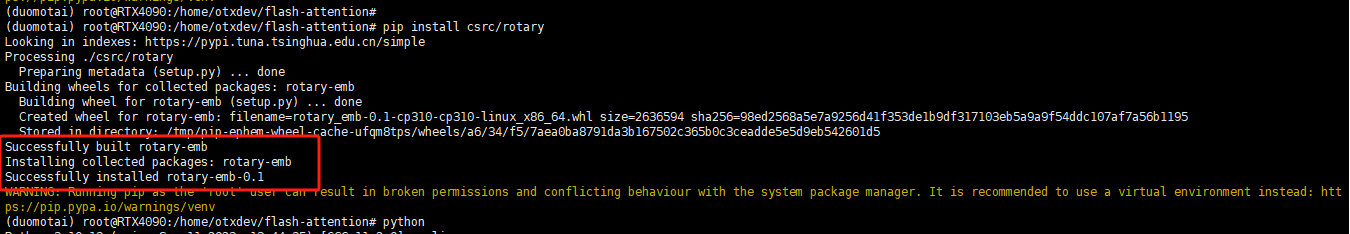

第五步:pip install csrc/rotary

最后成功!!!

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?