源自:《兵器装备工程学报》

作者:严硕, 徐永能, 何文韬

“人工智能技术与咨询” 发布

摘要

针对地铁工程车辆故障文本数据未得到合理利用的现象,提出了一种基于自然语言处理的故障智能诊断方法。该方法对故障文本进行预处理,采用Word2vec进行文本表示与词向量训练,运用LSTM与Softmax组成的RNN模块完成故障诊断,引入SMOTE算法处理文本数据类别不平衡问题,以提高诊断精度。以某地铁设备中心的工程车辆故障数据为例,进行实验,精确率与召回率分别达到86.30%和86.68%。结果表明:新方法能够提升地铁工程车辆的故障诊断准确性,为地铁设备故障智能诊断和故障文本的利用提供解决思路。

关键词

故障诊断;工程车辆;自然语言处理;故障文本数据;RNN

1 引言

近几年我国城市轨道交通高速发展,各城市运营线路数量与运营里程呈现逐年递增的趋势。随着城市地铁网络的逐渐形成,系统设备故障数量明显增加。其中,工程车辆作为维护城市地铁正常运营的重要车辆,在运营维护过程中积累了大量故障文本数据,这些数据蕴含了地铁工程车辆安全的重要信息,长期由维保人员依据经验与专家知识进行故障诊断与分类。由于缺乏监控数据且技术水平有限,维保人员主要依靠非结构化文本形式的故障数据来进行故障诊断。这些故障记录文本数据存在主观性与不准确性,进而影响故障诊断的准确性。同时,海量的故障文本若不能得到合理利用,也会造成资源堆积浪费。在智慧城轨和大数据技术发展的背景下, 亟需研究基于自然语言处理的机器学习算法,实现地铁工程车辆的故障智能诊断。

国内外学者在故障诊断领域取得了丰富的研究成果,故障诊断方法逐渐多样化[1]。近年来自然语言处理技术迅速发展,在国发[2017]35号文件中,自然语言处理被视为关键共性技术[2],已广泛应用于网络论坛[3]、新闻[4]等领域。众多学者的研究表明以自然语言处理技术实现故障诊断的核心在于选择合适的文本表示方法与文本分类器。传统的文本表示方法有独热编码[5](one-hot encoding)、词频-逆文档频度[6](term frequency-inverse document frequency,TF-IDF)等。但独热编码、TF-IDF等方法未考虑字词间顺序与相关性,易导致词向量维度过大,增加诊断难度。故障诊断更加注重文本上下文的顺序与相关性,因而Word2Vec生成特征向量[7]、故障文本相似度计算[9]等方法得到应用,这些方法能降低向量维度、将向量与上下文特征进行融合。在构建文本分类器时,支持向量机[10-12]、朴素贝叶斯[13-14]等机器学习算法得到了广泛应用,研究表明它们在故障分类与诊断等方面具有良好表现。但早期的机器学习算法在挖掘文本深层语义方面表现欠佳,不适应大数据技术的发展需求。而深度学习模型文本特征挖掘能力表现更优,更符合智能运维背景下的轨道交通设备故障诊断需求。

从综合考虑地铁工程车辆故障文本记录数据特征出发,以提高故障诊断准确率为优化目标,以RNN与LSTM算法为基础,提出了一种基于自然语言处理的地铁工程车辆故障智能诊断模型。将文中所用算法模型与经典自然语言处理算法进行对比,验证其有效性。实验表明,该算法模型能为智能运维背景下地铁工程车辆故障智能诊断与故障文本的利用提供重要解决思路。

2 RNN与LSTM模型

2.1 RNN模型

在神经网络训练过程中,给定输入并通过优化算法与反向传播调整神经网络模型参数,便于输出最佳的训练结果。早期神经网络算法的输出结果往往只考虑某时刻单个输入的影响。对于一些与时间先后顺序有关的序列信息(如文本、语音、视频等),标准神经网络的应用面临几个困境:第一,只考虑单一时刻的输入,不考虑输入数据之间的相互关系会明显降低输出结果的可用性;第二,不同样本的输入输出长度具有明显差异时,标准神经网络需要对整体结构进行调整,通用性明显降低;第三,标准神经网络不能共享其在文本中学习的特征。在这种研究需求下,RNN应运而生。

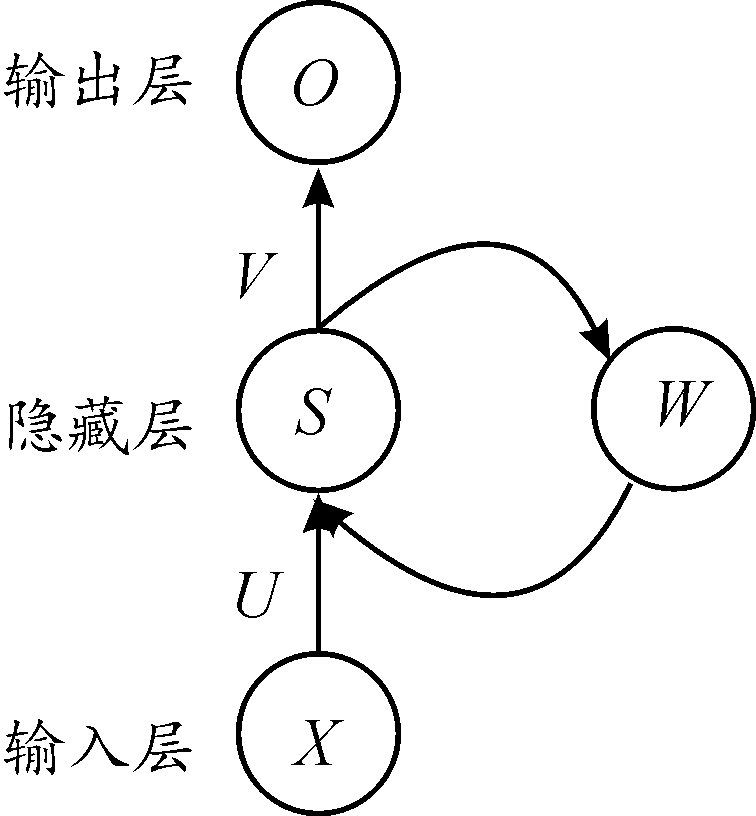

20世纪80年代研究者提出了循环神经网络(recurrent neural network,RNN)的模型,并于21世纪初为众多研究者广泛应用于不同领域[15]。在标准神经网络的基础上,RNN模型在处理序列数据某时刻的输入时,不仅考虑了前一时刻的输入,还能记忆网络前面的内容,帮助整个模型更好地去理解序列数据的前后逻辑关系。RNN由输入层、输出层与隐藏层组成,其主要结构件如图1所示。

对标管理是企业精细化管理的重要组成部分,也是企业对标工作的关键。合成分厂将吸取经验教训,在今后的工作中,将对标管理在实践中的应用进行重点完善和改进,及时总结、及时分析、及时调整,持续改进和提高。

图1 RNN模型结构件示意图

由图1可知,RNN模型中的输入进入隐藏层后的每一次计算结果都会得到保留,并作为下一次隐藏层计算的输入之一,不同时刻对应有不同的输出,相应的计算公式分别如下。

Ot=g(V·St)

(1)

St=f(U·Xt+W·St-1)

(2)

式(1)与式(2)中,Ot为RNN模型t时刻的输出,U、V、W为RNN模型各层之间的传递参数(传递参数W可以共享),St为RNN模型t时刻的隐藏层计算结果,Xt为t时刻模型获得的输入, f与g为激活函数(根据具体情况需求选择相应的激活函数)。

RNN模型在不同时刻对参数W进行了共享,实现了对序列数据的特征提取,RNN模型在不同时刻组成的时间轴展开的结构如图2所示。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?