最近在看机器学习时,看到一章关于稀疏学习的,之前有了解过稀疏表示与压缩感知,但是两者之间的差异并不是很清楚,今天就总结一下吧

稀疏表示

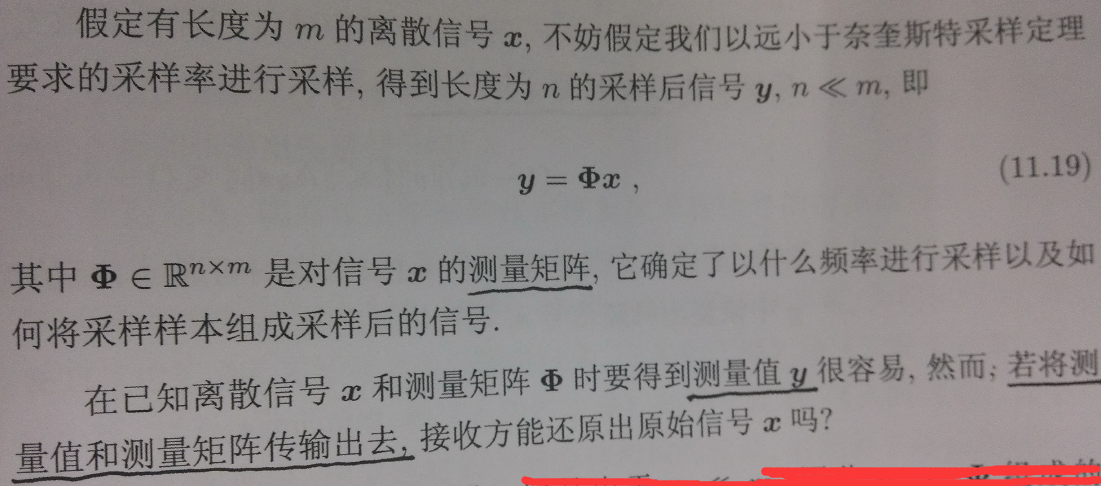

稀疏域模型(Sparse-Land Model)即信号的稀疏表示,它意欲用尽可能少的非0系数表示信号的主要信息,从而简化信号处理问题的求解过程。稀疏域模型可如表达式(1)所示,其中y∈R^n为待处理信号,A∈R^(n×m)为基函数字典,x∈R^m为稀疏表示向量, ||x||_0≪m。||x||_0为x的稀疏度,它表示x中非0稀疏的个数。

可以看做是在一个字典上我们对现有的一个文章进行新的编码,只是这个编码相对于这个字典和原始的数据来说是稀疏的,如上图等号的左侧可以看做是原始的输入信号,中间的彩色部分是字典,最右侧是编码出来的稀疏表示。(这是从表面的直观上的解释)。

在小一点的解释是字典是一组可以表征原始信号的一组特征基,通过对基的组合可以表征原始的图像,在计算式通常是在原始图像与解码的的图像上的残差加上一个稀疏的约束来生成字典和编码,这个约束理论上最好是L0范式,但是L0范式是NP问题,很难正向解出来,但是他有个好的近似的解L1约束来帮其完成使命。在使用中由于L1范式的解很耗时,人们就使用L2范式来代替,但是会出现稀疏性下降。

在说一下范式吧,L0范式是求非零元素的个数; L1范式求的是所有元素的绝对值之和; L2范式求的是元素的平方和。

L1与L2范式在模型中使用的范围是很广泛的,通常是用作正则化,具有一定降低过拟合的效果,只是L1范式较L2范式有较好的系数性质。

如此表示就可以算是稀疏表示了,但是关于稀疏的优化,及稀疏的求解还是有很多值得研究的,这个方面就有点偏向数学了,在下就不过多解释了。

压缩感知

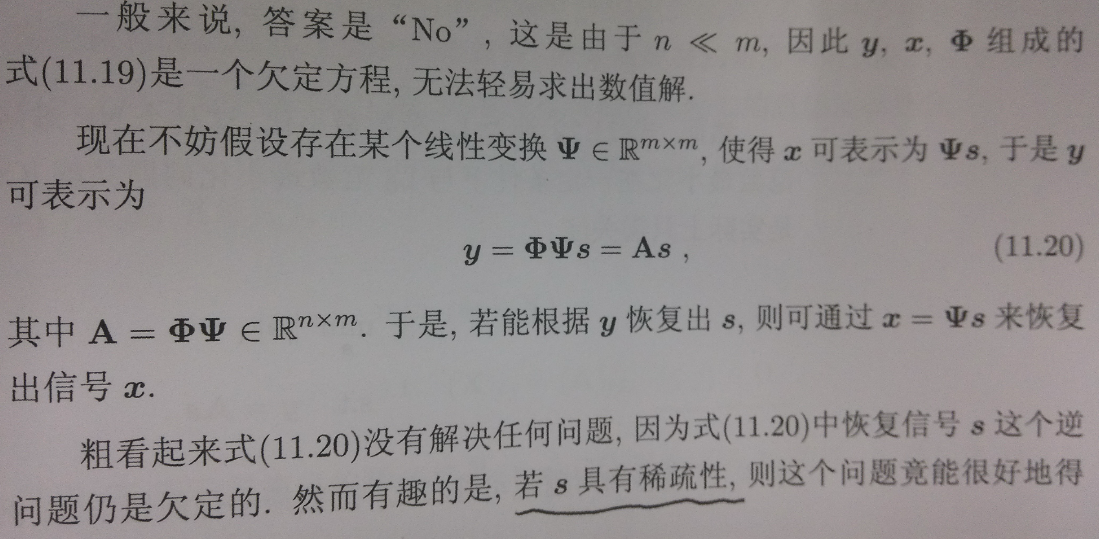

压缩感知更多的关于信息传播过程中的压缩与还原的角度。及发送信号前压缩信号,将信号传播至接受出将信号进行还原,在此压缩感知主要是想通过接收到的信息(是指少量的信息)来尽量还原出原始的信息。

来看一下压缩感知的公式:(摘自书中)

在使用中就是利用稀疏性使得未知因素的影响大大减少,进而在进行还原时可以尽量大还原。

压缩感知与稀疏表示不同,其更关注于如何利用信号本身所具有的稀疏性,从部分观测样本中恢复原始信号。

通常认为压缩感知是由 感知测量和重构恢复两个阶段来完成的。

但是在重构恢复的方面其实还是使用一些稀疏表示的原理,压缩感知的理论上比较复杂。常用的是RIP(限制灯具的要求)。

以上只是简单地介绍,感兴趣的可以去深入的了解。稀疏的原理在实际的使用中是比较广泛的。

7744

7744

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?