注意:分布和概率有时候会混乱,有时候P(X)表示X的分布,有时候用F(X),有时候用p(X),具体的直接看作者说它是啥就是啥吧

分布函数

要求 F ( X ) F(X) F(X),实际上是 F X ( x ) = P { X < x } F_X(x)=P\{X<x\} FX(x)=P{X<x}

联合分布

P ( X , Y ) P(X,Y) P(X,Y),表示X,Y同时发生的概率的分布

边缘分布

P

(

X

)

=

P

(

X

,

Y

=

∞

)

P(X) = P(X,Y=\infty)

P(X)=P(X,Y=∞)

即当Y可以取所有值时,或者说不考虑Y的取值时,X的概率分布

条件分布

和条件概率公式一样

p

(

X

∣

Y

)

=

p

(

X

,

Y

)

/

p

(

Y

)

p(X|Y) = p(X,Y)/p(Y)

p(X∣Y)=p(X,Y)/p(Y)

即

p

(

X

,

Y

)

=

p

(

X

∣

Y

)

∗

p

(

Y

)

=

p

(

Y

∣

X

)

∗

p

(

X

)

p(X,Y)=p(X|Y)*p(Y)=p(Y|X)*p(X)

p(X,Y)=p(X∣Y)∗p(Y)=p(Y∣X)∗p(X)

利用上述公式从而可推导出三个即以上随机变量的条件分布与联合分布的转换公式

互信息

I

(

X

;

Y

)

=

H

(

X

)

−

H

(

X

∣

Y

)

I(X;Y) =H(X)-H(X|Y)

I(X;Y)=H(X)−H(X∣Y)

即X和Y的互信息=X的信息量 — 知道Y后,X的信息量(其实就是信息增益,在知道Y后,X的信息量的变化量)

或者说,x的信息量–Y中与x重复的信息量(“知道Y后,X的信息量”实际是因为知道Y后,Y中与X重复的部分就知道了,X的不确定性就减少了)

所以,互信息越大,表明重复的信息量越少,X和Y重复的信息越多,这也应该就是为什么叫“互信息”

注意这里是分号不是逗号,逗号的话可能就是x,y一起的信息量了,也就是两个事件同时发生的信息量

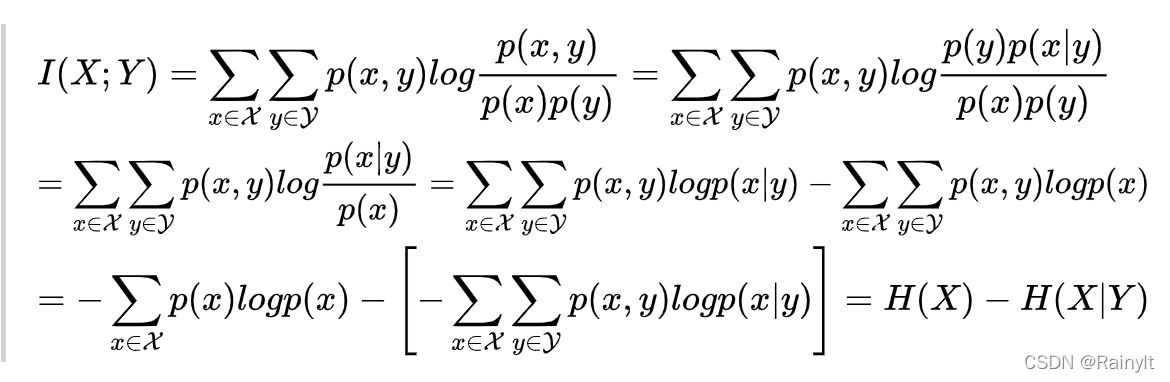

互信息定义:

从定义推导到上面的相减的结果:

很简单,用到的其实就条件概率和联合概率的转换公式,看完最前面几个公式完全可以cover,别被吓到了。

最后的一个等式,前者来自信息熵的定义,后者来自条件熵的定义

6007

6007

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?