4.1 多维特征

参考视频: 4 - 1 - Multiple Features (8 min).mkv

前几章,我们学习了单变量/特征的回归模型,现在我们对房价模型增加更多的特征,

例如房间数楼层等,构成一个含有多个变量的模型,模型中的特征为(𝑥1, 𝑥1, . . . , 𝑥𝑛)。

增添更多特征后,我们引入一系列新的注释:

𝑛 代表特征的数量

𝑥(𝑖)代表第 𝑖 个训练实例,是特征矩阵中的第𝑖行,是一个向量(vector)。

例如,上图的𝑥(2) = [1416

32

40 ],

𝑥𝑗(𝑖)代表特征矩阵中第 𝑖 行的第 𝑗 个特征,也就是第 𝑖 个训练实例的第 𝑗 个特征。

例如,上图的𝑥2(2) = 3, 𝑥3(2) = 2,

支持多变量的假设 ℎ 表示为:ℎ𝜃(𝑥) = 𝜃0 + 𝜃1𝑥1 + 𝜃2𝑥2+. . . +𝜃𝑛𝑥𝑛,

这个公式中有𝑛 + 1个参数和𝑛个变量,为了使得公式能够简化一些,引入𝑥0 = 1,则公

式转化为:ℎ𝜃(𝑥) = 𝜃0𝑥0 + 𝜃1𝑥1 + 𝜃2𝑥2+. . . +𝜃𝑛𝑥𝑛

此时模型中的参数是一个𝑛 + 1维的向量,任何一个训练实例也都是𝑛 + 1维的向量,特

征矩阵𝑋的维度是 𝑚 ∗ (𝑛 + 1)。 因此公式可以简化为:ℎ𝜃(𝑥) = 𝜃𝑇𝑋,其中上标𝑇代表矩阵

转置。

4.2 多变量梯度下降

参考视频: 4 - 2 - Gradient Descent for Multiple Variables (5 min).mkv

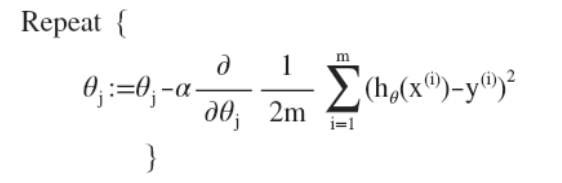

与单变量线性回归类似,在多变量线性回归中,我们也构建一个代价函数,则这个代价

函数是所有建模误差的平方和,

即:𝐽(𝜃0, 𝜃1. . . 𝜃𝑛) = 12𝑚 ∑ (ℎ𝜃(𝑥(𝑖)) − 𝑦(𝑖)) 𝑚 2 𝑖=1 ,

其中:ℎ𝜃(𝑥) = 𝜃𝑇𝑋 = 𝜃0 + 𝜃1𝑥1 + 𝜃2𝑥2+. . . +𝜃𝑛𝑥𝑛 ,

我们的目标和单变量线性回归问题中一样,是要找出使得代价函数最小的一系列参数。

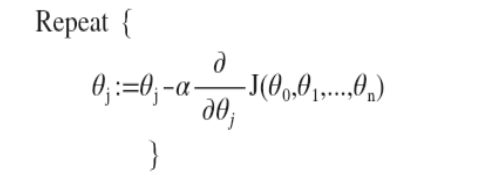

多变量线性回归的批量梯度下降算法为:

即:

求导数后得到:

当𝑛 >= 1时,

我们开始随机选择一系列的参数值,计算所有的预测结果后,再给所有的参数一个新的值,如此循环直到收敛。

4.3 梯度下降法实践 1-特征缩放

参考视频: 4 - 3 - Gradient Descent in Practice I - Feature Scaling (9

min).mkv

以房价问题为例,假设我们使用两个特征,房屋的尺寸和房间的数量,尺寸的值为 0- 2000 平方英尺,而房间数量的值则是

0-5,以两个参数分别为横纵坐标,绘制代价函数的等 高线图能,看出图像会显得很扁,梯度下降算法需要非常多次的迭代才能收敛。

解决的方法是尝试将所有特征的尺度都尽量缩放到-1 到 1 之间。

如图:

4.4 梯度下降法实践 2-学习率

参考视频: 4 - 4 - Gradient Descent in Practice II - Learning Rate (9

min).mkv

梯度下降算法收敛所需要的迭代次数根据模型的不同而不同,我们不能提前预知,我们

可以绘制迭代次数和代价函数的图表来观测算法在何时趋于收敛。

也有一些自动测试是否收敛的方法,例如将代价函数的变化值与某个阀值(例如 0.001)

进行比较,但通常看上面这样的图表更好。

梯度下降算法的每次迭代受到学习率的影响,如果学习率𝑎过小,则达到收敛所需的迭

代次数会非常高;如果学习率𝑎过大,每次迭代可能不会减小代价函数,可能会越过局部最

小值导致无法收敛。

通常可以考虑尝试些学习率:

𝛼 = 0.01,0.03,0.1,0.3,1,3,10

4.5 特征和多项式回归

参考视频: 4 - 5 - Features and Polynomial Regression (8 min).mkv

我们先来看一个房价问题

通常我们需要先观察数据然后再决定准备尝试怎样的模型。

另外,我们可以令:

𝑥2 = 𝑥22, 𝑥3 = 𝑥33,这就是转化为线性回归的问题。

根据函数图形特性,我们还可以使:

ℎ𝜃(𝑥) = 𝜃0 + 𝜃1(𝑠𝑖𝑧𝑒) + 𝜃2(𝑠𝑖𝑧𝑒)2

或者: ℎ𝜃(𝑥) = 𝜃0 + 𝜃1(𝑠𝑖𝑧𝑒) + 𝜃2√𝑠𝑖𝑧𝑒

注:如果我们采用多项式回归模型,在运行梯度下降算法前,特征缩放非常有必要。

4.6 正规方程

参考视频: 4 - 6 - Normal Equation (16 min).mkv

总结一下,就是当数据集较少时,我们选用正规方程,而数据集较大时,我们选用梯度下降。这里的数据集的多少,吴教授推荐的是10000。

下面上代码:

6155

6155

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?