NeurIPS 2019 作者:NAVER LABSEurope

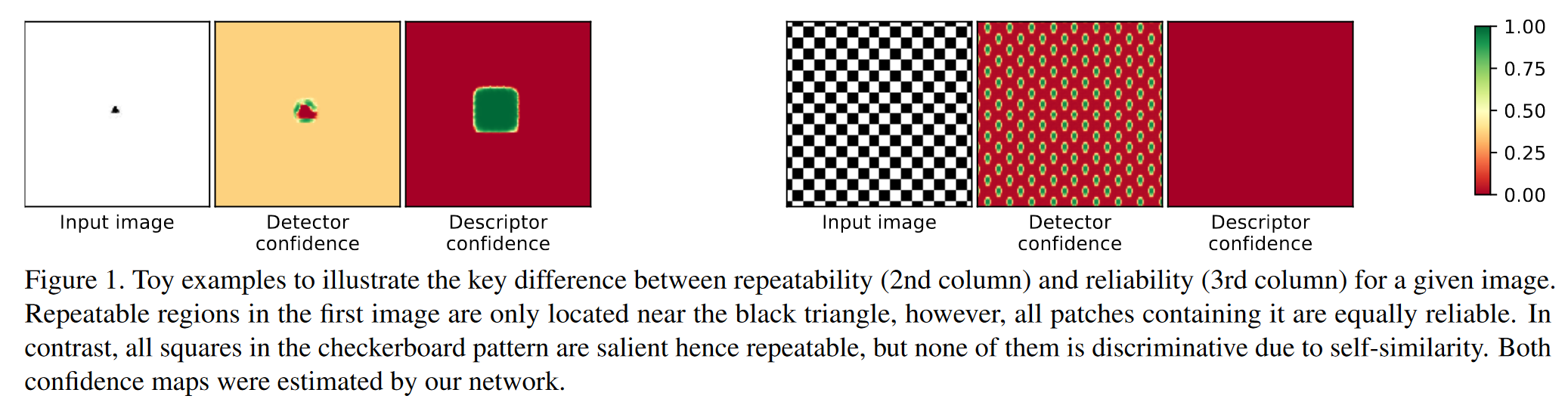

本篇文章提出了同时完成稀疏特征检测和特征描述(detect-and-descibe),作者认为显著的区域不一定具有判别性,因此会影响描述的性能,所以为描述子添加增加了一个置信度。输出稠密的描述子+可靠性(匹配)和可重复性(检测)的置信度,得到的匹配是两个置信度的最大化。---无监督学习

Background

传统的特征检测和描述是先检测特征点再完成局部描述符,人工设计的方法受限于先验知识,深度学习的方法可以自动找到适合的表示方法,但目前的许多方法都只关注关键点检测的重复性

度量学习的方法在检测到的可重复性的关键点上训练得到描述子,但难以准确匹配

目前特征描述常用的方法是度量学习,使用the triplet loss或者a contrastive loss

特征检测传统方法依赖先验,深度学习方法有的对关键点的显著图峰值进行激励,有的通过自然图像变换来保留

检测+描述:LIFT、Superpoint、D2-NET(定义特征点为局部最大值)

Motivation

显著的区域不一定具有判别性,比如棋盘

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1272

1272