Abstract

近些年因为Siamese在RGB跟踪中的优秀表现,其在RGB-T跟踪中也逐渐流行。尽管Siamese网络可以达到实时跟踪更快的速度,但像比如其他RGB-T跟踪器来说,现存的Siamese网络的精度仍然较低且鲁棒性较差。

为了解决以上问题,本文提出了a new complementarity- and distractor-aware RGB-T tracker based on Siamese network, 称为SiamCDA。其中几个重要模块包括:

- FPN (feature pyramid network) 捕获单模态内特征的cross-level信息;

- CA-MF (a complementarity-aware multi-modal feature fusion module) 捕获两种模态间的跨模态信息;

- DAS (a distractor-aware region prposal selection module) 用于在边界框选择阶段进一步增强tracker的鲁棒性。

I. Introduction

目标跟踪现状:VOT旨在一段视频序列中估计一个任意目标的位置,这个目标仅在第一帧给出他的定位。VOT是CV中一个基础的研究任务,可用于大量实际应用中如视频监控、无人驾驶和人机交互等。随着数学建模技术的探索,尤其是深度学习,近期先进的跟踪方法聚焦于使用大量带标签的视频数据集以离线的方式训练一个端到端的网络,其性能随着更有效的架构的设计和数据集的公开在不断地提升。但是,大部分VOT算法关注于单模态跟踪,特别是RGB跟踪,其面对许多因素时还有很大的挑战,如目标严重遮挡、剧烈形变和光照变化等。

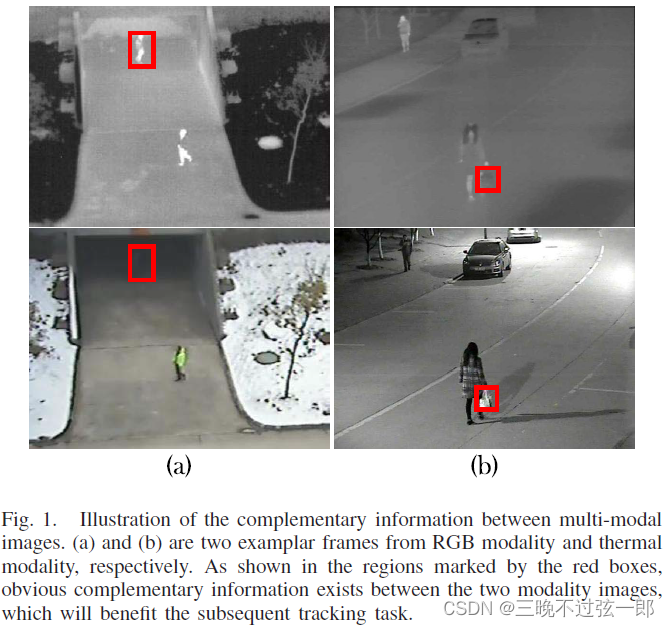

RGB-T背景介绍:近期,一些研究者试图应用多模态数据来跟踪,如RGB-D和RGB-T。其中,RGB-T跟踪更引人注目因为RGB图像和热成像图像间的互补信息,如下图所示:

- RGB images can capture rich target information but are susceptible to environments.

- Thermal images information are not sensitive to illumination change and have strong ability to penetrate the haze but they lack the detailed texture information of the targets.

已有的RGB-T的trackers: 1. 传统方式(手工提取的特征),无法应对具有挑战的环境,如目标剧烈形变,复杂背景,目标快速移动和遮挡等;2. 基于CNN的方法,比传统的方法明显更好,但无法达到

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1350

1350

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?