马尔科夫网络属于无向图模型

条件独立性体现在三个方面:

条

件

独

立

性

:

{

全

局

:

X

A

⊥

X

B

∣

X

C

局

部

:

x

i

⊥

x

i

−

n

b

∣

x

n

b

给

定

x

i

的

邻

居

x

n

b

情

况

下

,

x

i

独

立

于

x

i

的

非

邻

居

成

对

:

x

i

⊥

x

j

∣

x

−

i

,

j

给

定

所

有

非

x

i

和

x

j

情

况

下

,

x

i

独

立

于

x

j

条件独立性: \begin{cases} 全局:\quad X_A \bot X_B |X_C\\ 局部: \quad x_i \bot x_{i-nb}|x_{nb} 给定x_i的邻居x_{nb}情况下,x_i独立于x_i的非邻居 \\ 成对: \quad x_i \bot x_j|x_{-i,j} 给定所有非x_i和x_j情况下,x_i独立于x_j \end{cases}

条件独立性:⎩⎪⎨⎪⎧全局:XA⊥XB∣XC局部:xi⊥xi−nb∣xnb给定xi的邻居xnb情况下,xi独立于xi的非邻居成对:xi⊥xj∣x−i,j给定所有非xi和xj情况下,xi独立于xj

三个方面可以相互转换

全 局 < < = = > > 局 部 < < = = > > 成 对 全局<<==>>局部<<==>>成对 全局<<==>>局部<<==>>成对

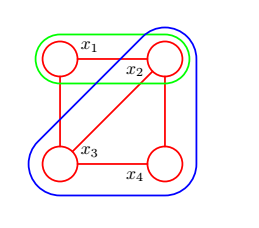

团和最大团的概念:

团:两两相连的节点叫做团

最大团:不能再添加任何节点的团叫做最大团

比如上图中

(

x

1

,

x

2

)

,

(

x

1

,

x

3

)

(

x

1

,

x

2

,

x

3

)

,

(

x

2

,

x

3

,

x

4

)

(x_1,x_2),(x_1,x_3)(x_1,x_2,x_3),(x_2,x_3,x_4)

(x1,x2),(x1,x3)(x1,x2,x3),(x2,x3,x4)都叫团,其中

(

x

1

,

x

2

,

x

3

)

,

(

x

2

,

x

3

,

x

4

)

(x_1,x_2,x_3),(x_2,x_3,x_4)

(x1,x2,x3),(x2,x3,x4)

是最大团

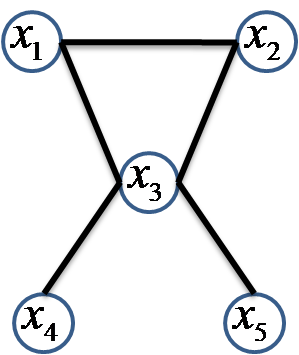

接下来我们可以顺利讨论怎么分解因子写出来联合概率了,但是由于公式看着理解比较棘手,我们先看一个具体的例子算式,这样有助于我们理解公式

此图包含三个最大团

C

1

=

(

x

1

,

x

2

,

x

3

)

,

C

2

=

(

x

3

,

x

4

)

,

C

3

=

(

x

3

,

x

5

)

C_1=(x_1,x_2,x_3),C_2=(x_3,x_4),C_3=(x_3,x_5)

C1=(x1,x2,x3),C2=(x3,x4),C3=(x3,x5)

那么此马尔科夫网络的联合概率分布可以写为:

p

(

x

1

,

x

2

,

x

3

,

x

4

,

x

5

)

=

1

Z

ψ

(

X

C

1

)

ψ

(

X

C

2

)

ψ

(

X

C

3

)

=

1

Z

ψ

(

x

1

,

x

2

,

x

3

)

ψ

(

x

3

,

x

4

)

ψ

(

x

3

,

x

5

)

=

1

Z

∏

ψ

(

X

C

i

)

p(x_1,x_2,x_3,x_4,x_5)= \displaystyle \frac{1}{Z} \psi(X_{C_1}) \psi(X_{C_2}) \psi(X_{C_3}) = \displaystyle \frac{1}{Z} \psi(x_1,x_2,x_3) \psi(x_3,x_4) \psi(x_3,x_5) =\displaystyle \frac{1}{Z} \prod \psi(X_{C_i})

p(x1,x2,x3,x4,x5)=Z1ψ(XC1)ψ(XC2)ψ(XC3)=Z1ψ(x1,x2,x3)ψ(x3,x4)ψ(x3,x5)=Z1∏ψ(XCi)

其中:

Z

=

∑

∏

ψ

(

X

C

i

)

=

∑

1

∑

2

∑

3

.

.

.

∑

p

∏

ψ

(

X

C

i

)

叫

做

归

一

化

因

子

Z=\sum \prod \psi(X_{C_i}) = \displaystyle \sum_1\sum_2\sum_3...\sum_p \prod \psi(X_{C_i})叫做归一化因子

Z=∑∏ψ(XCi)=1∑2∑3∑...p∑∏ψ(XCi)叫做归一化因子

ψ

(

X

C

i

)

叫

做

势

函

数

,

是

指

数

函

数

\psi(X_{C_i}) 叫做势函数,是指数函数

ψ(XCi)叫做势函数,是指数函数

ψ

(

X

C

i

)

=

e

x

p

{

−

E

(

X

C

i

)

}

,

E

表

示

能

量

函

数

\psi(X_{C_i})=exp\{-E(X_{C_i})\},E表示能量函数

ψ(XCi)=exp{−E(XCi)},E表示能量函数

比如

ψ

(

X

C

2

)

=

e

x

p

{

E

(

X

C

2

)

}

=

e

x

p

{

−

E

(

x

3

,

x

4

)

}

\psi(X_{C_2})=exp\{E(X_{C_2})\}=exp\{-E(x_3,x_4)\}

ψ(XC2)=exp{E(XC2)}=exp{−E(x3,x4)}

重写无向图联合概率公式:

P

(

X

)

=

1

Z

∏

i

k

ψ

(

X

C

i

)

P(X)=\displaystyle \frac{1}{Z} \prod_i^k \psi(X_{C_i})

P(X)=Z1i∏kψ(XCi)

而基于最大团的联合概率和无向图的条件独立性等价,这点由Hammersley-Clifford定理保证

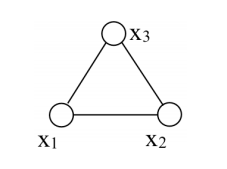

因子图

因子图可以看作是对势函数的进一步分解

p

(

x

1

,

x

2

,

x

3

)

=

ψ

(

x

1

,

x

2

,

x

3

)

p(x_1,x_2,x_3) = \psi(x_1,x_2,x_3)

p(x1,x2,x3)=ψ(x1,x2,x3)

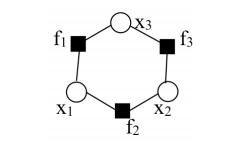

因子图的表现形式如下:

在每个相连的节点间都插入因子节点(函数节点),概率的表现形式如下:

p

(

x

1

,

x

2

,

x

3

)

=

f

1

(

x

1

,

x

3

)

f

2

(

x

1

,

x

2

)

f

3

(

x

2

,

x

3

)

p(x_1,x_2,x_3) = f_1(x_1,x_3)f_2(x_1,x_2)f_3(x_2,x_3)

p(x1,x2,x3)=f1(x1,x3)f2(x1,x2)f3(x2,x3)

5507

5507

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?