学习目标

用逻辑回归解决图像二分类问题

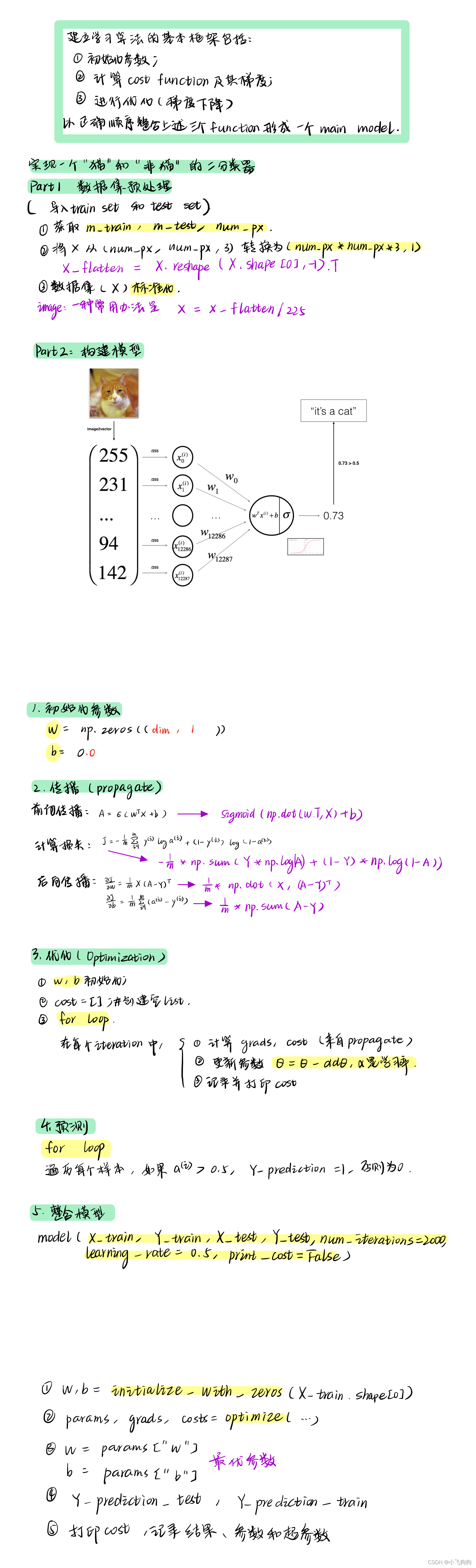

学习笔记

学习时间

2022.6.23

总结

- 逻辑回归实际上是一个非常简单的神经网络;

- 模型进一步优化的方法:

调整学习率(learning_rate)、迭代次数(num_iterations);

尝试不同的初始化方法并比较结果;

尝试其他预处理(将数据居中,或将每行除以其标准偏差); - 关于学习率:

不同的学习率会带来不同的损失,因此会有不同的预测结果;

如果学习率太大,cost可能会上下波动。 甚至可能会发散;

较低的损失并不意味着模型效果很好。当训练精度比测试精度高很多时,就会发生过拟合情况;

所以在深度学习中,通常:

选择好能最小化损失函数的学习率。

如果模型过拟合,使用其他方法来减少过拟合。

需要注意的地方

- w的维度是(m_train,1),m是训练样本的数量;

- b初始化为0.0,类型是float;

- 反向传播的公式推导(还没明白)。

1735

1735

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?